Claude Opus 4.7

Claude Opus 4.7 er Anthropic's flagskibsmodel med et 1-million-token context window, adaptiv reasoning og 3,3x højere vision-opløsning til enterprise-skala...

Om Claude Opus 4.7

Lær om Claude Opus 4.7s muligheder, funktioner og hvordan den kan hjælpe dig med at opnå bedre resultater.

Modeloversigt

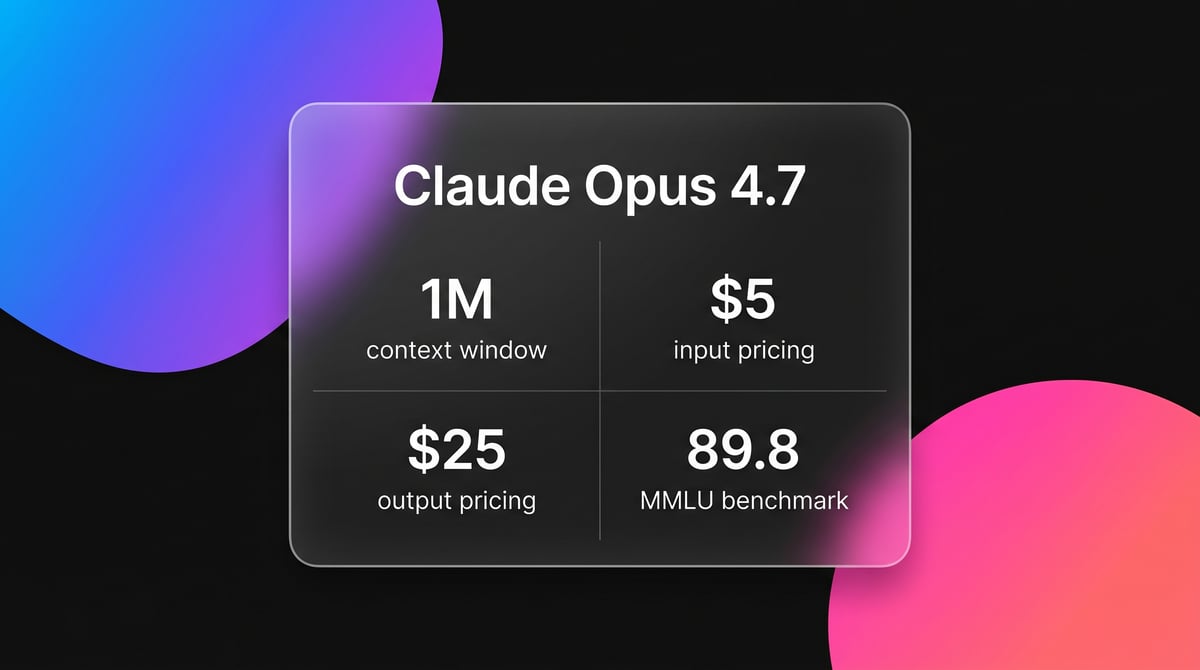

Claude Opus 4.7 er flagskibsmodellen i Claude 4-arkitekturserien. Den benytter et Adaptive Thinking-rammeværk, der gør det muligt for modellen at skalere sin kognitive indsats baseret på den opfattede sværhedsgrad af en opgave. Dette erstatter faste reasoning-budgetter med dynamiske logikniveauer. Udviklere kan nu kontrollere den interne resonnementsdybde via en API-parameter, hvilket giver en bedre balance mellem latency og logisk stringens. Modellen er specifikt tunet til virksomhedsworkflows med høj indsats og autonome agentic loops.

Kontekst og multimodale funktioner

Denne model tilbyder et 1-million-token context window uden ekstra gebyrer for lang kontekst. Den inkluderer en output-grænse på 128.000 tokens, hvilket muliggør generering af massive tekniske dokumenter eller komplette kodelagre i ét svar. Vision-opløsningen er 3,3x højere end tidligere iterationer. Dette giver mulighed for pixel-præcis UI-forståelse og 1:1 koordinat-mapping i billeder op til 2576 pixels. Disse forbedringer gør den til et pålideligt valg til dokumentanalyse og visuel revision.

Agentic Engineering og sikkerhed

Arkitektoniske opdateringer er rettet mod opgaver med lang tidshorisont og softwareudvikling. Den scorer 87,6% på SWE-bench Verified-ranglisten og fører i øjeblikket inden for evnen til at løse reelle GitHub-issues. Modellen introducerer opgavebudgetter for at hjælpe med at styre token-forbrug på tværs af agent-sessioner med mange interaktioner. Anthropic har integreret cybersikkerhedsbeskyttelse i realtid i kernearkitekturen for at forhindre modellen i at deltage i ondsindede angreb, samtidig med at dens nytteværdi for sikkerhedsforskere bevares.

Anvendelser for Claude Opus 4.7

Opdag de forskellige måder, du kan bruge Claude Opus 4.7 til at opnå gode resultater.

Agentic softwareudvikling

Udnyttelse af høje indsatsniveauer til autonomt at refaktorere repositories og løse komplekse afhængigheder på tværs af filer.

Syntese af store repositories

Behandling af 1 million tokens kildekode for at kortlægge arkitektoniske flows og generere teknisk dokumentation.

Visuel analyse i høj opløsning

Analyse af tætte grafer og UI-skærmbilleder med 3,3x flere detaljer end tidligere frontier models.

Forskning i cybersikkerhedssårbarheder

Udførelse af dybdegående sikkerhedsrevisioner og zero-day-analyse inden for verificerede sikkerhedsrammer.

Ekstraktion af viden i virksomheder

Ekstraktion af struktureret data fra omfattende tekniske biblioteker og udførelse af kompleks sammenligning på tværs af dokumenter.

Interaktiv 3D-prototyping

Generering af funktionelle 3D-miljøer og spillogik baseret på beskrivelser i naturligt sprog.

Styrker

Begrænsninger

API hurtig start

anthropic/claude-opus-4-7

import Anthropic from '@anthropic-ai/sdk';

const anthropic = new Anthropic({

apiKey: process.env.ANTHROPIC_API_KEY,

});

const msg = await anthropic.messages.create({

model: "claude-opus-4-7",

max_tokens: 4096,

thinking: { type: "adaptive" },

messages: [{ role: "user", content: "Analyze this architecture for concurrency bugs." }],

});

console.log(msg.content[0].text);Installér SDK'et og begynd at foretage API-kald på få minutter.

Hvad folk siger om Claude Opus 4.7

Se hvad fællesskabet mener om Claude Opus 4.7

“Claude Opus 4.7 fører på SWE-bench og agentic reasoning og slår GPT-5.4 og Gemini 3.1 Pro.”

“At den kan generere et procedurelt 3D-skatespil i ét hug er et bevis på modellens logiske tæthed.”

“Opus 4.7 er lige landet. Cursorbench sprang fra 58% til 70%. XBOW visuel skarphed 98,5% vs 54,5% på Opus 4.6.”

“Claude har en tendens til at over-engineere: Du beder om en simpel funktion og får en arkitektur designet til at skalere det næste årti.”

“Den tidlige feedback på Claude Opus 4.7 peger på højere token-forbrug og strengere krav til prompts.”

“X-High reasoning-indsatsen er den manglende mellemvej, vi havde brug for til komplekse agentic workflows.”

Videoer om Claude Opus 4.7

Se vejledninger, anmeldelser og diskussioner om Claude Opus 4.7

“Claude har været og er stadig den bedste model til citater på markedet i dag.”

“Den koster faktisk det samme som før, men du har fået mere kontrol over dens reasoning.”

“Det virker helt perfekt. Den valgte de værktøjer, jeg selv ville have valgt.”

“Modellen føles mærkbart hurtigere, når du ikke bruger de højeste tænkeniveauer.”

“Du kan se den overveje kanttilfælde, før den overhovedet skriver en linje kode.”

“Denne model er langt dyrere at køre... du kommer til at betale 35% mere for Opus 4.7.”

“Vision-opgraderingen alene er det værd... den kan håndtere billeder med tre gange så høj opløsning uden beskæring.”

“Hvis du bruger API'et, skal du regne med at betale 35% mere end før.”

“Tokenization-ændringen er den skjulte dræber for din API-regning, hvis du ikke passer på.”

“Den håndterer dyb kontekst meget bedre end den tidligere version af Opus 4.”

“Modellens vision-kapaciteter er væsentligt bedre.”

“X-High reasoning-indsatsen er den manglende mellemvej, vi havde brug for til komplekse agentic workflows.”

“Dette berettiger absolut 100% en vild titel. Det her blæste mig seriøst bagover.”

“Den identificerede korrekt en fejl i min gamle kodebase, som tre andre modeller overså.”

“Autonominiveauet i agent-loops er det, der adskiller denne fra GPT-5.”

Supercharg din arbejdsgang med AI-automatisering

Automatio kombinerer kraften fra AI-agenter, webautomatisering og smarte integrationer for at hjælpe dig med at udrette mere på kortere tid.

Pro-tips til Claude Opus 4.7

Eksperttips til at hjælpe dig med at få mest muligt ud af Claude Opus 4.7 og opnå bedre resultater.

Aktivér Adaptive Thinking

Aktivér eksplicit adaptive thinking-tilstand i API-kald for at sikre, at Claude vælger den optimale dybde for reasoning.

Brug X-High til agenter

Sæt effort-parameteren til xhigh i agentic loops for at maksimere selvkontrol og logisk præcision.

Fjern scaffolding

Fjern ældre prompte-instrukser som "tjek dit arbejde en ekstra gang", da modellen er optimeret til intern selvkontrol.

Overvåg token-forbrug

Brug den nye token-sporing til at administrere den 35% stigning i token-antal for identiske tekst-inputs.

Anmeldelser

Hvad vores brugere siger

Slut dig til tusindvis af tilfredse brugere, der har transformeret deres arbejdsgang

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Relateret AI Models

Gemini 3.1 Pro

Gemini 3.1 Pro is Google's elite multimodal model featuring the DeepThink reasoning engine, a 1M+ context window, and industry-leading ARC-AGI logic scores.

Gemini 3.1 Flash Live Preview

Gemini 3.1 Flash Live Preview is Google's ultra-low-latency, audio-to-audio model featuring a 131K context window, high-fidelity multimodal reasoning, and...

GPT-5.5

OpenAI

GPT-5.5 is OpenAI's flagship frontier model with a 1M context window and five reasoning effort levels, optimized for autonomous agentic workflows and coding.

Grok-3

xAI

Grok-3 is xAI's flagship reasoning model, featuring deep logic deduction, a 128k context window, and real-time integration with X for live research and coding.

GPT-5.2 Pro

OpenAI

GPT-5.2 Pro is OpenAI's 2025 flagship reasoning model featuring Extended Thinking for SOTA performance in mathematics, coding, and expert knowledge work.

Qwen 3.7 Max

alibaba

Qwen 3.7 Max is Alibaba’s flagship AI model for deep reasoning and autonomous agent tasks, featuring a 256k context window and top-tier coding performance.

Gemini 3 Pro

Google's Gemini 3 Pro is a multimodal powerhouse featuring a 1M token context window, native video processing, and industry-leading reasoning performance.

Claude Opus 4.6

Anthropic

Claude Opus 4.6 is Anthropic's flagship model featuring a 1M token context window, Adaptive Thinking, and world-class coding and reasoning performance.

Ofte stillede spørgsmål om Claude Opus 4.7

Find svar på almindelige spørgsmål om Claude Opus 4.7