Claude Opus 4.7

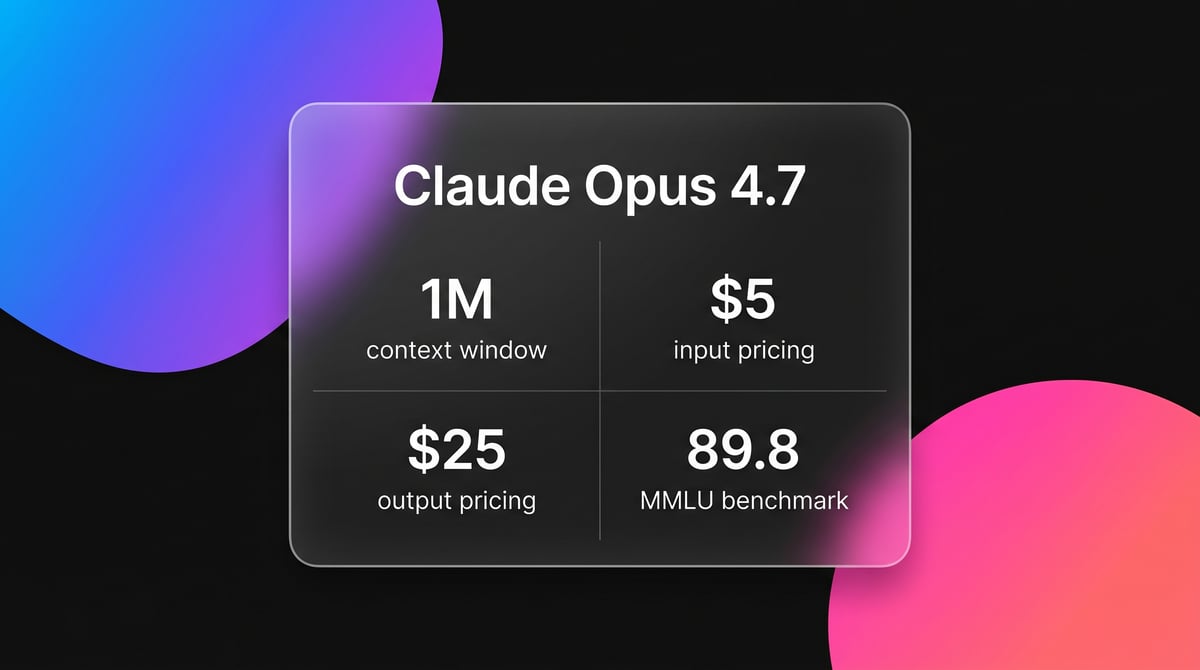

Claude Opus 4.7 est le model phare d'Anthropic avec un contexte de 1 million de tokens, un raisonnement adaptatif et une résolution de vision 3,3x supérieure...

À propos de Claude Opus 4.7

Découvrez les capacités, fonctionnalités et façons d'utiliser Claude Opus 4.7.

Aperçu du model

Claude Opus 4.7 est le model phare de la série d'architectures Claude 4. Il utilise un framework d'Adaptive Thinking qui permet au model d'ajuster son effort cognitif en fonction de la difficulté perçue d'une tâche. Cela remplace les budgets de raisonnement fixes par des niveaux logiques dynamiques. Les développeurs peuvent désormais contrôler la profondeur de raisonnement interne via un paramètre d'effort API, permettant un meilleur équilibre entre latence et rigueur logique. Le model est spécifiquement optimisé pour les flux de travail d'entreprise à fort enjeu et les boucles agentic autonomes.

Contexte et capacités multimodales

Ce model offre une context window de 1 million de tokens sans frais additionnels pour les longs contextes. Il inclut une limite de sortie de 128 000 tokens, permettant la génération de documents techniques massifs ou de dépôts de code complets en une seule réponse. La résolution de vision est 3,3x plus élevée que lors des itérations précédentes. Cela permet une compréhension de l'UI au pixel près et un mappage de coordonnées 1:1 dans des images allant jusqu'à 2576 pixels. Ces améliorations en font un choix fiable pour l'analyse de documents et les tâches d'audit visuel.

Ingénierie agentic et sécurité

Les mises à jour architecturales ciblent les tâches à long terme et l'ingénierie logicielle. Il obtient un score de 87,6 % sur le classement SWE-bench Verified, menant actuellement dans sa capacité à résoudre de véritables problèmes GitHub. Le model introduit des budgets de tâches pour aider à gérer la consommation de tokens lors de sessions agentic multi-tours. Anthropic a intégré des garde-fous de cybersécurité en temps réel dans l'architecture centrale pour empêcher le model de participer à des exploits malveillants, tout en conservant son utilité pour les chercheurs en sécurité.

Cas d'utilisation de Claude Opus 4.7

Découvrez les différentes façons d'utiliser Claude Opus 4.7 pour obtenir d'excellents résultats.

Ingénierie logicielle agentic

Utilisation de niveaux d'effort élevés pour refactoriser de manière autonome des dépôts et résoudre des dépendances complexes entre fichiers.

Synthèse de dépôts à grande échelle

Traitement de 1 million de tokens de code source pour cartographier les flux architecturaux et générer une documentation technique.

Analyse visuelle haute résolution

Analyse de graphiques denses et de captures d'écran d'UI au niveau du pixel avec 3,3x plus de détails que les modèles frontier précédents.

Recherche de vulnérabilités en cybersécurité

Réalisation d'audits de sécurité approfondis et analyse de type zero-day dans des limites de sécurité vérifiées.

Extraction de connaissances en entreprise

Extraction de données structurées à partir de bibliothèques techniques massives et réalisation de relectures complexes entre documents.

Prototypage 3D interactif

Génération d'environnements 3D fonctionnels et de logique de jeu à partir de descriptions en langage naturel.

Points forts

Limitations

Démarrage rapide API

anthropic/claude-opus-4-7

import Anthropic from '@anthropic-ai/sdk';

const anthropic = new Anthropic({

apiKey: process.env.ANTHROPIC_API_KEY,

});

const msg = await anthropic.messages.create({

model: "claude-opus-4-7",

max_tokens: 4096,

thinking: { type: "adaptive" },

messages: [{ role: "user", content: "Analyze this architecture for concurrency bugs." }],

});

console.log(msg.content[0].text);Installez le SDK et commencez à faire des appels API en quelques minutes.

Ce que les gens disent de Claude Opus 4.7

Voyez ce que la communauté pense de Claude Opus 4.7

“Claude Opus 4.7 est en tête sur SWE-bench et le raisonnement agentic, battant GPT-5.4 et Gemini 3.1 Pro.”

“Le fait qu'il puisse générer un jeu de skate 3D procédural d'une seule traite est une preuve de la densité logique du model.”

“Opus 4.7 vient de sortir. cursorbench est passé de 58 % à 70 %. Acuité visuelle XBOW 98,5 % contre 54,5 % sur Opus 4.6.”

“Claude a tendance à faire de l'over-engineering : vous demandez une fonction simple et vous obtenez une architecture conçue pour évoluer pendant la prochaine décennie.”

“Les premiers retours sur Claude Opus 4.7 pointent vers une consommation de tokens plus élevée et des exigences de prompt plus strictes.”

“L'effort de réflexion X-High est le juste milieu qui nous manquait pour les flux de travail agentic complexes.”

Vidéos sur Claude Opus 4.7

Regardez des tutoriels, critiques et discussions sur Claude Opus 4.7

“Claude a été et reste le meilleur model pour citer des sources aujourd'hui.”

“Le prix est identique à celui d'avant, mais ils vous donnent plus de contrôle sur son raisonnement.”

“Cela fonctionne parfaitement. Il a choisi les outils que j'aurais choisis moi-même.”

“Le model semble sensiblement plus rapide lorsque vous n'utilisez pas les niveaux de réflexion les plus élevés.”

“On peut le voir réfléchir aux cas limites avant même d'écrire une seule ligne de code.”

“Ce model est bien plus coûteux à faire tourner... vous allez payer 35 % de plus pour Opus 4.7.”

“La mise à jour de la vision vaut le coup à elle seule... il peut accepter des images trois fois plus grandes sans recadrage.”

“Si vous utilisez l'API, attendez-vous à payer 35 % de plus qu'avant.”

“Le changement de tokenisation est le tueur silencieux de vos factures API si vous ne faites pas attention.”

“Il gère le contexte profond bien mieux que la version précédente d'Opus 4.”

“Les capacités de vision de ce model sont substantiellement meilleures.”

“L'effort de réflexion X-High est le juste milieu qui nous manquait pour les flux de travail agentic complexes.”

“Cela justifie absolument à 100 % un titre fou. Cela m'a sérieusement époustouflé.”

“Il a correctement identifié un bug dans mon codebase hérité que trois autres modèles avaient manqué.”

“Le niveau d'autonomie dans les boucles agentic est ce qui différencie ce model de GPT-5.”

Optimisez votre flux de travail avec l'Automatisation IA

Automatio combine la puissance des agents IA, de l'automatisation web et des integrations intelligentes pour vous aider a accomplir plus en moins de temps.

Conseils Pro pour Claude Opus 4.7

Conseils d'experts pour tirer le meilleur parti de Claude Opus 4.7.

Activer l'Adaptive Thinking

Activez explicitement le mode de réflexion adaptative dans les appels API pour garantir que Claude sélectionne la profondeur de reasoning optimale.

Utiliser X-High pour les agents

Réglez le paramètre d'effort sur xhigh pour les boucles agentic afin de maximiser l'auto-vérification et la précision logique.

Supprimer les échafaudages (scaffolding)

Supprimez les prompts hérités tels que « vérifie deux fois ton travail », car le model est optimisé pour l'auto-correction interne.

Surveiller la consommation de tokens

Utilisez le nouveau suivi du tokenizer pour gérer l'augmentation de 35 % du nombre de tokens pour des saisies de texte identiques.

Témoignages

Ce Que Disent Nos Utilisateurs

Rejoignez des milliers d'utilisateurs satisfaits qui ont transforme leur flux de travail

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Associés AI Models

Gemini 3.1 Pro

Gemini 3.1 Pro is Google's elite multimodal model featuring the DeepThink reasoning engine, a 1M+ context window, and industry-leading ARC-AGI logic scores.

Gemini 3.1 Flash Live Preview

Gemini 3.1 Flash Live Preview is Google's ultra-low-latency, audio-to-audio model featuring a 131K context window, high-fidelity multimodal reasoning, and...

GPT-5.5

OpenAI

GPT-5.5 is OpenAI's flagship frontier model with a 1M context window and five reasoning effort levels, optimized for autonomous agentic workflows and coding.

Grok-3

xAI

Grok-3 is xAI's flagship reasoning model, featuring deep logic deduction, a 128k context window, and real-time integration with X for live research and coding.

GPT-5.2 Pro

OpenAI

GPT-5.2 Pro is OpenAI's 2025 flagship reasoning model featuring Extended Thinking for SOTA performance in mathematics, coding, and expert knowledge work.

Qwen 3.7 Max

alibaba

Qwen 3.7 Max is Alibaba’s flagship AI model for deep reasoning and autonomous agent tasks, featuring a 256k context window and top-tier coding performance.

Gemini 3 Pro

Google's Gemini 3 Pro is a multimodal powerhouse featuring a 1M token context window, native video processing, and industry-leading reasoning performance.

Claude Opus 4.6

Anthropic

Claude Opus 4.6 is Anthropic's flagship model featuring a 1M token context window, Adaptive Thinking, and world-class coding and reasoning performance.

Questions Fréquentes sur Claude Opus 4.7

Trouvez des réponses aux questions courantes sur Claude Opus 4.7