Claude Opus 4.7

Claude Opus 4.7 es el modelo insignia de Anthropic con 1 millón de tokens de contexto, reasoning adaptativo y resolución de visión 3,3x para agentes a escala...

Acerca de Claude Opus 4.7

Conoce las capacidades, características y formas de uso de Claude Opus 4.7.

Descripción general del modelo

Claude Opus 4.7 es el modelo flagship de la serie de arquitectura Claude 4. Utiliza un marco de Adaptive Thinking que permite al modelo escalar su esfuerzo cognitivo según la dificultad percibida de una tarea. Esto reemplaza los presupuestos de reasoning fijos por niveles de lógica dinámicos. Los desarrolladores ahora pueden controlar la profundidad de reasoning interna a través de un parámetro de esfuerzo de la API, permitiendo un mejor equilibrio entre latencia y rigor lógico. El modelo está ajustado específicamente para flujos de trabajo empresariales de alto nivel y bucles agentic autónomos.

Capacidades de contexto y multimodales

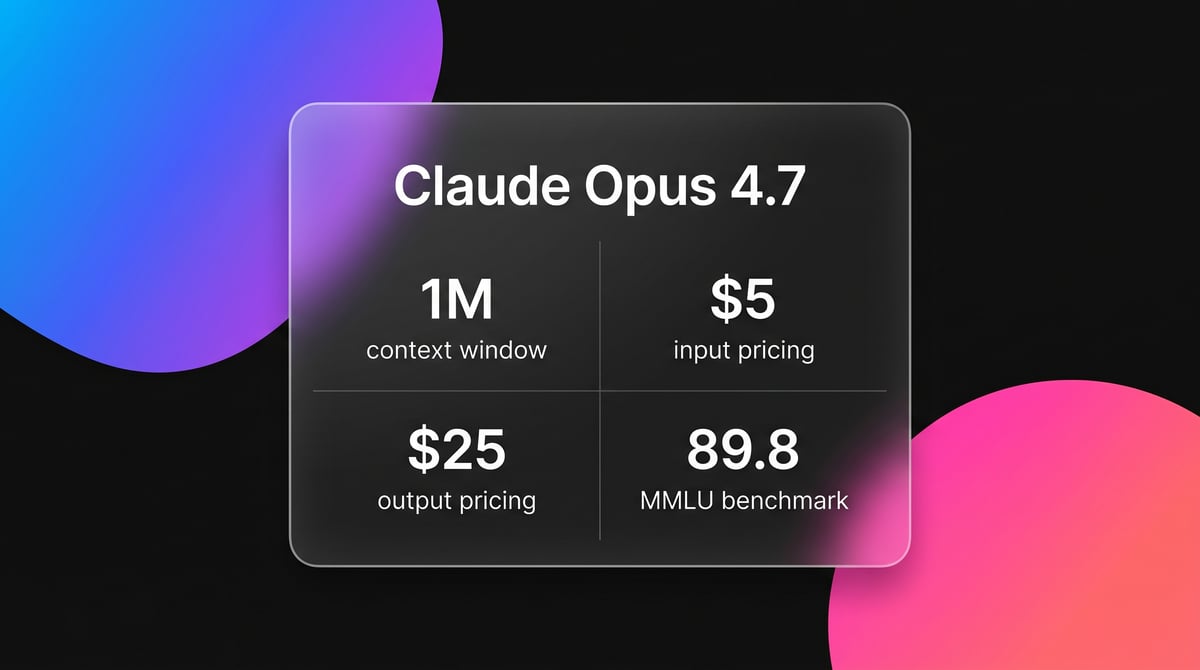

Este modelo proporciona una context window de 1 millón de tokens sin sobrecoste por contexto largo. Incluye un límite de salida de 128 000 tokens, lo que permite la generación de documentos técnicos masivos o repositorios de código completos en una sola respuesta. La resolución de visión es 3,3 veces mayor que en iteraciones anteriores. Esto permite una comprensión de UI perfecta a nivel de píxel y un mapeo de coordenadas 1:1 en imágenes de hasta 2576 píxeles. Estas mejoras lo convierten en una opción fiable para el análisis de documentos y tareas de auditoría visual.

Ingeniería Agentic y Seguridad

Las actualizaciones arquitectónicas se centran en tareas de largo alcance e ingeniería de software. Obtiene un 87,6 % en la tabla de clasificación SWE-bench Verified, liderando actualmente su capacidad para resolver problemas reales de GitHub. El modelo introduce presupuestos de tareas para ayudar a gestionar el consumo de tokens en sesiones de agentes de múltiples turnos. Anthropic ha integrado salvaguardas de ciberseguridad en tiempo real en la arquitectura central para evitar que el modelo participe en exploits maliciosos, manteniendo al mismo tiempo su utilidad para los investigadores de seguridad.

Casos de uso de Claude Opus 4.7

Descubre las diferentes formas de usar Claude Opus 4.7 para lograr excelentes resultados.

Agentic Software Engineering

Utilización de niveles de esfuerzo alto para refactorizar repositorios de forma autónoma y resolver dependencias complejas entre archivos.

Síntesis de repositorios a gran escala

Procesamiento de 1 millón de tokens de código fuente para mapear flujos arquitectónicos y generar documentación técnica.

Análisis de visión de alta resolución

Análisis de gráficos densos y capturas de pantalla de UI a nivel de píxel con 3,3 veces más detalle que anteriores frontier models.

Investigación de vulnerabilidades de ciberseguridad

Realización de auditorías de seguridad profundas y análisis de zero-day dentro de límites de seguridad verificados.

Extracción de conocimiento empresarial

Extracción de datos estructurados de bibliotecas técnicas masivas y realización de revisiones complejas entre documentos.

Prototipado 3D interactivo

Generación de entornos 3D funcionales y lógica de juegos a partir de descripciones en lenguaje natural.

Fortalezas

Limitaciones

Inicio rápido de API

anthropic/claude-opus-4-7

import Anthropic from '@anthropic-ai/sdk';

const anthropic = new Anthropic({

apiKey: process.env.ANTHROPIC_API_KEY,

});

const msg = await anthropic.messages.create({

model: "claude-opus-4-7",

max_tokens: 4096,

thinking: { type: "adaptive" },

messages: [{ role: "user", content: "Analiza esta arquitectura en busca de errores de concurrencia." }],

});

console.log(msg.content[0].text);Instala el SDK y comienza a hacer llamadas API en minutos.

Lo que la gente dice sobre Claude Opus 4.7

Mira lo que la comunidad piensa sobre Claude Opus 4.7

“Claude Opus 4.7 lidera en SWE-bench y reasoning agentic, superando a GPT-5.4 y Gemini 3.1 Pro.”

“El hecho de que pueda generar un juego de skate 3D procedimental de una sola vez es prueba de la densidad lógica del modelo.”

“Opus 4.7 acaba de salir. cursorbench saltó del 58 % al 70 %. Agudeza visual XBOW 98,5 % frente al 54,5 % en Opus 4.6.”

“Claude tiende a sobre-diseñar: pides una función simple y obtienes una arquitectura diseñada para escalar durante la próxima década.”

“Los primeros comentarios sobre Claude Opus 4.7 apuntan a un mayor uso de tokens y requisitos de prompting más estrictos.”

“El esfuerzo de reasoning X-High es el punto medio que necesitábamos para flujos de trabajo agentic complejos.”

Videos sobre Claude Opus 4.7

Mira tutoriales, reseñas y discusiones sobre Claude Opus 4.7

“Claude ha sido y sigue siendo el mejor modelo de cita disponible hoy.”

“De hecho, tiene el mismo precio que antes, pero te dieron más control sobre su reasoning.”

“Esto funciona perfectamente. Eligió las herramientas que yo mismo habría elegido.”

“El modelo se siente notablemente más rápido cuando no usas los niveles de thinking más altos.”

“Puedes verlo pensando en los casos extremos antes incluso de escribir una sola línea de código.”

“Este modelo es mucho más caro de ejecutar... pagarás un 35 % más por Opus 4.7.”

“La mejora en visión por sí sola merece la pena... puede tomar imágenes con tres veces la resolución sin recortar.”

“Si usas la API, espera pagar un 35 % más que antes.”

“El cambio de tokenización es un asesino silencioso para tus facturas de API si no tienes cuidado.”

“Maneja el contexto profundo mucho mejor que la versión anterior de Opus 4.”

“Las capacidades de visión de este modelo son sustancialmente mejores.”

“El esfuerzo de reasoning X-High es el punto medio que necesitábamos para flujos de trabajo agentic complejos.”

“Esto justifica al 100 % un título de locura. Me dejó realmente impresionado.”

“Identificó correctamente un error en mi base de código heredada que otros tres modelos pasaron por alto.”

“El nivel de autonomía en los bucles agentic es lo que diferencia a esto de GPT-5.”

Potencia tu flujo de trabajo con Automatizacion IA

Automatio combina el poder de agentes de IA, automatizacion web e integraciones inteligentes para ayudarte a lograr mas en menos tiempo.

Consejos Pro para Claude Opus 4.7

Consejos de expertos para ayudarte a sacar el máximo provecho de Claude Opus 4.7.

Activar Adaptive Thinking

Habilite explícitamente el modo de adaptive thinking en las llamadas a la API para asegurar que Claude seleccione la profundidad de reasoning óptima.

Usar X-High para Agents

Establezca el parámetro de esfuerzo (effort) en xhigh para los bucles agentic con el fin de maximizar la autoverificación y la precisión lógica.

Eliminar Scaffolding

Elimine prompts heredados como "revisa tu trabajo dos veces", ya que el modelo está optimizado para la autocorrección interna.

Monitorear el consumo de tokens

Utilice el nuevo seguimiento de tokenización para gestionar el aumento del 35 % en el conteo de tokens para entradas de texto idénticas.

Testimonios

Lo Que Dicen Nuestros Usuarios

Unete a miles de usuarios satisfechos que han transformado su flujo de trabajo

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Relacionados AI Models

Gemini 3.1 Pro

Gemini 3.1 Pro is Google's elite multimodal model featuring the DeepThink reasoning engine, a 1M+ context window, and industry-leading ARC-AGI logic scores.

Gemini 3.1 Flash Live Preview

Gemini 3.1 Flash Live Preview is Google's ultra-low-latency, audio-to-audio model featuring a 131K context window, high-fidelity multimodal reasoning, and...

GPT-5.5

OpenAI

GPT-5.5 is OpenAI's flagship frontier model with a 1M context window and five reasoning effort levels, optimized for autonomous agentic workflows and coding.

Grok-3

xAI

Grok-3 is xAI's flagship reasoning model, featuring deep logic deduction, a 128k context window, and real-time integration with X for live research and coding.

GPT-5.2 Pro

OpenAI

GPT-5.2 Pro is OpenAI's 2025 flagship reasoning model featuring Extended Thinking for SOTA performance in mathematics, coding, and expert knowledge work.

Qwen 3.7 Max

alibaba

Qwen 3.7 Max is Alibaba’s flagship AI model for deep reasoning and autonomous agent tasks, featuring a 256k context window and top-tier coding performance.

Gemini 3 Pro

Google's Gemini 3 Pro is a multimodal powerhouse featuring a 1M token context window, native video processing, and industry-leading reasoning performance.

Claude Opus 4.6

Anthropic

Claude Opus 4.6 is Anthropic's flagship model featuring a 1M token context window, Adaptive Thinking, and world-class coding and reasoning performance.

Preguntas Frecuentes Sobre Claude Opus 4.7

Encuentra respuestas a preguntas comunes sobre Claude Opus 4.7