Comment scraper Cheapflights | Scraper de données de vols

Découvrez comment scraper les prix des vols, les itinéraires et les données des compagnies aériennes de Cheapflights en temps réel. Guide expert pour...

Protection Anti-Bot Détectée

- Cloudflare

- WAF et gestion de bots de niveau entreprise. Utilise des défis JavaScript, des CAPTCHAs et l'analyse comportementale. Nécessite l'automatisation du navigateur avec des paramètres furtifs.

- DataDome

- Détection de bots en temps réel avec des modèles ML. Analyse l'empreinte d'appareil, les signaux réseau et les schémas comportementaux. Courant sur les sites e-commerce.

- Akamai Bot Manager

- Détection avancée des bots par empreinte d'appareil, analyse comportementale et apprentissage automatique. L'un des systèmes anti-bot les plus sophistiqués.

- Empreinte navigateur

- Identifie les bots par les caractéristiques du navigateur : canvas, WebGL, polices, plugins. Nécessite du spoofing ou de vrais profils de navigateur.

- Residential Proxy Detection

À Propos de Cheapflights

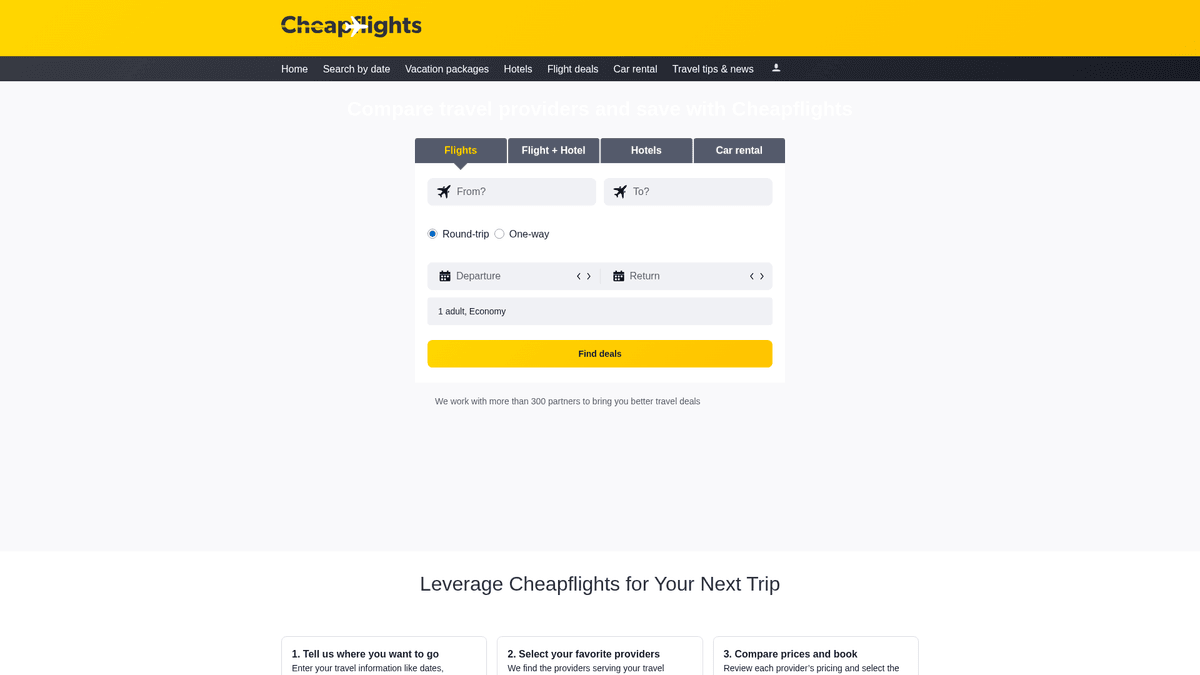

Découvrez ce que Cheapflights offre et quelles données précieuses peuvent être extraites.

Cheapflights est un moteur de métarecherche de voyage de premier plan appartenant à Booking Holdings et exploité comme marque sœur de Kayak. Il fonctionne comme un agrégateur massif, scannant des centaines de compagnies aériennes, d'agences de voyages et de plateformes de réservation pour trouver les meilleurs tarifs aériens, hôtels et offres de location de voitures. Contrairement à un site de réservation directe, Cheapflights se concentre sur la comparaison de prix, redirigeant souvent les utilisateurs vers les sites des fournisseurs pour finaliser leurs transactions.

Les données de Cheapflights sont extrêmement précieuses car elles représentent le pouls de la tarification mondiale des voyages. Pour les entreprises, ces données permettent un benchmarking concurrentiel, la création d'applications d'alerte de prix et une étude de marché approfondie sur les tendances de l'aviation. Comme les prix des voyages fluctuent à chaque minute, le site utilise une protection agressive pour empêcher le scraping automatisé de dégrader les performances ou de créer des déséquilibres.

En extrayant ces informations à grande échelle, les développeurs peuvent créer des outils qui prédisent les baisses de prix ou trouvent des offres de vols cachées sur des milliers d'itinéraires. Cependant, scraper avec succès la plateforme nécessite une approche robuste pour gérer le contenu dynamique et les systèmes sophistiqués de détection de bots.

Pourquoi Scraper Cheapflights?

Découvrez la valeur commerciale et les cas d'utilisation pour l'extraction de données de Cheapflights.

Veille tarifaire en temps réel

Surveillez les fluctuations de prix des vols sur des centaines de compagnies aériennes pour identifier les meilleures périodes de réservation et anticiper les évolutions du marché.

Comparaison des tarifs concurrents

Aidez les agences de voyage et les compagnies aériennes à comparer leurs tarifs par rapport aux leaders du secteur en agrégeant des données provenant de divers partenaires de voyage.

Génération de flux pour agrégateurs

Alimentez des applications de voyage de niche, des services de notification de baisse de prix et des sites web spécialisés avec un flux constant de données tarifaires fraîches.

Prévision des tendances historiques

Constituez une base de données complète des coûts de voyage saisonniers pour prédire les futures hausses de prix et identifier les tendances économiques à long terme dans l'aviation.

Analyse de la fréquence des itinéraires

Suivez la fréquence des vols et les schémas d'escale entre des paires de villes spécifiques pour évaluer la demande du marché et la dominance des transporteurs.

Défis du Scraping

Défis techniques que vous pouvez rencontrer lors du scraping de Cheapflights.

Protection anti-bot sophistiquée

Le site utilise Akamai et DataDome pour détecter le trafic automatisé via une analyse comportementale avancée et le fingerprinting de navigateur.

Empreinte numérique TLS et JA3

Les systèmes de sécurité vérifient le handshake TLS de bas niveau de la connexion, bloquant les bibliothèques de scraping standard qui n'imitent pas les signatures de navigateurs réels.

Contenu AJAX dynamique

Les résultats de recherche sont chargés de manière asynchrone via JavaScript, ce qui signifie que les parseurs HTML statiques ne verront aucune liste de vols sans moteur de rendu.

Géo-blocage d'IP localisées

Les prix et la disponibilité varient considérablement selon la localisation géographique de l'utilisateur, ce qui nécessite l'utilisation de proxies résidentiels de haute qualité.

Scrapez Cheapflights avec l'IA

Aucun code requis. Extrayez des données en minutes avec l'automatisation par IA.

Comment ça marche

Décrivez ce dont vous avez besoin

Dites à l'IA quelles données vous souhaitez extraire de Cheapflights. Tapez simplement en langage naturel — pas de code ni de sélecteurs.

L'IA extrait les données

Notre intelligence artificielle navigue sur Cheapflights, gère le contenu dynamique et extrait exactement ce que vous avez demandé.

Obtenez vos données

Recevez des données propres et structurées, prêtes à exporter en CSV, JSON ou à envoyer directement à vos applications.

Pourquoi utiliser l'IA pour le scraping

L'IA facilite le scraping de Cheapflights sans écrire de code. Notre plateforme alimentée par l'intelligence artificielle comprend quelles données vous voulez — décrivez-les en langage naturel et l'IA les extrait automatiquement.

How to scrape with AI:

- Décrivez ce dont vous avez besoin: Dites à l'IA quelles données vous souhaitez extraire de Cheapflights. Tapez simplement en langage naturel — pas de code ni de sélecteurs.

- L'IA extrait les données: Notre intelligence artificielle navigue sur Cheapflights, gère le contenu dynamique et extrait exactement ce que vous avez demandé.

- Obtenez vos données: Recevez des données propres et structurées, prêtes à exporter en CSV, JSON ou à envoyer directement à vos applications.

Why use AI for scraping:

- Masquage TLS automatisé: Contourne la détection de bas niveau en configurant automatiquement les signatures JA3 pour correspondre aux profils de navigateurs web modernes et légitimes.

- Moteur d'extraction visuel: Gère nativement toute l'exécution du JavaScript et le chargement du contenu dynamique, garantissant que les cartes de résultats de vol complexes sont entièrement générées avant la capture des données.

- Intégration transparente de proxies: Effectue facilement des rotations dans des pools d'IP résidentielles pour surmonter les variations de prix régionales et éviter les bannissements d'IP fréquents avec le trafic de data centers.

- Workflows de surveillance programmés: Configurez des instances de scraping récurrentes pour suivre des itinéraires spécifiques quotidiennement ou toutes les heures sans intervention manuelle, en injectant les données directement dans votre base de données.

Scrapers Web No-Code pour Cheapflights

Alternatives pointer-cliquer au scraping alimenté par l'IA

Plusieurs outils no-code comme Browse.ai, Octoparse, Axiom et ParseHub peuvent vous aider à scraper Cheapflights sans écrire de code. Ces outils utilisent généralement des interfaces visuelles pour sélectionner les données, bien qu'ils puissent avoir des difficultés avec le contenu dynamique complexe ou les mesures anti-bot.

Workflow Typique avec les Outils No-Code

Défis Courants

Courbe d'apprentissage

Comprendre les sélecteurs et la logique d'extraction prend du temps

Les sélecteurs cassent

Les modifications du site web peuvent casser tout le workflow

Problèmes de contenu dynamique

Les sites riches en JavaScript nécessitent des solutions complexes

Limitations des CAPTCHAs

La plupart des outils nécessitent une intervention manuelle pour les CAPTCHAs

Blocage d'IP

Le scraping agressif peut entraîner le blocage de votre IP

Scrapers Web No-Code pour Cheapflights

Plusieurs outils no-code comme Browse.ai, Octoparse, Axiom et ParseHub peuvent vous aider à scraper Cheapflights sans écrire de code. Ces outils utilisent généralement des interfaces visuelles pour sélectionner les données, bien qu'ils puissent avoir des difficultés avec le contenu dynamique complexe ou les mesures anti-bot.

Workflow Typique avec les Outils No-Code

- Installer l'extension de navigateur ou s'inscrire sur la plateforme

- Naviguer vers le site web cible et ouvrir l'outil

- Sélectionner en point-and-click les éléments de données à extraire

- Configurer les sélecteurs CSS pour chaque champ de données

- Configurer les règles de pagination pour scraper plusieurs pages

- Gérer les CAPTCHAs (nécessite souvent une résolution manuelle)

- Configurer la planification pour les exécutions automatiques

- Exporter les données en CSV, JSON ou se connecter via API

Défis Courants

- Courbe d'apprentissage: Comprendre les sélecteurs et la logique d'extraction prend du temps

- Les sélecteurs cassent: Les modifications du site web peuvent casser tout le workflow

- Problèmes de contenu dynamique: Les sites riches en JavaScript nécessitent des solutions complexes

- Limitations des CAPTCHAs: La plupart des outils nécessitent une intervention manuelle pour les CAPTCHAs

- Blocage d'IP: Le scraping agressif peut entraîner le blocage de votre IP

Exemples de Code

import requests

from bs4 import BeautifulSoup

# Note : Cheapflights utilise Cloudflare ; requests peut nécessiter des en-têtes spécialisés ou une session.

url = 'https://www.cheapflights.com/flights-to-london/new-york/'

headers = {

'User-Agent': 'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/119.0.0.0 Safari/537.36',

'Accept-Language': 'fr-FR,fr;q=0.9'

}

try:

response = requests.get(url, headers=headers)

if response.status_code == 200:

soup = BeautifulSoup(response.text, 'html.parser')

title = soup.find('title').text

print(f'Titre de la page : {title}')

else:

print(f'Échec de la récupération des données. Code statut : {response.status_code}')

except Exception as e:

print(f'Une erreur est survenue : {e}')Quand Utiliser

Idéal pour les pages HTML statiques avec peu de JavaScript. Parfait pour les blogs, sites d'actualités et pages e-commerce simples.

Avantages

- ●Exécution la plus rapide (sans surcharge navigateur)

- ●Consommation de ressources minimale

- ●Facile à paralléliser avec asyncio

- ●Excellent pour les APIs et pages statiques

Limitations

- ●Ne peut pas exécuter JavaScript

- ●Échoue sur les SPAs et contenu dynamique

- ●Peut avoir des difficultés avec les systèmes anti-bot complexes

Comment Scraper Cheapflights avec du Code

Python + Requests

import requests

from bs4 import BeautifulSoup

# Note : Cheapflights utilise Cloudflare ; requests peut nécessiter des en-têtes spécialisés ou une session.

url = 'https://www.cheapflights.com/flights-to-london/new-york/'

headers = {

'User-Agent': 'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/119.0.0.0 Safari/537.36',

'Accept-Language': 'fr-FR,fr;q=0.9'

}

try:

response = requests.get(url, headers=headers)

if response.status_code == 200:

soup = BeautifulSoup(response.text, 'html.parser')

title = soup.find('title').text

print(f'Titre de la page : {title}')

else:

print(f'Échec de la récupération des données. Code statut : {response.status_code}')

except Exception as e:

print(f'Une erreur est survenue : {e}')Python + Playwright

import asyncio

from playwright.async_api import async_playwright

async def scrape_cheapflights():

async with async_playwright() as p:

# Lancement avec un contexte de navigateur réaliste

browser = await p.chromium.launch(headless=True)

page = await browser.new_page(user_agent='Mozilla/5.0 (Windows NT 10.0; Win64; x64) Chrome/119.0.0.0')

# Naviguer vers un résultat de recherche de vol spécifique

await page.goto('https://www.cheapflights.com/flights/NYC-LON/2026-06-15')

# Attendre que les résultats de vol se chargent dynamiquement

try:

await page.wait_for_selector('.resultWrapper', timeout=15000)

flights = await page.query_selector_all('.resultWrapper')

for flight in flights[:5]:

price = await flight.query_selector('.price-text')

print(f'Prix du vol trouvé : {await price.inner_text()}')

except:

print('Les résultats de vol n\'ont pas chargé ou ont été bloqués.')

await browser.close()

asyncio.run(scrape_cheapflights())Python + Scrapy

import scrapy

class CheapflightsSpider(scrapy.Spider):

name = 'cheapflights_spider'

start_urls = ['https://www.cheapflights.com/flights/']

def parse(self, response):

# Scrapy est idéal pour crawler des liens ; pour les résultats de recherche, utilisez Scrapy-Playwright

for item in response.css('.destination-card'):

yield {

'destination': item.css('.city-name::text').get(),

'price': item.css('.price-value::text').get(),

'route': item.css('.route-info::text').get(),

}Node.js + Puppeteer

const puppeteer = require('puppeteer-extra');

const StealthPlugin = require('puppeteer-extra-plugin-stealth');

puppeteer.use(StealthPlugin());

(async () => {

const browser = await puppeteer.launch({ headless: true });

const page = await browser.newPage();

// Naviguer vers un résultat de recherche

await page.goto('https://www.cheapflights.com/flights/SFO-TYO/2026-08-20');

// Attendre l'apparition des cartes de vol dynamiques

await page.waitForSelector('.resultWrapper', { timeout: 10000 });

const results = await page.evaluate(() => {

return Array.from(document.querySelectorAll('.resultWrapper')).map(el => ({

price: el.querySelector('.price-text')?.innerText,

airline: el.querySelector('.codeshare-airline-name')?.innerText

}));

});

console.log(results);

await browser.close();

})();Que Pouvez-Vous Faire Avec Les Données de Cheapflights

Explorez les applications pratiques et les insights des données de Cheapflights.

Suivi dynamique des prix

Les agences de voyages peuvent surveiller des itinéraires spécifiques et alerter les utilisateurs lorsque les prix descendent en dessous d'un seuil cible.

Comment implémenter :

- 1Programmez des scrapings quotidiens pour les itinéraires de vol populaires.

- 2Stockez l'historique des prix dans une base de données centrale.

- 3Déclenchez des notifications par email automatisées lorsque les prix cibles sont atteints.

Utilisez Automatio pour extraire des données de Cheapflights et créer ces applications sans écrire de code.

Que Pouvez-Vous Faire Avec Les Données de Cheapflights

- Suivi dynamique des prix

Les agences de voyages peuvent surveiller des itinéraires spécifiques et alerter les utilisateurs lorsque les prix descendent en dessous d'un seuil cible.

- Programmez des scrapings quotidiens pour les itinéraires de vol populaires.

- Stockez l'historique des prix dans une base de données centrale.

- Déclenchez des notifications par email automatisées lorsque les prix cibles sont atteints.

- Analyse des tendances du marché

Les analystes de l'aviation utilisent des données agrégées pour comprendre la demande saisonnière et les stratégies de tarification des compagnies aériennes.

- Collectez les données de prix moyens mensuels pour les principaux couloirs mondiaux.

- Corrélez les fluctuations de prix avec les événements majeurs ou les changements de prix du carburant.

- Visualisez les tendances pour fournir de la business intelligence aux startups du voyage.

- Détection d'erreurs de tarifs (Error Fares)

Identifiez les erreurs de tarification massives commises par les compagnies aériennes pour proposer des offres exclusives aux abonnés premium.

- Scrapez tous les départs des principaux hubs internationaux toutes les 30 minutes.

- Utilisez l'analyse statistique pour identifier les prix qui s'écartent fortement des écarts-types.

- Vérifiez manuellement et publiez les error fares sur une plateforme de bons plans.

- Tableau de bord de tarification compétitive

Les compagnies aériennes peuvent utiliser des données agrégées pour ajuster leurs propres tarifs en temps réel face à la concurrence.

- Scrapez les tarifs des concurrents sur des itinéraires communs plusieurs fois par jour.

- Injectez les données scrapées dans un moteur de tarification interne via API.

- Mettez à jour automatiquement les prix des sièges pour maintenir la compétitivité sur le marché.

- Génération de contenu de voyage

Générez automatiquement des guides sur le meilleur moment pour réserver en fonction des données de prix historiques.

- Scrapez et agrégez les données de prix annuelles pour des destinations spécifiques.

- Identifiez les mois les moins chers et les plus chers pour voyager.

- Générez automatiquement des infographies et des articles de blog pour booster le trafic SEO.

Optimisez votre flux de travail avec l'Automatisation IA

Automatio combine la puissance des agents IA, de l'automatisation web et des integrations intelligentes pour vous aider a accomplir plus en moins de temps.

Conseils Pro pour Scraper Cheapflights

Conseils d'experts pour extraire avec succès les données de Cheapflights.

Utiliser des proxies résidentiels

Évitez les IP de data centers, car elles sont presque instantanément signalées par Akamai ; les proxies résidentiels offrent les scores de confiance élevés nécessaires à une extraction réussie.

Surveiller les API internes

Utilisez l'onglet Réseau du navigateur pour identifier les requêtes XHR ou GraphQL en arrière-plan, qui contiennent souvent des données plus structurées que le HTML visible.

Capturer les cookies de session

Lancez une session de handshake initiale sur la page d'accueil pour obtenir des cookies 'FT' valides, nécessaires au chargement correct des pages de résultats de recherche suivantes.

Implémenter des délais aléatoires

Imitez les comportements de navigation humaine en ajoutant des pauses aléatoires entre les recherches pour éviter de déclencher les limites de débit et les alertes de sécurité comportementales.

Faire correspondre les User-Agents avec TLS

Assurez-vous que la chaîne User-Agent de votre navigateur correspond exactement à l'empreinte JA3 de votre scraper pour éviter d'être signalé en raison de signatures client incohérentes.

Témoignages

Ce Que Disent Nos Utilisateurs

Rejoignez des milliers d'utilisateurs satisfaits qui ont transforme leur flux de travail

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Associés Web Scraping

Questions Fréquentes sur Cheapflights

Trouvez des réponses aux questions courantes sur Cheapflights