Claude Opus 4.5

Claude Opus 4.5 est le frontier model le plus puissant d'Anthropic, offrant une performance record de 80,9 % sur SWE-bench et une autonomie avancée pour le...

À propos de Claude Opus 4.5

Découvrez les capacités, fonctionnalités et façons d'utiliser Claude Opus 4.5.

Claude Opus 4.5 est le model phare d'Anthropic, publié fin 2025. Il est spécifiquement conçu pour le génie logiciel complexe et le reasoning à enjeux élevés. Le model a obtenu un score record de 80,9 % au benchmark SWE-bench Verified, ce qui en fait un choix privilégié pour le débogage autonome et la refactorisation de systèmes. Il introduit une personnalité raffinée mettant l'accent sur l'honnêteté diplomatique et une aide nuancée.

Optimisation multimodale et agentic

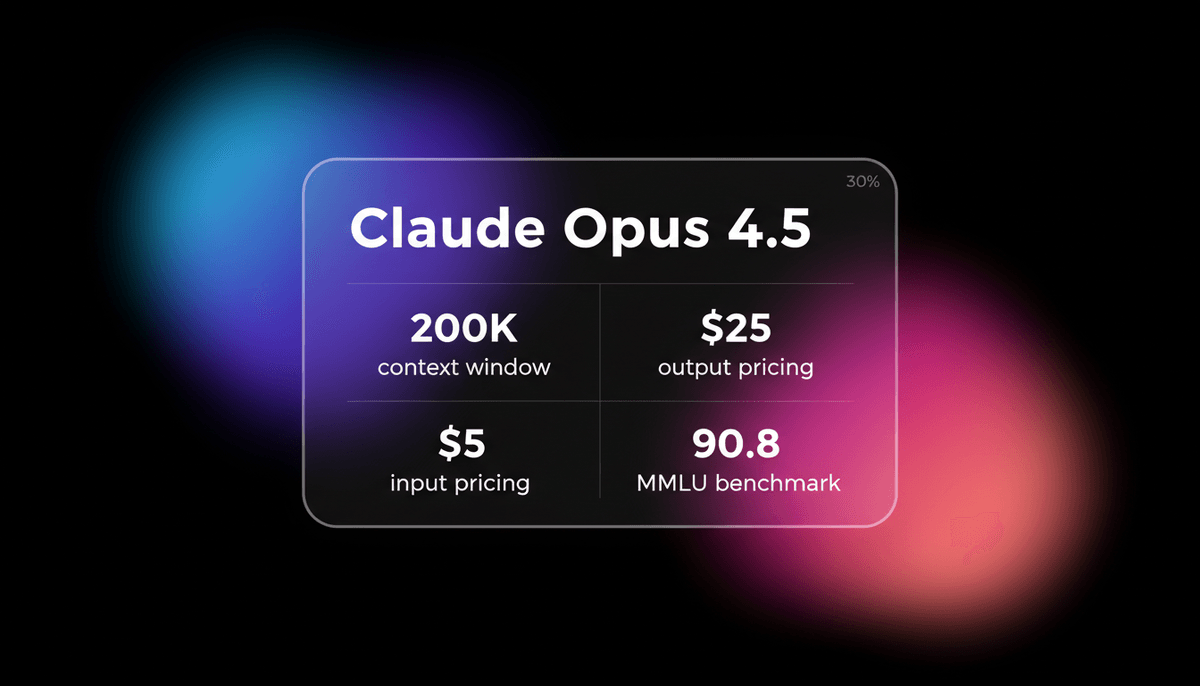

L'architecture prend en charge une context window de 200 000 tokens et une limite de sortie de 64 000 tokens. Les développeurs peuvent utiliser un paramètre effort spécialisé pour adapter la profondeur de reasoning au coût de calcul. Cette flexibilité permet d'effectuer des tâches logiques de haute intensité ou une rédaction créative plus rapide et économique. Le model est multimodal et excelle dans l'interprétation de diagrammes architecturaux et de mises en page d'interface denses.

Ingénierie et utilisation d'outils

Optimisé pour les flux de travail agentic, il navigue dans les environnements de terminal via Claude Code pour effectuer des audits à l'échelle du système. Il réduit considérablement la tarification des entrées et des sorties par rapport aux versions phares précédentes. Sa capacité à maintenir la cohérence sur des tâches à long terme le positionne comme un partenaire fiable pour les équipes d'ingénierie professionnelles et l'analyse de données complexe.

Cas d'utilisation de Claude Opus 4.5

Découvrez les différentes façons d'utiliser Claude Opus 4.5 pour obtenir d'excellents résultats.

Génie logiciel autonome

Automatisation du débogage de bout en bout et refactorisation à l'échelle du système avec un score record de 80,9 % au SWE-bench.

Flux de travail de recherche agentic

Synthèse de grandes quantités de données techniques en stratégies commerciales exploitables grâce à la context window de 200k.

Vision UI/UX haute fidélité

Conversion de designs Figma complexes et de diagrammes architecturaux en code frontend prêt pour la production avec une précision au pixel près.

Orchestration multi-agents

Agit comme le cerveau central pour des équipes de sous-agents afin de gérer des projets à long terme sur des bases de code disparates.

Analyse de données avancée

Automatisation de modèles financiers complexes et de flux de travail Excel avec une haute précision et une grande profondeur de reasoning.

Rédaction littéraire et créative

Production de textes nuancés respectant des goûts littéraires spécifiques et des principes de conception complexes centrés sur l'humain.

Points forts

Limitations

Démarrage rapide API

anthropic/claude-opus-4.5

import Anthropic from '@anthropic-ai/sdk';

const anthropic = new Anthropic({

apiKey: process.env.ANTHROPIC_API_KEY,

});

const msg = await anthropic.messages.create({

model: 'claude-opus-4-5-20251101',

max_tokens: 4096,

effort: 'high',

messages: [{ role: 'user', content: 'Analyze this system architecture for race conditions.' }],

});

console.log(msg.content[0].text);Installez le SDK et commencez à faire des appels API en quelques minutes.

Ce que les gens disent de Claude Opus 4.5

Voyez ce que la communauté pense de Claude Opus 4.5

“Claude Opus 4.5 semble moins être un assistant sans état et plus un coéquipier permanent. Il peut retracer les hypothèses sur plusieurs fichiers d'une manière qui semble clairement plus puissante.”

“Regarder votre AI agent développer une personnalité sur les réseaux sociaux qui résonne avec de vraies personnes d'une manière que vous ne pouvez expliquer. L'infrastructure compte plus que les prompts.”

“Opus est le model le plus performant sous cet aspect. Sa discussion est très naturelle et il vous suit vraiment dans le raisonnement.”

“Opus 4.5 saisit les nuances les plus subtiles. C'est le seul model à avoir réussi à inclure un mécanisme de trailer en ligne dès la première tentative.”

“Le score de 80,9 % au SWE-bench est probablement réel mais aussi un peu trompeur. Il nécessite une configuration d'environnement claire pour atteindre ces chiffres de manière cohérente.”

“SWE-bench Verified : 80,9 % (Opus 4.5) contre 71,3 % (Claude 3-Opus). Il s'agit d'un saut massif pour la fiabilité en conditions réelles.”

Vidéos sur Claude Opus 4.5

Regardez des tutoriels, critiques et discussions sur Claude Opus 4.5

“Opus 4.5 saisit les nuances les plus subtiles”

“C'est le seul model à avoir réussi à inclure un mécanisme de trailer en ligne dès la première tentative”

“Une évaluation du code pilotée par un agent confirme ce sentiment subjectif, attribuant à Opus un score de 7/10 pour l'exhaustivité des fonctionnalités”

“Le reasoning est bien plus logique que les versions précédentes lorsqu'il s'agit de gérer des cas limites”

“Il maintient la cohérence de la base de code sur des sessions de 30 minutes”

“Le prix est désormais trois fois moins cher. Il ne coûtera que 5 $ pour un million de tokens d'entrée”

“L'entrée est à 5 $ et la sortie à 25 $ pour un million de tokens”

“Opus 4.5 a obtenu un score plus élevé que n'importe quel candidat humain lors de l'examen technique d'Anthropic”

“C'est le premier model à franchir la barrière des 80 % sur SWE-bench”

“Il gère des sessions de codage autonomes de 30 minutes sans intervention humaine”

“Considérez Claude Opus 4.5 comme une couche de persuasion et un véritable monstre agentic”

“C'est un monstre absolu en matière de codage et d'agente”

“Les ingénieurs finissent par préférer travailler avec Claude Opus 4.5 car ils obtiennent des boucles de rétroaction très serrées”

“Le paramètre effort de reasoning est la fonctionnalité phare pour les développeurs”

“Il ressemble plus à un collaborateur qu'à un simple outil lors de discussions longues”

Optimisez votre flux de travail avec l'Automatisation IA

Automatio combine la puissance des agents IA, de l'automatisation web et des integrations intelligentes pour vous aider a accomplir plus en moins de temps.

Conseils Pro pour Claude Opus 4.5

Conseils d'experts pour tirer le meilleur parti de Claude Opus 4.5.

Activer le Reasoning Effort

Utilisez le paramètre effort en réglage 'high' pour une logique complexe ou des tâches de programmation, et 'medium' pour la rédaction créative standard.

Conception Vision-Native

Téléchargez des captures d'écran haute résolution des bugs d'interface, car le model est entraîné à identifier des divergences visuelles que les descriptions textuelles ignorent.

Prompts système structurés

Définissez des rôles agentic et des niveaux d'effort clairs dans vos prompts système pour éviter que le model ne réfléchisse trop à des tâches procédurales simples.

Compactage de contexte

Résumez l'historique lors de sessions prolongées pour garder la context window de 200k concentrée sur les informations les plus pertinentes.

Témoignages

Ce Que Disent Nos Utilisateurs

Rejoignez des milliers d'utilisateurs satisfaits qui ont transforme leur flux de travail

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Associés AI Models

Gemini 3.1 Flash-Lite

Gemini 3.1 Flash-Lite is Google's fastest, most cost-efficient model. Features 1M context, native multimodality, and 363 tokens/sec speed for scale.

Grok-4

xAI

Grok-4 by xAI is a frontier model featuring a 2M token context window, real-time X platform integration, and world-record reasoning capabilities.

Kimi K2.5

Moonshot

Discover Moonshot AI's Kimi K2.5, a 1T-parameter open-source agentic model featuring native multimodal capabilities, a 262K context window, and SOTA reasoning.

GLM-5.1

Zhipu (GLM)

GLM-5.1 is Zhipu AI's flagship reasoning model, featuring a 202K context window and an autonomous 8-hour execution loop for complex agentic engineering.

Qwen3.6-Max-Preview

alibaba

Qwen3.6-Max-Preview is Alibaba's flagship MoE model featuring 1M context, a native thinking mode, and SOTA scores in agentic coding and reasoning.

GLM-5

Zhipu (GLM)

GLM-5 is Zhipu AI's 744B parameter open-weight powerhouse, excelling in long-horizon agentic tasks, coding, and factual accuracy with a 200k context window.

GPT-5.1

OpenAI

GPT-5.1 is OpenAI’s advanced reasoning flagship featuring adaptive thinking, native multimodality, and state-of-the-art performance in math and technical...

GPT-5.2

OpenAI

GPT-5.2 is OpenAI's flagship model for professional tasks, featuring a 400K context window, elite coding, and deep multi-step reasoning capabilities.

Questions Fréquentes sur Claude Opus 4.5

Trouvez des réponses aux questions courantes sur Claude Opus 4.5