DeepSeek v4

DeepSeek v4 est un modèle MoE de 1,6T de paramètres doté d'une context window de 1M de tokens et d'un support multimodal natif pour texte, vision et vidéo à...

À propos de DeepSeek v4

Découvrez les capacités, fonctionnalités et façons d'utiliser DeepSeek v4.

Architecture haute efficacité à l'échelle du trillion

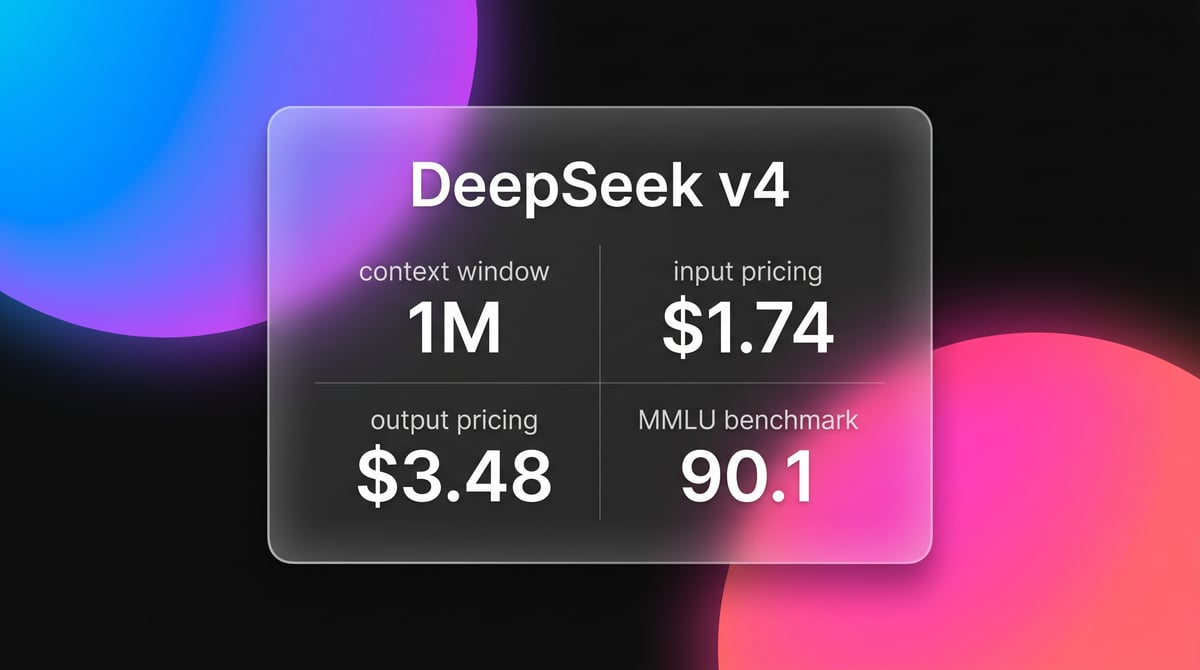

DeepSeek v4 représente une évolution dans la conception des Mixture-of-Experts (MoE), s'étendant jusqu'à 1,6 trillion de paramètres au total avec 49 milliards de paramètres actifs. Le modèle intègre les technologies CSA (Compressed Sparse Attention) et HCA (Heavily Compressed Attention) pour gérer sa context window d'un million de tokens. Ces technologies réduisent l'empreinte mémoire du cache KV de 90 % par rapport aux architectures standard, permettant une inference plus rapide et des exigences matérielles moindres pour les tâches à long contexte.

Intégration multimodale native

Contrairement aux modèles qui utilisent des encodeurs de vision ou d'audio séparés, DeepSeek v4 est nativement multimodal dès la phase d'entraînement initiale. Il traite le texte, les images, l'audio et la vidéo au sein d'un cadre unifié unique. Cette approche améliore le reasoning cross-modal, permettant au modèle d'effectuer des analyses complexes sur des fichiers vidéo bruts et des archives documentaires à grande échelle sans perdre les détails granulaires.

Disruption stratégique des coûts

Le modèle est positionné comme une alternative open-source performante aux modèles propriétaires de haut niveau. Avec une tarification à 1,74 $ par million de tokens en entrée, il maintient des performances de niveau frontier en coding et en mathématiques, tout en réduisant considérablement les coûts opérationnels pour les développeurs. L'inclusion d'un Thinking Mode optionnel permet un raisonnement approfondi pour les démonstrations logiques et la programmation compétitive.

Cas d'utilisation de DeepSeek v4

Découvrez les différentes façons d'utiliser DeepSeek v4 pour obtenir d'excellents résultats.

Refactoring de bases de code à grande échelle

Utilisation de la context window de 1M pour ingérer des dépôts entiers afin de détecter les bugs et d'apporter des améliorations architecturales globales.

Analyse vidéo native

Traitement direct de fichiers vidéo bruts pour effectuer la détection de scènes, la génération de transcriptions et un raisonnement visuel complexe.

Agents logiciels autonomes

Déploiement du modèle dans des workflows agentic pour résoudre des problèmes GitHub réels avec un taux de réussite de 80,6 % sur SWE-bench.

Création de contenu multimodal

Génération de données structurées et de contenu créatif via texte, image et audio en utilisant un modèle unifié.

Démonstrations mathématiques de haut niveau

Résolution de problèmes mathématiques de niveau Olympiade et démonstrations formelles grâce au Thinking Mode spécialisé pour le raisonnement approfondi.

Recherche de connaissances en entreprise

Analyse d'archives documentaires massives en un seul prompt pour extraire des faits sans avoir besoin de pipelines RAG complexes.

Points forts

Limitations

Démarrage rapide API

deepseek/deepseek-v4-pro

import OpenAI from 'openai'; const deepseek = new OpenAI({ baseURL: 'https://api.deepseek.com', apiKey: process.env.DEEPSEEK_API_KEY, }); const msg = await deepseek.chat.completions.create({ model: 'deepseek-v4-pro', messages: [{ role: 'user', content: 'Optimize this Rust kernel for memory efficiency.' }], }); console.log(msg.choices[0].message.content);Installez le SDK et commencez à faire des appels API en quelques minutes.

Ce que les gens disent de DeepSeek v4

Voyez ce que la communauté pense de DeepSeek v4

“Le mode de reasoning de DeepSeek v4 a trouvé un bug de concurrence dans mon code Rust que même Claude Opus a manqué. C'est vraiment fou.”

“L'ère du 1M de contexte rentable est enfin arrivée. Nous pouvons maintenant effectuer des refactorings de projets complets pour quelques centimes.”

“Voir le modèle travailler sur une base de code de 1M de tokens sans perdre le fil est le véritable tournant de 2026.”

“Anthropic et OpenAI ont un sérieux problème de tarification maintenant. DeepSeek vient de transformer l'IA de pointe en produit de commodité.”

“Il bat GPT-5.4 dans les benchmarks de coding tout en étant open source. C'est la plus grosse sortie de l'année.”

“La compression mémoire est la vraie magie. 1T de paramètres sur du matériel grand public commence enfin à devenir réalité.”

Vidéos sur DeepSeek v4

Regardez des tutoriels, critiques et discussions sur DeepSeek v4

“L'efficacité mémoire est le vrai point fort ici, réduire le cache KV de 90 % change tout”

“Faire tourner un modèle 1T avec ce niveau de vitesse est une victoire architecturale majeure”

“Le coût par million de tokens rend la chose incontournable pour les petites startups”

“Je n'ai jamais vu un modèle open source gérer 1 million de tokens aussi proprement”

“On dirait que l'écart entre les modèles open et closed s'est officiellement refermé”

“DeepSeek ne joue plus seulement sur les prix ; ils sont leaders en reasoning sur long contexte”

“Le support vidéo natif est étonnamment robuste comparé à Gemini 2.0”

“L'installation en local est étonnamment simple si vous utilisez SGLang”

“Les benchmarks sur HumanEval montrent qu'il est essentiellement à parité avec GPT-5”

“La context window rend les pipelines RAG presque redondants pour les projets de taille moyenne”

“Les performances sur les benchmarks de coding sont actuellement inégalées par tout autre modèle open-weight”

“Il égale ou dépasse les meilleurs modèles fermés sur le refactoring massif de bases de code”

“L'implémentation de la mémoire engramme est une prouesse technique dans ce domaine”

“Nous constatons une précision logique de 90 % en Thinking Mode pour les maths de niveau Olympiade”

“Cette version démocratise efficacement l'intelligence à mille milliards de paramètres”

Optimisez votre flux de travail avec l'Automatisation IA

Automatio combine la puissance des agents IA, de l'automatisation web et des integrations intelligentes pour vous aider a accomplir plus en moins de temps.

Conseils Pro pour DeepSeek v4

Conseils d'experts pour tirer le meilleur parti de DeepSeek v4.

Basculer entre les modes de réflexion

Utilisez le mode standard pour des échanges rapides et réservez le Thinking Mode spécifiquement pour le coding et les démonstrations logiques.

Exploiter le cache de contexte

Utilisez les fonctionnalités de mise en cache de contexte intégrées pour réduire les coûts jusqu'à 90 % lors de l'utilisation de prompts à long contexte répétitifs.

Entrée multimodale directe

Fournissez des fichiers audio et vidéo bruts directement dans l'API pour bénéficier de l'architecture native plutôt que de passer par une pré-transcription.

Optimisation du System Prompt

Fournissez un schéma JSON clair ou des instructions d'utilisation d'outils dans le system prompt pour un comportement agentic hautement fiable.

Témoignages

Ce Que Disent Nos Utilisateurs

Rejoignez des milliers d'utilisateurs satisfaits qui ont transforme leur flux de travail

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Associés AI Models

Claude Sonnet 4.6

Anthropic

Claude Sonnet 4.6 offers frontier performance for coding and computer use with a massive 1M token context window for only $3/1M tokens.

Gemini 3 Flash

Gemini 3 Flash is Google's high-speed multimodal model featuring a 1M token context window, elite 90.4% GPQA reasoning, and autonomous browser automation tools.

Kimi k2.6

Moonshot

Kimi k2.6 is Moonshot AI's 1T-parameter MoE model featuring a 256K context window, native video input, and elite performance in autonomous agentic coding.

Claude Opus 4.6

Anthropic

Claude Opus 4.6 is Anthropic's flagship model featuring a 1M token context window, Adaptive Thinking, and world-class coding and reasoning performance.

Qwen3.5-397B-A17B

alibaba

Qwen3.5-397B-A17B is Alibaba's flagship open-weight MoE model. It features native multimodal reasoning, a 1M context window, and a 19x decoding throughput...

Gemini 3 Pro

Google's Gemini 3 Pro is a multimodal powerhouse featuring a 1M token context window, native video processing, and industry-leading reasoning performance.

GPT-5.1

OpenAI

GPT-5.1 is OpenAI’s advanced reasoning flagship featuring adaptive thinking, native multimodality, and state-of-the-art performance in math and technical...

Qwen 3.7 Max

alibaba

Qwen 3.7 Max is Alibaba’s flagship AI model for deep reasoning and autonomous agent tasks, featuring a 256k context window and top-tier coding performance.

Questions Fréquentes sur DeepSeek v4

Trouvez des réponses aux questions courantes sur DeepSeek v4