DeepSeek v4

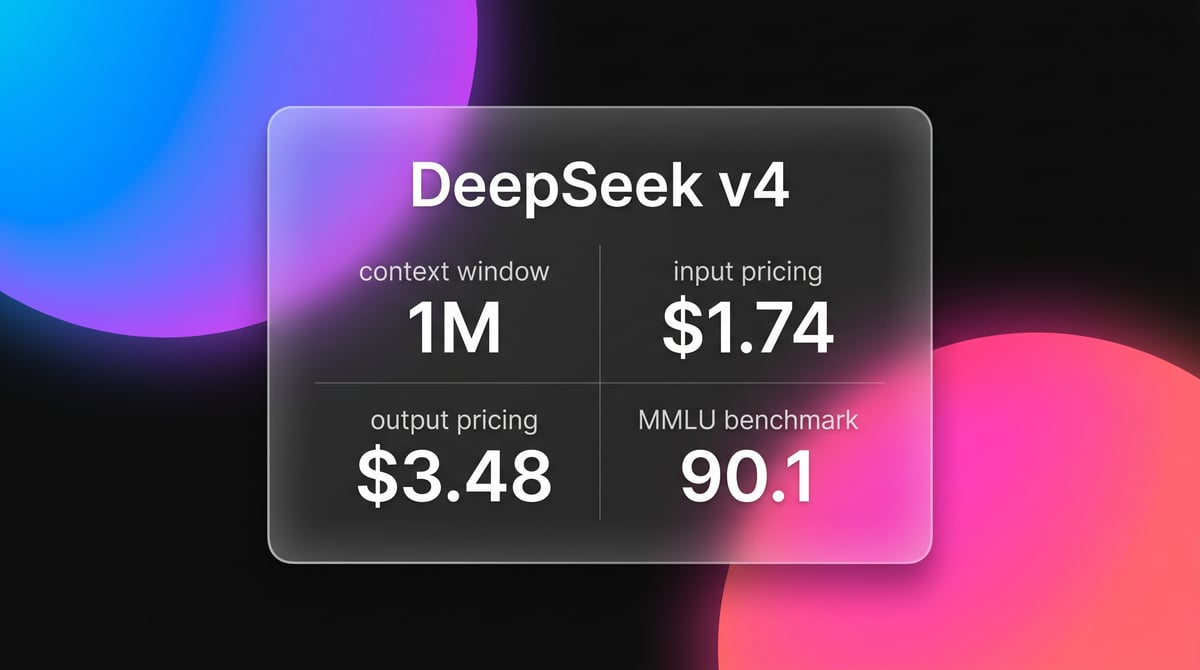

DeepSeek v4 è un modello MoE da 1,6T di parametri con una context window da 1M di tokens e supporto multimodal nativo per testo, visione e video a prezzi...

Informazioni su DeepSeek v4

Scopri le capacita di DeepSeek v4, le funzionalita e come puo aiutarti a ottenere risultati migliori.

Architettura ad alta efficienza su scala di trilioni

DeepSeek v4 rappresenta un'evoluzione nel design Mixture-of-Experts (MoE), scalando a 1,6 trilioni di parametri totali con 49 miliardi di parametri attivi. Il modello integra Compressed Sparse Attention (CSA) e Heavily Compressed Attention (HCA) per gestire la sua context window da 1 milione di tokens. Queste tecnologie riducono l'impronta di memoria della cache KV del 90% rispetto alle architetture standard, consentendo una inference più rapida e requisiti hardware inferiori per attività a contesto lungo. ### Integrazione multimodal nativa A differenza dei modelli che utilizzano encoder di visione o audio separati, DeepSeek v4 è nativamente multimodal sin dalla fase di addestramento iniziale. Elabora testo, immagini, audio e video all'interno di un unico framework unificato. Questo approccio migliora il reasoning cross-modale, consentendo al modello di eseguire analisi complesse su file video grezzi e vasti archivi di documenti senza perdere dettagli granulari. ### Disruption strategica dei costi Il modello si posiziona come un'alternativa open-source performante ai modelli proprietari di fascia alta. Con un prezzo di 1,74 $ per milione di input tokens, mantiene prestazioni di livello frontier nel coding e nella matematica, riducendo significativamente i costi operativi per gli sviluppatori. L'inclusione di una Thinking Mode opzionale consente un deep reasoning per dimostrazioni logiche e programmazione competitiva.

Casi d'uso per DeepSeek v4

Scopri i diversi modi in cui puoi usare DeepSeek v4 per ottenere ottimi risultati.

Refactoring di codebase su larga scala

Utilizzo della context window da 1M per acquisire intere repository per il rilevamento globale di bug e miglioramenti architettonici.

Analisi video nativa

Elaborazione diretta di file video grezzi per eseguire rilevamento di scene, generazione di trascrizioni e reasoning visivo complesso.

Agenti software autonomi

Implementazione del modello in flussi di lavoro agentic per risolvere problemi GitHub del mondo reale con un tasso di successo dell'80,6% su SWE-bench.

Creazione di contenuti multimodal

Generazione di dati strutturati e contenuti creativi su formati testo, immagine e audio utilizzando un unico modello unificato.

Dimostrazioni matematiche di alto livello

Risoluzione di problemi matematici di livello olimpico e dimostrazioni formali utilizzando la speciale Thinking Mode per il deep reasoning.

Recupero della conoscenza aziendale

Analisi di enormi archivi di documenti in un unico prompt per estrarre fatti senza bisogno di complesse pipeline RAG.

Punti di forza

Limitazioni

Avvio rapido API

deepseek/deepseek-v4-pro

import OpenAI from 'openai'; const deepseek = new OpenAI({ baseURL: 'https://api.deepseek.com', apiKey: process.env.DEEPSEEK_API_KEY, }); const msg = await deepseek.chat.completions.create({ model: 'deepseek-v4-pro', messages: [{ role: 'user', content: 'Ottimizza questo kernel Rust per l'efficienza della memoria.' }], }); console.log(msg.choices[0].message.content);Installa l'SDK e inizia a fare chiamate API in pochi minuti.

Cosa dice la gente su DeepSeek v4

Guarda cosa pensa la community di DeepSeek v4

“La modalità di reasoning di DeepSeek v4 ha trovato un bug di concurrency nel mio codice Rust che persino Claude Opus ha mancato. Davvero folle.”

“L'era del contesto da 1M conveniente è finalmente arrivata. Ora possiamo eseguire refactoring dell'intero progetto per pochi centesimi.”

“Vedere il modello lavorare attraverso una codebase da 1M di tokens senza perdere l'orientamento è il vero punto di svolta per il 2026.”

“Anthropic e OpenAI hanno ora un serio problema di prezzo. DeepSeek ha appena trasformato l'AI di frontiera in una commodity.”

“Batte GPT-5.4 nei benchmark di coding pur essendo open-source. Questa è la più grande uscita dell'anno.”

“La compressione della memoria è la vera magia. 1T di parametri su hardware consumer-ish sta finalmente diventando realtà.”

Video su DeepSeek v4

Guarda tutorial, recensioni e discussioni su DeepSeek v4

“L'efficienza della memoria è il vero punto focale qui, ridurre la cache KV del 90% cambia tutto”

“Eseguire un modello da 1T con questo livello di velocità è una grande vittoria architettonica”

“Il costo per milione di tokens rende impossibile per le piccole startup ignorarlo”

“Non ho mai visto un modello open-source gestire 1 milione di tokens in modo così pulito”

“Sembra che il divario tra modelli open e closed si sia ufficialmente colmato”

“DeepSeek non compete più solo sul prezzo; sono leader nel reasoning su contesto lungo”

“Il supporto video nativo è sorprendentemente robusto rispetto a Gemini 2.0”

“Installarlo localmente è sorprendentemente facile se usi SGLang”

“I benchmark su HumanEval mostrano che è essenzialmente alla pari con GPT-5”

“La context window rende le pipeline RAG quasi superflue per progetti di medie dimensioni”

“Le prestazioni sui benchmark di coding sono attualmente ineguagliate da qualsiasi altro modello open-weight”

“Eguaglia o supera i migliori modelli closed nel refactoring di enormi codebase”

“L'implementazione della memoria engram è una meraviglia tecnica in questo spazio”

“Stiamo vedendo una precisione logica del 90% nella Thinking Mode per la matematica olimpica”

“Questa release democratizza efficacemente l'intelligenza da trilioni di parametri”

Potenzia il tuo workflow con l'automazione AI

Automatio combina la potenza degli agenti AI, dell'automazione web e delle integrazioni intelligenti per aiutarti a fare di piu in meno tempo.

Consigli Pro per DeepSeek v4

Consigli esperti per aiutarti a ottenere il massimo da DeepSeek v4 e raggiungere risultati migliori.

Alterna le modalità di pensiero

Usa la modalità standard per chat rapide e riserva la Thinking Mode specificamente per coding e dimostrazioni logiche.

Sfrutta il caching del contesto

Utilizza le funzionalità integrate di context caching per ridurre i costi fino al 90% quando utilizzi prompt lunghi e ripetitivi.

Input multimodal diretto

Inserisci file audio e video grezzi direttamente nella API per beneficiare dell'architettura nativa invece di effettuare una trascrizione preliminare.

Ottimizzazione del system prompt

Fornisci schemi JSON chiari o istruzioni per l'uso di tool nel system prompt per un comportamento agentic altamente affidabile.

Testimonianze

Cosa dicono i nostri utenti

Unisciti a migliaia di utenti soddisfatti che hanno trasformato il loro workflow

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Correlati AI Models

Claude Sonnet 4.6

Anthropic

Claude Sonnet 4.6 offers frontier performance for coding and computer use with a massive 1M token context window for only $3/1M tokens.

Gemini 3 Flash

Gemini 3 Flash is Google's high-speed multimodal model featuring a 1M token context window, elite 90.4% GPQA reasoning, and autonomous browser automation tools.

Kimi k2.6

Moonshot

Kimi k2.6 is Moonshot AI's 1T-parameter MoE model featuring a 256K context window, native video input, and elite performance in autonomous agentic coding.

Claude Opus 4.6

Anthropic

Claude Opus 4.6 is Anthropic's flagship model featuring a 1M token context window, Adaptive Thinking, and world-class coding and reasoning performance.

Qwen3.5-397B-A17B

alibaba

Qwen3.5-397B-A17B is Alibaba's flagship open-weight MoE model. It features native multimodal reasoning, a 1M context window, and a 19x decoding throughput...

Gemini 3 Pro

Google's Gemini 3 Pro is a multimodal powerhouse featuring a 1M token context window, native video processing, and industry-leading reasoning performance.

GPT-5.1

OpenAI

GPT-5.1 is OpenAI’s advanced reasoning flagship featuring adaptive thinking, native multimodality, and state-of-the-art performance in math and technical...

Qwen 3.7 Max

alibaba

Qwen 3.7 Max is Alibaba’s flagship AI model for deep reasoning and autonomous agent tasks, featuring a 256k context window and top-tier coding performance.

Domande frequenti su DeepSeek v4

Trova risposte alle domande comuni su DeepSeek v4