DeepSeek v4

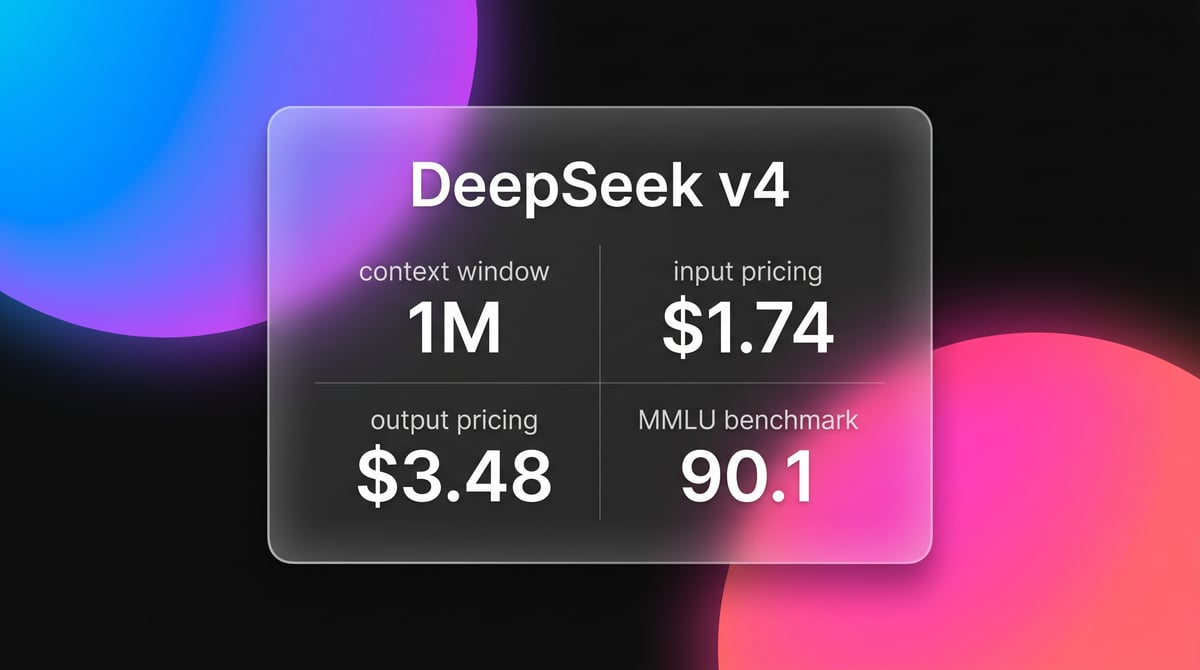

DeepSeek v4 to model MoE o 1,6 bln parametrów z 1M context window i natywnym wsparciem multimodalnym dla tekstu, obrazu i wideo w przełomowych cenach.

O DeepSeek v4

Dowiedz sie o mozliwosciach DeepSeek v4, funkcjach i jak moze pomoc Ci osiagnac lepsze wyniki.

Architektura o wysokiej wydajności na skalę bilionową

DeepSeek v4 reprezentuje ewolucję w projektowaniu Mixture-of-Experts (MoE), skalując się do 1,6 biliona parametrów całkowitych z 49 miliardami aktywnych parametrów. Model integruje Compressed Sparse Attention (CSA) oraz Heavily Compressed Attention (HCA) do zarządzania swoim 1-milionowym context window. Technologie te redukują ślad pamięciowy KV cache o 90% w porównaniu ze standardowymi architekturami, co pozwala na szybszą inference i mniejsze wymagania sprzętowe w zadaniach o długim context.

Natywna integracja multimodalna

W przeciwieństwie do modeli korzystających z oddzielnych koderów wizji lub audio, DeepSeek v4 jest natywnie multimodalny od początkowej fazy treningu. Przetwarza tekst, obrazy, audio i wideo w ramach jednego, zunifikowanego frameworku. Takie podejście poprawia cross-modal reasoning, umożliwiając modelowi wykonywanie złożonych analiz na surowych plikach wideo i obszernych archiwach dokumentów bez utraty szczegółów.

Strategiczna rewolucja cenowa

Model pozycjonuje się jako wydajna alternatywa open-source dla wysokiej klasy modeli proprietary. Dzięki wycenie na poziomie 1,74 USD za milion input tokens, utrzymuje wydajność klasy frontier w kodowaniu i matematyce, jednocześnie znacząco obniżając koszty operacyjne dla programistów. Dodatkowy, opcjonalny Thinking Mode pozwala na głęboki reasoning przy dowodach logicznych i programowaniu konkursowym.

Przypadki uzycia dla DeepSeek v4

Odkryj rozne sposoby wykorzystania DeepSeek v4 do osiagniecia swietnych wynikow.

Refaktoryzacja dużych baz kodu

Wykorzystanie 1M context window do wczytywania całych repozytoriów w celu globalnego wykrywania błędów i wprowadzania usprawnień architektonicznych.

Natywna analiza wideo

Bezpośrednie przetwarzanie surowych plików wideo w celu wykrywania scen, generowania transkrypcji i złożonego visual reasoning.

Autonomiczne agenty programistyczne

Wdrażanie modelu w workflow agentic w celu rozwiązywania rzeczywistych problemów z GitHub z 80,6% skutecznością w SWE-bench.

Multimodalne tworzenie treści

Generowanie ustrukturyzowanych danych i kreatywnych treści w formatach tekstowym, graficznym i audio przy użyciu jednego modelu.

Zaawansowane dowody matematyczne

Rozwiązywanie problemów matematycznych na poziomie olimpijskim oraz dowodów formalnych przy użyciu wyspecjalizowanego Thinking Mode do deep reasoning.

Wyszukiwanie w wiedzy korporacyjnej

Analiza ogromnych archiwów dokumentów w jednym prompt w celu wyodrębniania faktów bez konieczności tworzenia złożonych potoków RAG.

Mocne strony

Ograniczenia

Szybki start API

deepseek/deepseek-v4-pro

import OpenAI from 'openai'; const deepseek = new OpenAI({ baseURL: 'https://api.deepseek.com', apiKey: process.env.DEEPSEEK_API_KEY, }); const msg = await deepseek.chat.completions.create({ model: 'deepseek-v4-pro', messages: [{ role: 'user', content: 'Zoptymalizuj ten kernel Rust pod kątem wydajności pamięci.' }], }); console.log(msg.choices[0].message.content);Zainstaluj SDK i zacznij wykonywac wywolania API w kilka minut.

Co mowia ludzie o DeepSeek v4

Zobacz, co spolecznosc mysli o DeepSeek v4

“Tryb reasoning w DeepSeek v4 znalazł błąd współbieżności w moim kodzie Rust, który pominął nawet Claude Opus. Absolutnie niesamowite.”

“Era opłacalnego 1M context wreszcie nadeszła. Możemy teraz przeprowadzać refaktoryzację całych projektów za grosze.”

“Obserwowanie, jak model radzi sobie z bazą kodu o wielkości 1M tokenów bez gubienia wątku, to prawdziwy punkt zwrotny 2026 roku.”

“Anthropic i OpenAI mają teraz poważny problem z cenami. DeepSeek właśnie uczynił AI klasy frontier towarem powszechnym.”

“Pokonuje GPT-5.4 w benchmark kodowania, będąc jednocześnie open source. To najważniejsza premiera tego roku.”

“Kompresja pamięci to prawdziwa magia. 1T parametrów na sprzęcie klasy konsumenckiej staje się wreszcie rzeczywistością.”

Filmy o DeepSeek v4

Ogladaj samouczki, recenzje i dyskusje o DeepSeek v4

“Wydajność pamięci jest tutaj prawdziwym przełomem; redukcja KV cache o 90% zmienia wszystko”

“Uruchomienie modelu 1T z taką prędkością to ogromny sukces architektoniczny”

“Koszt za milion tokens sprawia, że małe startupy nie mogą go zignorować”

“Nigdy nie widziałem modelu open-source, który tak czysto obsługuje 1 milion tokens”

“Wygląda na to, że przepaść między modelami open i closed została oficjalnie zasypana”

“DeepSeek nie konkuruje już tylko ceną; prowadzą w dziedzinie long-context reasoning”

“Natywna obsługa wideo jest zaskakująco solidna w porównaniu do Gemini 2.0”

“Lokalna instalacja jest zaskakująco prosta, jeśli użyjesz SGLang”

“Wyniki w HumanEval pokazują, że jest w zasadzie na równi z GPT-5”

“To context window sprawia, że potoki RAG stają się niemal zbędne w średnich projektach”

“Wydajność w benchmark kodowania jest obecnie nieosiągalna dla żadnego innego modelu open-weight”

“Dorównuje lub przewyższa topowe modele zamknięte w refaktoryzacji potężnych baz kodu”

“Implementacja pamięci engramowej to techniczne arcydzieło w tej dziedzinie”

“Widzimy 90% dokładności logicznej w Thinking Mode dla matematyki olimpijskiej”

“To wydanie skutecznie demokratyzuje inteligencję o skali biliona parametrów”

Przyspiesz swoj workflow z automatyzacja AI

Automatio laczy moc agentow AI, automatyzacji web i inteligentnych integracji, aby pomoc Ci osiagnac wiecej w krotszym czasie.

Porady Pro dla DeepSeek v4

Wskazówki ekspertów, aby w pełni wykorzystać DeepSeek v4.

Przełączanie trybów Thinking Mode

Używaj standardowego trybu do szybkiego czatu, a Thinking Mode zarezerwuj specjalnie dla kodowania i dowodów logicznych.

Wykorzystanie context caching

Korzystaj z wbudowanych funkcji context caching, aby obniżyć koszty nawet o 90% przy używaniu powtarzalnych prompt o długim context.

Bezpośredni input multimodal

Przesyłaj surowe pliki audio i wideo bezpośrednio do API, aby skorzystać z natywnej architektury zamiast wstępnej transkrypcji.

Optymalizacja system prompt

Dostarczaj przejrzyste schematy JSON lub instrukcje tool-use w system prompt, aby uzyskać wysoce niezawodne działanie agentic.

Opinie

Co mowia nasi uzytkownicy

Dolacz do tysiecy zadowolonych uzytkownikow, ktorzy przeksztalcili swoj workflow

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Powiazane AI Models

Claude Sonnet 4.6

Anthropic

Claude Sonnet 4.6 offers frontier performance for coding and computer use with a massive 1M token context window for only $3/1M tokens.

Gemini 3 Flash

Gemini 3 Flash is Google's high-speed multimodal model featuring a 1M token context window, elite 90.4% GPQA reasoning, and autonomous browser automation tools.

Kimi k2.6

Moonshot

Kimi k2.6 is Moonshot AI's 1T-parameter MoE model featuring a 256K context window, native video input, and elite performance in autonomous agentic coding.

Claude Opus 4.6

Anthropic

Claude Opus 4.6 is Anthropic's flagship model featuring a 1M token context window, Adaptive Thinking, and world-class coding and reasoning performance.

Qwen3.5-397B-A17B

alibaba

Qwen3.5-397B-A17B is Alibaba's flagship open-weight MoE model. It features native multimodal reasoning, a 1M context window, and a 19x decoding throughput...

Gemini 3 Pro

Google's Gemini 3 Pro is a multimodal powerhouse featuring a 1M token context window, native video processing, and industry-leading reasoning performance.

GPT-5.1

OpenAI

GPT-5.1 is OpenAI’s advanced reasoning flagship featuring adaptive thinking, native multimodality, and state-of-the-art performance in math and technical...

Qwen 3.7 Max

alibaba

Qwen 3.7 Max is Alibaba’s flagship AI model for deep reasoning and autonomous agent tasks, featuring a 256k context window and top-tier coding performance.

Często Zadawane Pytania o DeepSeek v4

Znajdź odpowiedzi na częste pytania o DeepSeek v4