DeepSeek v4

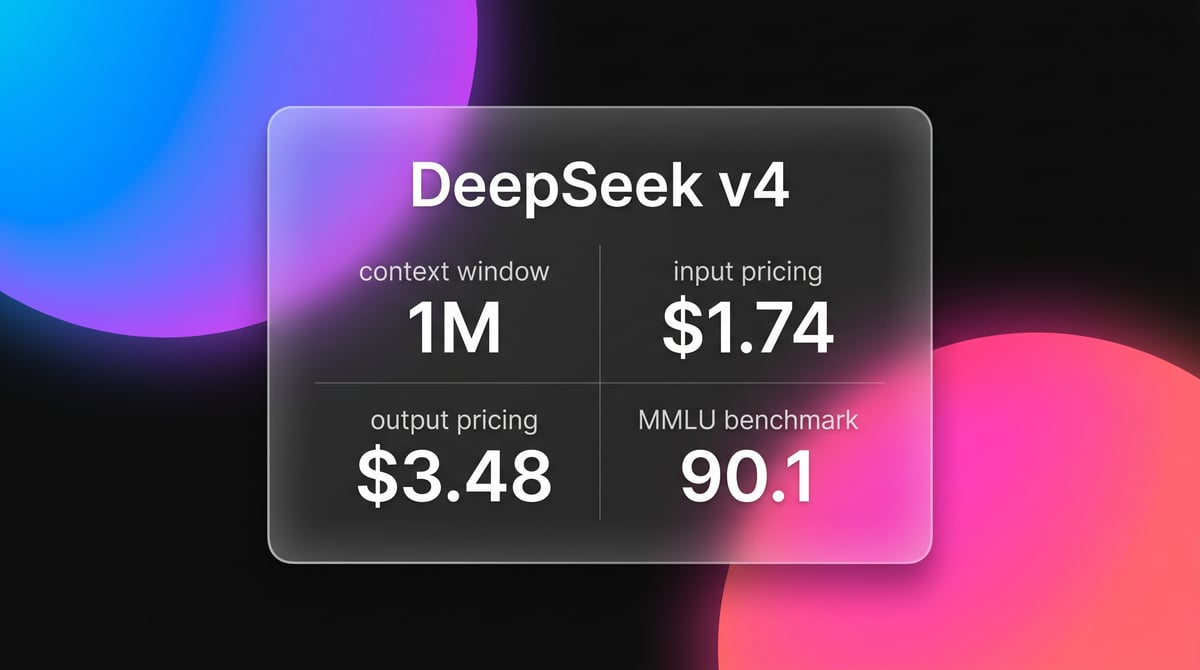

O DeepSeek v4 é um model MoE de 1,6T de parâmetros com uma context window de 1M de tokens e suporte multimodal nativo para texto, visão e vídeo a preços...

Sobre DeepSeek v4

Aprenda sobre as capacidades do DeepSeek v4, recursos e como ele pode ajuda-lo a obter melhores resultados.

Arquitetura de Alta Eficiência em Escala de Trilhões

O DeepSeek v4 representa uma evolução no design de Mixture-of-Experts (MoE), escalando para 1,6 trilhões de parâmetros totais com 49 bilhões de parâmetros ativos. O model integra Compressed Sparse Attention (CSA) e Heavily Compressed Attention (HCA) para gerenciar sua context window de 1 milhão de tokens. Essas tecnologias reduzem o footprint de memória do cache KV em 90% em comparação com arquiteturas padrão, permitindo inferência mais rápida e menores requisitos de hardware para tarefas de long context.

Integração Multimodal Nativa

Diferente de modelos que usam encoders de visão ou áudio separados, o DeepSeek v4 é nativamente multimodal desde a fase inicial de treinamento. Ele processa texto, imagens, áudio e vídeo dentro de um framework unificado único. Essa abordagem melhora o reasoning intermodal, permitindo que o model execute análises complexas em arquivos de vídeo brutos e arquivos de documentos em grande escala sem perder detalhes granulares.

Disrupção Estratégica de Custos

O model é posicionado como uma alternativa open-source de alto desempenho aos modelos proprietários de alto nível. Com um preço de US$ 1,74 por milhão de tokens de entrada, ele mantém um desempenho de nível frontier em coding e matemática, reduzindo significativamente os custos operacionais para desenvolvedores. A inclusão de um Thinking Mode opcional permite um deep reasoning para provas lógicas e programação competitiva.

Casos de Uso para DeepSeek v4

Descubra as diferentes maneiras de usar DeepSeek v4 para obter otimos resultados.

Refatoração de Bases de Código em Grande Escala

Utilizando a context window de 1M para processar repositórios inteiros para detecção global de bugs e melhorias arquiteturais.

Análise Nativa de Vídeo

Processando arquivos de vídeo brutos diretamente para realizar detecção de cenas, geração de transcrições e reasoning visual complexo.

Agentes de Software Autônomos

Implantando o model em fluxos de trabalho agentic para resolver problemas reais do GitHub com uma taxa de sucesso de 80,6% no SWE-bench.

Criação de Conteúdo Multimodal

Gerando dados estruturados e conteúdo criativo em formatos de texto, imagem e áudio usando um model unificado.

Provas Matemáticas de Alto Nível

Resolvendo problemas de matemática de nível de olimpíada e provas formais usando o Thinking Mode especializado para deep reasoning.

Recuperação de Conhecimento Corporativo

Analisando arquivos massivos de documentos em um único prompt para extrair fatos sem a necessidade de pipelines de RAG complexos.

Pontos Fortes

Limitacoes

Inicio Rapido da API

deepseek/deepseek-v4-pro

import OpenAI from 'openai'; const deepseek = new OpenAI({ baseURL: 'https://api.deepseek.com', apiKey: process.env.DEEPSEEK_API_KEY, }); const msg = await deepseek.chat.completions.create({ model: 'deepseek-v4-pro', messages: [{ role: 'user', content: 'Otimize este kernel Rust para eficiência de memória.' }], }); console.log(msg.choices[0].message.content);Instale o SDK e comece a fazer chamadas de API em minutos.

O Que as Pessoas Estao Dizendo Sobre DeepSeek v4

Veja o que a comunidade pensa sobre DeepSeek v4

“O modo de reasoning do DeepSeek v4 encontrou um bug de concorrência no meu código Rust que até o Claude Opus deixou passar. Realmente insano.”

“A era do long context de 1M com bom custo-benefício finalmente chegou. Agora podemos fazer refatorações de projetos completos por centavos.”

“Ver o model trabalhar em uma base de código de 1M de tokens sem perder o 'fio da meada' é o verdadeiro ponto de virada para 2026.”

“A Anthropic e a OpenAI têm um sério problema de precificação agora. O DeepSeek acabou de transformar IA frontier em uma commodity.”

“Ele supera o GPT-5.4 em benchmarks de coding enquanto é open-source. Este é o maior lançamento do ano.”

“A compressão de memória é a verdadeira mágica. 1T de parâmetros em hardware de consumo está finalmente se tornando real.”

Videos Sobre DeepSeek v4

Assista tutoriais, analises e discussoes sobre DeepSeek v4

“A eficiência de memória é o ponto principal aqui; reduzir o cache KV em 90% muda tudo”

“Executar um model de 1T com esse nível de velocidade é uma vitória arquitetural massiva”

“O custo por milhão de tokens torna impossível para pequenas startups ignorarem”

“Nunca vi um model open-source lidar com 1 milhão de tokens tão bem”

“Parece que o abismo entre modelos open e closed foi oficialmente fechado”

“O DeepSeek não está mais competindo apenas por preço; eles estão liderando em reasoning com long context”

“O suporte nativo a vídeo é surpreendentemente robusto comparado ao Gemini 2.0”

“Instalar isso localmente é surpreendentemente fácil se você usar o SGLang”

“Benchmarks no HumanEval mostram que ele está essencialmente em paridade com o GPT-5”

“A context window torna pipelines de RAG quase redundantes para projetos de médio porte”

“O desempenho em benchmarks de coding é atualmente inigualável por qualquer outro model de pesos abertos”

“Ele iguala ou supera os melhores modelos closed em refatoração de bases de código massivas”

“A implementação de engram memory é uma maravilha técnica neste espaço”

“Estamos vendo 90% de precisão lógica no Thinking Mode para matemática de olimpíada”

“Este lançamento efetivamente democratiza a inteligência de trilhões de parâmetros”

Potencialize seu fluxo de trabalho com Automacao de IA

Automatio combina o poder de agentes de IA, automacao web e integracoes inteligentes para ajuda-lo a realizar mais em menos tempo.

Dicas Profissionais para DeepSeek v4

Dicas de especialistas para ajuda-lo a aproveitar ao maximo DeepSeek v4 e obter melhores resultados.

Alternar Modos de Pensamento

Use o modo padrão para conversas rápidas e reserve o Thinking Mode especificamente para coding e provas lógicas.

Aproveite o Context Caching

Utilize recursos integrados de context caching para reduzir custos em até 90% ao usar prompts de long context repetitivos.

Entrada Multimodal Direta

Envie arquivos de áudio e vídeo brutos diretamente para a API para se beneficiar da arquitetura nativa em vez de realizar transcrições prévias.

Otimização de System Prompt

Forneça esquemas JSON claros ou instruções de tool-use no system prompt para um comportamento agentic altamente confiável.

Depoimentos

O Que Nossos Usuarios Dizem

Junte-se a milhares de usuarios satisfeitos que transformaram seu fluxo de trabalho

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Relacionados AI Models

Claude Sonnet 4.6

Anthropic

Claude Sonnet 4.6 offers frontier performance for coding and computer use with a massive 1M token context window for only $3/1M tokens.

Gemini 3 Flash

Gemini 3 Flash is Google's high-speed multimodal model featuring a 1M token context window, elite 90.4% GPQA reasoning, and autonomous browser automation tools.

Kimi k2.6

Moonshot

Kimi k2.6 is Moonshot AI's 1T-parameter MoE model featuring a 256K context window, native video input, and elite performance in autonomous agentic coding.

Claude Opus 4.6

Anthropic

Claude Opus 4.6 is Anthropic's flagship model featuring a 1M token context window, Adaptive Thinking, and world-class coding and reasoning performance.

Qwen3.5-397B-A17B

alibaba

Qwen3.5-397B-A17B is Alibaba's flagship open-weight MoE model. It features native multimodal reasoning, a 1M context window, and a 19x decoding throughput...

Gemini 3 Pro

Google's Gemini 3 Pro is a multimodal powerhouse featuring a 1M token context window, native video processing, and industry-leading reasoning performance.

GPT-5.1

OpenAI

GPT-5.1 is OpenAI’s advanced reasoning flagship featuring adaptive thinking, native multimodality, and state-of-the-art performance in math and technical...

Qwen 3.7 Max

alibaba

Qwen 3.7 Max is Alibaba’s flagship AI model for deep reasoning and autonomous agent tasks, featuring a 256k context window and top-tier coding performance.

Perguntas Frequentes Sobre DeepSeek v4

Encontre respostas para perguntas comuns sobre DeepSeek v4