DeepSeek v4

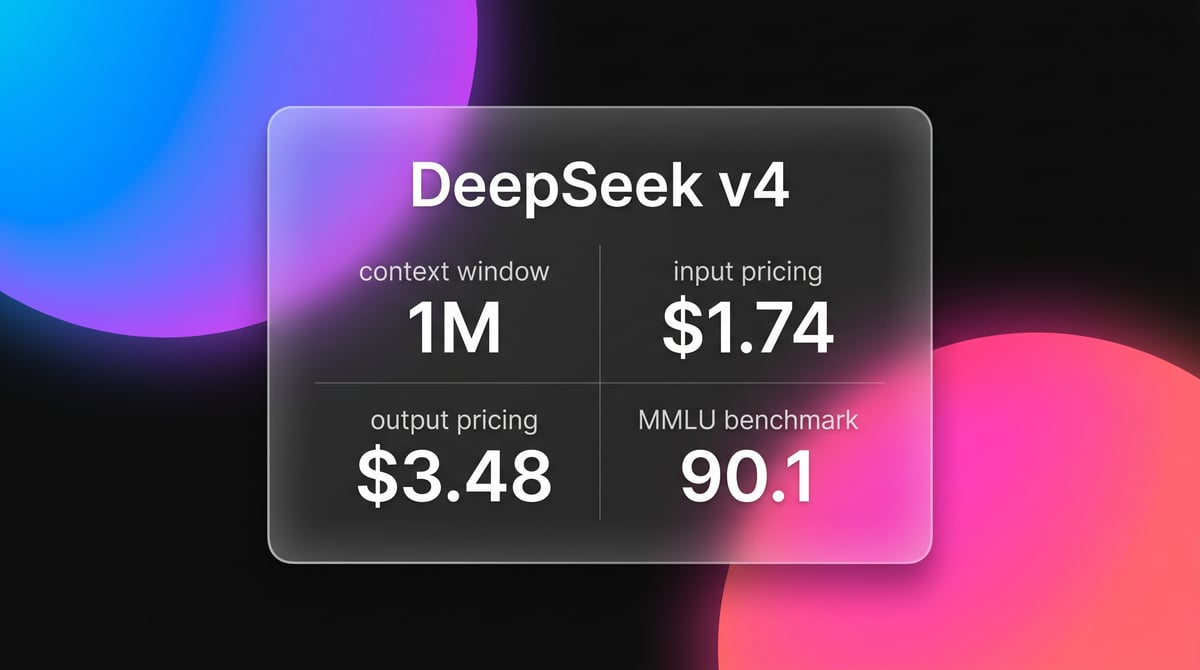

DeepSeek v4 คือ model ระดับ 1.6T parameters แบบ MoE มาพร้อม 1M context window และการรองรับ multimodal ทั้งข้อความ ภาพ และวิดีโอในราคาที่เปลี่ยนโฉมตลาด

เกี่ยวกับ DeepSeek v4

เรียนรู้เกี่ยวกับความสามารถของ DeepSeek v4 คุณสมบัติ และวิธีที่จะช่วยให้คุณได้ผลลัพธ์ที่ดีขึ้น

สถาปัตยกรรมระดับล้านล้าน parameters ที่มีประสิทธิภาพสูง

DeepSeek v4 คือวิวัฒนาการในการออกแบบ Mixture-of-Experts (MoE) โดยขยายขนาดถึง 1.6 ล้านล้าน parameters รวม และ 49 พันล้าน parameters ที่ทำงานอยู่จริง ตัว model ผสาน Compressed Sparse Attention (CSA) และ Heavily Compressed Attention (HCA) เพื่อจัดการกับ context window ขนาด 1 ล้าน tokens เทคโนโลยีเหล่านี้ช่วยลดภาระหน่วยความจำของ KV cache ลงได้ถึง 90% เมื่อเทียบกับสถาปัตยกรรมมาตรฐาน ช่วยให้ inference ได้เร็วขึ้นและใช้ฮาร์ดแวร์ต่ำลงสำหรับงานที่ต้องใช้ context ยาวๆ

การรวมระบบ Multimodal แบบ Native

แตกต่างจาก model อื่นที่ใช้ encoder แยกสำหรับภาพหรือเสียง DeepSeek v4 เป็น multimodal โดยธรรมชาติ ตั้งแต่ขั้นตอนการฝึกฝน ประมวลผลข้อความ ภาพ เสียง และวิดีโอภายในเฟรมเวิร์กเดียว แนวทางนี้ช่วยเพิ่มประสิทธิภาพในการใช้เหตุผลข้ามสื่อ (cross-modal reasoning) ทำให้ model สามารถวิเคราะห์ไฟล์วิดีโอดิบและคลังเอกสารขนาดใหญ่ได้อย่างละเอียดโดยไม่ตกหล่น

การเปลี่ยนแปลงด้านต้นทุนเชิงกลยุทธ์

model นี้ถูกวางตำแหน่งเป็นทางเลือก open-source ที่มีประสิทธิภาพสูงเทียบเท่า model ปิดระดับท็อป ด้วยราคา 1.74 ดอลลาร์ต่อล้าน input tokens ยังคงประสิทธิภาพระดับแนวหน้าทั้งในด้านการเขียนโปรแกรมและคณิตศาสตร์ พร้อมลดต้นทุนการดำเนินงานสำหรับนักพัฒนาได้อย่างมหาศาล การมีตัวเลือก Thinking Mode ยังช่วยให้สามารถใช้เหตุผลเชิงลึกสำหรับการพิสูจน์ทางตรรกะและการแข่งขันเขียนโปรแกรมได้อีกด้วย

กรณีการใช้งานสำหรับ DeepSeek v4

ค้นพบวิธีต่างๆ ที่คุณสามารถใช้ DeepSeek v4 เพื่อได้ผลลัพธ์ที่ยอดเยี่ยม

การ Refactor Codebase ขนาดใหญ่

ใช้ประโยชน์จาก 1M context window เพื่อนำ repository ทั้งหมดมาวิเคราะห์เพื่อตรวจหา bug และปรับปรุงสถาปัตยกรรมระดับองค์กร

การวิเคราะห์วิดีโอแบบ Native

ประมวลผลไฟล์วิดีโอดิบโดยตรงเพื่อตรวจจับฉาก, สร้าง transcript และใช้เหตุผลเชิงภาพที่ซับซ้อน

Agent ซอฟต์แวร์อัตโนมัติ

ปรับใช้ model ใน workflow แบบ agentic เพื่อแก้ไขปัญหาบน GitHub ด้วยอัตราความสำเร็จ 80.6% บน SWE-bench

การสร้างคอนเทนต์แบบ Multi-Modal

สร้างข้อมูลเชิงโครงสร้างและเนื้อหาเชิงสร้างสรรค์ผ่านรูปแบบข้อความ ภาพ และเสียงโดยใช้ model เดียว

การพิสูจน์ทางคณิตศาสตร์ขั้นสูง

แก้โจทย์คณิตศาสตร์ระดับโอลิมปิกและการพิสูจน์ทางทฤษฎีโดยใช้ Thinking Mode สำหรับการใช้เหตุผลเชิงลึก

การดึงข้อมูลองค์กร (Enterprise Knowledge Retrieval)

วิเคราะห์คลังเอกสารมหาศาลในการ prompt ครั้งเดียวเพื่อดึงข้อเท็จจริงโดยไม่จำเป็นต้องใช้ระบบ RAG ที่ซับซ้อน

จุดแข็ง

ข้อจำกัด

เริ่มต้นด่วน API

deepseek/deepseek-v4-pro

import OpenAI from 'openai'; const deepseek = new OpenAI({ baseURL: 'https://api.deepseek.com', apiKey: process.env.DEEPSEEK_API_KEY, }); const msg = await deepseek.chat.completions.create({ model: 'deepseek-v4-pro', messages: [{ role: 'user', content: 'Optimize this Rust kernel for memory efficiency.' }], }); console.log(msg.choices[0].message.content);ติดตั้ง SDK และเริ่มเรียก API ภายในไม่กี่นาที

ผู้คนพูดอะไรเกี่ยวกับ DeepSeek v4

ดูว่าชุมชนคิดอย่างไรเกี่ยวกับ DeepSeek v4

“โหมดการใช้เหตุผลของ DeepSeek v4 พบ bug เรื่อง concurrency ในโค้ด Rust ของผมที่แม้แต่ Claude Opus ยังพลาด ไปสุดจริงๆ”

“ยุคของ 1M context ที่คุ้มค่ามาถึงแล้ว เราสามารถรันการ refactor ทั้งโปรเจกต์ได้ในราคาแค่เศษเงิน”

“การได้เห็น model จัดการ codebase 1M tokens โดยที่ยังจำข้อมูลที่สำคัญได้ไม่หลุด นี่คือจุดเปลี่ยนที่แท้จริงของปี 2026”

“Anthropic และ OpenAI กำลังเจอปัญหาหนักเรื่องราคาแล้ว DeepSeek ทำให้ AI ระดับ frontier กลายเป็นสินค้าทั่วไปเรียบร้อย”

“มันชนะ GPT-5.4 ในด้าน coding benchmark ในขณะที่เป็น open source นี่คือการเปิดตัวที่ใหญ่ที่สุดแห่งปี”

“การบีบอัดหน่วยความจำคือเวทมนตร์ของจริง 1T parameters บนฮาร์ดแวร์ทั่วไปกำลังกลายเป็นจริงแล้ว”

วิดีโอเกี่ยวกับ DeepSeek v4

ดูบทเรียน รีวิว และการสนทนาเกี่ยวกับ DeepSeek v4

“ประสิทธิภาพหน่วยความจำคือหัวใจสำคัญ การลด KV cache ลง 90% เปลี่ยนทุกอย่าง”

“การรัน model ระดับ 1T ด้วยความเร็วขนาดนี้ถือเป็นชัยชนะทางสถาปัตยกรรมที่ยิ่งใหญ่”

“ต้นทุนต่อล้าน tokens ทำให้ startup ขนาดเล็กมองข้ามไม่ได้เลย”

“ผมไม่เคยเห็น open-source model จัดการ 1 ล้าน tokens ได้เนียนขนาดนี้มาก่อน”

“รู้สึกว่าช่องว่างระหว่าง open และ closed model ได้ถูกปิดลงอย่างเป็นทางการแล้ว”

“DeepSeek ไม่ได้แข่งแค่เรื่องราคาแล้ว แต่กำลังเป็นผู้นำด้าน long-context reasoning”

“การรองรับวิดีโอแบบ native นั้นแข็งแกร่งอย่างน่าประหลาดใจเมื่อเทียบกับ Gemini 2.0”

“การติดตั้งแบบ local นั้นทำได้ง่ายเกินคาดถ้าใช้ SGLang”

“ผลทดสอบบน HumanEval แสดงให้เห็นว่าเทียบเท่ากับ GPT-5 แล้ว”

“context window ขนาดนี้ทำให้ระบบ RAG แทบจะกลายเป็นเรื่องไม่จำเป็นสำหรับโปรเจกต์ขนาดกลาง”

“ประสิทธิภาพบน coding benchmark ในขณะนี้ยังไม่มี open-weight model อื่นใดเทียบได้”

“มันเทียบเท่าหรือเหนือกว่า closed model ระดับท็อปในงาน refactoring codebase ขนาดใหญ่”

“การปรับใช้ engram memory ถือเป็นความสำเร็จทางเทคนิคที่น่าทึ่งในพื้นที่นี้”

“เราเห็นความแม่นยำของตรรกะถึง 90% ใน Thinking Mode สำหรับคณิตศาสตร์ระดับโอลิมปิก”

“การปล่อยรุ่นนี้ทำให้ความฉลาดระดับล้านล้าน parameters กลายเป็นสิ่งที่ทุกคนเข้าถึงได้จริง”

เพิ่มพลังให้เวิร์กโฟลว์ของคุณด้วย ระบบอัตโนมัติ AI

Automatio รวมพลังของ AI agents การอัตโนมัติเว็บ และการผสานรวมอัจฉริยะเพื่อช่วยให้คุณทำงานได้มากขึ้นในเวลาน้อยลง

เคล็ดลับมือโปรสำหรับ DeepSeek v4

เคล็ดลับจากผู้เชี่ยวชาญเพื่อช่วยให้คุณใช้ประโยชน์สูงสุดจาก DeepSeek v4 และได้ผลลัพธ์ที่ดีขึ้น

สลับการใช้งานโหมด Thinking

ใช้โหมดมาตรฐานสำหรับการแชททั่วไป และใช้ Thinking Mode สำหรับงานเขียนโปรแกรมและการพิสูจน์ทางตรรกะโดยเฉพาะ

ใช้ประโยชน์จาก Context Caching

ใช้ฟีเจอร์ context caching ในตัวเพื่อลดค่าใช้จ่ายลงถึง 90% เมื่อใช้ long-context prompt แบบซ้ำๆ

การป้อนข้อมูล Multimodal โดยตรง

ส่งไฟล์เสียงและวิดีโอดิบเข้าสู่ API โดยตรงเพื่อใช้ประโยชน์จากสถาปัตยกรรมแบบ native แทนการแปลงข้อมูลก่อนส่ง

การปรับแต่ง System Prompt

ระบุ JSON schema หรือคำสั่งการใช้เครื่องมือให้ชัดเจนใน system prompt เพื่อการตอบสนองแบบ agentic ที่แม่นยำและน่าเชื่อถือ

คำรับรอง

ผู้ใช้ของเราพูดอย่างไร

เข้าร่วมกับผู้ใช้ที่พึงพอใจนับพันที่ได้เปลี่ยนแปลงเวิร์กโฟลว์ของพวกเขา

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

ที่เกี่ยวข้อง AI Models

Claude Sonnet 4.6

Anthropic

Claude Sonnet 4.6 offers frontier performance for coding and computer use with a massive 1M token context window for only $3/1M tokens.

Gemini 3 Flash

Gemini 3 Flash is Google's high-speed multimodal model featuring a 1M token context window, elite 90.4% GPQA reasoning, and autonomous browser automation tools.

Kimi k2.6

Moonshot

Kimi k2.6 is Moonshot AI's 1T-parameter MoE model featuring a 256K context window, native video input, and elite performance in autonomous agentic coding.

Claude Opus 4.6

Anthropic

Claude Opus 4.6 is Anthropic's flagship model featuring a 1M token context window, Adaptive Thinking, and world-class coding and reasoning performance.

Qwen3.5-397B-A17B

alibaba

Qwen3.5-397B-A17B is Alibaba's flagship open-weight MoE model. It features native multimodal reasoning, a 1M context window, and a 19x decoding throughput...

Gemini 3 Pro

Google's Gemini 3 Pro is a multimodal powerhouse featuring a 1M token context window, native video processing, and industry-leading reasoning performance.

GPT-5.1

OpenAI

GPT-5.1 is OpenAI’s advanced reasoning flagship featuring adaptive thinking, native multimodality, and state-of-the-art performance in math and technical...

Qwen 3.7 Max

alibaba

Qwen 3.7 Max is Alibaba’s flagship AI model for deep reasoning and autonomous agent tasks, featuring a 256k context window and top-tier coding performance.

คำถามที่พบบ่อยเกี่ยวกับ DeepSeek v4

ค้นหาคำตอบสำหรับคำถามทั่วไปเกี่ยวกับ DeepSeek v4