Qwen3.5-397B-A17B

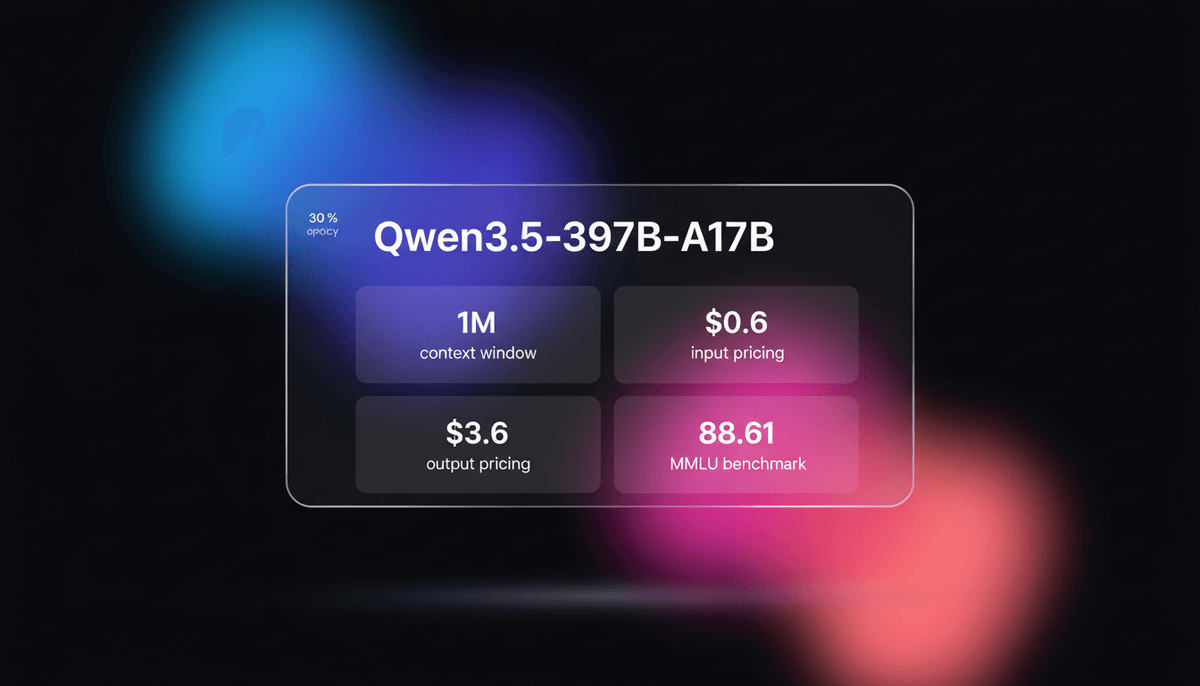

Qwen3.5-397B-A17B er Alibabas flagship open-weight MoE-model. Den indeholder indfødt multimodal reasoning, et 1M context window og 19x decoding throughput...

Om Qwen3.5-397B-A17B

Lær om Qwen3.5-397B-A17Bs muligheder, funktioner og hvordan den kan hjælpe dig med at opnå bedre resultater.

Mixture of Experts med høj effektivitet

Qwen3.5-397B-A17B er en flagship native multimodal model, der benytter en innovativ hybridarkitektur, som forener lineær opmærksomhed gennem Gated Delta Networks med en sparse Mixture-of-Experts (MoE). Selvom den indeholder 397 milliarder total parameters, aktiverer dens sparse design kun 17 milliarder parameters pr. forward pass, hvilket opnår enestående inferenseffektivitet og hastighed uden at gå på kompromis med dens omfattende reasoning-evner. Den er optimeret til både sprog- og visuelle opgaver, understøtter et massivt ordforråd på 250k tokens og yder understøttelse til over 201 sprog og dialekter.

Indfødte multimodale agentic workflows

Modellen udmærker sig som en indfødt multimodal agent, der er i stand til at behandle op til en million tokens context, hvilket svarer til cirka to timers video. Den introducerer en specialiseret Thinking Mode til kompleks logisk ræsonnement og er indfødt udstyret til agentic workflows, herunder webudvikling, GUI-navigation og spatial intelligens i den virkelige verden. Dens arkitektur understøtter FP8 end-to-end træning og et disaggregeret trænings-/inferens-framework, hvilket gør den til en af de mest skalerbare og effektive modeller til AI-applikationer i virksomhedsklassen.

Open weights for global tilgængelighed

Udgivet under Apache 2.0-licensen giver denne model open-source-miljøet adgang til frontier-niveau evner, der tidligere var begrænset til proprietære systemer. Den bygger bro mellem massive parameterantal og praktisk implementering, hvilket gør det muligt for organisationer at køre state-of-the-art reasoning-opgaver på privat infrastruktur med betydeligt lavere beregningsmæssige omkostninger end tætte 400B alternativer.

Anvendelser for Qwen3.5-397B-A17B

Opdag de forskellige måder, du kan bruge Qwen3.5-397B-A17B til at opnå gode resultater.

Videoanalyse med lang tidshorisont

Analyser op til to timers videoindhold for at udtrække logik, reverse-engineere kode fra optagelser eller generere strukturerede resuméer.

STEM-forskning på ph.d.-niveau

Løs videnskabelige problemer på ph.d.-niveau og matematiske opgaver på olympiade-niveau ved hjælp af dens adaptive deep-thinking mode.

Autonome GUI-agenter

Automatiser interaktioner med smartphones og computere for at håndtere kontorarbejdsgange og navigation mellem apps på mobilen.

Visuel softwareudvikling

Udfør 'vibe coding' ved at omdanne instruktioner i naturligt sprog og UI-skitser til funktionel frontend-kode.

Dokument-intelligens

Behandl komplekse dokumenter, diagrammer og håndskrevne skitser for at udtrække struktureret data og reverse-engineere layouts.

Spatial AI-applikationer

Forstå pixel-niveau relationer til embodied AI-opgaver såsom analyse af scener fra selvkørende biler og robotnavigation.

Styrker

Begrænsninger

API hurtig start

alibaba/qwen3.5-plus

import OpenAI from 'openai';

const client = new OpenAI({

apiKey: process.env.DASHSCOPE_API_KEY,

baseURL: 'https://dashscope-intl.aliyuncs.com/compatible-mode/v1',

});

async function main() {

const completion = await client.chat.completions.create({

model: 'qwen3.5-plus',

messages: [{ role: 'user', content: 'Analyser logikken i denne MoE-arkitektur.' }],

extra_body: { enable_thinking: true },

});

console.log(completion.choices[0].message.content);

}

main();Installér SDK'et og begynd at foretage API-kald på få minutter.

Hvad folk siger om Qwen3.5-397B-A17B

Se hvad fællesskabet mener om Qwen3.5-397B-A17B

“Qwen3.5-397B er i bund og grund en GPT-5 klasse model, men open-weight. DeltaNet-arkitekturen løser MoE-latensproblemer perfekt.”

“Indfødt multimodal reasoning på Qwen3.5 ser utrolig ud. 1M context + videoanalyse kommer til at ændre agent-workflows.”

“Beslutningen om at bruge FP8 end-to-end træning, mens BF16 opretholdes i følsomme lag, er en mesterklasse i stabilitetsoptimeringer.”

“Dette er første gang, jeg har set en åben model rent faktisk slå Gemini 1.5 Pro i komplekse multimodale agent-opgaver.”

“Den 19x forbedring i decoding throughput over Qwen3-Max gør denne til et levedygtigt alternativ for agenter på produktionsniveau.”

“Jeg var overrasket over, hvor godt den håndterer 4-bit kvantisering. Den bevarer næsten alle sine reasoning-evner på et dual A100 setup.”

Videoer om Qwen3.5-397B-A17B

Se vejledninger, anmeldelser og diskussioner om Qwen3.5-397B-A17B

“En model med 397 milliarder parameters, men med 17 milliarder parameters aktive.”

“Ved decoding på 256K er denne model 19 gange hurtigere end Qwen 3 Max.”

“Den indfødte vision-language reasoning er det, der gør den unik til agentic workflows.”

“Denne slår de fleste lukkede modeller på standard matematiske benchmarks.”

“Det er hårdt at køre denne lokalt, men de kvantiserede versioner kan bruges på high-end Macs.”

“Model med 397 milliarder parameters og 17 milliarder aktive parameters. Den er indfødt multimodal.”

“Det er sandsynligvis den bedste open-source multimodale model lige nu.”

“Evnen til at behandle to timers video indfødt er en kæmpe fordel.”

“Se på disse logik-scores, den rammer konsekvent GPT-4o niveauer.”

“Apache-licensen gør den meget attraktiv for virksomheders databeskyttelse.”

“Struktureret OCR-udtræk. Du har en rodet PDF... og du skal omdanne den til ren JSON. Denne model er fremragende til det.”

“Du får intelligensen fra en kæmpe på 400 milliarder parameters... men betaler beregningsomkostningerne for en model på 17 milliarder parameters.”

“Den håndterer long-context retrieval bedre end den forrige version.”

“Integrationen af tool use er bygget ind i grundtræningen, ikke en eftertanke.”

“Thinking mode giver den mulighed for at rette sin egen logik før output.”

Supercharg din arbejdsgang med AI-automatisering

Automatio kombinerer kraften fra AI-agenter, webautomatisering og smarte integrationer for at hjælpe dig med at udrette mere på kortere tid.

Pro-tips til Qwen3.5-397B-A17B

Eksperttips til at hjælpe dig med at få mest muligt ud af Qwen3.5-397B-A17B og opnå bedre resultater.

Slå Thinking Mode til

Send parameteren 'enable_thinking: true' i dit API-kald for at aktivere dyb reasoning til matematik, kodning og komplekse logiske gåder.

Brug Fast Mode

Brug 'Fast'-mode til simple forespørgsler for at få øjeblikkelige svar uden at forbruge tokens på unødvendige interne tænkefaser.

Optimer video-prompts

Når du analyserer video, så bed modellen om at fokusere på det endelige dynamiske resultat frem for frame-for-frame analyse for bedre tidsmæssig sammenhæng.

Udnyt kvantisering

Brug 4-bit eller 8-bit kvantisering (GGUF/EXL2) til at køre modellen på hardware til forbrugere, hvis du har tilstrækkelig VRAM (200GB+).

Anmeldelser

Hvad vores brugere siger

Slut dig til tusindvis af tilfredse brugere, der har transformeret deres arbejdsgang

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Relateret AI Models

GPT-5.1

OpenAI

GPT-5.1 is OpenAI’s advanced reasoning flagship featuring adaptive thinking, native multimodality, and state-of-the-art performance in math and technical...

Kimi K2.5

Moonshot

Discover Moonshot AI's Kimi K2.5, a 1T-parameter open-source agentic model featuring native multimodal capabilities, a 262K context window, and SOTA reasoning.

Grok-4

xAI

Grok-4 by xAI is a frontier model featuring a 2M token context window, real-time X platform integration, and world-record reasoning capabilities.

Claude Opus 4.5

Anthropic

Claude Opus 4.5 is Anthropic's most powerful frontier model, delivering record-breaking 80.9% SWE-bench performance and advanced autonomous agency for coding.

Gemini 3.1 Flash-Lite

Gemini 3.1 Flash-Lite is Google's fastest, most cost-efficient model. Features 1M context, native multimodality, and 363 tokens/sec speed for scale.

Claude Sonnet 4.6

Anthropic

Claude Sonnet 4.6 offers frontier performance for coding and computer use with a massive 1M token context window for only $3/1M tokens.

DeepSeek v4

DeepSeek

DeepSeek v4 is a 1.6T parameter MoE model featuring a 1M token context window and native multimodal support for text, vision, and video at disruptive prices.

Gemini 3 Flash

Gemini 3 Flash is Google's high-speed multimodal model featuring a 1M token context window, elite 90.4% GPQA reasoning, and autonomous browser automation tools.

Ofte stillede spørgsmål om Qwen3.5-397B-A17B

Find svar på almindelige spørgsmål om Qwen3.5-397B-A17B