Qwen3.6-Max-Preview

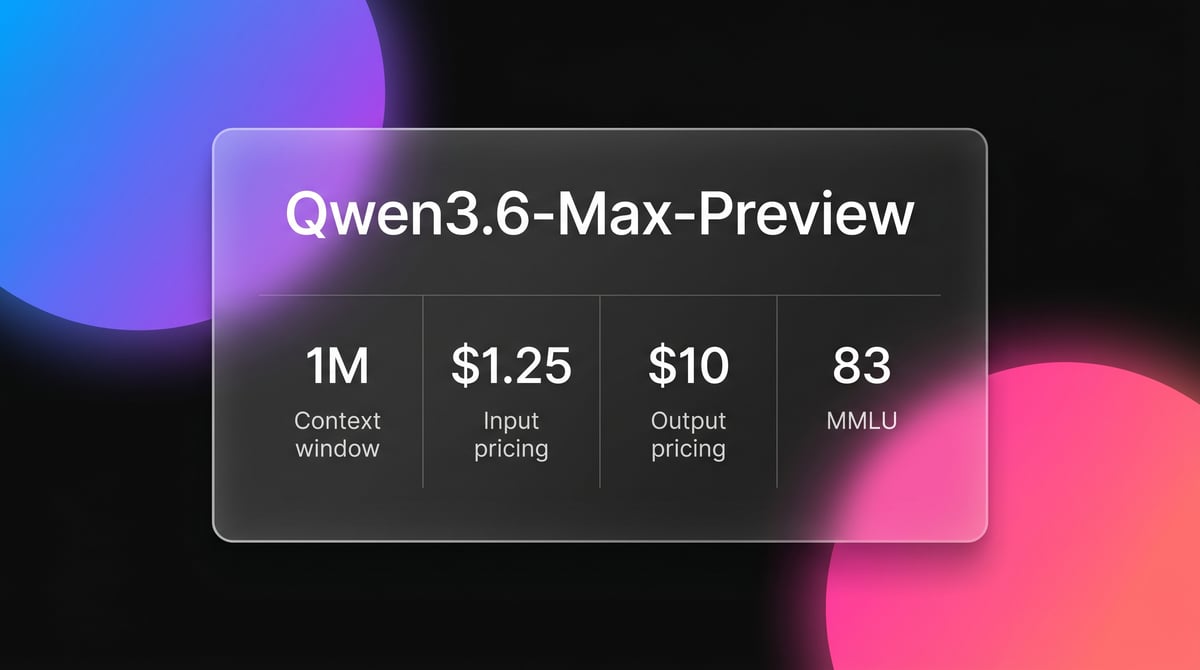

Qwen3.6-Max-Preview er Alibabas flagship MoE-model med 1M context, indbygget thinking mode og top-scores inden for agentic coding og ræsonnering.

Om Qwen3.6-Max-Preview

Lær om Qwen3.6-Max-Previews muligheder, funktioner og hvordan den kan hjælpe dig med at opnå bedre resultater.

Qwen3.6-Max-Preview er den proprietære flagship LLM fra Alibaba, som repræsenterer det næste skridt i deres serie af højtydende AI. Ved hjælp af en sparsom Mixture-of-Experts (MoE)-arkitektur opnår modellen den ræsonneringsdybde, man forventer af et system med billioner af parametre, samtidig med at den bevarer en høj driftseffektivitet. Den er specifikt optimeret til agentic coding, verdensviden og kompleks instruktionsfølgning.

Modellens mest fremtrædende egenskab er dens indbyggede Thinking Mode, som gør det muligt for systemet at generere en synlig intern chain-of-thought, før det leverer et endeligt svar. Denne gennemsigtighed er særligt værdifuld for udviklere, der bygger autonome agenter, da det giver et klart indblik i logisk planlægning og trin til fejlretning. Kombineret med et massivt 1-million-token context window kan modellen indlæse hele projekt-repositories eller omfattende dokumentationsbiblioteker i én arbejdsgang.

Qwen3.6-Max-Preview hostes på Alibaba Cloud Model Studio, understøtter industristandard-protokoller og er kompatibel med OpenAI-API-specifikationer. Den er designet til at være det primære valg for virksomheder, der kræver AI-kapaciteter på frontier-niveau til multimodal dataanalyse og robuste agentic-workflows, og tilbyder et højtydende alternativ til vestlige proprietære modeller.

Anvendelser for Qwen3.6-Max-Preview

Opdag de forskellige måder, du kan bruge Qwen3.6-Max-Preview til at opnå gode resultater.

Autonom softwareudvikling

Implementér modellen som en kode-agent, der kan navigere i hele kodebaser, planlægge arkitektoniske ændringer og rette fejl på tværs af flere filer.

Teknisk analyse i stor skala

Udnyt 1M token context window til at indlæse komplette dokumentationssæt eller juridiske rammeværker til dybdegående analyser uden RAG-begrænsninger.

Kompleks ræsonnering og planlægning

Udnyt den indbyggede Thinking Mode til at løse komplekse matematiske problemer, hvor en intern plan i flere trin er påkrævet for at sikre nøjagtighed.

Multimodal indholdsforståelse

Analysér både statiske billeder og komplekse videosekvenser for at udtrække data og opsummere dynamiske visuelle begivenheder.

Interaktive terminaloperationer

Byg værktøjer, der lader AI'en interagere direkte med shells og CLI-miljøer, hvilket drager fordel af dens optimerede Terminal-Bench-performance.

Enterprise agentic-workflows

Integrér modellen i komplekse forretnings-pipelines, hvor høj instruktionspålidelighed og sofistikeret tool-calling er påkrævet til automatisering.

Styrker

Begrænsninger

API hurtig start

alibaba/qwen3.6-max-preview

import OpenAI from 'openai';

const client = new OpenAI({

apiKey: process.env.DASHSCOPE_API_KEY,

base_url: 'https://dashscope-intl.aliyuncs.com/compatible-mode/v1',

});

async function main() {

const completion = await client.chat.completions.create({

model: 'qwen3.6-max-preview',

messages: [{ role: 'user', content: 'Design a system architecture for a real-time AI agent.' }],

extra_body: { enable_thinking: true },

stream: true

});

for await (const chunk of completion) {

process.stdout.write(chunk.choices[0]?.delta?.content || '');

}

}

main();Installér SDK'et og begynd at foretage API-kald på få minutter.

Hvad folk siger om Qwen3.6-Max-Preview

Se hvad fællesskabet mener om Qwen3.6-Max-Preview

“Den form for performance, man ville forvente fra en model, der kører på en massiv serverfarm, sidder nu på dit skrivebord.”

“Qwen3.6-Max-Preview har lige slået Claude Opus 4.5 på SWE-Bench Pro. Kina indhenter det forsømte hurtigt.”

“Til $1,25 pr. million tokens er Qwen betydeligt billigere end Claude til dataindlæsning i stor skala.”

“At Thinking Mode er indbygget som standard er et meningsfuldt designvalg for agentic-pålidelighed.”

“Qwen har lanceret Qwen 3.6 Max Preview som en ny proprietær top-model.”

“Den viser forbedret agentic coding og bedre driftssikkerhed for agenter i den virkelige verden sammenlignet med Plus-modellen.”

Videoer om Qwen3.6-Max-Preview

Se vejledninger, anmeldelser og diskussioner om Qwen3.6-Max-Preview

“Qwen har lanceret Qwen 3.6 Max Preview som en ny proprietær top-model.”

“Modellen viser et stærkt spring i benchmarks for kode-agenter som SkillsBench og Terminal-Bench 2.0.”

“Qwen forsøger tydeligvis for alvor at konkurrere i high-end segmentet mod modeller som Claude 4.5 Opus.”

“Denne model repræsenterer en væsentlig forbedring inden for verdensviden og instruktionsfølgning.”

“Performance-springet på SWE-bench er det, der virkelig adskiller denne fra Plus-varianten.”

“Benchmark-historien handler i virkeligheden om at positionere den hostede Max Preview som noget unikt i forhold til familien af open-weight modeller.”

“Vi bruger Qwen Code-sider og repo-flader til at vurdere økosystemets dybde ud over blot modellens vægte.”

“Thinking mode er overraskende hurtig sammenlignet med o1-lignende modeller fra sidste år.”

“Denne er tydeligvis designet til enterprise-udviklere, der har brug for et pålideligt API til agentic-opgaver.”

“Den multimodale vision-performance er ved at indhente Gemini 2 i visse dokumentanalysetests.”

“Denne video introducerer Qwen3.6-Max-Preview, et tidligt kig på den næste flagship-model fra Qwen.”

“Den viser forbedret agentic coding og bedre driftssikkerhed for agenter i den virkelige verden sammenlignet med Plus-modellen.”

“1M context window er langt mere stabilt end det, vi så i de tidlige Qwen 2-versioner.”

“Hvis du koder meget, er Qwen 3.6 Max i øjeblikket benchmark-førende.”

“Prissætningen er fortsat meget konkurrencedygtig, selv for deres proprietære flagship-model.”

Supercharg din arbejdsgang med AI-automatisering

Automatio kombinerer kraften fra AI-agenter, webautomatisering og smarte integrationer for at hjælpe dig med at udrette mere på kortere tid.

Pro-tips til Qwen3.6-Max-Preview

Eksperttips til at hjælpe dig med at få mest muligt ud af Qwen3.6-Max-Preview og opnå bedre resultater.

Aktivér intern ræsonnering

Indstil 'enable_thinking'-parameteren til true i din API-forespørgsel for at se modellens interne logik til debugging af komplekse ræsonnementer.

Bevar logik over lange forløb

Brug 'preserve_thinking'-funktionen til samtaler med flere interaktioner for at sikre, at modellen opretholder logisk konsistens gennem hele sessionen.

Indlæs hele biblioteker

Udnyt det 1M context window ved at levere komplette kildematerialer frem for opdelte data for at opnå en bedre forståelse på tværs af filer.

Brug kompatible endpoints

Til globale applikationer bør du bruge Singapore- eller US Virginia-endpoints i Alibaba Cloud for at minimere regional latency for internationale brugere.

Anmeldelser

Hvad vores brugere siger

Slut dig til tusindvis af tilfredse brugere, der har transformeret deres arbejdsgang

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Relateret AI Models

GLM-5

Zhipu (GLM)

GLM-5 is Zhipu AI's 744B parameter open-weight powerhouse, excelling in long-horizon agentic tasks, coding, and factual accuracy with a 200k context window.

GLM-5.1

Zhipu (GLM)

GLM-5.1 is Zhipu AI's flagship reasoning model, featuring a 202K context window and an autonomous 8-hour execution loop for complex agentic engineering.

GPT-5.2

OpenAI

GPT-5.2 is OpenAI's flagship model for professional tasks, featuring a 400K context window, elite coding, and deep multi-step reasoning capabilities.

Gemini 3.1 Flash-Lite

Gemini 3.1 Flash-Lite is Google's fastest, most cost-efficient model. Features 1M context, native multimodality, and 363 tokens/sec speed for scale.

Claude Opus 4.5

Anthropic

Claude Opus 4.5 is Anthropic's most powerful frontier model, delivering record-breaking 80.9% SWE-bench performance and advanced autonomous agency for coding.

Grok-4

xAI

Grok-4 by xAI is a frontier model featuring a 2M token context window, real-time X platform integration, and world-record reasoning capabilities.

Kimi K2 Thinking

Moonshot

Kimi K2 Thinking is Moonshot AI's trillion-parameter reasoning model. It outperforms GPT-5 on HLE and supports 300 sequential tool calls autonomously for...

Kimi K2.5

Moonshot

Discover Moonshot AI's Kimi K2.5, a 1T-parameter open-source agentic model featuring native multimodal capabilities, a 262K context window, and SOTA reasoning.

Ofte stillede spørgsmål om Qwen3.6-Max-Preview

Find svar på almindelige spørgsmål om Qwen3.6-Max-Preview