Claude Opus 4.7

Claude Opus 4.7 ist das flagship model von Anthropic mit einem 1-Million-token context, adaptivem reasoning und 3,3-facher Vision-Auflösung für...

Über Claude Opus 4.7

Erfahren Sie mehr über die Fähigkeiten, Funktionen und Einsatzmöglichkeiten von Claude Opus 4.7.

Modell-Übersicht

Claude Opus 4.7 ist das flagship model in der Claude 4-Architekturserie. Es verwendet ein Adaptive Thinking-Framework, das es dem model ermöglicht, seinen kognitiven Aufwand basierend auf der wahrgenommenen Schwierigkeit einer Aufgabe zu skalieren. Dies ersetzt feste reasoning-Budgets durch dynamische logische Ebenen. Entwickler können nun die interne reasoning-Tiefe über einen API-Aufwandsparameter steuern, was ein besseres Gleichgewicht zwischen latency und logischer Strenge ermöglicht. Das model ist speziell auf anspruchsvolle Enterprise-Workflows und autonome agentic loops abgestimmt.

Context- und multimodale Fähigkeiten

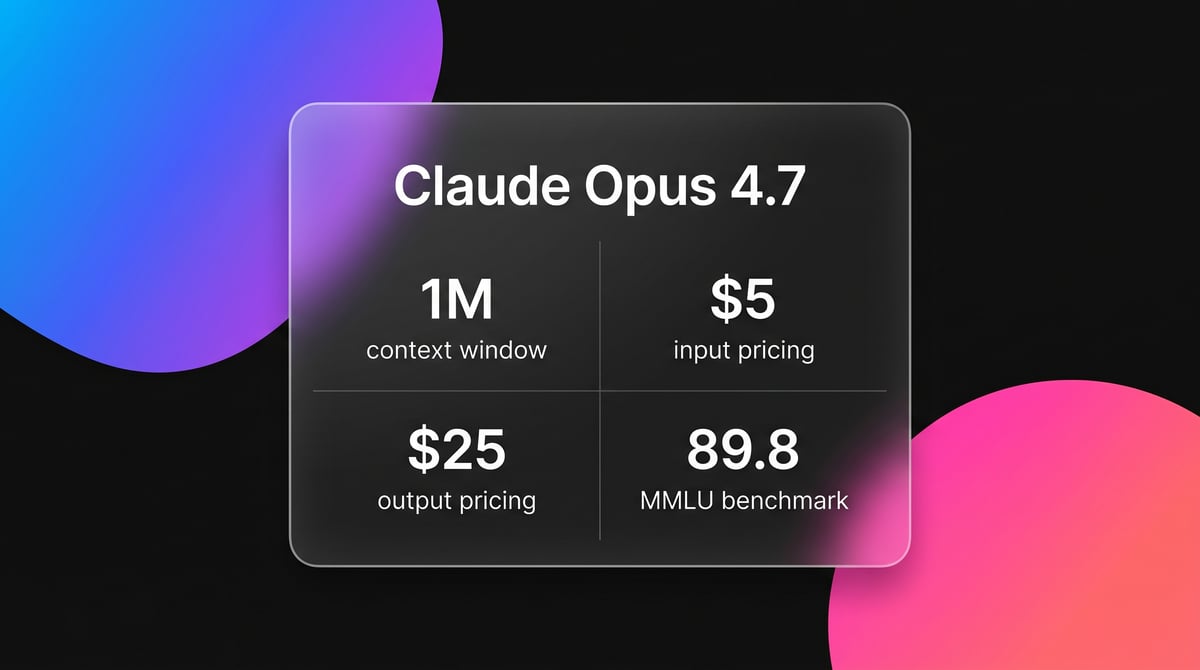

Dieses model bietet ein 1-Million-token context window ohne Aufpreis für long-context. Es enthält ein 128.000-token-Ausgabelimit, das die Generierung umfangreicher technischer Dokumente oder vollständiger Code-Repositories in einer Antwort ermöglicht. Die Vision-Auflösung ist 3,3-mal höher als bei früheren Iterationen. Dies ermöglicht pixelperfektes UI-Verständnis und ein 1:1-Koordinaten-Mapping in Bildern bis zu 2576 Pixeln. Diese Verbesserungen machen es zu einer zuverlässigen Wahl für Dokumentenanalyse und visuelle Auditing-Aufgaben.

Agentic Engineering und Sicherheit

Architektonische Updates zielen auf langfristige Aufgaben und Software Engineering ab. Es erreicht 87,6 % auf der SWE-bench Verified-Bestenliste und ist derzeit führend in der Fähigkeit, reale GitHub-Issues zu lösen. Das model führt Aufgabenbudgets ein, um den token-Verbrauch über agentic Sessions hinweg zu verwalten. Anthropic hat Echtzeit-Sicherheitsvorkehrungen für die Cybersicherheit in die Kernarchitektur integriert, um zu verhindern, dass das model an böswilligen Exploits teilnimmt, während es gleichzeitig nützlich für Sicherheitsforscher bleibt.

Anwendungsfälle für Claude Opus 4.7

Entdecken Sie die verschiedenen Möglichkeiten, Claude Opus 4.7 für großartige Ergebnisse zu nutzen.

Agentic Software Engineering

Nutzung hoher Aufwandsstufen zur autonomen Refaktorisierung von Repositories und Lösung komplexer dateiübergreifender Abhängigkeiten.

Synthese umfangreicher Repositories

Verarbeitung von 1 Million tokens an Quellcode, um architektonische Abläufe abzubilden und technische Dokumentationen zu generieren.

Hochauflösende Vision-Analyse

Analyse komplexer Diagramme und pixelgenauer UI-Screenshots mit 3,3-facher Detailtiefe gegenüber früheren frontier modellen.

Cybersecurity-Schwachstellenforschung

Durchführung tiefgreifender Sicherheitsaudits und Zero-Day-Analysen innerhalb verifizierter Sicherheitsgrenzen.

Enterprise Knowledge Extraction

Extraktion strukturierter Daten aus riesigen technischen Bibliotheken und Durchführung komplexer, dokumentübergreifender Analysen.

Interaktives 3D-Prototyping

Generierung funktionaler 3D-Umgebungen und Spiellogik aus natürlichsprachlichen Beschreibungen.

Stärken

Einschränkungen

API-Schnellstart

anthropic/claude-opus-4-7

import Anthropic from '@anthropic-ai/sdk';

const anthropic = new Anthropic({

apiKey: process.env.ANTHROPIC_API_KEY,

});

const msg = await anthropic.messages.create({

model: "claude-opus-4-7",

max_tokens: 4096,

thinking: { type: "adaptive" },

messages: [{ role: "user", content: "Analyze this architecture for concurrency bugs." }],

});

console.log(msg.content[0].text);Installieren Sie das SDK und beginnen Sie in wenigen Minuten mit API-Aufrufen.

Was die Leute über Claude Opus 4.7 sagen

Sehen Sie, was die Community über Claude Opus 4.7 denkt

“Claude Opus 4.7 führt bei SWE-bench und agentic reasoning und schlägt GPT-5.4 sowie Gemini 3.1 Pro.”

“Dass es in einem Durchgang ein prozedurales 3D-Skate-Spiel generieren kann, beweist die logische Dichte des modells.”

“Opus 4.7 wurde gerade veröffentlicht. cursorbench sprang von 58 % auf 70 %. XBOW visuelle Präzision 98,5 % gegenüber 54,5 % bei Opus 4.6.”

“Claude neigt zum Over-Engineering: Man bittet um eine einfache Funktion und erhält eine Architektur, die für das nächste Jahrzehnt skalieren soll.”

“Erste Rückmeldungen zu Claude Opus 4.7 deuten auf einen höheren token-Verbrauch und strengere prompting-Anforderungen hin.”

“Der X-High reasoning-Aufwand ist der fehlende Mittelweg, den wir für komplexe agentic Workflows brauchten.”

Videos über Claude Opus 4.7

Schauen Sie Tutorials, Rezensionen und Diskussionen über Claude Opus 4.7

“Claude war und ist immer noch das beste Modell für Zitate, das heute verfügbar ist.”

“Es kostet tatsächlich dasselbe wie zuvor, aber man hat jetzt mehr Kontrolle über das reasoning.”

“Das funktioniert einwandfrei. Es hat die Werkzeuge ausgewählt, die ich selbst gewählt hätte.”

“Das model fühlt sich spürbar schneller an, wenn man nicht die höchsten thinking-Stufen nutzt.”

“Man sieht, wie es über Edge Cases nachdenkt, bevor es überhaupt eine Zeile Code schreibt.”

“Dieses model ist in der Anwendung viel teurer... man zahlt 35 % mehr für Opus 4.7.”

“Allein das Vision-Upgrade lohnt sich... es kann Bilder mit dreifacher Auflösung ohne Zuschneiden verarbeiten.”

“Wenn Sie die API nutzen, müssen Sie mit 35 % höheren Kosten als zuvor rechnen.”

“Die Änderung der Tokenisierung ist der stille Killer für Ihre API-Rechnungen, wenn Sie nicht aufpassen.”

“Es geht mit tiefem context viel besser um als die frühere Version von Opus 4.”

“Die Vision-Fähigkeiten dieses modells sind wesentlich besser.”

“Der X-High reasoning-Aufwand ist der fehlende Mittelweg, den wir für komplexe agentic Workflows brauchten.”

“Das verdient absolut zu 100 % einen verrückten Titel. Das hat mich wirklich umgehauen.”

“Es hat einen Fehler in meiner Legacy-Codebasis korrekt identifiziert, den drei andere modelle übersehen haben.”

“Das Maß an Autonomie in den Agent-Loops unterscheidet dies von GPT-5.”

Optimieren Sie Ihren Workflow mit KI-Automatisierung

Automatio kombiniert die Kraft von KI-Agenten, Web-Automatisierung und intelligenten Integrationen, um Ihnen zu helfen, mehr in weniger Zeit zu erreichen.

Pro-Tipps für Claude Opus 4.7

Expertentipps, um das Beste aus Claude Opus 4.7 herauszuholen.

Adaptive Thinking aktivieren

Aktivieren Sie explizit den Adaptive Thinking-Modus in API-Aufrufen, damit Claude die optimale reasoning-Tiefe auswählt.

X-High für Agents verwenden

Setzen Sie den effort-parameter für agentic loops auf xhigh, um die Selbstprüfung und logische Präzision zu maximieren.

Scaffolding entfernen

Entfernen Sie veraltete prompts wie „überprüfen Sie Ihre Arbeit erneut“, da das model auf interne Selbstkorrektur optimiert ist.

Token-Verbrauch überwachen

Verwenden Sie das neue tokenizer-Tracking, um den Anstieg der token-Anzahl um 35 % bei identischen Texteingaben zu verwalten.

Erfahrungsberichte

Was Unsere Nutzer Sagen

Schliessen Sie sich Tausenden zufriedener Nutzer an, die ihren Workflow transformiert haben

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Verwandte AI Models

Gemini 3.1 Pro

Gemini 3.1 Pro is Google's elite multimodal model featuring the DeepThink reasoning engine, a 1M+ context window, and industry-leading ARC-AGI logic scores.

Gemini 3.1 Flash Live Preview

Gemini 3.1 Flash Live Preview is Google's ultra-low-latency, audio-to-audio model featuring a 131K context window, high-fidelity multimodal reasoning, and...

GPT-5.5

OpenAI

GPT-5.5 is OpenAI's flagship frontier model with a 1M context window and five reasoning effort levels, optimized for autonomous agentic workflows and coding.

Grok-3

xAI

Grok-3 is xAI's flagship reasoning model, featuring deep logic deduction, a 128k context window, and real-time integration with X for live research and coding.

GPT-5.2 Pro

OpenAI

GPT-5.2 Pro is OpenAI's 2025 flagship reasoning model featuring Extended Thinking for SOTA performance in mathematics, coding, and expert knowledge work.

Qwen 3.7 Max

alibaba

Qwen 3.7 Max is Alibaba’s flagship AI model for deep reasoning and autonomous agent tasks, featuring a 256k context window and top-tier coding performance.

Gemini 3 Pro

Google's Gemini 3 Pro is a multimodal powerhouse featuring a 1M token context window, native video processing, and industry-leading reasoning performance.

Claude Opus 4.6

Anthropic

Claude Opus 4.6 is Anthropic's flagship model featuring a 1M token context window, Adaptive Thinking, and world-class coding and reasoning performance.

Häufig gestellte Fragen zu Claude Opus 4.7

Finden Sie Antworten auf häufige Fragen zu Claude Opus 4.7