GPT-5.2

GPT-5.2 ist das flagship-Modell von OpenAI für professionelle Aufgaben, mit 400K context window, Elite-Coding und tiefgreifenden mehrstufigen...

Über GPT-5.2

Erfahren Sie mehr über die Fähigkeiten, Funktionen und Einsatzmöglichkeiten von GPT-5.2.

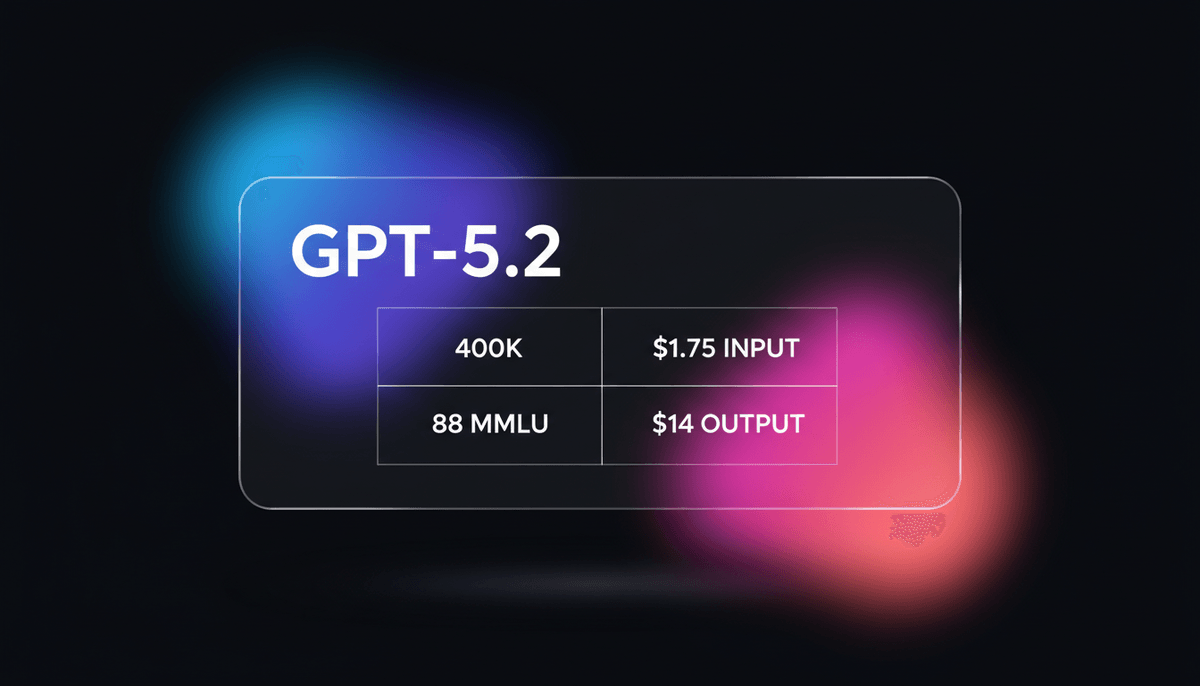

GPT-5.2 ist das flagship Reasoning-Modell von OpenAI, konzipiert für anspruchsvolle professionelle Wissensarbeit und autonomes Engineering. Es wurde am 11. Dezember 2025 veröffentlicht und stellt eine bedeutende Weiterentwicklung der GPT-4- und GPT-o1-Serien dar, indem es einen dedizierten Thinking-Modus mit Effort-Steuerung (Medium, High, Extra High) integriert. Dies ermöglicht es dem Modell, innezuhalten und mehrstufige Logik zu verifizieren, bevor eine Antwort generiert wird.

Mit einem massiven 400K context window und nahezu 100 % Abrufgenauigkeit ist es für Senior-Code-Reviews, komplexe Refactorings und wissenschaftliche Forschung ausgelegt. Die Modellarchitektur unterstützt agentic Workflows und verfügt über native Tool-Calling-Fähigkeiten sowie multimodales Vision, das komplexe technische Diagramme und Codebases gleichzeitig verarbeiten kann.

Während es bei logischer Präzision und Engineering-benchmarks glänzt – mit einem 100 %-Ergebnis im AIME 2025 –, wirkt der Tonfall formaler und maschinenähnlicher als bei Wettbewerbern wie Claude. Es kostet derzeit 1,75 $ pro Million Input-tokens und 14,00 $ pro Million Output-tokens und ist damit eine kosteneffiziente Alternative für Deep-Reasoning-Aufgaben, die bisher ein hohes Maß an menschlicher Überwachung erforderten.

Anwendungsfälle für GPT-5.2

Entdecken Sie die verschiedenen Möglichkeiten, GPT-5.2 für großartige Ergebnisse zu nutzen.

Komplexe Engineering-Refactorings

Durchführung tiefgreifender Refactorings in performancekritischen Codebases unter Beibehaltung strenger Typ-Invarianten und architektonischer Konsistenz.

Autonome Terminal-Aufgaben

Ausführung mehrstufiger CLI-Workflows und Verwaltung komplexer Cloud-Deployments durch hohe Performance in Terminal-Bench-Umgebungen.

Wissenssynthese auf PhD-Niveau

Gleichzeitige Analyse hunderter technischer Quellen und wissenschaftlicher Arbeiten zur Erstellung umfassender Forschungsberichte zu Nischenthemen.

Lösung von Concurrency-Bugs

Identifizierung und Behebung subtiler Race Conditions oder Speicherlecks, die ein hohes Maß an logischem Reasoning über lange Codeabschnitte erfordern.

Mechanische Code-Verarbeitung

Bewältigung großflächiger, repetitiver Code-Migrationen über komplette Repositories hinweg, ohne die bei allgemeinen LLMs oft beobachtete Trägheit.

Senior Technical Review

Einsatz als virtueller Senior Engineer zur Überprüfung von Designplänen und Identifizierung von Edge Cases in der Logik von Produktionssystemen.

Stärken

Einschränkungen

API-Schnellstart

openai/gpt-5.2

import OpenAI from 'openai';

const openai = new OpenAI();

async function solveCodeProblem() {

const response = await openai.chat.completions.create({

model: 'gpt-5.2',

messages: [{ role: 'user', content: 'Debug this race condition in my Rust service.' }],

reasoning_effort: 'high',

temperature: 0,

});

console.log(response.choices[0].message.content);

}

solveCodeProblem();Installieren Sie das SDK und beginnen Sie in wenigen Minuten mit API-Aufrufen.

Was die Leute über GPT-5.2 sagen

Sehen Sie, was die Community über GPT-5.2 denkt

“GPT 5.2 in Codex ist eine riesige Verbesserung; es ist eher bereit, diese mechanischen Aufgaben zu übernehmen, bei denen Modelle sonst faul werden.”

“Die verstärkten Überlegungen und die Zeit, die in die Überprüfung der Ergebnisse fließt, sind lobenswert... die Zuverlässigkeit ist deutlich verbessert.”

“Das Modell für tiefe Recherchen zeigte einen menschlichen Ansatz, indem es bei Bedarf gezielt nach spezialisierten Informationen suchte.”

“OpenAIs Fokus auf strukturierte 'Nutzerbetreuung' fühlt sich im Vergleich zu den natürlichen Diskussionen mit Claude wie eine Unternehmensmaske für einen kalten Kern an.”

“Endlich ein Modell, das bei einem 500-Zeilen-Refactoring nicht mitten drin faul wird.”

“Der reasoning_effort-parameter ist der MVP für komplexe Logikprobleme.”

Videos über GPT-5.2

Schauen Sie Tutorials, Rezensionen und Diskussionen über GPT-5.2

“Das ist wirklich der Wahnsinn. Schaut euch diesen One-Shot an.”

“Vom Design bei GPT 5.2 bin ich nicht so beeindruckt... es war deutlich schlechter als Gemini 3.”

“Der Kontext-Abruf ist über den gesamten 400k-Bereich nahezu perfekt.”

“Es fühlt sich viel mehr wie eine Reasoning-Engine an als wie ein Chatbot.”

“Die Latency ist für einige Echtzeit-Apps der einzige echte Dealbreaker.”

“GPT 5.2 kann jetzt vollständig formatierte Tabellen und Foliensätze direkt in ChatGPT erstellen.”

“Es wirkt, als wäre das Modell endlich erwachsen geworden und nähme seinen Job ernst.”

“Nutzen Sie die hohe Reasoning-Einstellung nur für logikintensive Aufgaben.”

“Die Halluzinationen sind im Vergleich zur 4o-Serie deutlich zurückgegangen.”

“Agentic Workflows sind endlich ohne ständiges Babysitting praktikabel.”

“GPT 5.2 ist eigentlich 40 % teurer als 5.1, aber immer noch deutlich günstiger als Opus.”

“GPT 5.2 brauchte 11 Minuten und 20 Sekunden [um die App zu bauen]. Also doppelt so lange [wie Opus].”

“Die Output-Qualität ist viel höher, wenn man den Thinking-Modus laufen lässt.”

“Es hat das Multi-File-Refactoring ohne Verlust der Typdefinitionen bewältigt.”

“Wenn Sie reine Geschwindigkeit brauchen, ist das nicht das richtige Modell für Sie.”

Optimieren Sie Ihren Workflow mit KI-Automatisierung

Automatio kombiniert die Kraft von KI-Agenten, Web-Automatisierung und intelligenten Integrationen, um Ihnen zu helfen, mehr in weniger Zeit zu erreichen.

Pro-Tipps für GPT-5.2

Expertentipps, um das Beste aus GPT-5.2 herauszuholen.

Thinking Effort gezielt nutzen

Verwenden Sie den reasoning_effort-parameter (medium, high, xhigh), um die Überlegungszeit des Modells an die Komplexität der Aufgabe anzupassen.

Codex für Persistenz aktivieren

Nutzen Sie bei der Arbeit an großen Repositories die dedizierte Codex-Umgebung, um aktive Verarbeitungssitzungen für bis zu 150 Minuten aufrechtzuerhalten.

Kontext präzise bereitstellen

Geben Sie umfassende Hintergrunddokumentation in system prompts an, da das Modell am besten arbeitet, wenn es gezielt nach dem benötigten Kontext befragt wird.

Anforderungen iterativ verfeinern

Weisen Sie das Modell explizit an, Verifizierungsprüfungen gegen das aktuelle Codebase durchzuführen, um sicherzustellen, dass die Anforderungen validiert sind.

Erfahrungsberichte

Was Unsere Nutzer Sagen

Schliessen Sie sich Tausenden zufriedener Nutzer an, die ihren Workflow transformiert haben

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Verwandte AI Models

GPT-5.2 Pro

OpenAI

GPT-5.2 Pro is OpenAI's 2025 flagship reasoning model featuring Extended Thinking for SOTA performance in mathematics, coding, and expert knowledge work.

Qwen 3.7 Max

alibaba

Qwen 3.7 Max is Alibaba’s flagship AI model for deep reasoning and autonomous agent tasks, featuring a 256k context window and top-tier coding performance.

GPT-5.5

OpenAI

GPT-5.5 is OpenAI's flagship frontier model with a 1M context window and five reasoning effort levels, optimized for autonomous agentic workflows and coding.

Grok-3

xAI

Grok-3 is xAI's flagship reasoning model, featuring deep logic deduction, a 128k context window, and real-time integration with X for live research and coding.

Gemini 3.1 Flash Live Preview

Gemini 3.1 Flash Live Preview is Google's ultra-low-latency, audio-to-audio model featuring a 131K context window, high-fidelity multimodal reasoning, and...

Gemini 3 Pro

Google's Gemini 3 Pro is a multimodal powerhouse featuring a 1M token context window, native video processing, and industry-leading reasoning performance.

Claude Opus 4.7

Anthropic

Claude Opus 4.7 is Anthropic's flagship model with a 1-million-token context, adaptive reasoning, and 3.3x vision resolution for enterprise-scale agents.

Gemini 3.1 Pro

Gemini 3.1 Pro is Google's elite multimodal model featuring the DeepThink reasoning engine, a 1M+ context window, and industry-leading ARC-AGI logic scores.

Häufig gestellte Fragen zu GPT-5.2

Finden Sie Antworten auf häufige Fragen zu GPT-5.2