DeepSeek v4

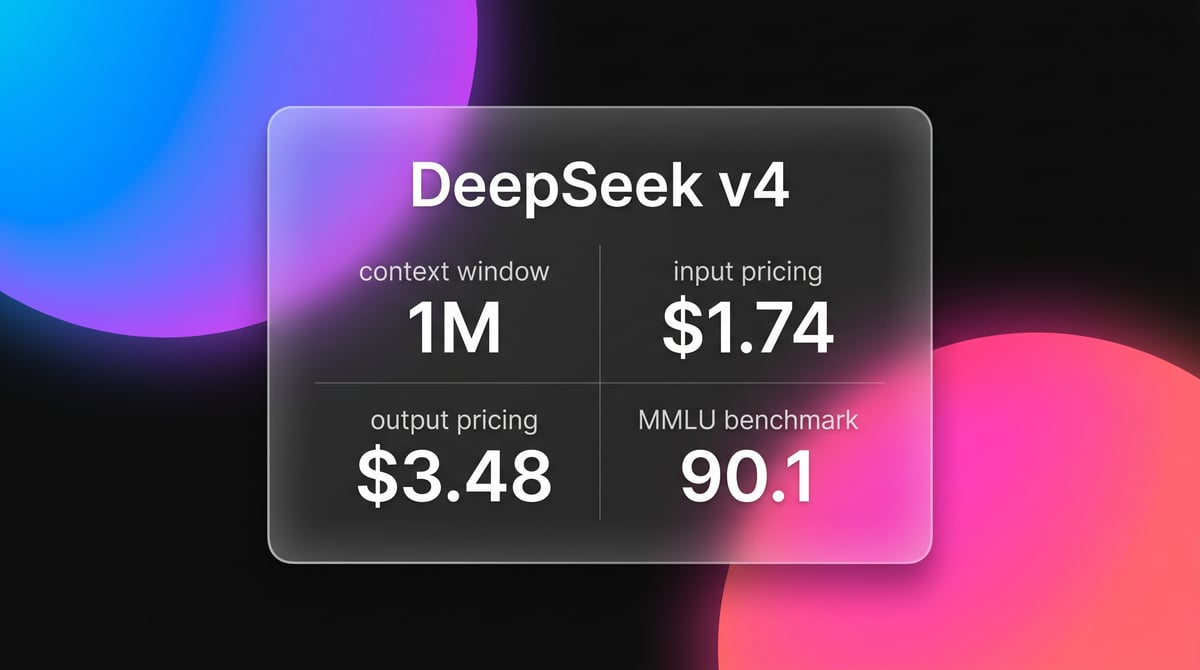

DeepSeek v4 es un modelo MoE de 1.6T de parámetros con una context window de 1M de tokens y soporte multimodal nativo para texto, visión y video a precios...

Acerca de DeepSeek v4

Conoce las capacidades, características y formas de uso de DeepSeek v4.

Arquitectura de billones de parámetros de alta eficiencia

DeepSeek v4 representa una evolución en el diseño de Mixture-of-Experts (MoE), escalando a 1.6 billones de parámetros totales con 49 mil millones de parámetros activos. El modelo integra Compressed Sparse Attention (CSA) y Heavily Compressed Attention (HCA) para gestionar su context window de 1 millón de tokens. Estas tecnologías reducen la huella de memoria del KV cache en un 90% en comparación con las arquitecturas estándar, permitiendo una inference más rápida y menores requisitos de hardware para tareas de long context.

Integración multimodal nativa

A diferencia de los modelos que utilizan codificadores de visión o audio separados, DeepSeek v4 es nativamente multimodal desde la fase de entrenamiento inicial. Procesa texto, imágenes, audio y video dentro de un marco unificado. Este enfoque mejora el razonamiento cross-modal, permitiendo al modelo realizar análisis complejos en archivos de video crudos y grandes archivos de documentos sin perder detalles granulares.

Disrupción estratégica de costos

El modelo se posiciona como una alternativa open-source de alto rendimiento a los modelos propietarios de primer nivel. Con un precio de $1.74 por millón de tokens de entrada, mantiene un rendimiento de nivel frontier en programación y matemáticas, al tiempo que reduce significativamente los costos operativos para los desarrolladores. La inclusión de un Thinking Mode opcional permite un razonamiento profundo para pruebas lógicas y programación competitiva.

Casos de uso de DeepSeek v4

Descubre las diferentes formas de usar DeepSeek v4 para lograr excelentes resultados.

Refactorización de bases de código a gran escala

Utilizar la context window de 1M para ingerir repositorios completos para la detección global de errores y mejoras arquitectónicas.

Análisis de video nativo

Procesar archivos de video crudos directamente para realizar detección de escenas, generación de transcripciones y razonamiento visual complejo.

Agentes de software autónomos

Desplegar el modelo en flujos de trabajo agentic para resolver problemas reales de GitHub con una tasa de éxito del 80.6% en SWE-bench.

Creación de contenido multimodal

Generar datos estructurados y contenido creativo en formatos de texto, imagen y audio utilizando un modelo unificado.

Pruebas matemáticas de alto nivel

Resolver problemas matemáticos de nivel olímpico y pruebas formales utilizando el Thinking Mode especializado para un razonamiento profundo.

Recuperación de conocimiento empresarial

Analizar archivos masivos de documentos en un solo prompt para extraer datos sin necesidad de complejas pipelines de RAG.

Fortalezas

Limitaciones

Inicio rápido de API

deepseek/deepseek-v4-pro

import OpenAI from 'openai'; const deepseek = new OpenAI({ baseURL: 'https://api.deepseek.com', apiKey: process.env.DEEPSEEK_API_KEY, }); const msg = await deepseek.chat.completions.create({ model: 'deepseek-v4-pro', messages: [{ role: 'user', content: 'Optimize this Rust kernel for memory efficiency.' }], }); console.log(msg.choices[0].message.content);Instala el SDK y comienza a hacer llamadas API en minutos.

Lo que la gente dice sobre DeepSeek v4

Mira lo que la comunidad piensa sobre DeepSeek v4

“El modo de razonamiento de DeepSeek v4 encontró un bug de concurrencia en mi código Rust que incluso Claude Opus pasó por alto. Verdaderamente una locura.”

“La era del long context de 1M rentable finalmente está aquí. Ahora podemos ejecutar refactorizaciones de proyectos completos por centavos.”

“Ver al modelo trabajar a través de una base de código de 1M de tokens sin perder la 'aguja' es el verdadero punto de inflexión para 2026.”

“Anthropic y OpenAI tienen un serio problema de precios ahora. DeepSeek acaba de convertir la IA de frontera en un commodity.”

“Supera a GPT-5.4 en benchmarks de programación mientras es open-source. Este es el mayor lanzamiento del año.”

“La compresión de memoria es la verdadera magia. 1T de parámetros en hardware casi de consumo finalmente se está volviendo real.”

Videos sobre DeepSeek v4

Mira tutoriales, reseñas y discusiones sobre DeepSeek v4

“La eficiencia de memoria es la verdadera noticia aquí; reducir el KV cache en un 90% cambia todo”

“Ejecutar un modelo de 1T con este nivel de velocidad es un triunfo arquitectónico masivo”

“El costo por millón de tokens hace imposible que las pequeñas startups lo ignoren”

“Nunca he visto un modelo open-source manejar 1 millón de tokens con tanta limpieza”

“Se siente como si la brecha entre modelos open y closed se hubiera cerrado oficialmente”

“DeepSeek ya no solo compite por precio; lideran en razonamiento de long context”

“El soporte nativo de video es sorprendentemente robusto comparado con Gemini 2.0”

“Instalar esto localmente es sorprendentemente fácil si usas SGLang”

“Los benchmarks en HumanEval muestran que está esencialmente a la par con GPT-5”

“La context window hace que las pipelines de RAG sean casi redundantes para proyectos medianos”

“El rendimiento en benchmarks de programación es actualmente inigualable por cualquier otro modelo de pesos abiertos”

“Iguala o supera a los mejores modelos closed en refactorización masiva de bases de código”

“La implementación de memoria engram es una maravilla técnica en este espacio”

“Estamos viendo un 90% de precisión lógica en Thinking Mode para matemáticas olímpicas”

“Este lanzamiento democratiza efectivamente la inteligencia de un billón de parámetros”

Potencia tu flujo de trabajo con Automatizacion IA

Automatio combina el poder de agentes de IA, automatizacion web e integraciones inteligentes para ayudarte a lograr mas en menos tiempo.

Consejos Pro para DeepSeek v4

Consejos de expertos para ayudarte a sacar el máximo provecho de DeepSeek v4.

Alternar los Thinking Modes

Usa el modo estándar para chats rápidos y reserva el Thinking Mode específicamente para programación y pruebas lógicas.

Aprovechar el context caching

Utiliza las funciones integradas de context caching para reducir costos hasta en un 90% al usar prompts de long context repetitivos.

Entrada multimodal directa

Envía archivos de audio y video crudos directamente a la API para beneficiarte de la arquitectura nativa en lugar de realizar una transcripción previa.

Optimización del system prompt

Proporciona esquemas JSON claros o instrucciones de uso de herramientas en el system prompt para un comportamiento agentic altamente confiable.

Testimonios

Lo Que Dicen Nuestros Usuarios

Unete a miles de usuarios satisfechos que han transformado su flujo de trabajo

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Relacionados AI Models

Claude Sonnet 4.6

Anthropic

Claude Sonnet 4.6 offers frontier performance for coding and computer use with a massive 1M token context window for only $3/1M tokens.

Gemini 3 Flash

Gemini 3 Flash is Google's high-speed multimodal model featuring a 1M token context window, elite 90.4% GPQA reasoning, and autonomous browser automation tools.

Kimi k2.6

Moonshot

Kimi k2.6 is Moonshot AI's 1T-parameter MoE model featuring a 256K context window, native video input, and elite performance in autonomous agentic coding.

Claude Opus 4.6

Anthropic

Claude Opus 4.6 is Anthropic's flagship model featuring a 1M token context window, Adaptive Thinking, and world-class coding and reasoning performance.

Qwen3.5-397B-A17B

alibaba

Qwen3.5-397B-A17B is Alibaba's flagship open-weight MoE model. It features native multimodal reasoning, a 1M context window, and a 19x decoding throughput...

Gemini 3 Pro

Google's Gemini 3 Pro is a multimodal powerhouse featuring a 1M token context window, native video processing, and industry-leading reasoning performance.

GPT-5.1

OpenAI

GPT-5.1 is OpenAI’s advanced reasoning flagship featuring adaptive thinking, native multimodality, and state-of-the-art performance in math and technical...

Qwen 3.7 Max

alibaba

Qwen 3.7 Max is Alibaba’s flagship AI model for deep reasoning and autonomous agent tasks, featuring a 256k context window and top-tier coding performance.

Preguntas Frecuentes Sobre DeepSeek v4

Encuentra respuestas a preguntas comunes sobre DeepSeek v4