GPT-4o mini

GPT-4o mini est le modèle compact le plus rentable d'OpenAI, offrant une intelligence de classe GPT-4 avec une vitesse supérieure et une vision multimodale...

À propos de GPT-4o mini

Découvrez les capacités, fonctionnalités et façons d'utiliser GPT-4o mini.

Un nouveau standard pour les petits modèles

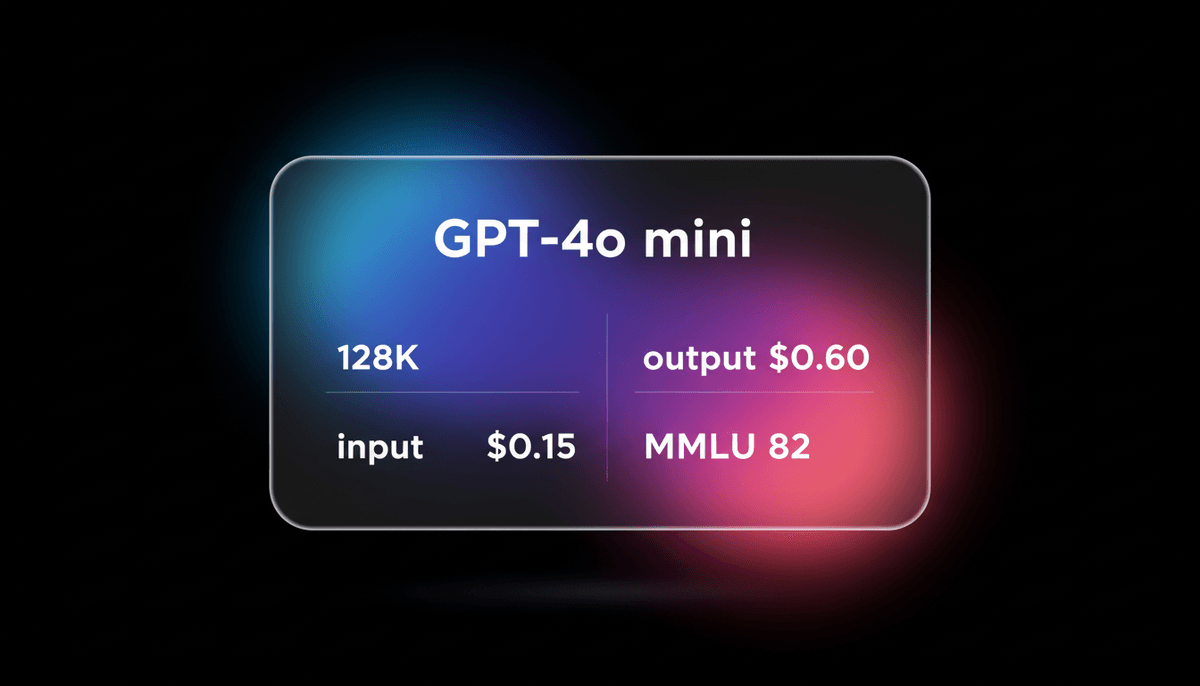

GPT-4o mini représente un saut significatif dans l'efficacité de l'IA, conçu pour remplacer GPT-3.5 Turbo en tant que modèle de référence pour les développeurs. Construit avec une architecture multimodale native, il offre des performances de classe GPT-4 à une fraction du coût et de la latency. Il dispose d'une massive context window de 128 000 tokens et prend en charge des sorties complexes allant jusqu'à 16 384 tokens, ce qui le rend idéal pour le traitement de documents longs et de flux de données à haut volume.

L'intelligence rencontre l'accessibilité financière

Contrairement aux précédents petits modèles qui sacrifiaient l'intelligence pour la vitesse, GPT-4o mini maintient des capacités de raisonnement élevées sur les tâches de texte et de vision. Il est 60 % moins cher que GPT-3.5 Turbo et nettement plus performant, obtenant un score de 82 % sur le benchmark MMLU. Ce modèle est spécifiquement optimisé pour les applications où la faible latency et la haute fiabilité sont primordiales, telles que les assistants clients en temps réel et les moteurs de classification de données à grande échelle.

Cas d'utilisation de GPT-4o mini

Découvrez les différentes façons d'utiliser GPT-4o mini pour obtenir d'excellents résultats.

Automatisation du support client

Traitement de gros volumes de demandes clients avec une faible latency et une haute précision, à une fraction du coût habituel.

Résumé de contenu

Transformation de documents volumineux ou de contenus longs en résumés concis grâce à la context window de 128k.

Extraction de données

Conversion de texte non structuré ou d'images en formats de données structurées comme le JSON pour l'intégration en base de données.

Traduction multilingue

Traduction en temps réel dans des dizaines de langues pour les applications de chat et la communication mondiale.

Tutorat éducatif

Assistant d'étude interactif pour les élèves ayant besoin d'aide en mathématiques, en sciences et en langues.

Tâches de vision basiques

Analyse d'images pour identifier des objets, extraire du texte via OCR ou fournir des descriptions pour l'accessibilité.

Points forts

Limitations

Démarrage rapide API

openai/gpt-4o-mini

import OpenAI from "openai";

const openai = new OpenAI();

async function main() {

const completion = await openai.chat.completions.create({

messages: [{ role: "user", content: "Explique la physique quantique." }],

model: "gpt-4o-mini",

});

console.log(completion.choices[0].message.content);

}

main();Installez le SDK et commencez à faire des appels API en quelques minutes.

Ce que les gens disent de GPT-4o mini

Voyez ce que la communauté pense de GPT-4o mini

“GPT-4o mini a pratiquement tué le marché du fine-tuning des anciens modèles pour le RAG basique. Les coûts sont trop bas pour être ignorés.”

“La vitesse est tout simplement folle. Je reçois mes tokens presque instantanément pour mon agent de traduction.”

“OpenAI a vraiment forcé la main à Anthropic et Google avec cette tarification. 0,15 $ pour 1M de tokens, c'est un nouveau plancher.”

“J'ai remplacé 3.5 par mini et l'amélioration de la logique était visible dès les cinq premières minutes de test.”

“C'est enfin assez bon marché pour utiliser des LLM pour le nettoyage de données de base à grande échelle sans facture cloud massive.”

“La performance de vision pour l'OCR est en fait meilleure que certains modèles spécialisés qui coûtent 10 fois plus cher.”

Vidéos sur GPT-4o mini

Regardez des tutoriels, critiques et discussions sur GPT-4o mini

“Il est plus rapide et moins cher que GPT-3.5 Turbo sur tous les aspects.”

“Les capacités de vision pour un modèle aussi petit sont vraiment surprenantes.”

“La tarification est devenue une véritable course vers le bas avec ce lancement.”

“Il parvient à garder une context window massive tout en étant minuscule.”

“Les benchmarks montrent qu'il surpasse Claude Haiku dans presque toutes les catégories.”

“GPT 40 mini est un modèle léger donc il est beaucoup plus rapide que GPT 40.”

“C'est bien plus rapide que GPT 4.”

“Pour les tâches quotidiennes, la plupart des utilisateurs ne remarqueront même pas la différence de raisonnement.”

“La reconnaissance d'images est très cohérente pour les objets de base.”

“Il gère les instructions complexes beaucoup mieux que l'ancien modèle 3.5.”

“Il surpasse actuellement leur gbd4 sur les préférences de chat du leaderboard LMC.”

“Tout semble parfait et ce reçu spécifique ressemble à un ticket de caisse classique.”

“Le temps de réponse est pratiquement inférieur à la seconde pour les prompts courts.”

“Il est très efficace pour résumer de longs PDF via l'API.”

“Vous pouvez traiter des millions de tokens pour seulement quelques dollars.”

Optimisez votre flux de travail avec l'Automatisation IA

Automatio combine la puissance des agents IA, de l'automatisation web et des integrations intelligentes pour vous aider a accomplir plus en moins de temps.

Conseils Pro pour GPT-4o mini

Conseils d'experts pour tirer le meilleur parti de GPT-4o mini.

Utilisation pour le RAG

Exploitez le faible coût d'entrée pour effectuer une Retrieval Augmented Generation intensive sans frais élevés.

Structurer avec le mode JSON

Utilisez le mode JSON ou les paramètres de function calling pour garantir des structures de données cohérentes pour vos workflows backend.

Batch Processing

Utilisez l'API Batch d'OpenAI avec ce modèle pour réduire les coûts de 50 % pour les tâches non urgentes.

Réglage de la température

Définissez une température plus basse entre 0,1 et 0,3 pour les tâches d'extraction factuelle afin de maximiser la précision.

Témoignages

Ce Que Disent Nos Utilisateurs

Rejoignez des milliers d'utilisateurs satisfaits qui ont transforme leur flux de travail

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Associés AI Models

Qwen3-Coder-Next

alibaba

Qwen3-Coder-Next is Alibaba Cloud's elite Apache 2.0 coding model, featuring an 80B MoE architecture and 256k context window for advanced local development.

GLM-4.7

Zhipu (GLM)

GLM-4.7 by Zhipu AI is a flagship 358B MoE model featuring a 200K context window, elite 73.8% SWE-bench performance, and native Deep Thinking for agentic...

MiniMax M2.5

minimax

MiniMax M2.5 is a SOTA MoE model featuring a 1M context window and elite agentic coding capabilities at disruptive pricing for autonomous agents.

MiMo V2.5 Pro

Other

MiMo V2.5 Pro is Xiaomi's open-source 1.02T parameter MoE model featuring a 1M context window, native multimodality, and elite agentic coding performance.

Gemini 3.5 Flash

Gemini 3.5 Flash is Google's high-speed multimodal model with a 1M context window, optimized for sub-second agentic loops and complex coding tasks.

Qwen 3.7 Max

alibaba

Qwen 3.7 Max is Alibaba’s flagship AI model for deep reasoning and autonomous agent tasks, featuring a 256k context window and top-tier coding performance.

Qwen3.5-Omni

alibaba

Qwen3.5-Omni is a natively omnimodal AI by Alibaba Cloud, offering seamless audio-visual reasoning, real-time voice chat, and 256k context for low-latency apps.

DeepSeek v4

DeepSeek

DeepSeek v4 is a 1.6T parameter MoE model featuring a 1M token context window and native multimodal support for text, vision, and video at disruptive prices.

Questions Fréquentes sur GPT-4o mini

Trouvez des réponses aux questions courantes sur GPT-4o mini