Kimi K2.5

Découvrez Kimi K2.5 de Moonshot AI, un modèle agentique open-source de 1T de paramètres avec des capacités multimodales natives, une context window de 262K et...

À propos de Kimi K2.5

Découvrez les capacités, fonctionnalités et façons d'utiliser Kimi K2.5.

Kimi K2.5 est un modèle multimodal open-source de Moonshot AI. Il utilise une architecture Mixture-of-Experts de 1 trillion de paramètres où 32 milliards de paramètres sont actifs par token. Le système unifie le traitement du texte, de l'image et de la vidéo à travers un cadre de reasoning unique plutôt que d'utiliser des encodeurs externes séparés pour chaque modalité. Cette architecture permet au modèle de gérer 256 000 tokens de contexte tout en maintenant une haute précision de récupération et une cohérence logique sur de très longues séquences.

Le modèle se distingue par sa capacité Agent Swarm. Cette fonctionnalité permet au système de coordonner jusqu'à 100 sous-agents en parallèle pour exécuter des tâches de recherche ou d'ingénierie complexes simultanément. En intégrant un encodeur MoonViT-3D de 400M de paramètres, K2.5 peut analyser plusieurs heures de contenu vidéo avec une précision temporelle. Il est spécifiquement conçu pour l'exécution autonome, surpassant de nombreux modèles propriétaires sur les benchmarks agentiques comme SWE-Bench et BrowseComp.

Kimi K2.5 propose un mode Thinking dédié aux tâches nécessitant une logique approfondie. Lorsqu'il est activé, le modèle génère une chaîne de reasoning interne pour s'autocorriger et vérifier ses étapes avant de produire une réponse finale. Cela le rend très efficace pour les mathématiques de niveau compétition et le développement logiciel à grande échelle. Son économie de tokens est optimisée pour le déploiement en entreprise, offrant une intelligence de classe frontier à une fraction du coût des systèmes fermés concurrents.

Cas d'utilisation de Kimi K2.5

Découvrez les différentes façons d'utiliser Kimi K2.5 pour obtenir d'excellents résultats.

Ingénierie logicielle autonome

Résolution de problèmes GitHub complexes et création d'architectures de projets multi-fichiers utilisant une logique optimisée pour SWE-Bench.

Développement web visuel

Création de code frontend fonctionnel et de designs UI directement à partir d'enregistrements d'écran d'interactions de sites web existants.

Recherche multi-thread

Utilisation de l'Agent Swarm pour explorer et synthétiser des informations provenant de plus de 100 sources dans un seul flux de travail parallèle.

Analyse de vidéos longues

Extraction d'événements spécifiques et de données temporelles à partir d'heures de séquences de sécurité ou de cours sans outils d'extraction d'images.

Génération de preuves mathématiques

Application du mode de deep thinking pour résoudre des problèmes mathématiques de niveau olympiade avec un taux de précision de 96 pour cent.

Automatisation documentaire en entreprise

Génération de rapports PDF de plusieurs pages et de feuilles de calcul financières complexes à partir de sources de données métier non structurées.

Points forts

Limitations

Démarrage rapide API

fireworks/kimi-k2p5

import OpenAI from 'openai';

const client = new OpenAI({ apiKey: process.env.KIMI_API_KEY, baseURL: 'https://api.moonshot.cn/v1' });

async function main() {

const res = await client.chat.completions.create({

model: 'kimi-k2.5',

messages: [

{ role: 'system', content: 'You are Kimi, a reasoning agent.' },

{ role: 'user', content: 'Design a parallel research plan for quantum computing trends.' }

],

extra_body: { thinking: { type: 'enabled' } }

});

console.log(res.choices[0].message.content);

}

main();Installez le SDK et commencez à faire des appels API en quelques minutes.

Ce que les gens disent de Kimi K2.5

Voyez ce que la communauté pense de Kimi K2.5

“Kimi K2.5 coûte presque 10 pour cent du prix d'Opus pour un niveau de performance similaire.”

“Les gens oublient que Nvidia a perdu 600 milliards de dollars lorsqu'un laboratoire chinois a rendu open-source une avancée majeure. Kimi réitère cela avec une intelligence frontier.”

“Le concept d'Attention Residuals dans K2.5 est le premier changement architectural en des années qui résout réellement le problème d'oubli des LLM.”

“Workers AI exécute désormais de gros modèles. Kimi K2.5 en premier. C'est l'un des meilleurs modèles open-source disponibles, très bon pour le code également.”

“Kimi K2.5 est une bête différente. C'est un modèle RP incroyablement intelligent, mais il peut devenir névrosé si vous n'utilisez pas les presets de la communauté.”

“J'ai remplacé mon workflow GPT 4 par Kimi K2.5 car le mode thinking est plus transparent et la context window gère tout mon dépôt.”

Vidéos sur Kimi K2.5

Regardez des tutoriels, critiques et discussions sur Kimi K2.5

“Kimmy K2.5 bat GPT 5.2 avec son mode thinking élevé, surpassant littéralement les autres modèles frontier.”

“C'est le modèle de code open-source le plus puissant à ce jour avec 76.8 sur SWE-Bench Verified.”

“L'Agent swarm marque une transition du modèle mono-agent vers l'exécution multi-agent de workflows parallèles sur jusqu'à 1500 étapes coordonnées.”

“La context window est massive avec 256k tokens, ce qui est largement suffisant pour la plupart des projets.”

“Moonshot repousse vraiment les limites de ce que les open weights peuvent accomplir début 2026.”

“Il a vraiment capturé l'esthétique du design Apple et a produit un site web attrayant avec des animations juste à partir d'une vidéo.”

“La fonctionnalité Swarm est très impressionnante et amusante à utiliser car elle assigne des badges d'identification à chaque sous-agent.”

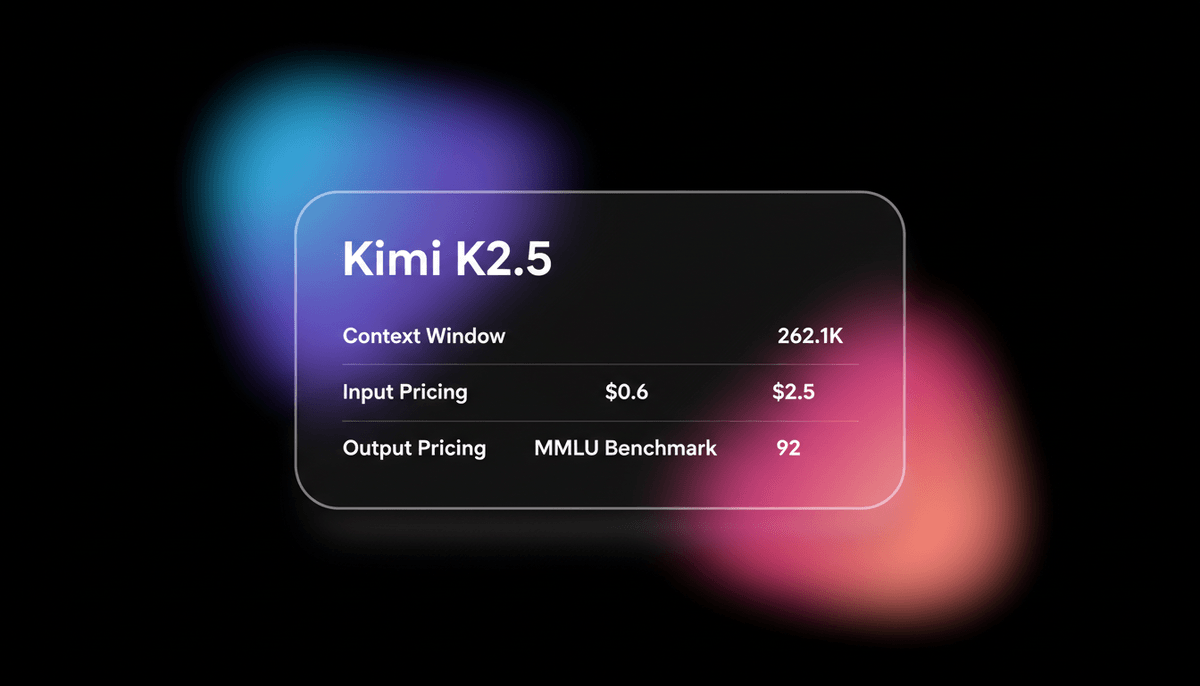

“K2.5 est beaucoup moins cher à 60 centimes par million de tokens d'entrée et 3 dollars par million de tokens de sortie.”

“Le traitement vidéo natif signifie que vous n'avez pas besoin d'utiliser des outils externes coûteux pour traiter les images.”

“Ce modèle change la donne pour les développeurs qui ont besoin d'agents autonomes avec un budget limité.”

“Moonshot a réussi cela en donnant à chaque sous-agent des récompenses à des étapes critiques distinctes pour éviter l'effondrement en série.”

“Le modèle apprend à choisir le parallélisme uniquement lorsque cela raccourcit le chemin critique, une innovation très intelligente.”

“Kimi K2.5 est à la limite de pouvoir être exécuté sur du matériel grand public en utilisant GGUF.”

“Le mode thinking est incroyablement robuste pour résoudre des erreurs logiques complexes en Python.”

“Voir un modèle de 1 trillion de paramètres publié ainsi est énorme pour la communauté open-source.”

Optimisez votre flux de travail avec l'Automatisation IA

Automatio combine la puissance des agents IA, de l'automatisation web et des integrations intelligentes pour vous aider a accomplir plus en moins de temps.

Conseils Pro pour Kimi K2.5

Conseils d'experts pour tirer le meilleur parti de Kimi K2.5.

Activer le mode Thinking

Passez le paramètre thinking dans votre requête API pour atteindre une précision maximale sur les tâches mathématiques et de code.

Déclencher l'Agent Swarm

Demandez au modèle de déployer un swarm pour les tâches de recherche afin de forcer l'orchestration parallèle entre les sous-agents.

Optimiser la Temperature

Utilisez une température de 1.0 en mode thinking pour permettre un reasoning diversifié, mais réduisez-la à 0.6 pour une conversation standard.

Prompts de vision combinée

Téléchargez des captures d'écran d'erreurs avec des snippets de code pour tirer parti de l'entraînement texte-vision unifié du modèle.

Context Caching

Utilisez le context caching pour les longs documents répétés afin de réduire les coûts d'entrée jusqu'à 90 pour cent.

Témoignages

Ce Que Disent Nos Utilisateurs

Rejoignez des milliers d'utilisateurs satisfaits qui ont transforme leur flux de travail

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Associés AI Models

Grok-4

xAI

Grok-4 by xAI is a frontier model featuring a 2M token context window, real-time X platform integration, and world-record reasoning capabilities.

GPT-5.1

OpenAI

GPT-5.1 is OpenAI’s advanced reasoning flagship featuring adaptive thinking, native multimodality, and state-of-the-art performance in math and technical...

Claude Opus 4.5

Anthropic

Claude Opus 4.5 is Anthropic's most powerful frontier model, delivering record-breaking 80.9% SWE-bench performance and advanced autonomous agency for coding.

Gemini 3.1 Flash-Lite

Gemini 3.1 Flash-Lite is Google's fastest, most cost-efficient model. Features 1M context, native multimodality, and 363 tokens/sec speed for scale.

Qwen3.5-397B-A17B

alibaba

Qwen3.5-397B-A17B is Alibaba's flagship open-weight MoE model. It features native multimodal reasoning, a 1M context window, and a 19x decoding throughput...

GLM-5.1

Zhipu (GLM)

GLM-5.1 is Zhipu AI's flagship reasoning model, featuring a 202K context window and an autonomous 8-hour execution loop for complex agentic engineering.

Qwen3.6-Max-Preview

alibaba

Qwen3.6-Max-Preview is Alibaba's flagship MoE model featuring 1M context, a native thinking mode, and SOTA scores in agentic coding and reasoning.

GLM-5

Zhipu (GLM)

GLM-5 is Zhipu AI's 744B parameter open-weight powerhouse, excelling in long-horizon agentic tasks, coding, and factual accuracy with a 200k context window.

Questions Fréquentes sur Kimi K2.5

Trouvez des réponses aux questions courantes sur Kimi K2.5