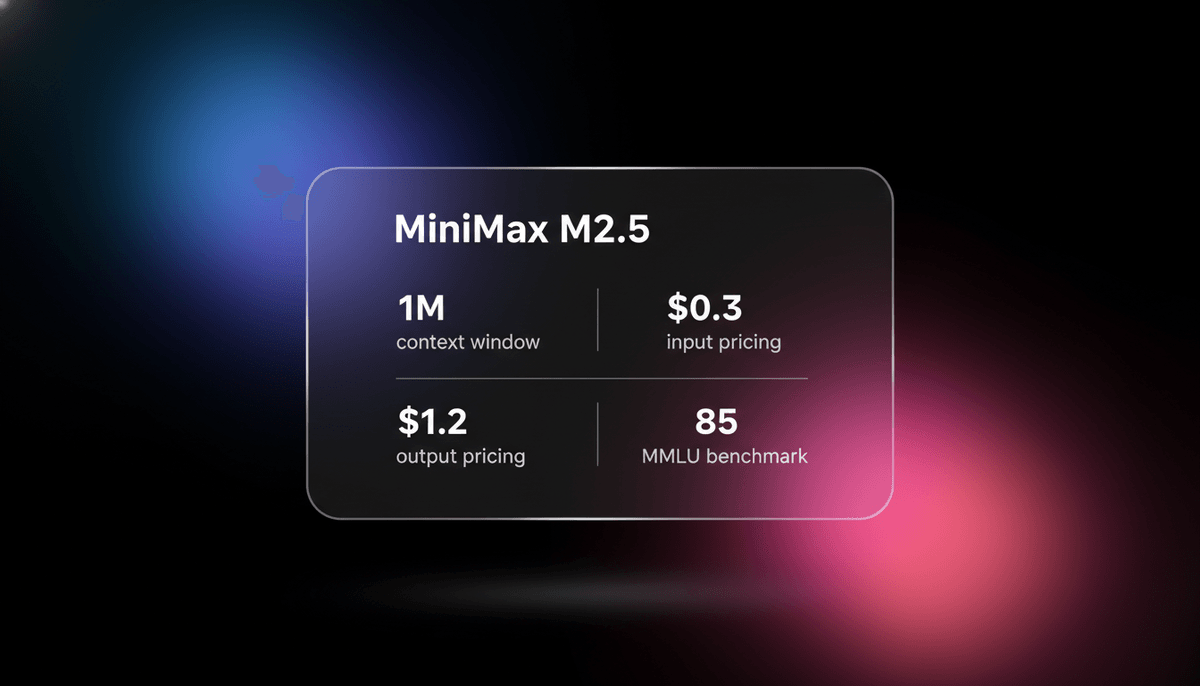

MiniMax M2.5

MiniMax M2.5 est un modèle MoE state-of-the-art doté d'une context window de 1M et de capacités de codage agentique d'élite à un prix disruptif pour les agents...

À propos de MiniMax M2.5

Découvrez les capacités, fonctionnalités et façons d'utiliser MiniMax M2.5.

Architecture frontier efficace

MiniMax M2.5 est un modèle frontier à haute efficacité basé sur une architecture Mixture-of-Experts (MoE) de 230B. En n'activant que 10 milliards de paramètres par passage direct, il atteint des vitesses d'inference et des structures de prix près de 20 fois plus efficaces que les géants propriétaires. Il est conçu spécifiquement pour l'intelligence agentique, privilégiant la logique structurée et la planification multi-étapes aux simples complétions de chat. Cette conception sparse permet au modèle de conserver une haute intelligence sans le coût de calcul massif des modèles denses traditionnels.

Intelligence de codage avancée

La caractéristique principale du modèle est sa Mentalité d'Architecte, qui lui permet de visualiser les structures logiques et les hiérarchies de projet avant de générer du code. Cela le rend particulièrement efficace pour l'ingénierie logicielle autonome, où il égale l'état de l'art avec un score de 80,2 % sur SWE-Bench Verified. Avec une context window d'un million de tokens, il peut ingérer des codebases entières, permettant des audits de dépôts profonds et des refactorisations de systèmes complexes qui étaient auparavant prohibitifs en termes de coûts.

Déploiement en entreprise et en local

MiniMax M2.5 prend en charge plus de 10 langages de programmation et un débit natif allant jusqu'à 100 tokens par seconde sur sa variante lightning. Parce qu'il est disponible en tant que modèle open-weight, les développeurs peuvent le déployer localement pour une confidentialité totale des données tout en conservant l'accès au même raisonnement riche en logique que dans l'API hébergée. Cette polyvalence en fait un choix pratique tant pour les pipelines d'agents basés sur le cloud que pour les outils de développement sur site.

Cas d'utilisation de MiniMax M2.5

Découvrez les différentes façons d'utiliser MiniMax M2.5 pour obtenir d'excellents résultats.

Ingénierie logicielle autonome

Résolution de problèmes GitHub réels et débogage multi-fichiers à l'aide d'environnements d'agents.

Pipelines d'agents en entreprise

Alimentation d'agents d'arrière-plan toujours actifs pour la recherche et la synthèse de données à faible coût d'API.

Modernisation de code legacy

Refactorisation de dépôts massifs obsolètes vers des frameworks modernes tout en respectant les standards logiques.

Revues de code architecturales

Analyse des hiérarchies de projet pour fournir des retours logiques et des suggestions d'optimisation structurelle.

Édition de documents à haut volume

Traitement de fichiers bureautiques volumineux avec une grande fidélité pour la modélisation financière et juridique.

Outils de développement à faible latence

Pilotage d'extensions d'IDE et d'outils CLI nécessitant des temps de réponse inférieurs à la seconde.

Points forts

Limitations

Démarrage rapide API

minimax/minimax-m2.5

import OpenAI from 'openai';

const client = new OpenAI({

apiKey: process.env.MINIMAX_API_KEY,

baseURL: 'https://api.minimax.io/v1',

});

async function main() {

const response = await client.chat.completions.create({

model: 'minimax-m2.5',

messages: [{ role: 'user', content: 'Design a microservices architecture for a fintech app.' }],

temperature: 0.1,

});

console.log(response.choices[0].message.content);

}

main();Installez le SDK et commencez à faire des appels API en quelques minutes.

Ce que les gens disent de MiniMax M2.5

Voyez ce que la communauté pense de MiniMax M2.5

“La tarification de MiniMax M2.5 est la vraie nouvelle, assez bon marché pour changer l'architecture, pas seulement les budgets.”

“Le M2.5 atteint des chiffres state-of-the-art et c'est un modèle à 10B de paramètres actifs, ce qui signifie qu'il est rapide et bon marché.”

“Le modèle réduit le travail lourd que les utilisateurs devaient fournir juste pour faire avancer les choses.”

“Le M2.5 égale le débit de Claude Opus 4.6 pour une fraction du coût.”

“Faire tourner M2.5 localement sur un Mac Studio est rapide. Les 10B de paramètres actifs font vraiment la différence.”

“L'étape de planification architecturale détecte les erreurs logiques avant même d'écrire une seule ligne de code.”

Vidéos sur MiniMax M2.5

Regardez des tutoriels, critiques et discussions sur MiniMax M2.5

“C'est près de 20 fois moins cher que les meilleures options propriétaires.”

“C'est un modèle de codage et d'agent de premier plan, beaucoup plus rapide et nettement moins cher.”

“La performance sur SWE-bench verified le place vraiment dans la catégorie d'élite.”

“Vous obtenez une intelligence frontier avec des exigences matérielles open-source.”

“L'architecture MoE ici est parfaitement réglée pour les tâches de codage à faible latence.”

“MiniMax sert le modèle à 3 % du coût d'Opus 4.6 en tokens de sortie.”

“Le coût de l'intelligence approche désormais le coût de l'électricité.”

“Il gère les context windows de grands dépôts sans le typique oubli en milieu de document.”

“Pour les outils de développement, la vitesse de la variante lightning est un gain massif pour l'UX.”

“C'est la première fois que je vois un modèle aussi bon marché résoudre réellement des bugs logiques complexes.”

“Cela ne coûte qu'1 $ pour faire tourner le modèle en continu pendant une heure à 100 tokens par seconde.”

“La réflexion interne brille vraiment ici car il peut corriger sa trajectoire immédiatement.”

“En le testant face à GPT-4o, il fournit systématiquement de meilleures refactorisations multi-fichiers.”

“Les capacités agentiques sont intégrées, ce n'est pas juste une réflexion après-coup dans le prompt.”

“C'est essentiellement gratuit pour les petits développeurs compte tenu des paliers de prix d'entrée.”

Optimisez votre flux de travail avec l'Automatisation IA

Automatio combine la puissance des agents IA, de l'automatisation web et des integrations intelligentes pour vous aider a accomplir plus en moins de temps.

Conseils Pro pour MiniMax M2.5

Conseils d'experts pour tirer le meilleur parti de MiniMax M2.5.

Adoptez la mentalité d'architecte

Demandez au modèle de générer une structure de projet avant de demander le code d'implémentation proprement dit.

Utilisez la context window de 1M

Fournissez une documentation complète ou des modules entiers pour assurer une compréhension globale de votre codebase.

Utilisez le plan HighSpeed

Sélectionnez l'endpoint M2.5-HighSpeed pour atteindre un débit constant de 100 tokens par seconde pour les agents interactifs.

Raffinement itératif

Demandez au modèle de réviser son résultat initial pour détecter les lacunes logiques ou les vulnérabilités de sécurité.

Témoignages

Ce Que Disent Nos Utilisateurs

Rejoignez des milliers d'utilisateurs satisfaits qui ont transforme leur flux de travail

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Associés AI Models

DeepSeek-V3.2-Speciale

DeepSeek

DeepSeek-V3.2-Speciale is a reasoning-first LLM featuring gold-medal math performance, DeepSeek Sparse Attention, and a 131K context window. Rivaling GPT-5...

MiMo V2.5 Pro

Other

MiMo V2.5 Pro is Xiaomi's open-source 1.02T parameter MoE model featuring a 1M context window, native multimodality, and elite agentic coding performance.

Claude 3.7 Sonnet

Anthropic

Claude 3.7 Sonnet is Anthropic's first hybrid reasoning model, delivering state-of-the-art coding capabilities, a 200k context window, and visible thinking.

Qwen 3.7 Max

alibaba

Qwen 3.7 Max is Alibaba’s flagship AI model for deep reasoning and autonomous agent tasks, featuring a 256k context window and top-tier coding performance.

Qwen3.5-Omni

alibaba

Qwen3.5-Omni is a natively omnimodal AI by Alibaba Cloud, offering seamless audio-visual reasoning, real-time voice chat, and 256k context for low-latency apps.

DeepSeek v4

DeepSeek

DeepSeek v4 is a 1.6T parameter MoE model featuring a 1M token context window and native multimodal support for text, vision, and video at disruptive prices.

GPT-5.5

OpenAI

GPT-5.5 is OpenAI's flagship frontier model with a 1M context window and five reasoning effort levels, optimized for autonomous agentic workflows and coding.

Kimi k2.6

Moonshot

Kimi k2.6 is Moonshot AI's 1T-parameter MoE model featuring a 256K context window, native video input, and elite performance in autonomous agentic coding.

Questions Fréquentes sur MiniMax M2.5

Trouvez des réponses aux questions courantes sur MiniMax M2.5