Qwen3.5-397B-A17B

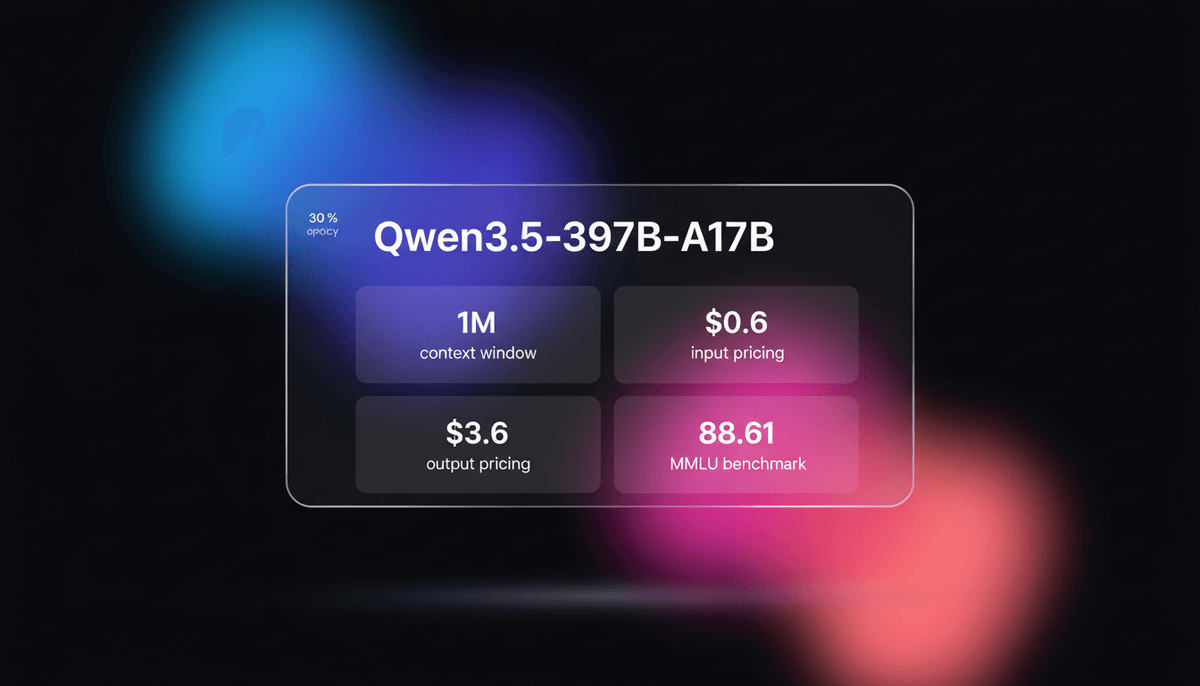

Qwen3.5-397B-A17B est le modèle MoE open-weights phare d'Alibaba. Il propose un raisonnement multimodal natif, une context window de 1M, et un throughput de...

À propos de Qwen3.5-397B-A17B

Découvrez les capacités, fonctionnalités et façons d'utiliser Qwen3.5-397B-A17B.

Mixture of Experts à haute efficacité

Qwen3.5-397B-A17B est un flagship multimodal natif qui utilise une architecture hybride innovante fusionnant l'attention linéaire via Gated Delta Networks avec une Mixture-of-Experts (MoE) sparse. Bien qu'il contienne 397 milliards de paramètres au total, sa conception sparse n'active que 17 milliards de paramètres par passage forward, atteignant une efficacité d'inférence et une vitesse exceptionnelles sans compromettre ses vastes capacités de raisonnement. Il est optimisé pour les tâches linguistiques et visuelles, prenant en charge un vocabulaire massif de 250k tokens et couvrant plus de 201 langues et dialectes.

Workflows agentic multimodaux natifs

Le modèle excelle en tant qu'agent multimodal natif, capable de traiter jusqu'à un million de tokens de contexte, soit environ deux heures de vidéo. Il introduit un Thinking Mode spécialisé pour le raisonnement logique complexe et est nativement équipé pour les workflows agentic, incluant le développement web, la navigation GUI et l'intelligence spatiale du monde réel. Son architecture prend en charge l'entraînement FP8 de bout en bout et un framework d'entraînement-inférence désagrégé, ce qui en fait l'un des modèles les plus scalables et efficaces pour les applications d'IA en entreprise.

Open Weights pour une accessibilité mondiale

Publié sous la licence Apache 2.0, ce modèle offre à la communauté open-source des capacités de pointe auparavant réservées aux systèmes propriétaires. Il comble le fossé entre le nombre massif de paramètres et le déploiement pratique, permettant aux organisations d'effectuer des tâches de raisonnement de pointe sur une infrastructure privée avec un overhead de calcul nettement inférieur aux alternatives denses de 400B.

Cas d'utilisation de Qwen3.5-397B-A17B

Découvrez les différentes façons d'utiliser Qwen3.5-397B-A17B pour obtenir d'excellents résultats.

Analyse vidéo longue

Analysez jusqu'à deux heures de contenu vidéo pour extraire une logique, faire de l'ingénierie inverse sur du code à partir d'une séquence ou générer des résumés structurés.

Recherche STEM de niveau doctorat

Résolvez des problèmes scientifiques de niveau doctorat et des problèmes mathématiques complexes grâce à son mode de réflexion profonde adaptative.

Agents GUI autonomes

Automatisez les interactions avec les smartphones et les ordinateurs pour gérer les flux de travail de bureau et la navigation mobile multi-applications.

Ingénierie logicielle visuelle

Exécutez du « vibe coding » en transformant des instructions en langage naturel et des croquis d'UI en code frontend fonctionnel.

Intelligence documentaire

Traitez des documents complexes, des graphiques et des croquis manuscrits pour extraire des données structurées et analyser les mises en page.

Applications d'IA spatiale

Comprenez les relations au niveau du pixel pour des tâches d'IA incarnée comme l'analyse de scènes de conduite autonome et la navigation robotique.

Points forts

Limitations

Démarrage rapide API

alibaba/qwen3.5-plus

import OpenAI from 'openai';

const client = new OpenAI({

apiKey: process.env.DASHSCOPE_API_KEY,

baseURL: 'https://dashscope-intl.aliyuncs.com/compatible-mode/v1',

});

async function main() {

const completion = await client.chat.completions.create({

model: 'qwen3.5-plus',

messages: [{ role: 'user', content: 'Analyze the logic of this MoE architecture.' }],

extra_body: { enable_thinking: true },

});

console.log(completion.choices[0].message.content);

}

main();Installez le SDK et commencez à faire des appels API en quelques minutes.

Ce que les gens disent de Qwen3.5-397B-A17B

Voyez ce que la communauté pense de Qwen3.5-397B-A17B

“Qwen3.5-397B est essentiellement un modèle de classe GPT-5 mais en open-weights. L'architecture DeltaNet résout parfaitement les problèmes de latence MoE.”

“Le raisonnement multimodal natif sur Qwen3.5 semble incroyable. 1M de contexte + analyse vidéo va changer les flux de travail des agents.”

“La décision d'utiliser l'entraînement FP8 de bout en bout tout en maintenant BF16 dans les couches sensibles est un coup de maître en matière d'optimisation de la stabilité.”

“C'est la première fois que je vois un modèle ouvert battre réellement Gemini 1.5 Pro sur des tâches d'agents multimodaux complexes.”

“L'amélioration de 19x du throughput de décodage par rapport à Qwen3-Max en fait une alternative viable pour les agents de niveau production.”

“J'ai été surpris de voir à quel point il gère bien la quantification 4-bit. Il conserve presque toute la capacité de raisonnement sur une configuration double A100.”

Vidéos sur Qwen3.5-397B-A17B

Regardez des tutoriels, critiques et discussions sur Qwen3.5-397B-A17B

“Un modèle de 397 milliards de paramètres, avec 17 milliards de paramètres actifs.”

“Lors du décodage à 256K, ce modèle est 19 fois plus rapide que Qwen 3 Max.”

“Le raisonnement vision-langage natif est ce qui le distingue pour les workflows agentic.”

“Il bat la plupart des modèles fermés sur les benchmarks mathématiques standards.”

“Le faire tourner localement est difficile, mais les versions quantifiées sont utilisables sur des Mac haut de gamme.”

“Modèle de 397 milliards de paramètres avec 17 milliards actifs. Il est nativement multimodal.”

“C'est probablement le meilleur modèle multimodal open-source actuellement.”

“La capacité de traiter nativement deux heures de vidéo est un avantage majeur.”

“Regardez ces scores de logique, il atteint régulièrement les niveaux de GPT-4o.”

“La licence Apache rend cela très attractif pour la confidentialité des données en entreprise.”

“Extraction structurée OCR. Vous avez un PDF illisible... et vous devez le transformer en JSON propre. Ce modèle excelle dans ce domaine.”

“Vous obtenez l'intelligence d'un géant de 400 milliards de paramètres... mais vous payez le coût de calcul d'un modèle de 17 milliards.”

“Il gère mieux la récupération de contexte long que la version précédente.”

“L'intégration de l'utilisation d'outils est intégrée à l'entraînement de base, pas ajoutée après coup.”

“Le mode réflexion permet de corriger sa propre logique avant de générer la réponse.”

Optimisez votre flux de travail avec l'Automatisation IA

Automatio combine la puissance des agents IA, de l'automatisation web et des integrations intelligentes pour vous aider a accomplir plus en moins de temps.

Conseils Pro pour Qwen3.5-397B-A17B

Conseils d'experts pour tirer le meilleur parti de Qwen3.5-397B-A17B.

Activer le Thinking Mode

Passez le paramètre 'enable_thinking: true' dans votre appel API pour activer un raisonnement profond pour les mathématiques, le codage et les énigmes logiques complexes.

Utiliser le Fast Mode

Utilisez le mode 'Fast' pour les requêtes simples afin d'obtenir des réponses instantanées sans consommer de tokens lors des phases de réflexion interne inutiles.

Optimiser les prompts vidéo

Lors de l'analyse vidéo, demandez au modèle de se concentrer sur le résultat dynamique final plutôt que sur une analyse image par image pour une meilleure cohérence temporelle.

Exploiter la quantification

Utilisez la quantification 4-bit ou 8-bit (GGUF/EXL2) pour faire tourner le modèle sur du matériel grand public si vous disposez de suffisamment de VRAM (200 Go+).

Témoignages

Ce Que Disent Nos Utilisateurs

Rejoignez des milliers d'utilisateurs satisfaits qui ont transforme leur flux de travail

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Associés AI Models

GPT-5.1

OpenAI

GPT-5.1 is OpenAI’s advanced reasoning flagship featuring adaptive thinking, native multimodality, and state-of-the-art performance in math and technical...

Kimi K2.5

Moonshot

Discover Moonshot AI's Kimi K2.5, a 1T-parameter open-source agentic model featuring native multimodal capabilities, a 262K context window, and SOTA reasoning.

Grok-4

xAI

Grok-4 by xAI is a frontier model featuring a 2M token context window, real-time X platform integration, and world-record reasoning capabilities.

Claude Opus 4.5

Anthropic

Claude Opus 4.5 is Anthropic's most powerful frontier model, delivering record-breaking 80.9% SWE-bench performance and advanced autonomous agency for coding.

Gemini 3.1 Flash-Lite

Gemini 3.1 Flash-Lite is Google's fastest, most cost-efficient model. Features 1M context, native multimodality, and 363 tokens/sec speed for scale.

Claude Sonnet 4.6

Anthropic

Claude Sonnet 4.6 offers frontier performance for coding and computer use with a massive 1M token context window for only $3/1M tokens.

DeepSeek v4

DeepSeek

DeepSeek v4 is a 1.6T parameter MoE model featuring a 1M token context window and native multimodal support for text, vision, and video at disruptive prices.

Gemini 3 Flash

Gemini 3 Flash is Google's high-speed multimodal model featuring a 1M token context window, elite 90.4% GPQA reasoning, and autonomous browser automation tools.

Questions Fréquentes sur Qwen3.5-397B-A17B

Trouvez des réponses aux questions courantes sur Qwen3.5-397B-A17B