Qwen3.6-Max-Preview

Qwen3.6-Max-Preview est le modèle MoE flagship d'Alibaba doté d'une context window de 1M, d'un Thinking Mode natif et de scores de pointe en codage et...

À propos de Qwen3.6-Max-Preview

Découvrez les capacités, fonctionnalités et façons d'utiliser Qwen3.6-Max-Preview.

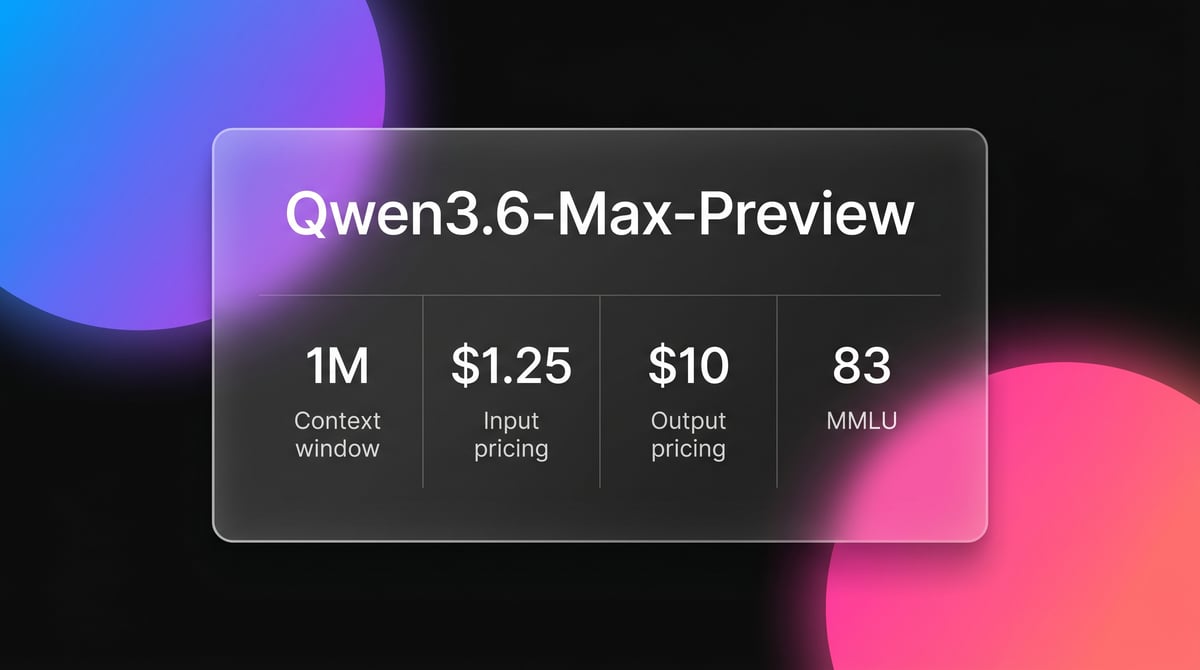

Qwen3.6-Max-Preview est le large language model propriétaire flagship d'Alibaba, représentant la prochaine étape de leur série d'IA haute performance. Utilisant une architecture sparse Mixture-of-Experts (MoE), le modèle atteint la profondeur de raisonnement d'un système à mille milliards de paramètres tout en conservant une efficacité opérationnelle significative. Il est spécifiquement optimisé pour le codage agentic, les connaissances mondiales et le suivi d'instructions complexes.

La caractéristique marquante du modèle est son Thinking Mode natif, qui permet au système de générer une chain-of-thought interne visible avant de fournir une réponse finale. Cette transparence est particulièrement précieuse pour les développeurs qui construisent des agents autonomes, car elle offre une fenêtre claire sur la planification logique et les étapes de correction d'erreurs. Combiné avec une massive context window de 1 million de tokens, le modèle peut ingérer des dépôts de projets entiers ou des bibliothèques de documentation étendues en une seule passe.

Hébergé sur Alibaba Cloud Model Studio, Qwen3.6-Max-Preview prend en charge les protocoles standard de l'industrie et est compatible avec les spécifications API de style OpenAI. Il est conçu pour être le choix principal pour les entreprises nécessitant des capacités d'IA de niveau frontier pour l'analyse de données multimodales et des workflows agentic robustes, offrant une alternative haute performance aux modèles fermés occidentaux.

Cas d'utilisation de Qwen3.6-Max-Preview

Découvrez les différentes façons d'utiliser Qwen3.6-Max-Preview pour obtenir d'excellents résultats.

Ingénierie logicielle autonome

Déployez le modèle en tant qu'agent de codage capable de naviguer dans des bases de code entières, de planifier des changements architecturaux et de corriger des bugs sur plusieurs fichiers.

Analyse technique à grande échelle

Utilisez la context window de 1M tokens pour ingérer des jeux de documentation complets ou des cadres juridiques pour une analyse approfondie sans les limitations du RAG.

Raisonnement et planification complexes

Exploitez le Thinking Mode natif pour résoudre des problèmes mathématiques de haut niveau nécessitant un plan interne en plusieurs étapes pour garantir la précision.

Compréhension de contenu multimodal

Analysez à la fois des images statiques et des séquences vidéo complexes pour extraire des données et résumer des événements visuels dynamiques.

Opérations interactives en terminal

Développez des outils permettant à l'IA d'interagir directement avec des shells et des environnements CLI, en tirant parti de ses performances optimisées sur Terminal-Bench.

Workflows agentic en entreprise

Intégrez le modèle dans des pipelines métier complexes où une fiabilité instructionnelle élevée et un tool-calling sophistiqué sont nécessaires pour l'automatisation.

Points forts

Limitations

Démarrage rapide API

alibaba/qwen3.6-max-preview

import OpenAI from 'openai';

const client = new OpenAI({

apiKey: process.env.DASHSCOPE_API_KEY,

base_url: 'https://dashscope-intl.aliyuncs.com/compatible-mode/v1',

});

async function main() {

const completion = await client.chat.completions.create({

model: 'qwen3.6-max-preview',

messages: [{ role: 'user', content: 'Design a system architecture for a real-time AI agent.' }],

extra_body: { enable_thinking: true },

stream: true

});

for await (const chunk of completion) {

process.stdout.write(chunk.choices[0]?.delta?.content || '');

}

}

main();Installez le SDK et commencez à faire des appels API en quelques minutes.

Ce que les gens disent de Qwen3.6-Max-Preview

Voyez ce que la communauté pense de Qwen3.6-Max-Preview

“Le type de performance que vous attendriez d'un modèle tournant sur une ferme de serveurs massive est maintenant disponible sur votre ordinateur de bureau.”

“Qwen3.6-Max-Preview vient de battre Claude Opus 4.5 sur SWE-Bench Pro. La Chine rattrape son retard rapidement.”

“À 1,25 $ par million de tokens, Qwen est nettement moins cher que Claude pour l'ingestion de données à grande échelle.”

“Le fait que le Thinking Mode soit intégré comme état par défaut est un choix de conception significatif pour la fiabilité agentic.”

“Qwen a lancé Qwen 3.6 Max Preview en tant que nouveau flagship propriétaire haut de gamme.”

“Il montre un codage agentic amélioré et une meilleure fiabilité des agents dans le monde réel par rapport au modèle Plus.”

Vidéos sur Qwen3.6-Max-Preview

Regardez des tutoriels, critiques et discussions sur Qwen3.6-Max-Preview

“Qwen a lancé Qwen 3.6 Max Preview en tant que nouveau flagship propriétaire haut de gamme.”

“Le modèle montre un bond important dans les benchmarks de codage agentic comme SkillsBench et Terminal-Bench 2.0.”

“Qwen tente clairement de rivaliser sérieusement sur le haut de gamme avec des modèles comme Claude 4.5 Opus.”

“Ce modèle représente une amélioration significative dans la connaissance du monde et le suivi d'instructions.”

“Le bond de performance sur SWE-bench est ce qui le distingue vraiment de la variante Plus.”

“L'histoire des benchmarks consiste vraiment à positionner le Max Preview hébergé comme distinct de la famille open-weight.”

“Nous utilisons les pages Qwen Code et les surfaces de repo pour juger la profondeur de l'écosystème au-delà des simples poids du modèle.”

“Le Thinking Mode est étonnamment rapide par rapport aux modèles de style o1 de l'année dernière.”

“Il est clairement conçu pour les développeurs d'entreprise qui ont besoin d'une API fiable pour des tâches agentic.”

“Les performances multimodales en vision rattrapent Gemini 2 dans certains tests d'analyse de documents.”

“Cette vidéo présente le Qwen3.6-Max-Preview, un premier aperçu du prochain flagship de Qwen.”

“Il montre un codage agentic amélioré et une meilleure fiabilité des agents dans le monde réel par rapport au modèle Plus.”

“La context window de 1M est beaucoup plus stable que ce que nous avons vu dans les premières versions de Qwen 2.”

“Si vous faites beaucoup de programmation, Qwen 3.6 Max est actuellement le leader des benchmarks.”

“La tarification reste très compétitive, même pour leur modèle flagship en code fermé.”

Optimisez votre flux de travail avec l'Automatisation IA

Automatio combine la puissance des agents IA, de l'automatisation web et des integrations intelligentes pour vous aider a accomplir plus en moins de temps.

Conseils Pro pour Qwen3.6-Max-Preview

Conseils d'experts pour tirer le meilleur parti de Qwen3.6-Max-Preview.

Activer le raisonnement interne

Définissez le paramètre 'enable_thinking' sur true dans votre requête API pour visualiser la logique interne du modèle et déboguer des raisonnements complexes.

Préserver la logique à long terme

Utilisez la fonctionnalité 'preserve_thinking' pour les conversations multi-tours afin de garantir que le modèle maintient une cohérence logique tout au long de la session.

Alimenter avec des bibliothèques entières

Tirez parti de la context window de 1M en fournissant des ressources sources complètes plutôt que des données fragmentées pour une meilleure compréhension inter-fichiers.

Utiliser des points de terminaison compatibles

Pour les applications mondiales, utilisez les terminaux de Singapour ou de Virginie (États-Unis) dans Alibaba Cloud afin de minimiser la latency régionale pour les utilisateurs internationaux.

Témoignages

Ce Que Disent Nos Utilisateurs

Rejoignez des milliers d'utilisateurs satisfaits qui ont transforme leur flux de travail

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Associés AI Models

GLM-5

Zhipu (GLM)

GLM-5 is Zhipu AI's 744B parameter open-weight powerhouse, excelling in long-horizon agentic tasks, coding, and factual accuracy with a 200k context window.

GLM-5.1

Zhipu (GLM)

GLM-5.1 is Zhipu AI's flagship reasoning model, featuring a 202K context window and an autonomous 8-hour execution loop for complex agentic engineering.

GPT-5.2

OpenAI

GPT-5.2 is OpenAI's flagship model for professional tasks, featuring a 400K context window, elite coding, and deep multi-step reasoning capabilities.

Gemini 3.1 Flash-Lite

Gemini 3.1 Flash-Lite is Google's fastest, most cost-efficient model. Features 1M context, native multimodality, and 363 tokens/sec speed for scale.

Claude Opus 4.5

Anthropic

Claude Opus 4.5 is Anthropic's most powerful frontier model, delivering record-breaking 80.9% SWE-bench performance and advanced autonomous agency for coding.

Grok-4

xAI

Grok-4 by xAI is a frontier model featuring a 2M token context window, real-time X platform integration, and world-record reasoning capabilities.

Kimi K2 Thinking

Moonshot

Kimi K2 Thinking is Moonshot AI's trillion-parameter reasoning model. It outperforms GPT-5 on HLE and supports 300 sequential tool calls autonomously for...

Kimi K2.5

Moonshot

Discover Moonshot AI's Kimi K2.5, a 1T-parameter open-source agentic model featuring native multimodal capabilities, a 262K context window, and SOTA reasoning.

Questions Fréquentes sur Qwen3.6-Max-Preview

Trouvez des réponses aux questions courantes sur Qwen3.6-Max-Preview