Hogyan scrapeljük a pump.fun-t: Technikai útmutató a valós idejű Solana adatokhoz

Ismerje meg, hogyan scrapelheti a pump.fun-t valós idejű Solana token indításokhoz, piaci kapitalizációhoz és bonding curve adatokhoz. Építsen nagyfrekvenciás...

Anti-bot védelem észlelve

- Cloudflare

- Vállalati szintű WAF és botkezelés. JavaScript kihívásokat, CAPTCHA-kat és viselkedéselemzést használ. Böngészőautomatizálás szükséges rejtett beállításokkal.

- Sebességkorlátozás

- IP/munkamenet alapú kéréseket korlátoz időben. Forgó proxykkal, kéréskésleltetéssel és elosztott scrapinggel megkerülhető.

- Böngésző ujjlenyomat

- Botokat azonosít a böngésző jellemzői alapján: canvas, WebGL, betűtípusok, bővítmények. Hamisítás vagy valódi böngészőprofilok szükségesek.

- WebSockets

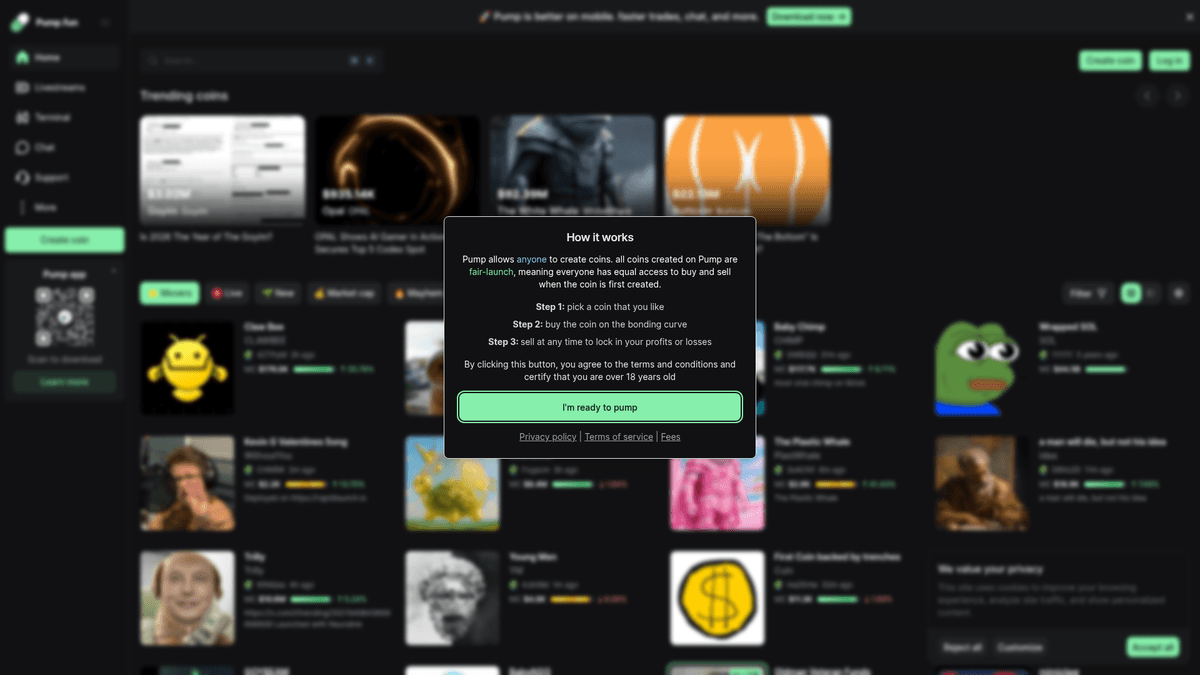

A(z) pump.fun Névjegye

Fedezze fel, mit kínál a(z) pump.fun és milyen értékes adatok nyerhetők ki.

A Solana Meme Coinok Epicentruma

A pump.fun egy decentralizált pénzügyi (DeFi) platform a Solana blockchainen, amely lehetővé teszi a felhasználók számára, hogy azonnal meme coinokat indítsanak kezdeti likviditás biztosítása nélkül. Egy egyedi 'bonding curve' mechanizmust használ, ahol az ár emelkedik, ahogy egyre többen vásárolnak, végül pedig a tokent egy jelentős decentralizált tőzsdére, például a Raydiumra migrálja, amint eléri a meghatározott piaci kapitalizáció küszöböt. A platform a Solana meme coin ökoszisztéma központjává vált, naponta több ezer új token indításának adva otthont.

Nagy Sebességű Token Adatok

Az weboldal valós idejű feedet biztosít az újonnan létrehozott tokenekről, azok piaci kapitalizációjáról, a bonding curve állapotáról és a részletes tranzakciós előzményekről. Tartalmazza továbbá a közösségi linkeket (Twitter/Telegram), a készítő wallet címeit és az élő chat naplókat minden egyes tokenhez. Mivel néhány másodpercenként indulnak új projektek, az oldal egy nagy sebességű adatforrás, amely speciális scraping technikákat igényel a hatékony monitorozáshoz.

Miért Kulcsfontosságúak ezek az Adatok?

A pump.fun scrapelése rendkívül értékes a kripto-kereskedők és fejlesztők számára, akik sniping botokat, sentiment elemző eszközöket vagy rug-pull detektáló szolgáltatásokat építenek. A token metaadatok és a holderek viselkedésének valós idejű kinyerésével a felhasználók azonosíthatják a nagy momentummal rendelkező projekteket, mielőtt azok bekerülnének a fősodratú tőzsdékre, és automatizálhatják a piacra lépést. A meme coin kereskedés magas kockázatai miatt az automatizált adatelőny jelentős versenyelőnyt jelent.

Miért Kell Scrapelni a(z) pump.fun-t?

Fedezze fel a(z) pump.fun-ból történő adatkinyerés üzleti értékét és felhasználási eseteit.

Azonosítsd az új Solana token indításokat a létrehozásuk ezredmásodpercében.

Figyeld a bonding curve mérföldköveit a Raydium migrációk előrejelzéséhez.

Elemezd a készítő wallet előzményeit a sorozatos csalók vagy a sikeres fejlesztők azonosításához.

Gyűjtsd össze a közösségi sentimentet az élő komment feedekből.

Építs automatizált, nagyfrekvenciás sniping botokat a piaci kapitalizáció momentuma alapján.

Nyerd ki a közösségi média linkeket automatizált sentiment elemzéshez az X/Telegram felületeken.

Scraping Kihívások

Technikai kihívások, amelyekkel a(z) pump.fun scrapelésekor találkozhat.

Agresszív Cloudflare védelem, beleértve a 403-as kihívásokat és a JS ujjlenyomat-vételt.

Valós idejű adatfrissítések, amelyek WebSockets-en keresztül érkeznek a szabványos HTTP kérések helyett.

Rendkívül dinamikus DOM struktúra, amely oldalújratöltés nélkül frissül React/Next.js használatával.

Szigorú IP-alapú rate limiting a nagyfrekvenciás kérések esetén.

Magas látencia-érzékenység, ahol minden másodperc számít a kereskedési előny megszerzéséhez.

Scrapeld a pump.fun-t AI-val

Nincs szükség kódolásra. Nyerj ki adatokat percek alatt AI-vezérelt automatizálással.

Hogyan működik

Írd le, mire van szükséged

Mondd el az AI-nak, milyen adatokat szeretnél kinyerni a pump.fun-ról. Csak írd be természetes nyelven — nincs szükség kódra vagy szelektorokra.

Az AI kinyeri az adatokat

Mesterséges intelligenciánk navigál a pump.fun-on, kezeli a dinamikus tartalmat, és pontosan azt nyeri ki, amit kértél.

Kapd meg az adataidat

Kapj tiszta, strukturált adatokat, amelyek készen állnak CSV, JSON exportra vagy közvetlenül az alkalmazásaidba küldésre.

Miért érdemes AI-t használni a scrapeléshez

Az AI megkönnyíti a pump.fun scrapelését kódírás nélkül. Mesterséges intelligenciával működő platformunk megérti, milyen adatokra van szükséged — csak írd le természetes nyelven, és az AI automatikusan kinyeri őket.

How to scrape with AI:

- Írd le, mire van szükséged: Mondd el az AI-nak, milyen adatokat szeretnél kinyerni a pump.fun-ról. Csak írd be természetes nyelven — nincs szükség kódra vagy szelektorokra.

- Az AI kinyeri az adatokat: Mesterséges intelligenciánk navigál a pump.fun-on, kezeli a dinamikus tartalmat, és pontosan azt nyeri ki, amit kértél.

- Kapd meg az adataidat: Kapj tiszta, strukturált adatokat, amelyek készen állnak CSV, JSON exportra vagy közvetlenül az alkalmazásaidba küldésre.

Why use AI for scraping:

- Beépített képesség a Cloudflare és a böngésző ujjlenyomat-vétel automatikus megkerülésére.

- No-code beállítás a komplex JavaScript-renderelt elemekhez és token kártyákhoz.

- Felhőalapú futtatás az 'Új tokenek' feed 24/7-es monitorozásához.

- Közvetlen integráció Webhook-okkal a kereskedő botok azonnali aktiválásához.

No-Code Web Scraperek a pump.fun számára

Kattints-és-válassz alternatívák az AI-alapú scrapeléshez

Számos no-code eszköz, mint a Browse.ai, Octoparse, Axiom és ParseHub segíthet a pump.fun scrapelésében kódírás nélkül. Ezek az eszközök általában vizuális felületeket használnak az adatok kiválasztásához, bár nehézségeik lehetnek összetett dinamikus tartalmakkal vagy anti-bot intézkedésekkel.

Tipikus Munkafolyamat No-Code Eszközökkel

Gyakori Kihívások

Tanulási görbe

A szelektorok és a kinyerési logika megértése időt igényel

Szelektorok elromlanak

A weboldal változásai tönkretehetik a teljes munkafolyamatot

Dinamikus tartalom problémák

JavaScript-gazdag oldalak komplex megoldásokat igényelnek

CAPTCHA korlátozások

A legtöbb eszköz manuális beavatkozást igényel CAPTCHA esetén

IP blokkolás

Az agresszív scraping az IP blokkolásához vezethet

No-Code Web Scraperek a pump.fun számára

Számos no-code eszköz, mint a Browse.ai, Octoparse, Axiom és ParseHub segíthet a pump.fun scrapelésében kódírás nélkül. Ezek az eszközök általában vizuális felületeket használnak az adatok kiválasztásához, bár nehézségeik lehetnek összetett dinamikus tartalmakkal vagy anti-bot intézkedésekkel.

Tipikus Munkafolyamat No-Code Eszközökkel

- Böngésző bővítmény telepítése vagy regisztráció a platformon

- Navigálás a célweboldalra és az eszköz megnyitása

- Adatelemek kiválasztása kattintással

- CSS szelektorok konfigurálása minden adatmezőhöz

- Lapozási szabályok beállítása több oldal scrapeléséhez

- CAPTCHA kezelése (gyakran manuális megoldás szükséges)

- Ütemezés konfigurálása automatikus futtatásokhoz

- Adatok exportálása CSV, JSON formátumba vagy API-n keresztüli csatlakozás

Gyakori Kihívások

- Tanulási görbe: A szelektorok és a kinyerési logika megértése időt igényel

- Szelektorok elromlanak: A weboldal változásai tönkretehetik a teljes munkafolyamatot

- Dinamikus tartalom problémák: JavaScript-gazdag oldalak komplex megoldásokat igényelnek

- CAPTCHA korlátozások: A legtöbb eszköz manuális beavatkozást igényel CAPTCHA esetén

- IP blokkolás: Az agresszív scraping az IP blokkolásához vezethet

Kod peldak

import requests

from bs4 import BeautifulSoup

import json

# Megjegyzés: a pump.fun Cloudflare-t használ. Ez a megközelítés a kezdeti állapotot célozza.

url = 'https://pump.fun/board'

headers = {

'User-Agent': 'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/119.0.0.0 Safari/537.36'

}

try:

session = requests.Session()

response = session.get(url, headers=headers)

if response.status_code == 200:

soup = BeautifulSoup(response.text, 'html.parser')

# A kezdeti tokeneket tartalmazó Next.js adat blob kinyerése

next_data = soup.find('script', id='__NEXT_DATA__')

if next_data:

data = json.loads(next_data.string)

print('Sikeresen kinyertük a kezdeti token adatokat.')

else:

print('Dinamikus tartalom nem található a statikus HTML-ben.')

else:

print(f'Blokkolt a Cloudflare? Státusz: {response.status_code}')

except Exception as e:

print(f'Hiba: {e}')Mikor Használjuk

A legjobb statikus HTML oldalakhoz, ahol a tartalom szerver oldalon töltődik. A leggyorsabb és legegyszerűbb megközelítés, amikor JavaScript renderelés nem szükséges.

Előnyök

- ●Leggyorsabb végrehajtás (nincs böngésző overhead)

- ●Legalacsonyabb erőforrás-fogyasztás

- ●Könnyen párhuzamosítható asyncio-val

- ●Kiváló API-khoz és statikus oldalakhoz

Korlátok

- ●Nem tudja végrehajtani a JavaScriptet

- ●Nem működik SPA-knál és dinamikus tartalmaknál

- ●Problémái lehetnek összetett anti-bot rendszerekkel

How to Scrape pump.fun with Code

Python + Requests

import requests

from bs4 import BeautifulSoup

import json

# Megjegyzés: a pump.fun Cloudflare-t használ. Ez a megközelítés a kezdeti állapotot célozza.

url = 'https://pump.fun/board'

headers = {

'User-Agent': 'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/119.0.0.0 Safari/537.36'

}

try:

session = requests.Session()

response = session.get(url, headers=headers)

if response.status_code == 200:

soup = BeautifulSoup(response.text, 'html.parser')

# A kezdeti tokeneket tartalmazó Next.js adat blob kinyerése

next_data = soup.find('script', id='__NEXT_DATA__')

if next_data:

data = json.loads(next_data.string)

print('Sikeresen kinyertük a kezdeti token adatokat.')

else:

print('Dinamikus tartalom nem található a statikus HTML-ben.')

else:

print(f'Blokkolt a Cloudflare? Státusz: {response.status_code}')

except Exception as e:

print(f'Hiba: {e}')Python + Playwright

import asyncio

from playwright.async_api import async_playwright

async def scrape_pump_fun():

async with async_playwright() as p:

# Stealth beállításokkal való indítás ajánlott

browser = await p.chromium.launch(headless=True)

context = await browser.new_context(

user_agent='Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/121.0.0.0 Safari/537.36'

)

page = await context.new_page()

# Navigáció és várakozás a JS renderelésre

await page.goto('https://pump.fun/board', wait_until='networkidle')

await page.wait_for_selector('.token-card')

tokens = await page.query_selector_all('.token-card')

for token in tokens[:5]:

name = await (await token.query_selector('.name')).inner_text()

mcap = await (await token.query_selector('.market-cap')).inner_text()

print(f'Token: {name} | MCAP: {mcap}')

await browser.close()

asyncio.run(scrape_pump_fun())Python + Scrapy

import scrapy

from scrapy_playwright.page import PageMethod

class PumpFunSpider(scrapy.Spider):

name = 'pump_spider'

def start_requests(self):

yield scrapy.Request(

url='https://pump.fun/board',

meta={

'playwright': True,

'playwright_page_methods': [

PageMethod('wait_for_selector', '.token-card')

]

}

)

def parse(self, response):

for token in response.css('.token-card'):

yield {

'name': token.css('.token-name::text').get(),

'ticker': token.css('.ticker::text').get(),

'mcap': token.css('.mcap-value::text').get(),

}Node.js + Puppeteer

const puppeteer = require('puppeteer-extra');

const StealthPlugin = require('puppeteer-extra-plugin-stealth');

puppeteer.use(StealthPlugin());

(async () => {

const browser = await puppeteer.launch({ headless: true });

const page = await browser.newPage();

await page.goto('https://pump.fun/board', { waitUntil: 'networkidle2' });

// Várunk a token kártyák dinamikus betöltésére

await page.waitForSelector('.token-card');

const data = await page.evaluate(() => {

const cards = Array.from(document.querySelectorAll('.token-card'));

return cards.map(card => ({

name: card.querySelector('.name')?.innerText,

ticker: card.querySelector('.symbol')?.innerText,

mcap: card.querySelector('.market-cap')?.innerText

}));

});

console.log(data);

await browser.close();

})();Mit Tehet a(z) pump.fun Adataival

Fedezze fel a(z) pump.fun adataiból származó gyakorlati alkalmazásokat és betekintéseket.

Valós idejű Meme Coin Sniper

Azonosítsd és vásárold meg az ígéretes új tokeneket abban a pillanatban, ahogy elindulnak a platformon.

Hogyan implementáljuk:

- 1Állíts be egy WebSocket scrapert a 'coinCreated' események figyelésére.

- 2Alkalmazz szűrőket a közösségi linkekre és a készítő hírnevére.

- 3Indíts el egy vásárlási tranzakciót a Solana web3.js segítségével.

- 4Figyeld a bonding curve folyamatát az exit stratégia meghatározásához.

Használja az Automatio-t adatok kinyeréséhez a pump.fun-ből és építse meg ezeket az alkalmazásokat kódírás nélkül.

Mit Tehet a(z) pump.fun Adataival

- Valós idejű Meme Coin Sniper

Azonosítsd és vásárold meg az ígéretes új tokeneket abban a pillanatban, ahogy elindulnak a platformon.

- Állíts be egy WebSocket scrapert a 'coinCreated' események figyelésére.

- Alkalmazz szűrőket a közösségi linkekre és a készítő hírnevére.

- Indíts el egy vásárlási tranzakciót a Solana web3.js segítségével.

- Figyeld a bonding curve folyamatát az exit stratégia meghatározásához.

- Rug-Pull Detektáló Dashboard

Hozz létre egy szolgáltatást, amely a fejlesztői múlt alapján figyelmezteti a kereskedőket a potenciális csalásokra.

- Scrapeld le a készítő wallet címét minden új indításnál.

- Kérdezd le a korábbi adatokat a korábbi tokenjeik élettartamának megtekintéséhez.

- Azonosítsd a 'bundled' indításokat, ahol egy fejlesztő több kezdeti walletet irányít.

- Értesítsd a felhasználókat Telegramon vagy Discordon keresztül.

- Sentiment-Alapú Trendelemzés

Vizualizáld, hogy mely témák (pl. AI, macskák, politika) dominálják jelenleg a Solana ökoszisztémát.

- Scrapeld le a tokenek neveit és leírásait az 'Új' feedből.

- Használj Natural Language Processing technikákat a témák kategorizálásához.

- Számold ki az egyes kategóriák gyakoriságát egy gördülő 24 órás ablakban.

- Ábrázold a trendeket egy dashboardon piackutatási célból.

- Bálna-Mozgás Követő

Figyeld, mely tokeneket halmozzák fel a nagy vagyonnal rendelkező wallet címek.

- Scrapeld le a trendi tokenek részletes kereskedési előzményeit.

- Azonosítsd a visszatérő, nagy vásárlási volumennel rendelkező wallet címeket.

- Állíts be riasztásokat arra az esetre, amikor ezek a 'bálnák' belépnek egy új token indításba.

- Aggregáld a vételi/eladási arányokat a piaci erő meghatározásához.

- Bonding Curve Arbitrázs

Jósold meg, mikor költözik egy token a Raydiumra, hogy profitálj a likviditási változásokból.

- Scrapeld a 'Bonding Curve Progress' százalékot valós időben.

- Számítsd ki a növekedési ütemet 5 perces intervallumokban.

- Azonosítsd a 100%-os küszöbhöz közeli tokeneket.

- Automatizáld a belépést a DEX migráció előtt.

Turbozd fel a munkafolyamatodat AI automatizalasal

Az Automatio egyesiti az AI ugynokk, a web automatizalas es az okos integraciok erejet, hogy segitsen tobbet elerni kevesebb ido alatt.

Profi Tippek a(z) pump.fun Scrapeléséhez

Szakértői tanácsok a(z) pump.fun-ból történő sikeres adatkinyeréshez.

Csípd el a WebSocket (WS) kapcsolatot a böngésző hálózati (network) fülén; a 'coinCreated' események figyelése gyorsabb, mint a DOM scrapelése.

Használj kiváló minőségű residential proxykat az IP-tiltás elkerülése érdekében, különösen több párhuzamos szál futtatásakor.

Célozd meg a 'King of the Hill' szekciót olyan tokenekért, amelyek nagy momentummal rendelkeznek, és várhatóan hamarosan a Raydium platformra kerülnek.

Vesd össze a készítő wallet címeit on-chain adatokkal, hogy kiszűrd azokat a fejlesztőket, akiknek a múltjában rug-pulling szerepel.

Kerüld a scrapelést a Solana hálózat csúcsidőben tapasztalható torlódásai alatt, mivel az oldal adatbetöltése inkonzisztenssé válhat.

Figyeld a __NEXT_DATA__ script taget az oldal kezdeti állapotáért, így elkerülheted a bonyolult React renderelés megvárását.

Velemenyek

Mit mondanak a felhasznaloink

Csatlakozz tobb ezer elegedett felhasznalohoz, akik atalakitottak a munkafolyamatukat

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Kapcsolodo Web Scraping

How to Scrape Yahoo Finance: Extract Stock Market Data

How to Scrape Moon.ly | Step-by-Step NFT Data Extraction Guide

How to Scrape Rocket Mortgage: A Comprehensive Guide

How to Scrape Open Collective: Financial and Contributor Data Guide

How to Scrape jup.ag: Jupiter DEX Web Scraper Guide

How to Scrape Indiegogo: The Ultimate Crowdfunding Data Extraction Guide

How to Scrape ICO Drops: Comprehensive Crypto Data Guide

How to Scrape Crypto.com: Comprehensive Market Data Guide

Gyakran ismetelt kerdesek a pump.fun-rol

Talalj valaszokat a pump.fun-val kapcsolatos gyakori kerdesekre