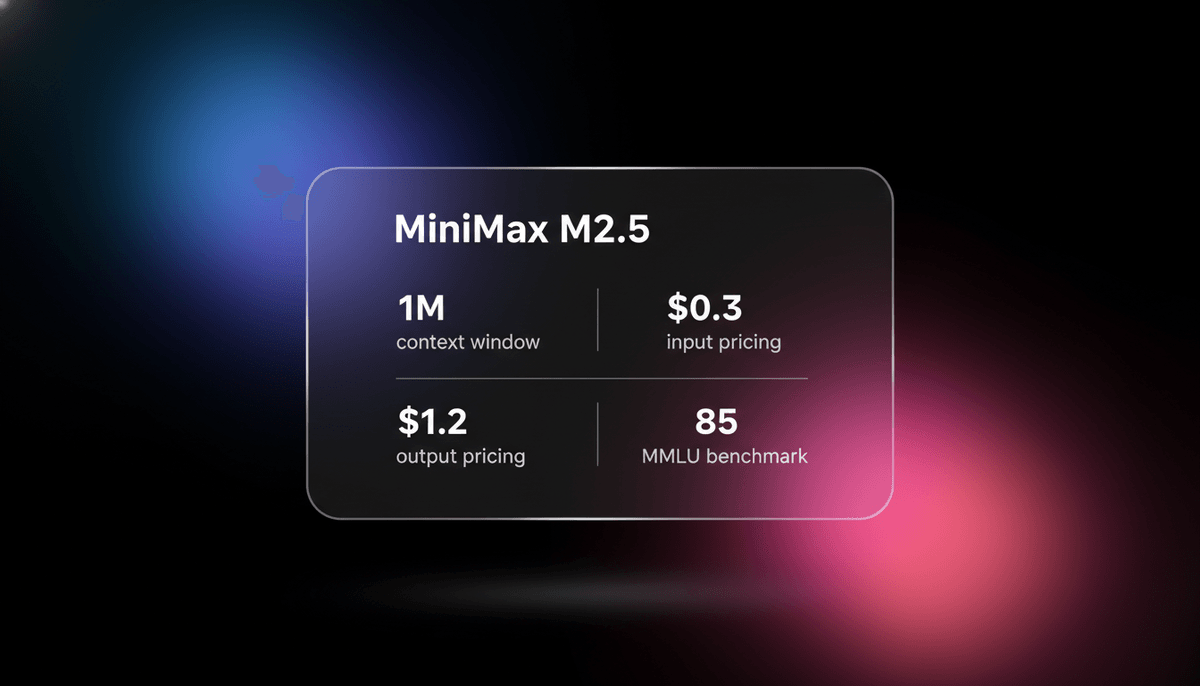

MiniMax M2.5

MiniMax M2.5 è un model MoE SOTA con context window da 1M di token ed elite agentic coding capabilities a prezzi dirompenti per agenti autonomi.

Informazioni su MiniMax M2.5

Scopri le capacita di MiniMax M2.5, le funzionalita e come puo aiutarti a ottenere risultati migliori.

Architettura Efficient Frontier

MiniMax M2.5 è un frontier model ad alta efficienza costruito su un'architettura Mixture-of-Experts (MoE) da 230B. Attivando solo 10 miliardi di parameters per passata, raggiunge velocità di inference e strutture di pricing quasi 20 volte più efficienti dei colossi proprietari. È progettato specificamente per l'intelligenza agentic, privilegiando la logica strutturata e la pianificazione multi-step rispetto alle semplici chat. Questo design sparse consente al model di mantenere un'intelligenza elevata senza l'enorme carico di calcolo dei model dense tradizionali.

Coding Intelligence Avanzata

La caratteristica distintiva del model è la sua Mentalità da Architetto, che gli consente di visualizzare strutture logiche e gerarchie di progetto prima di generare codice. Questo lo rende particolarmente efficace per l'ingegneria del software autonoma, dove eguaglia lo state-of-the-art con un punteggio dell'80,2% su SWE-Bench Verified. Con un context window da 1 milione di token, può ingerire intere codebase, consentendo audit approfonditi dei repository e complessi refactoring di sistema che in precedenza erano proibitivi in termini di costi.

Enterprise e Deployment Locale

MiniMax M2.5 supporta oltre 10 linguaggi di programmazione e un throughput nativo fino a 100 token al secondo nella sua variante lightning. Poiché è disponibile come open-weight model, gli sviluppatori possono distribuirlo localmente per la massima privacy dei dati, mantenendo l'accesso allo stesso reasoning di alto livello presente nell'API hostata. Questa versatilità lo rende una scelta pratica sia per pipeline di agenti cloud-based che per tool di sviluppo on-premise.

Casi d'uso per MiniMax M2.5

Scopri i diversi modi in cui puoi usare MiniMax M2.5 per ottenere ottimi risultati.

Ingegneria del Software Autonoma

Risoluzione di problemi GitHub reali e debugging su più file utilizzando harness agentici.

Pipeline di Agenti Enterprise

Supporto per agenti in background sempre attivi per ricerca e sintesi dati a bassi costi API.

Modernizzazione di Codice Legacy

Refactoring di enormi repository obsoleti verso framework moderni mantenendo gli standard logici.

Code Review Architetturali

Analisi delle gerarchie di progetto per fornire feedback logici e suggerimenti di ottimizzazione strutturale.

Editing Documentale ad alto volume

Elaborazione di file di grandi dimensioni con alta fedeltà per modellazione finanziaria e legale.

Tool di Sviluppo a bassa latenza

Ideale per estensioni IDE e CLI tool che richiedono tempi di risposta inferiori al secondo.

Punti di forza

Limitazioni

Avvio rapido API

minimax/minimax-m2.5

import OpenAI from 'openai';

const client = new OpenAI({

apiKey: process.env.MINIMAX_API_KEY,

baseURL: 'https://api.minimax.io/v1',

});

async function main() {

const response = await client.chat.completions.create({

model: 'minimax-m2.5',

messages: [{ role: 'user', content: 'Progetta un'architettura a microservizi per un'app fintech.' }],

temperature: 0.1,

});

console.log(response.choices[0].message.content);

}

main();Installa l'SDK e inizia a fare chiamate API in pochi minuti.

Cosa dice la gente su MiniMax M2.5

Guarda cosa pensa la community di MiniMax M2.5

“Il pricing di MiniMax M2.5 è la vera notizia, abbastanza economico da cambiare l'architettura, non solo i budget.”

“M2.5 sta raggiungendo numeri da state-of-the-art ed è un model con 10B di parameters attivi, il che significa che è veloce ed economico.”

“Il model riduce il carico di lavoro che gli utenti dovevano fare solo per mantenere le cose in movimento.”

“M2.5 sta eguagliando il throughput di Claude Opus 4.6 a una frazione del costo.”

“Eseguire M2.5 localmente su un Mac Studio è scattante. I 10B di params attivi fanno davvero la differenza.”

“Lo step di pianificazione architetturale intercetta gli errori logici ancora prima che venga scritta una sola riga di codice.”

Video su MiniMax M2.5

Guarda tutorial, recensioni e discussioni su MiniMax M2.5

“È quasi 20 volte più economico delle migliori opzioni proprietarie.”

“Questo è un model di coding e agentic di alto livello, molto più veloce ed estremamente più economico.”

“Le performance su SWE-bench verified lo pongono davvero nella categoria d'élite.”

“Ottieni intelligenza da frontier model con requisiti hardware open-source.”

“L'architettura MoE qui è ottimizzata perfettamente per task di coding a bassa latenza.”

“MiniMax offre il model al 3% del costo di Opus 4.6 in termini di token in output.”

“Il costo dell'intelligenza si sta avvicinando al costo dell'elettricità a questo punto.”

“Gestisce context window per grandi repository senza i soliti dimenticanze tipiche.”

“Per i tool di sviluppo, la velocità della variante lightning è un enorme vantaggio UX.”

“È la prima volta che vedo un model così economico risolvere bug logici complessi.”

“Costa solo $1 eseguire il model continuamente per un'ora a 100 token al secondo.”

“Il ragionamento interno brilla davvero qui perché può correggersi immediatamente.”

“Testandolo contro GPT-4o, fornisce costantemente migliori refactoring su più file.”

“Le capacità agentic sono integrate, non solo un'aggiunta dell'ultimo minuto nel prompt.”

“È essenzialmente gratuito per i piccoli sviluppatori dati i livelli di prezzo per l'input.”

Potenzia il tuo workflow con l'automazione AI

Automatio combina la potenza degli agenti AI, dell'automazione web e delle integrazioni intelligenti per aiutarti a fare di piu in meno tempo.

Consigli Pro per MiniMax M2.5

Consigli esperti per aiutarti a ottenere il massimo da MiniMax M2.5 e raggiungere risultati migliori.

Adotta la mentalità da Architetto

Chiedi al model di generare una struttura di progetto prima di richiedere il codice di implementazione vero e proprio.

Sfrutta il context window da 1M

Fornisci la documentazione completa o interi moduli per garantire una consapevolezza globale della tua codebase.

Usa il piano HighSpeed

Seleziona l'endpoint M2.5-HighSpeed per ottenere 100 token al secondo costanti per agenti interattivi.

Raffinamento iterativo

Chiedi al model di rivedere il suo output iniziale per individuare lacune logiche o vulnerabilità di sicurezza.

Testimonianze

Cosa dicono i nostri utenti

Unisciti a migliaia di utenti soddisfatti che hanno trasformato il loro workflow

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Correlati AI Models

DeepSeek-V3.2-Speciale

DeepSeek

DeepSeek-V3.2-Speciale is a reasoning-first LLM featuring gold-medal math performance, DeepSeek Sparse Attention, and a 131K context window. Rivaling GPT-5...

MiMo V2.5 Pro

Other

MiMo V2.5 Pro is Xiaomi's open-source 1.02T parameter MoE model featuring a 1M context window, native multimodality, and elite agentic coding performance.

Claude 3.7 Sonnet

Anthropic

Claude 3.7 Sonnet is Anthropic's first hybrid reasoning model, delivering state-of-the-art coding capabilities, a 200k context window, and visible thinking.

Gemini 3.5 Flash

Gemini 3.5 Flash is Google's high-speed multimodal model with a 1M context window, optimized for sub-second agentic loops and complex coding tasks.

Qwen 3.7 Max

alibaba

Qwen 3.7 Max is Alibaba’s flagship AI model for deep reasoning and autonomous agent tasks, featuring a 256k context window and top-tier coding performance.

Qwen3.5-Omni

alibaba

Qwen3.5-Omni is a natively omnimodal AI by Alibaba Cloud, offering seamless audio-visual reasoning, real-time voice chat, and 256k context for low-latency apps.

DeepSeek v4

DeepSeek

DeepSeek v4 is a 1.6T parameter MoE model featuring a 1M token context window and native multimodal support for text, vision, and video at disruptive prices.

GPT-5.5

OpenAI

GPT-5.5 is OpenAI's flagship frontier model with a 1M context window and five reasoning effort levels, optimized for autonomous agentic workflows and coding.

Domande frequenti su MiniMax M2.5

Trova risposte alle domande comuni su MiniMax M2.5