Qwen3.5-397B-A17B

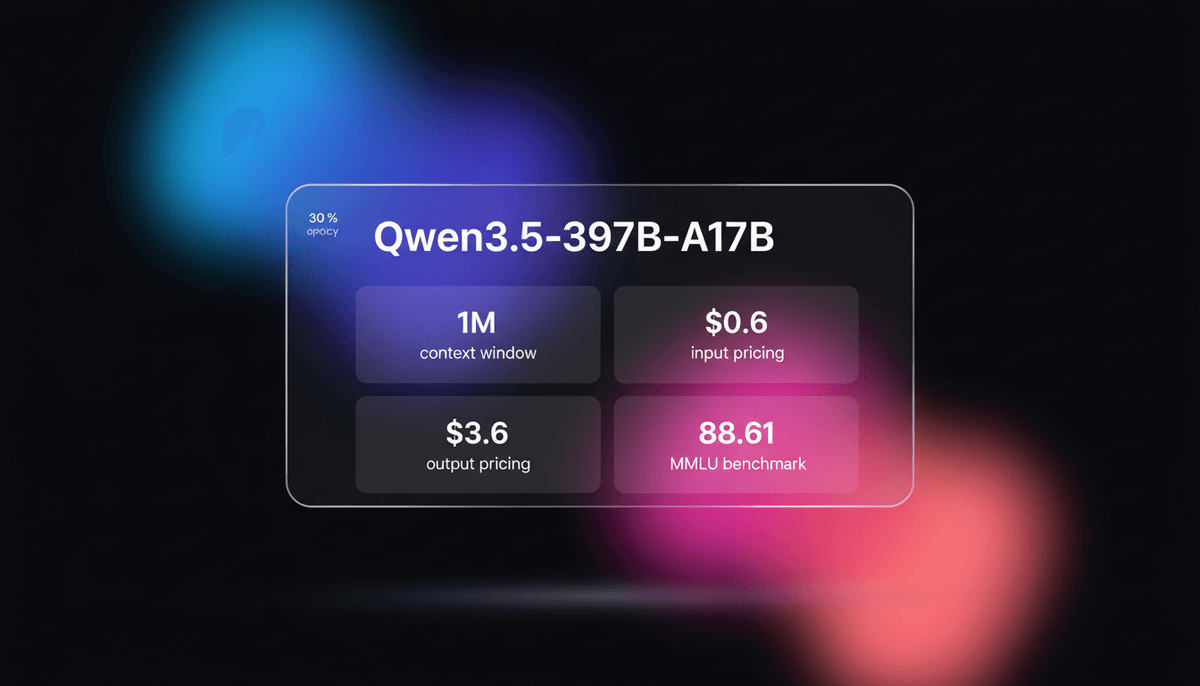

Qwen3.5-397B-A17B è il model MoE open-weight flagship di Alibaba. Presenta reasoning multimodale nativo, una context window di 1M e un throughput di decoding...

Informazioni su Qwen3.5-397B-A17B

Scopri le capacita di Qwen3.5-397B-A17B, le funzionalita e come puo aiutarti a ottenere risultati migliori.

Mixture of Experts ad alta efficienza

Qwen3.5-397B-A17B è un flagship model multimodale nativo che utilizza un'architettura ibrida innovativa che fonde l'attenzione lineare attraverso Gated Delta Networks con una Mixture-of-Experts (MoE) sparsa. Sebbene contenga 397 miliardi di parametri totali, il suo design sparso attiva solo 17 miliardi di parametri per passata, ottenendo un'eccezionale efficienza e velocità di inference senza compromettere le sue vaste capacità di reasoning. È ottimizzato sia per il linguaggio che per i task visivi, supportando un vasto vocabolario di 250k tokens e offrendo supporto per oltre 201 lingue e dialetti.

Flussi di lavoro Agentic Multimodali Nativi

Il model eccelle come agente multimodale nativo, in grado di elaborare fino a un milione di tokens di context, equivalenti a circa due ore di video. Introduce una Thinking Mode specializzata per il ragionamento logico complesso ed è equipaggiato nativamente per flussi di lavoro agentic, inclusi sviluppo web, navigazione GUI e intelligenza spaziale nel mondo reale. La sua architettura supporta l'addestramento FP8 end-to-end e un framework di training-inference disaggregato, rendendolo uno dei modelli più scalabili ed efficienti per applicazioni AI di livello enterprise.

Open Weights per l'Accessibilità Globale

Rilasciato sotto licenza Apache 2.0, questo model fornisce alla comunità open-source capacità di livello frontier precedentemente limitate ai sistemi proprietari. Colma il divario tra conteggi massicci di parametri e deployment pratico, consentendo alle organizzazioni di eseguire task di reasoning all'avanguardia su infrastrutture private con un overhead di calcolo significativamente inferiore rispetto alle alternative dense da 400B.

Casi d'uso per Qwen3.5-397B-A17B

Scopri i diversi modi in cui puoi usare Qwen3.5-397B-A17B per ottenere ottimi risultati.

Analisi Video a Lungo Termine

Analizza fino a due ore di contenuti video per estrarre logica, eseguire reverse-engineering di codice da filmati o generare riassunti strutturati.

Ricerca STEM di Livello PhD

Risolvi problemi scientifici di livello PhD e quesiti matematici di livello olimpico utilizzando la sua modalità di deep-thinking adattiva.

Agenti GUI Autonomi

Automatizza le interazioni con smartphone e computer per gestire flussi di lavoro d'ufficio e navigazione mobile tra le app.

Ingegneria Software Visuale

Esegui 'vibe coding' trasformando istruzioni in linguaggio naturale e bozzetti UI in codice frontend funzionale.

Document Intelligence

Elabora documenti complessi, grafici e bozzetti scritti a mano per estrarre dati strutturati e ricavare il layout.

Applicazioni AI Spaziali

Comprendi le relazioni a livello di pixel per task di embodied AI come l'analisi di scene di guida autonoma e la navigazione robotica.

Punti di forza

Limitazioni

Avvio rapido API

alibaba/qwen3.5-plus

import OpenAI from 'openai';

const client = new OpenAI({

apiKey: process.env.DASHSCOPE_API_KEY,

baseURL: 'https://dashscope-intl.aliyuncs.com/compatible-mode/v1',

});

async function main() {

const completion = await client.chat.completions.create({

model: 'qwen3.5-plus',

messages: [{ role: 'user', content: 'Analizza la logica di questa architettura MoE.' }],

extra_body: { enable_thinking: true },

});

console.log(completion.choices[0].message.content);

}

main();Installa l'SDK e inizia a fare chiamate API in pochi minuti.

Cosa dice la gente su Qwen3.5-397B-A17B

Guarda cosa pensa la community di Qwen3.5-397B-A17B

“Qwen3.5-397B è essenzialmente un model di classe GPT-5 ma open-weight. L'architettura DeltaNet sta risolvendo perfettamente i problemi di latency MoE.”

“Il reasoning multimodale nativo su Qwen3.5 sembra incredibile. 1M di context + analisi video cambierà i flussi di lavoro degli agenti.”

“La decisione di utilizzare l'addestramento FP8 end-to-end mantenendo BF16 negli strati sensibili è un capolavoro di ottimizzazione della stabilità.”

“Questa è la prima volta che vedo un model aperto superare davvero Gemini 1.5 Pro in task multimodali complessi per agenti.”

“Il miglioramento del throughput di decoding 19x rispetto a Qwen3-Max lo rende un'alternativa valida per agenti a livello di produzione.”

“Sono rimasto sorpreso da come gestisce la quantizzazione a 4-bit. Mantiene quasi tutta la capacità di reasoning su un setup dual A100.”

Video su Qwen3.5-397B-A17B

Guarda tutorial, recensioni e discussioni su Qwen3.5-397B-A17B

“Un model da 397 miliardi di parametri, ma con 17 miliardi attivi.”

“Quando esegue il decoding a 256K, questo model è 19 volte più veloce di Qwen 3 Max.”

“Il reasoning multimodale nativo è ciò che lo distingue per i flussi di lavoro agentic.”

“Supera la maggior parte dei modelli chiusi sui benchmark matematici standard.”

“Eseguirlo localmente è dura, ma le versioni quantizzate sono utilizzabili su Mac di fascia alta.”

“Model da 397 miliardi di parametri con 17 miliardi attivi. È nativamente multimodale.”

“È probabilmente il miglior model multimodale open-source al momento.”

“La capacità di elaborare due ore di video nativamente è un enorme vantaggio.”

“Guarda questi punteggi logici, sta raggiungendo costantemente i livelli di GPT-4o.”

“La licenza Apache lo rende molto interessante per la privacy dei dati aziendali.”

“Estrazione strutturata OCR. Hai un PDF disordinato... e devi trasformarlo in JSON pulito. Questo model eccelle in questo.”

“Ottieni l'intelligenza di un gigante da 400 miliardi di parametri... ma paghi il costo di calcolo di un model da 17 miliardi.”

“Gestisce il recupero di contesti lunghi meglio della versione precedente.”

“L'integrazione del tool use è incorporata nell'addestramento di base, non è un ripensamento.”

“La modalità di pensiero gli permette di correggere la propria logica prima di produrre l'output.”

Potenzia il tuo workflow con l'automazione AI

Automatio combina la potenza degli agenti AI, dell'automazione web e delle integrazioni intelligenti per aiutarti a fare di piu in meno tempo.

Consigli Pro per Qwen3.5-397B-A17B

Consigli esperti per aiutarti a ottenere il massimo da Qwen3.5-397B-A17B e raggiungere risultati migliori.

Attiva la Thinking Mode

Passa il parameter 'enable_thinking: true' nella tua chiamata API per attivare il deep reasoning per matematica, coding e puzzle logici complessi.

Utilizza la Fast Mode

Usa la modalità 'Fast' per query semplici per ottenere risposte istantanee senza consumare tokens in fasi di pensiero interno non necessarie.

Ottimizza i prompt video

Quando analizzi un video, chiedi al model di concentrarsi sul risultato dinamico finale piuttosto che su un'analisi frame-by-frame per una migliore coerenza temporale.

Sfrutta la quantizzazione

Usa la quantizzazione a 4-bit o 8-bit (GGUF/EXL2) per eseguire il model su hardware di livello consumer se disponi di VRAM sufficiente (200GB+).

Testimonianze

Cosa dicono i nostri utenti

Unisciti a migliaia di utenti soddisfatti che hanno trasformato il loro workflow

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Correlati AI Models

GPT-5.1

OpenAI

GPT-5.1 is OpenAI’s advanced reasoning flagship featuring adaptive thinking, native multimodality, and state-of-the-art performance in math and technical...

Kimi K2.5

Moonshot

Discover Moonshot AI's Kimi K2.5, a 1T-parameter open-source agentic model featuring native multimodal capabilities, a 262K context window, and SOTA reasoning.

Grok-4

xAI

Grok-4 by xAI is a frontier model featuring a 2M token context window, real-time X platform integration, and world-record reasoning capabilities.

Claude Opus 4.5

Anthropic

Claude Opus 4.5 is Anthropic's most powerful frontier model, delivering record-breaking 80.9% SWE-bench performance and advanced autonomous agency for coding.

Gemini 3.1 Flash-Lite

Gemini 3.1 Flash-Lite is Google's fastest, most cost-efficient model. Features 1M context, native multimodality, and 363 tokens/sec speed for scale.

Claude Sonnet 4.6

Anthropic

Claude Sonnet 4.6 offers frontier performance for coding and computer use with a massive 1M token context window for only $3/1M tokens.

DeepSeek v4

DeepSeek

DeepSeek v4 is a 1.6T parameter MoE model featuring a 1M token context window and native multimodal support for text, vision, and video at disruptive prices.

Gemini 3 Flash

Gemini 3 Flash is Google's high-speed multimodal model featuring a 1M token context window, elite 90.4% GPQA reasoning, and autonomous browser automation tools.

Domande frequenti su Qwen3.5-397B-A17B

Trova risposte alle domande comuni su Qwen3.5-397B-A17B