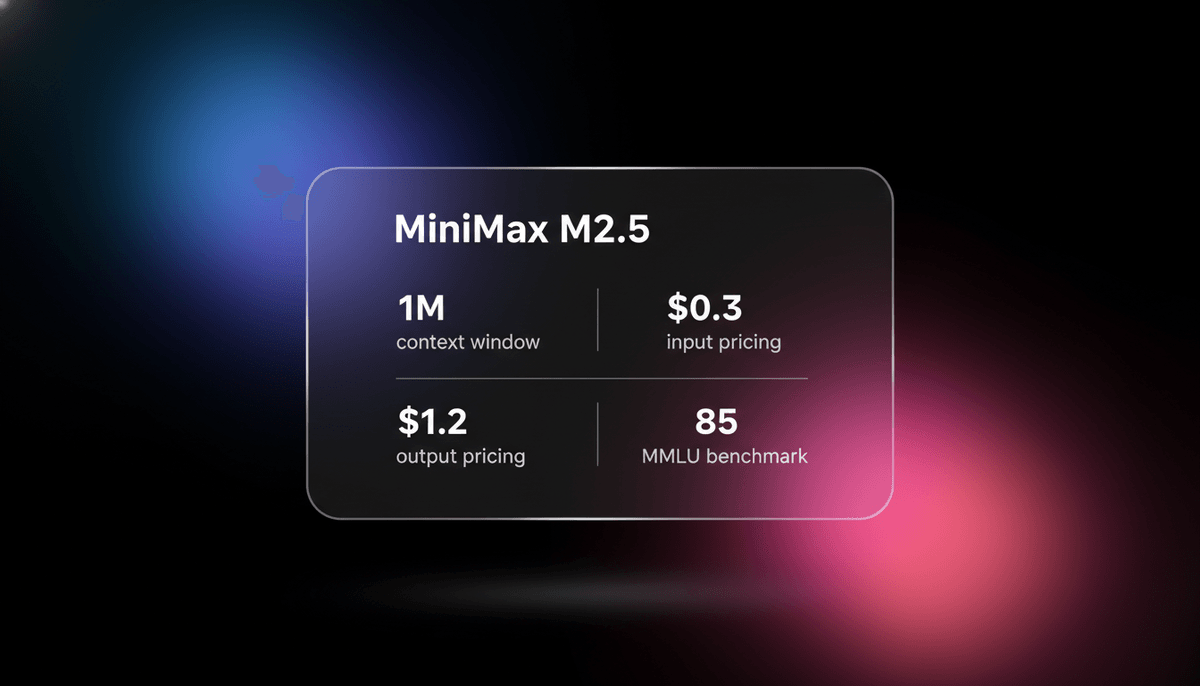

MiniMax M2.5

MiniMax M2.5は、1M tokensのcontext windowとエリート級の自律型エージェント機能を備えた、価格破壊的なSOTA MoEモデルです。

MiniMax M2.5について

MiniMax M2.5の機能、特徴、そしてより良い結果を得るための方法について学びましょう。

高効率なフロンティア・アーキテクチャ

MiniMax M2.5は、230B Mixture-of-Experts (MoE) アーキテクチャを基盤とした、高効率なフロンティアモデルです。フォワードパスごとにわずか100億parametersのみをアクティブ化することで、既存の巨大な独自モデルよりも約20倍も効率的な推論速度と価格設定を実現しました。本モデルは特にエージェントとしての知性を目指して設計されており、単純なチャット応答よりも構造的な論理と多段階の計画策定を優先しています。このsparseな設計により、従来のdenseモデルのような膨大な計算リソースを必要とせずに、高いインテリジェンスを維持しています。

先端的なコーディング能力

このモデルの最大の特長は、コードを生成する前に論理構造やプロジェクトの階層を可視化する「アーキテクトのマインドセット」です。これにより、自律型ソフトウェアエンジニアリングにおいて特に強力な効果を発揮し、SWE-Bench Verifiedで80.2%というSOTAクラスのスコアを達成しました。100万tokensのcontext windowにより、コードベース全体を読み込み、これまではコスト的に不可能だった大規模なリポジトリ監査や複雑なシステムリファクタリングが可能です。

エンタープライズとローカルデプロイ

MiniMax M2.5は10以上のプログラミング言語をサポートし、Lightningバリアントでは最大毎秒100 tokensのスループットを実現します。また、Open-Weightsモデルとして提供されているため、開発者はデータプライバシーを完全に確保しつつ、ホスト型APIと同等の論理推論能力をローカルで利用可能です。この多様性により、クラウドベースのエージェントパイプラインだけでなく、オンプレミスのデベロッパーツールとしても現実的な選択肢となっています。

MiniMax M2.5のユースケース

MiniMax M2.5を使って素晴らしい結果を得るさまざまな方法を発見してください。

自律型ソフトウェアエンジニアリング

エージェントを活用し、GitHubの課題解決や複数ファイルにわたるデバッグを自動化します。

エンタープライズエージェントパイプライン

APIコストを抑えつつ、調査やデータ合成を行う常時稼働のバックグラウンドエージェントを構築します。

レガシーコードの近代化

大規模な古いリポジトリを、論理的標準を維持しながら最新のフレームワークへリファクタリングします。

アーキテクチャコードレビュー

プロジェクト階層を分析し、論理フィードバックや構造最適化のための提案を行います。

大量ドキュメントの編集

金融や法務モデリング向けに、膨大なオフィスファイルを高精度で処理します。

低latencyデベロッパーツール

1秒未満の応答速度が求められるIDE拡張機能やCLIツールを駆動します。

強み

制限

APIクイックスタート

minimax/minimax-m2.5

import OpenAI from 'openai';

const client = new OpenAI({

apiKey: process.env.MINIMAX_API_KEY,

baseURL: 'https://api.minimax.io/v1',

});

async function main() {

const response = await client.chat.completions.create({

model: 'minimax-m2.5',

messages: [{ role: 'user', content: 'Fintechアプリのためのマイクロサービスアーキテクチャを設計してください。' }],

temperature: 0.1,

});

console.log(response.choices[0].message.content);

}

main();SDKをインストールして、数分でAPIコールを開始しましょう。

MiniMax M2.5についてのユーザーの声

MiniMax M2.5についてコミュニティがどう思っているか見てください

“MiniMax M2.5の価格設定こそが本題。単なる予算削減ではなく、アーキテクチャそのものを変えるほどの安さだ。”

“M2.5はSOTAレベルの数値を出しているのに10Bのアクティブparameterモデルという点が凄い。つまり、速くて安いということだ。”

“このモデルのおかげで、ワークフローを維持するためにユーザーが行っていた重労働が大幅に軽減された。”

“M2.5はClaude Opus 4.6のスループットに匹敵しながら、コストはごく一部だ。”

“Mac StudioでM2.5をローカル動作させているが、非常にキビキビ動く。10Bのアクティブparamsが効いている。”

“アーキテクチャ計画のステップがあることで、コードを1行も書く前に論理エラーを検知できる。”

MiniMax M2.5についての動画

MiniMax M2.5についてのチュートリアル、レビュー、ディスカッションを見る

“主要な独自モデルと比べて約20倍も安価です。”

“これはトップクラスのコーディング・エージェントモデルで、非常に高速かつ大幅に安価です。”

“SWE-bench verifiedでの性能は、まさにエリート級と言えます。”

“オープンソースハードウェアの要件で、フロンティアレベルの知性を手に入れられます。”

“このMoEアーキテクチャは、低latencyのコーディングタスクに完璧に調整されています。”

“MiniMaxは、Opus 4.6の出力コストのわずか3%でモデルを提供しています。”

“知性のコストが、実質的に電気代と同程度になりつつあります。”

“大規模リポジトリのcontext windowを扱っても、途中で忘れることはありません。”

“デベロッパーツールにおいて、このLightningバリアントの速度はUX上の大きな勝利です。”

“これほど安価なモデルが複雑な論理バグを解決できるのを初めて見ました。”

“毎秒100 tokensで1時間継続して実行しても、コストはわずか1ドルです。”

“その内部思考プロセスが非常に優秀で、即座に軌道修正が可能です。”

“GPT-4oと比較して、より優れた複数ファイルのリファクタリングを継続的に提供してくれます。”

“エージェント機能が内蔵されており、単なるプロンプトのおまけではありません。”

“入力の価格体系を考えると、小規模な開発者にとっては実質無料で利用できます。”

ワークフローを強化する AI自動化

AutomatioはAIエージェント、ウェブ自動化、スマート統合のパワーを組み合わせ、より短時間でより多くのことを達成するお手伝いをします。

MiniMax M2.5のプロのヒント

MiniMax M2.5を最大限に活用し、より良い結果を得るための専門家のヒント。

アーキテクトのマインドセットを採用する

実際の実装コードを要求する前に、プロジェクト構造を生成するようモデルに指示してください。

1Mのcontext windowを活用する

コードベース全体をモデルが把握できるよう、完全なドキュメントやモジュール全体を提供してください。

HighSpeedプランを利用する

インタラクティブなエージェント向けには、毎秒100 tokensの安定した速度を実現するM2.5-HighSpeedエンドポイントを選択してください。

反復的な改善

モデルに生成された初期出力をレビューさせ、論理的な不備やセキュリティの脆弱性をチェックさせてください。

お客様の声

ユーザーの声

ワークフローを変革した何千人もの満足したユーザーに加わりましょう

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

関連 AI Models

DeepSeek-V3.2-Speciale

DeepSeek

DeepSeek-V3.2-Speciale is a reasoning-first LLM featuring gold-medal math performance, DeepSeek Sparse Attention, and a 131K context window. Rivaling GPT-5...

MiMo V2.5 Pro

Other

MiMo V2.5 Pro is Xiaomi's open-source 1.02T parameter MoE model featuring a 1M context window, native multimodality, and elite agentic coding performance.

Claude 3.7 Sonnet

Anthropic

Claude 3.7 Sonnet is Anthropic's first hybrid reasoning model, delivering state-of-the-art coding capabilities, a 200k context window, and visible thinking.

Qwen 3.7 Max

alibaba

Qwen 3.7 Max is Alibaba’s flagship AI model for deep reasoning and autonomous agent tasks, featuring a 256k context window and top-tier coding performance.

Qwen3.5-Omni

alibaba

Qwen3.5-Omni is a natively omnimodal AI by Alibaba Cloud, offering seamless audio-visual reasoning, real-time voice chat, and 256k context for low-latency apps.

DeepSeek v4

DeepSeek

DeepSeek v4 is a 1.6T parameter MoE model featuring a 1M token context window and native multimodal support for text, vision, and video at disruptive prices.

GPT-5.5

OpenAI

GPT-5.5 is OpenAI's flagship frontier model with a 1M context window and five reasoning effort levels, optimized for autonomous agentic workflows and coding.

Kimi k2.6

Moonshot

Kimi k2.6 is Moonshot AI's 1T-parameter MoE model featuring a 256K context window, native video input, and elite performance in autonomous agentic coding.

MiniMax M2.5についてのよくある質問

MiniMax M2.5に関するよくある質問への回答を見つけてください