Qwen3.6-Max-Preview

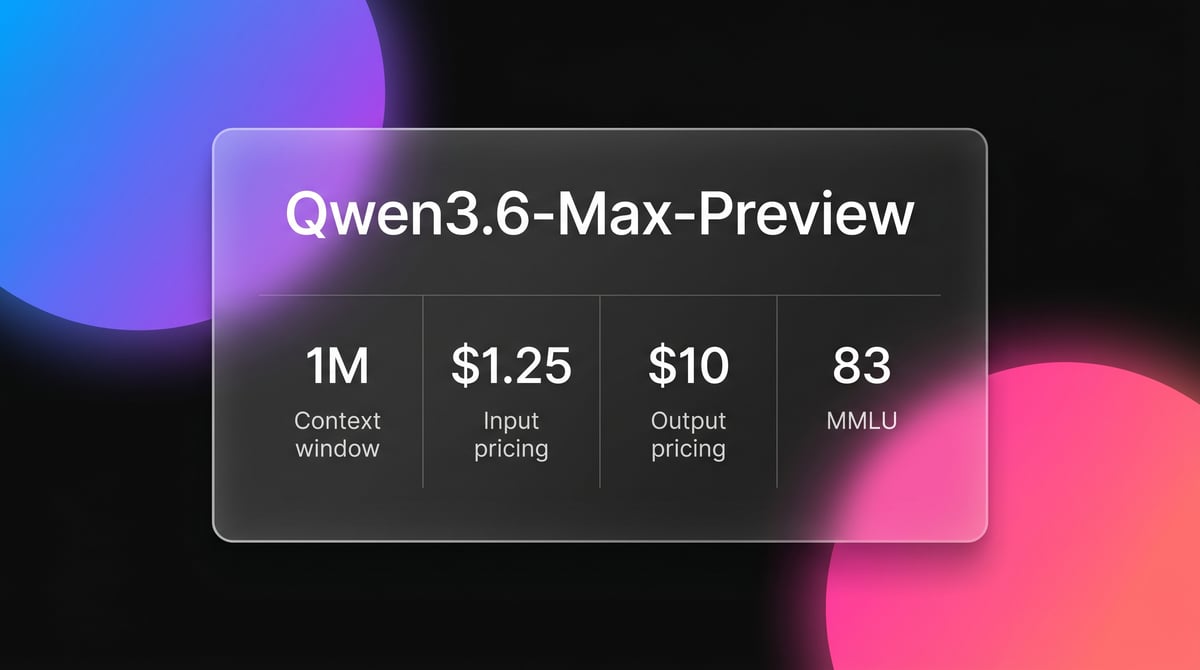

Qwen3.6-Max-Previewは、1M context window、ネイティブなThinking Mode、コーディングおよび推論において最高レベルのスコアを誇るAlibabaのフラッグシップMoEモデルです。

Qwen3.6-Max-Previewについて

Qwen3.6-Max-Previewの機能、特徴、そしてより良い結果を得るための方法について学びましょう。

Qwen3.6-Max-Previewは、Alibabaが提供するフラッグシップのプロプライエタリなLLMであり、高性能AIシリーズにおける次なるステップを象徴するものです。疎なMixture-of-Experts (MoE)アーキテクチャを採用することで、1兆パラメータ規模の推論の深さを実現しつつ、高い運用効率を維持しています。特にagenticなコーディング、世界知識、複雑な指示への追従のために最適化されています。

このモデルの最大の特徴は、ネイティブなThinking Modeです。これにより、システムは最終回答を出す前に可視化された内部のchain-of-thoughtを生成できます。この透明性は、自律型agentを構築する開発者にとって、論理的な計画やエラー修正のステップを明確に把握できるため、極めて重要です。さらに、100万tokenのcontext windowを組み合わせることで、プロジェクトのリポジトリ全体や膨大なドキュメントライブラリを一度のパスで読み込むことが可能です。

Alibaba Cloud Model StudioでホストされるQwen3.6-Max-Previewは、業界標準プロトコルをサポートし、OpenAIスタイルのAPI仕様と互換性があります。マルチモーダルなデータ分析や堅牢なagenticワークフローのために、frontierレベルのAI機能を必要とする企業にとって最適な選択肢となるよう設計されており、欧米のクローズドソースモデルに代わる高性能な代替案を提供します。

Qwen3.6-Max-Previewのユースケース

Qwen3.6-Max-Previewを使って素晴らしい結果を得るさまざまな方法を発見してください。

自律的なソフトウェアエンジニアリング

コードベース全体を探索し、アーキテクチャの変更を計画し、複数のファイルにわたるバグを修正できるコーディングagentとしてモデルを展開します。

大規模な技術分析

1M tokenのcontext windowを活用し、RAGの制限を受けずに、ドキュメントセットや法規制フレームワーク全体を読み込ませて詳細な分析を行います。

高度な推論と計画策定

ネイティブなThinking Modeを活用し、精度向上のために複数ステップの内部計画が必要となるハイレベルな数学的問題を解決します。

マルチモーダルコンテンツの理解

静止画像と複雑な動画シーケンスの両方を分析し、データの抽出や動的な視覚イベントの要約を行います。

インタラクティブなターミナル操作

AIがシェルやCLI環境と直接対話できるようにツールを構築し、Terminal-Benchで最適化されたパフォーマンスを最大限に活用します。

エンタープライズ向けのAgenticワークフロー

指示に対する高い信頼性と、自動化に不可欠な高度なtool-callingが必要な複雑なビジネスパイプラインにモデルを統合します。

強み

制限

APIクイックスタート

alibaba/qwen3.6-max-preview

import OpenAI from 'openai';

const client = new OpenAI({

apiKey: process.env.DASHSCOPE_API_KEY,

base_url: 'https://dashscope-intl.aliyuncs.com/compatible-mode/v1',

});

async function main() {

const completion = await client.chat.completions.create({

model: 'qwen3.6-max-preview',

messages: [{ role: 'user', content: 'Design a system architecture for a real-time AI agent.' }],

extra_body: { enable_thinking: true },

stream: true

});

for await (const chunk of completion) {

process.stdout.write(chunk.choices[0]?.delta?.content || '');

}

}

main();SDKをインストールして、数分でAPIコールを開始しましょう。

Qwen3.6-Max-Previewについてのユーザーの声

Qwen3.6-Max-Previewについてコミュニティがどう思っているか見てください

“大規模なサーバーファームで動作するモデルから期待されるようなパフォーマンスが、今やデスクトップで利用可能だ。”

“Qwen3.6-Max-PreviewがSWE-Bench ProでClaude Opus 4.5を破った。中国の追い上げは速い。”

“100万tokenあたり1.25ドルというのは、大規模データを取り込む際にClaudeよりも大幅に安い。”

“Thinking Modeがデフォルト状態で組み込まれているという事実は、agenticな信頼性にとって有意義な設計上の選択だ。”

“Qwenは、新しいトップエンドのプロプライエタリなフラッグシップモデルとしてQwen 3.6 Max Previewをリリースした。”

“Plusモデルと比較して、改善されたコーディング機能と、より優れた実環境でのagentの信頼性を示している。”

Qwen3.6-Max-Previewについての動画

Qwen3.6-Max-Previewについてのチュートリアル、レビュー、ディスカッションを見る

“Qwenは、新しいトップエンドのプロプライエタリなフラッグシップモデルとしてQwen 3.6 Max Previewをリリースしました。”

“このモデルは、SkillsBenchやTerminal-Bench 2.0のようなコーディングagentのbenchmarkで強力な飛躍を見せています。”

“Qwenは、Claude 4.5 Opusのようなモデルに対してハイエンドで真剣に競おうとしていることは明らかです。”

“このモデルは、世界的な知識と指示への追従において有意義な向上を示しています。”

“SWE-benchでのパフォーマンス向上が、Plusバリアントとの真の違いです。”

“benchmarkの背景にある物語は、ホスト型のMax Previewをオープンウェイトのファミリーと明確に区別することにあります。”

“私たちはQwenのコードページやリポジトリのサーフェスを使用して、モデルウェイトだけでなくエコシステムの深みを評価しています。”

“Thinking Modeは、昨年のo1スタイルのモデルと比較して驚くほど高速です。”

“これは、agenticなタスクのために信頼性の高いAPIを必要とするエンタープライズ開発者向けに設計されているのは明らかです。”

“マルチモーダルな視覚パフォーマンスは、一部のドキュメント分析テストにおいてGemini 2に追いつきつつあります。”

“このビデオでは、Qwenの次期フラッグシップモデルの早期プレビュー版であるQwen3.6-Max-Previewを紹介します。”

“Plusモデルと比較して、改善されたコーディング機能と、より優れた実環境でのagentの信頼性を示しています。”

“1Mのcontext windowは、初期のQwen 2バージョンで見られたものよりもはるかに安定しています。”

“多くのコーディングを行う場合、Qwen 3.6 Maxは現在ベンチマークのリーダーです。”

“フラッグシップのクローズドソースモデルであっても、価格設定は依然として非常に競争力があります。”

ワークフローを強化する AI自動化

AutomatioはAIエージェント、ウェブ自動化、スマート統合のパワーを組み合わせ、より短時間でより多くのことを達成するお手伝いをします。

Qwen3.6-Max-Previewのプロのヒント

Qwen3.6-Max-Previewを最大限に活用し、より良い結果を得るための専門家のヒント。

内部推論(Thinking Mode)の有効化

APIリクエストで 'enable_thinking' パラメータを true に設定すると、モデルの内部ロジックを確認でき、複雑な推論のデバッグに役立ちます。

長期的な論理整合性の保持

マルチターン会話では 'preserve_thinking' 機能を使用し、セッション全体を通じてモデルの論理的な一貫性を維持してください。

ライブラリ全体を読み込ませる

1Mのcontext windowを最大限に活用し、データを分割するのではなくソースコード全体を入力することで、ファイル間を跨いだ理解精度を向上させましょう。

互換性のあるエンドポイントの使用

グローバルなアプリケーション開発では、Alibaba Cloudのシンガポールまたは米国バージニアのエンドポイントを使用し、国際的なユーザーへのlatencyを最小限に抑えてください。

お客様の声

ユーザーの声

ワークフローを変革した何千人もの満足したユーザーに加わりましょう

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

関連 AI Models

GLM-5

Zhipu (GLM)

GLM-5 is Zhipu AI's 744B parameter open-weight powerhouse, excelling in long-horizon agentic tasks, coding, and factual accuracy with a 200k context window.

GLM-5.1

Zhipu (GLM)

GLM-5.1 is Zhipu AI's flagship reasoning model, featuring a 202K context window and an autonomous 8-hour execution loop for complex agentic engineering.

GPT-5.2

OpenAI

GPT-5.2 is OpenAI's flagship model for professional tasks, featuring a 400K context window, elite coding, and deep multi-step reasoning capabilities.

Gemini 3.1 Flash-Lite

Gemini 3.1 Flash-Lite is Google's fastest, most cost-efficient model. Features 1M context, native multimodality, and 363 tokens/sec speed for scale.

Claude Opus 4.5

Anthropic

Claude Opus 4.5 is Anthropic's most powerful frontier model, delivering record-breaking 80.9% SWE-bench performance and advanced autonomous agency for coding.

Grok-4

xAI

Grok-4 by xAI is a frontier model featuring a 2M token context window, real-time X platform integration, and world-record reasoning capabilities.

Kimi K2 Thinking

Moonshot

Kimi K2 Thinking is Moonshot AI's trillion-parameter reasoning model. It outperforms GPT-5 on HLE and supports 300 sequential tool calls autonomously for...

Kimi K2.5

Moonshot

Discover Moonshot AI's Kimi K2.5, a 1T-parameter open-source agentic model featuring native multimodal capabilities, a 262K context window, and SOTA reasoning.

Qwen3.6-Max-Previewについてのよくある質問

Qwen3.6-Max-Previewに関するよくある質問への回答を見つけてください