Kimi K2.5

Ontdek Kimi K2.5 van Moonshot AI, een 1T-parameter open-source agentic model met native multimodale mogelijkheden, een 262K context window en SOTA reasoning.

Over Kimi K2.5

Leer over de mogelijkheden van Kimi K2.5, functies en hoe het je kan helpen betere resultaten te behalen.

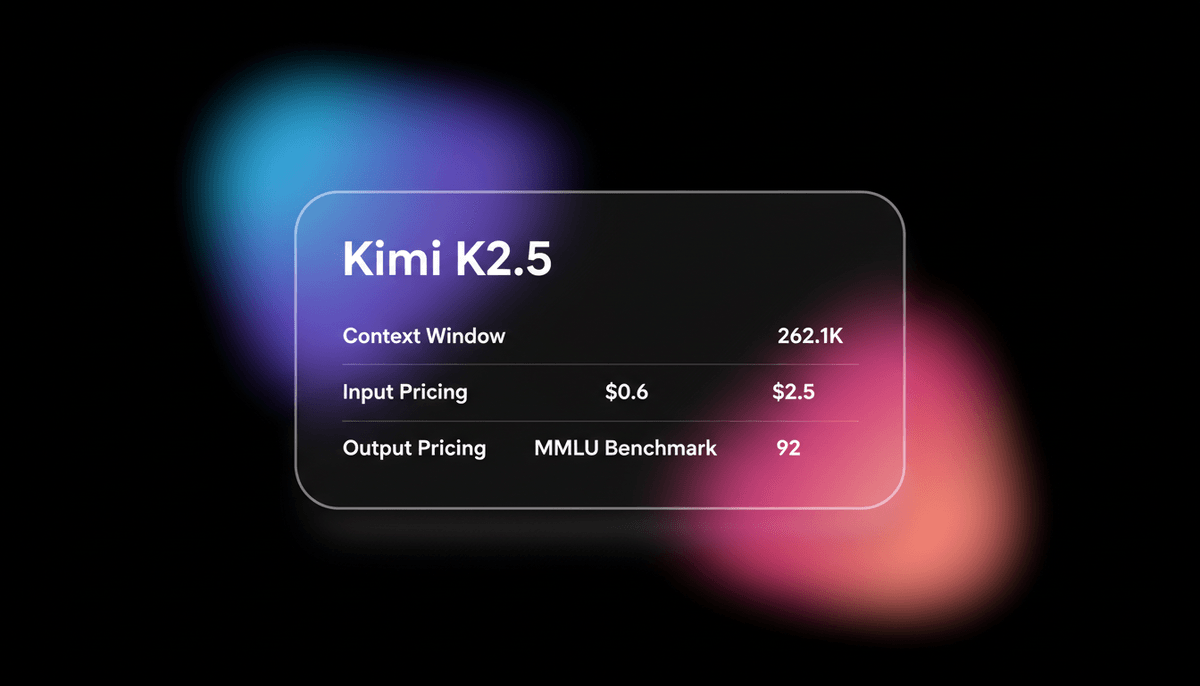

Kimi K2.5 is een open-source multimodaal model van Moonshot AI. Het gebruikt een 1 biljoen parameter Mixture-of-Experts architectuur waarbij 32 miljard parameters actief zijn per token. Het systeem verenigt tekst-, beeld- en videoverwerking via één reasoning-framework, in plaats van aparte externe encoders per modaliteit te gebruiken. Deze architectuur stelt het model in staat om 256.000 tokens aan context te verwerken met behoud van een hoge retrieval-nauwkeurigheid en logische consistentie over zeer lange sequenties.

Het model onderscheidt zich door de Agent Swarm-mogelijkheid. Deze functie stelt het systeem in staat om tot 100 parallelle sub-agents te coördineren voor het gelijktijdig uitvoeren van complexe onderzoeks- of engineeringtaken. Door de integratie van een 400M parameter MoonViT-3D encoder kan K2.5 uren aan videobeelden analyseren met temporele precisie. Het is specifiek ontworpen voor autonome executie en presteert beter dan veel propriëtaire modellen op agentic benchmarks zoals SWE-Bench en BrowseComp.

Kimi K2.5 biedt een speciale Thinking-modus voor taken die diepe logica vereisen. Wanneer deze is ingeschakeld, genereert het model een interne chain-of-reasoning om stappen zelf te corrigeren en te verifiëren voordat er een definitief antwoord wordt gegeven. Dit maakt het uiterst effectief voor wiskunde op competitieniveau en grootschalige softwareontwikkeling. De token-economie is geoptimaliseerd voor enterprise-implementatie en biedt frontier-niveau intelligentie tegen een fractie van de kosten van concurrerende closed-source systemen.

Gebruikscases voor Kimi K2.5

Ontdek de verschillende manieren waarop je Kimi K2.5 kunt gebruiken voor geweldige resultaten.

Autonome software-engineering

Het oplossen van complexe GitHub-issues en het bouwen van projectarchitecturen met meerdere bestanden met behulp van SWE-Bench geoptimaliseerde logica.

Visuele webontwikkeling

Functionele frontend-code en UI-ontwerpen maken op basis van schermopnames van bestaande website-interacties.

Multi-threaded onderzoek

Gebruik van Agent Swarm om informatie te verzamelen en te synthetiseren uit meer dan 100 bronnen in één parallelle workflow.

Lange video-analyse

Specifieke gebeurtenissen en temporele data extraheren uit uren aan beveiligings- of collegebeelden zonder externe tools voor frame-extractie.

Genereren van wiskundige bewijzen

Toepassen van de deep thinking-modus om wiskundige problemen op olympiade-niveau op te lossen met een nauwkeurigheidspercentage van 96 procent.

Enterprise document-automatisering

Genereren van PDF-rapporten van meerdere pagina's en complexe financiële spreadsheets op basis van ongestructureerde bedrijfsdata.

Sterke punten

Beperkingen

API snelstart

fireworks/kimi-k2p5

import OpenAI from 'openai';

const client = new OpenAI({ apiKey: process.env.KIMI_API_KEY, baseURL: 'https://api.moonshot.cn/v1' });

async function main() {

const res = await client.chat.completions.create({

model: 'kimi-k2.5',

messages: [

{ role: 'system', content: 'You are Kimi, a reasoning agent.' },

{ role: 'user', content: 'Design a parallel research plan for quantum computing trends.' }

],

extra_body: { thinking: { type: 'enabled' } }

});

console.log(res.choices[0].message.content);

}

main();Installeer de SDK en begin binnen enkele minuten met API-calls.

Wat mensen zeggen over Kimi K2.5

Bekijk wat de community denkt over Kimi K2.5

“Kimi K2.5 kost bijna 10 procent van wat Opus kost bij een vergelijkbaar prestatieniveau.”

“Mensen vergeten dat Nvidia 600 miljard dollar verloor toen een Chinees lab iets belangrijks open-source maakte. Kimi doet dat nu opnieuw met frontier-intelligentie.”

“Het Attention Residuals-concept in K2.5 is de eerste architecturale verandering in jaren die het LLM 'vergeet'-probleem echt oplost.”

“Workers AI draait nu grote modellen. Kimi K2.5 als eerste. Het is een van de beste open-source modellen die er zijn, ook erg goed voor coding.”

“Kimi K2.5 is een ander beest. Het is een slim en ongelooflijk RP-model, maar het kan neurotisch worden als je geen community-presets gebruikt.”

“Ik heb mijn GPT 4-workflow vervangen door Kimi K2.5 omdat de thinking-modus transparanter is en de context window mijn hele repo aankan.”

Video's over Kimi K2.5

Bekijk tutorials, reviews en discussies over Kimi K2.5

“Kimmy K2.5 verslaat GPT 5.2 met krachtige reasoning; het vernietigt de andere frontier models volledig.”

“Het is tot op heden het krachtigste open-source coding-model met een score van 76.8 op SWE verified.”

“Agent swarm is een verschuiving van single-agent naar multi-agent die parallelle workflows uitvoert over maximaal 1500 gecoördineerde stappen.”

“De context window is enorm met 256k tokens, wat ruim voldoende is voor de meeste projecten.”

“Moonshot verlegt echt de grenzen van wat open weights kunnen doen begin 2026.”

“Het wist de hele Apple design-esthetiek perfect te vangen en produceerde een goed uitziende website met animaties op basis van enkel een video.”

“De Swarm-functie ziet er erg gaaf uit en is zeker leuk om te gebruiken, omdat het ID-badges toewijst aan elke sub-agent.”

“K2.5 is veel goedkoper met 60 cent per miljoen input tokens en 3 dollar per miljoen output tokens.”

“Dankzij de native videoverwerking hoef je geen dure externe tools te gebruiken voor het verwerken van frames.”

“Dit model is een game changer voor developers die autonoom opererende agents nodig hebben met een beperkt budget.”

“Moonshot bereikte dit door elke sub-agent beloningen te geven op specifieke kritieke fasen om seriële collapse te voorkomen.”

“Het model leert alleen voor parallellisme te kiezen wanneer het dit kritieke pad verkort, wat een zeer slimme innovatie is.”

“Kimi K2.5 zit net op de grens van wat op consumentenhardware gedraaid kan worden met GGUF.”

“De thinking-modus is ongelooflijk robuust voor het oplossen van complexe logische fouten in Python.”

“Het zien van een 1 biljoen parameter model dat op deze manier wordt uitgebracht, is enorm voor de open-source community.”

Supercharge je workflow met AI-automatisering

Automatio combineert de kracht van AI-agents, webautomatisering en slimme integraties om je te helpen meer te bereiken in minder tijd.

Pro-tips voor Kimi K2.5

Experttips om je te helpen het maximale uit Kimi K2.5 te halen en betere resultaten te behalen.

Thinking-modus inschakelen

Gebruik de thinking parameter in je API-request om maximale nauwkeurigheid te bereiken bij wiskundige en programmeertaken.

Agent Swarm activeren

Instrueer het model om een swarm in te zetten voor onderzoekstaken om parallelle orchestratie over sub-agents af te dwingen.

Temperatuur optimaliseren

Gebruik een temperatuur van 1.0 voor de thinking-modus om diverse reasoning toe te staan, maar verlaag deze naar 0.6 voor standaard chats.

Joint Vision Prompts

Upload schermafbeeldingen van foutmeldingen bij code-snippets om gebruik te maken van de gecombineerde text-vision training van het model.

Context Caching

Gebruik context caching voor herhaalde lange documenten om de inputkosten met wel 90 procent te verlagen.

Testimonials

Wat onze gebruikers zeggen

Sluit je aan bij duizenden tevreden gebruikers die hun workflow hebben getransformeerd

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Gerelateerd AI Models

Grok-4

xAI

Grok-4 by xAI is a frontier model featuring a 2M token context window, real-time X platform integration, and world-record reasoning capabilities.

GPT-5.1

OpenAI

GPT-5.1 is OpenAI’s advanced reasoning flagship featuring adaptive thinking, native multimodality, and state-of-the-art performance in math and technical...

Claude Opus 4.5

Anthropic

Claude Opus 4.5 is Anthropic's most powerful frontier model, delivering record-breaking 80.9% SWE-bench performance and advanced autonomous agency for coding.

Gemini 3.1 Flash-Lite

Gemini 3.1 Flash-Lite is Google's fastest, most cost-efficient model. Features 1M context, native multimodality, and 363 tokens/sec speed for scale.

Qwen3.5-397B-A17B

alibaba

Qwen3.5-397B-A17B is Alibaba's flagship open-weight MoE model. It features native multimodal reasoning, a 1M context window, and a 19x decoding throughput...

GLM-5.1

Zhipu (GLM)

GLM-5.1 is Zhipu AI's flagship reasoning model, featuring a 202K context window and an autonomous 8-hour execution loop for complex agentic engineering.

Qwen3.6-Max-Preview

alibaba

Qwen3.6-Max-Preview is Alibaba's flagship MoE model featuring 1M context, a native thinking mode, and SOTA scores in agentic coding and reasoning.

GLM-5

Zhipu (GLM)

GLM-5 is Zhipu AI's 744B parameter open-weight powerhouse, excelling in long-horizon agentic tasks, coding, and factual accuracy with a 200k context window.

Veelgestelde vragen over Kimi K2.5

Vind antwoorden op veelvoorkomende vragen over Kimi K2.5