Qwen3.5-397B-A17B

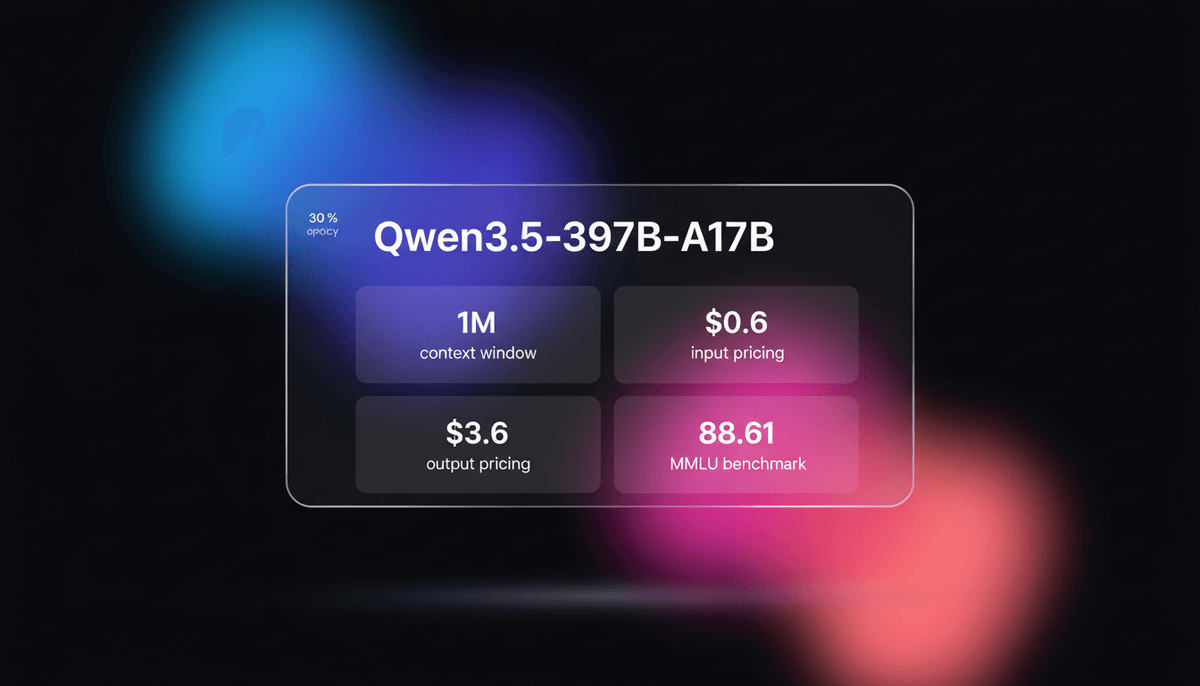

Qwen3.5-397B-A17B is Alibaba's flagship open-weight MoE model. Het beschikt over native multimodal reasoning, een 1M context window en een 19x hogere decoding...

Over Qwen3.5-397B-A17B

Leer over de mogelijkheden van Qwen3.5-397B-A17B, functies en hoe het je kan helpen betere resultaten te behalen.

High-Efficiency Mixture of Experts

Qwen3.5-397B-A17B is een flagship native multimodal model dat gebruikmaakt van een innovatieve hybride architectuur die lineaire aandacht via Gated Delta Networks combineert met een sparse Mixture-of-Experts (MoE). Hoewel het in totaal 397 miljard parameters bevat, activeert het sparse ontwerp slechts 17 miljard parameters per forward pass, wat uitzonderlijke inference-efficiëntie en snelheid oplevert zonder in te leveren op de enorme reasoning-capaciteiten. Het is geoptimaliseerd voor zowel taal- als visuele taken, ondersteunt een enorme woordenschat van 250k tokens en biedt ondersteuning voor meer dan 201 talen en dialecten.

Native multimodal agentic workflows

Het model blinkt uit als een native multimodal agent, in staat om tot één miljoen tokens aan context te verwerken, wat gelijk staat aan ongeveer twee uur video. Het introduceert een gespecialiseerde Thinking Mode voor complexe logische redeneringen en is standaard uitgerust voor agentic workflows, waaronder webontwikkeling, GUI-navigatie en ruimtelijke intelligentie in de echte wereld. De architectuur ondersteunt FP8 end-to-end training en een gedesaggregeerd training-inference framework, waardoor het een van de meest schaalbare en efficiënte modellen is voor AI-applicaties op ondernemingsniveau.

Open weights voor wereldwijde toegankelijkheid

Uitgebracht onder de Apache 2.0 licentie, biedt dit model de open-source gemeenschap frontier-level mogelijkheden die voorheen beperkt waren tot propriëtaire systemen. Het overbrugt de kloof tussen enorme parameteraantallen en praktische implementatie, waardoor organisaties state-of-the-art reasoning taken op private infrastructuur kunnen draaien met aanzienlijk lagere compute-overhead dan dense 400B alternatieven.

Gebruikscases voor Qwen3.5-397B-A17B

Ontdek de verschillende manieren waarop je Qwen3.5-397B-A17B kunt gebruiken voor geweldige resultaten.

Video-analyse op lange termijn

Analyseer tot twee uur aan videocontent om logica te extraheren, code reverse-engineeren vanuit beeldmateriaal of gestructureerde samenvattingen te genereren.

STEM-onderzoek op PhD-niveau

Los wetenschappelijke vraagstukken op PhD-niveau en wiskundige problemen op olympiade-niveau op met behulp van de adaptieve deep-thinking modus.

Autonome GUI-agents

Automatiseer interacties met smartphones en computers voor kantoorworkflows en navigatie tussen mobiele apps.

Visuele software engineering

Voer 'vibe coding' uit door instructies in natuurlijke taal en UI-schetsen om te zetten in functionele frontend code.

Documentintelligentie

Verwerk complexe documenten, grafieken en handgeschreven schetsen om gestructureerde data te extraheren en lay-outs te reverse-engineeren.

Spatial AI-applicaties

Begrijp relaties op pixelniveau voor embodied AI-taken zoals analyse van autonome rijscènes en robotnavigatie.

Sterke punten

Beperkingen

API snelstart

alibaba/qwen3.5-plus

import OpenAI from 'openai';

const client = new OpenAI({

apiKey: process.env.DASHSCOPE_API_KEY,

baseURL: 'https://dashscope-intl.aliyuncs.com/compatible-mode/v1',

});

async function main() {

const completion = await client.chat.completions.create({

model: 'qwen3.5-plus',

messages: [{ role: 'user', content: 'Analyseer de logica van deze MoE architectuur.' }],

extra_body: { enable_thinking: true },

});

console.log(completion.choices[0].message.content);

}

main();Installeer de SDK en begin binnen enkele minuten met API-calls.

Wat mensen zeggen over Qwen3.5-397B-A17B

Bekijk wat de community denkt over Qwen3.5-397B-A17B

“Qwen3.5-397B is in essentie een model van GPT-5 klasse, maar dan open-weight. De DeltaNet-architectuur lost de MoE latency-problemen perfect op.”

“Native multimodal reasoning op Qwen3.5 ziet er ongelooflijk uit. 1M context + video-analyse gaat agent workflows veranderen.”

“De beslissing om FP8 end-to-end training te gebruiken terwijl BF16 behouden blijft in gevoelige lagen is een meesterwerk in stabiliteitsoptimalisaties.”

“Dit is de eerste keer dat ik een open model zie dat Gemini 1.5 Pro daadwerkelijk verslaat op complexe multimodale agent-taken.”

“De 19x verbetering in decoding throughput ten opzichte van Qwen3-Max maakt dit een levensvatbaar alternatief voor agents op productieniveau.”

“Ik was verrast door hoe goed het omgaat met 4-bit kwantisatie. Het behoudt bijna al het reasoning-vermogen op een dual A100 setup.”

Video's over Qwen3.5-397B-A17B

Bekijk tutorials, reviews en discussies over Qwen3.5-397B-A17B

“Een model met 397 miljard parameters, maar met 17 miljard parameters actief.”

“Bij decoding op 256K is dit model 19 keer sneller dan Qwen 3 Max.”

“De native vision-language reasoning is wat dit model onderscheidt voor agentic workflows.”

“Dit verslaat de meeste closed models op de standaard wiskunde-benchmarks.”

“Dit lokaal draaien is zwaar, maar de gekwantiseerde versies werken op high-end Macs.”

“397 miljard parameter model met 17 miljard actieve parameters. Het is native multimodal.”

“Het is waarschijnlijk momenteel het beste open-source multimodal model.”

“De mogelijkheid om twee uur video native te verwerken is een enorm voordeel.”

“Kijk naar deze logica-scores, het bereikt consistent GPT-4o niveaus.”

“De Apache-licentie maakt dit zeer aantrekkelijk voor zakelijke gegevensprivacy.”

“OCR gestructureerde extractie. Je hebt een slordige PDF... en je moet dat omzetten naar schone JSON. Dit model blinkt daarin uit.”

“Je krijgt de intelligentie van een gigant met 400 miljard parameters... maar je betaalt de compute-kosten van een model met 17 miljard parameters.”

“Het verwerkt long-context retrieval beter dan de vorige versie.”

“De tool use-integratie is ingebouwd in de basistraining, geen achteraf toegevoegde functie.”

“Thinking mode stelt het in staat om zijn eigen logica te corrigeren voor de output.”

Supercharge je workflow met AI-automatisering

Automatio combineert de kracht van AI-agents, webautomatisering en slimme integraties om je te helpen meer te bereiken in minder tijd.

Pro-tips voor Qwen3.5-397B-A17B

Experttips om je te helpen het maximale uit Qwen3.5-397B-A17B te halen en betere resultaten te behalen.

Schakel Thinking Mode in

Geef de parameter 'enable_thinking: true' mee in je API call om deep reasoning voor wiskunde, coding en complexe logische puzzels te activeren.

Gebruik Fast Mode

Gebruik de 'Fast' modus voor eenvoudige vragen om direct antwoorden te krijgen zonder tokens te verbruiken voor onnodige interne denkfasen.

Optimaliseer video prompts

Bij het analyseren van video kun je het model het beste vragen om zich te focussen op de uiteindelijke dynamische uitkomst in plaats van frame-voor-frame analyse, voor een betere temporele coherentie.

Maak gebruik van kwantisatie

Gebruik 4-bit of 8-bit kwantisatie (GGUF/EXL2) om het model op consumentenhardware te draaien als je over voldoende VRAM beschikt (200GB+).

Testimonials

Wat onze gebruikers zeggen

Sluit je aan bij duizenden tevreden gebruikers die hun workflow hebben getransformeerd

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Gerelateerd AI Models

GPT-5.1

OpenAI

GPT-5.1 is OpenAI’s advanced reasoning flagship featuring adaptive thinking, native multimodality, and state-of-the-art performance in math and technical...

Kimi K2.5

Moonshot

Discover Moonshot AI's Kimi K2.5, a 1T-parameter open-source agentic model featuring native multimodal capabilities, a 262K context window, and SOTA reasoning.

Grok-4

xAI

Grok-4 by xAI is a frontier model featuring a 2M token context window, real-time X platform integration, and world-record reasoning capabilities.

Claude Opus 4.5

Anthropic

Claude Opus 4.5 is Anthropic's most powerful frontier model, delivering record-breaking 80.9% SWE-bench performance and advanced autonomous agency for coding.

Gemini 3.1 Flash-Lite

Gemini 3.1 Flash-Lite is Google's fastest, most cost-efficient model. Features 1M context, native multimodality, and 363 tokens/sec speed for scale.

Claude Sonnet 4.6

Anthropic

Claude Sonnet 4.6 offers frontier performance for coding and computer use with a massive 1M token context window for only $3/1M tokens.

DeepSeek v4

DeepSeek

DeepSeek v4 is a 1.6T parameter MoE model featuring a 1M token context window and native multimodal support for text, vision, and video at disruptive prices.

Gemini 3 Flash

Gemini 3 Flash is Google's high-speed multimodal model featuring a 1M token context window, elite 90.4% GPQA reasoning, and autonomous browser automation tools.

Veelgestelde vragen over Qwen3.5-397B-A17B

Vind antwoorden op veelvoorkomende vragen over Qwen3.5-397B-A17B