Qwen3.6-Max-Preview

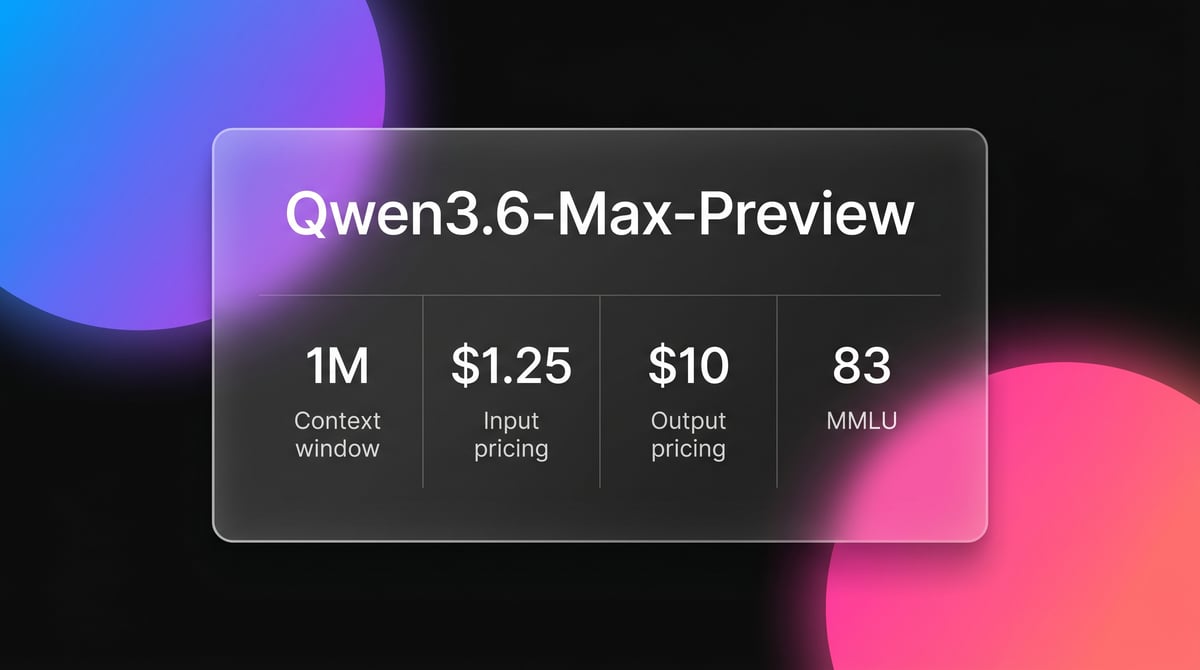

Qwen3.6-Max-Preview is Alibaba's flagship MoE model met 1M context, een native Thinking Mode en SOTA scores in agentic coding en redeneren.

Over Qwen3.6-Max-Preview

Leer over de mogelijkheden van Qwen3.6-Max-Preview, functies en hoe het je kan helpen betere resultaten te behalen.

Qwen3.6-Max-Preview is het flagship proprietary large language model van Alibaba, dat de volgende stap vertegenwoordigt in hun high-performance AI-serie. Door gebruik te maken van een sparse Mixture-of-Experts (MoE) architectuur, bereikt het model de redeneerdiepte van een systeem met biljoenen parameters, terwijl het een hoge operationele efficiëntie behoudt. Het is specifiek geoptimaliseerd voor agentic coding, wereldkennis en het opvolgen van complexe instructies.

Het opvallendste kenmerk van het model is de native Thinking Mode, die het systeem in staat stelt een zichtbare interne chain-of-thought te genereren voordat het een definitief antwoord geeft. Deze transparantie is bijzonder waardevol voor ontwikkelaars die autonome agents bouwen, omdat het een duidelijk inzicht geeft in logische planning en stappen voor foutcorrectie. Gecombineerd met een enorme 1-million-token context window kan het model volledige projectrepositories of uitgebreide documentatiebibliotheken in één keer verwerken.

Qwen3.6-Max-Preview wordt gehost op Alibaba Cloud Model Studio, ondersteunt industriestandaard protocollen en is compatibel met OpenAI-stijl API-specificaties. Het is ontworpen als de primaire keuze voor ondernemingen die AI-mogelijkheden op frontier-niveau nodig hebben voor multimodale data-analyse en robuuste agentic workflows, en biedt een krachtig alternatief voor westerse closed-source modellen.

Gebruikscases voor Qwen3.6-Max-Preview

Ontdek de verschillende manieren waarop je Qwen3.6-Max-Preview kunt gebruiken voor geweldige resultaten.

Autonome software engineering

Zet het model in als een coding agent die door volledige codebases kan navigeren, architecturale wijzigingen kan plannen en bugs in meerdere bestanden tegelijk kan herstellen.

Technische analyse op grote schaal

Gebruik de 1M token context window om volledige documentatiesets of juridische kaders in te lezen voor diepgaande analyses zonder RAG-beperkingen.

Complexe redenering en planning

Maak gebruik van de native Thinking Mode om wiskundige vraagstukken op hoog niveau op te lossen waarbij een intern plan uit meerdere stappen vereist is voor nauwkeurigheid.

Multimodaal inhoudsbegrip

Analyseer zowel statische afbeeldingen als complexe videoreeksen om data te extraheren en dynamische visuele gebeurtenissen samen te vatten.

Interactieve terminaloperaties

Bouw tools waarmee de AI direct kan communiceren met shells en CLI-omgevingen, gebruikmakend van zijn geoptimaliseerde Terminal-Bench prestaties.

Enterprise agentic workflows

Integreer het model in complexe bedrijfsprocessen waar een hoge instructiebetrouwbaarheid en geavanceerde tool-calling vereist zijn voor automatisering.

Sterke punten

Beperkingen

API snelstart

alibaba/qwen3.6-max-preview

import OpenAI from 'openai';

const client = new OpenAI({

apiKey: process.env.DASHSCOPE_API_KEY,

base_url: 'https://dashscope-intl.aliyuncs.com/compatible-mode/v1',

});

async function main() {

const completion = await client.chat.completions.create({

model: 'qwen3.6-max-preview',

messages: [{ role: 'user', content: 'Design a system architecture for a real-time AI agent.' }],

extra_body: { enable_thinking: true },

stream: true

});

for await (const chunk of completion) {

process.stdout.write(chunk.choices[0]?.delta?.content || '');

}

}

main();Installeer de SDK en begin binnen enkele minuten met API-calls.

Wat mensen zeggen over Qwen3.6-Max-Preview

Bekijk wat de community denkt over Qwen3.6-Max-Preview

“De prestaties die je verwacht van een model dat op een enorme serverfarm draait, staan nu op je eigen desktop.”

“Qwen3.6-Max-Preview heeft zojuist Claude Opus 4.5 verslagen op SWE-Bench Pro. China haalt snel in.”

“Met $1,25 per miljoen tokens is Qwen aanzienlijk goedkoper dan Claude voor het inlezen van grootschalige data.”

“Het feit dat Thinking Mode standaard ingeschakeld is, is een betekenisvolle ontwerpkeuze voor agentic betrouwbaarheid.”

“Qwen heeft Qwen 3.6 Max Preview gelanceerd als een nieuw top-end proprietary flagship model.”

“Het toont verbeterde agentic coding en betere betrouwbaarheid in echte agents vergeleken met het Plus-model.”

Video's over Qwen3.6-Max-Preview

Bekijk tutorials, reviews en discussies over Qwen3.6-Max-Preview

“Qwen heeft Qwen 3.6 Max Preview gelanceerd als nieuw top-end proprietary flagship model.”

“Het model laat een sterke sprong zien in coding-agent benchmarks zoals SkillsBench en Terminal-Bench 2.0.”

“Qwen probeert duidelijk serieus te concurreren aan de top tegen modellen zoals Claude 4.5 Opus.”

“Dit model vertegenwoordigt een betekenisvolle verbetering in wereldkennis en het opvolgen van instructies.”

“De prestatiesprong op SWE-bench is wat dit model echt onderscheidt van de Plus-variant.”

“Het benchmark-verhaal draait erom dat de hosted Max Preview zich onderscheidt van de open-weight familie.”

“We gebruiken Qwen Code-pagina's en repo-surfaces om de diepgang van het ecosysteem te beoordelen, verder dan alleen de model weights.”

“De Thinking Mode is verrassend snel vergeleken met o1-stijl modellen van vorig jaar.”

“Dit is duidelijk ontworpen voor enterprise developers die een betrouwbare API nodig hebben voor agentic taken.”

“De multimodale vision-prestaties komen in de buurt van Gemini 2 in sommige documentanalyse-tests.”

“Deze video introduceert de Qwen3.6-Max-Preview, een eerste blik op het volgende flagship model van Qwen.”

“Het toont verbeterde agentic coding en betere betrouwbaarheid in echte agents vergeleken met het Plus-model.”

“De 1M context window is veel stabieler dan wat we zagen in vroege Qwen 2-versies.”

“Als je veel programmeert, is Qwen 3.6 Max momenteel de benchmark-leider.”

“De prijs blijft zeer concurrerend, zelfs voor hun flagship closed-source model.”

Supercharge je workflow met AI-automatisering

Automatio combineert de kracht van AI-agents, webautomatisering en slimme integraties om je te helpen meer te bereiken in minder tijd.

Pro-tips voor Qwen3.6-Max-Preview

Experttips om je te helpen het maximale uit Qwen3.6-Max-Preview te halen en betere resultaten te behalen.

Activeer Internal Reasoning

Zet de 'enable_thinking' parameter op true in je API-request om de interne logica van het model te bekijken voor het debuggen van complexe redeneringen.

Behoud Long-Horizon Logica

Gebruik de 'preserve_thinking' functie voor conversaties met meerdere beurten om te garanderen dat het model logische consistentie behoudt gedurende de hele sessie.

Voer volledige bibliotheken in

Maak gebruik van de 1M context window door volledige bronmaterialen aan te leveren in plaats van data in kleine stukjes te knippen, voor een beter begrip over verschillende bestanden heen.

Gebruik compatibele endpoints

Voor wereldwijde applicaties kun je de Singapore of US Virginia endpoints in Alibaba Cloud gebruiken om de regionale latency voor internationale gebruikers te minimaliseren.

Testimonials

Wat onze gebruikers zeggen

Sluit je aan bij duizenden tevreden gebruikers die hun workflow hebben getransformeerd

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Gerelateerd AI Models

GLM-5

Zhipu (GLM)

GLM-5 is Zhipu AI's 744B parameter open-weight powerhouse, excelling in long-horizon agentic tasks, coding, and factual accuracy with a 200k context window.

GLM-5.1

Zhipu (GLM)

GLM-5.1 is Zhipu AI's flagship reasoning model, featuring a 202K context window and an autonomous 8-hour execution loop for complex agentic engineering.

GPT-5.2

OpenAI

GPT-5.2 is OpenAI's flagship model for professional tasks, featuring a 400K context window, elite coding, and deep multi-step reasoning capabilities.

Gemini 3.1 Flash-Lite

Gemini 3.1 Flash-Lite is Google's fastest, most cost-efficient model. Features 1M context, native multimodality, and 363 tokens/sec speed for scale.

Claude Opus 4.5

Anthropic

Claude Opus 4.5 is Anthropic's most powerful frontier model, delivering record-breaking 80.9% SWE-bench performance and advanced autonomous agency for coding.

Grok-4

xAI

Grok-4 by xAI is a frontier model featuring a 2M token context window, real-time X platform integration, and world-record reasoning capabilities.

Kimi K2 Thinking

Moonshot

Kimi K2 Thinking is Moonshot AI's trillion-parameter reasoning model. It outperforms GPT-5 on HLE and supports 300 sequential tool calls autonomously for...

Kimi K2.5

Moonshot

Discover Moonshot AI's Kimi K2.5, a 1T-parameter open-source agentic model featuring native multimodal capabilities, a 262K context window, and SOTA reasoning.

Veelgestelde vragen over Qwen3.6-Max-Preview

Vind antwoorden op veelvoorkomende vragen over Qwen3.6-Max-Preview