Qwen3.5-397B-A17B

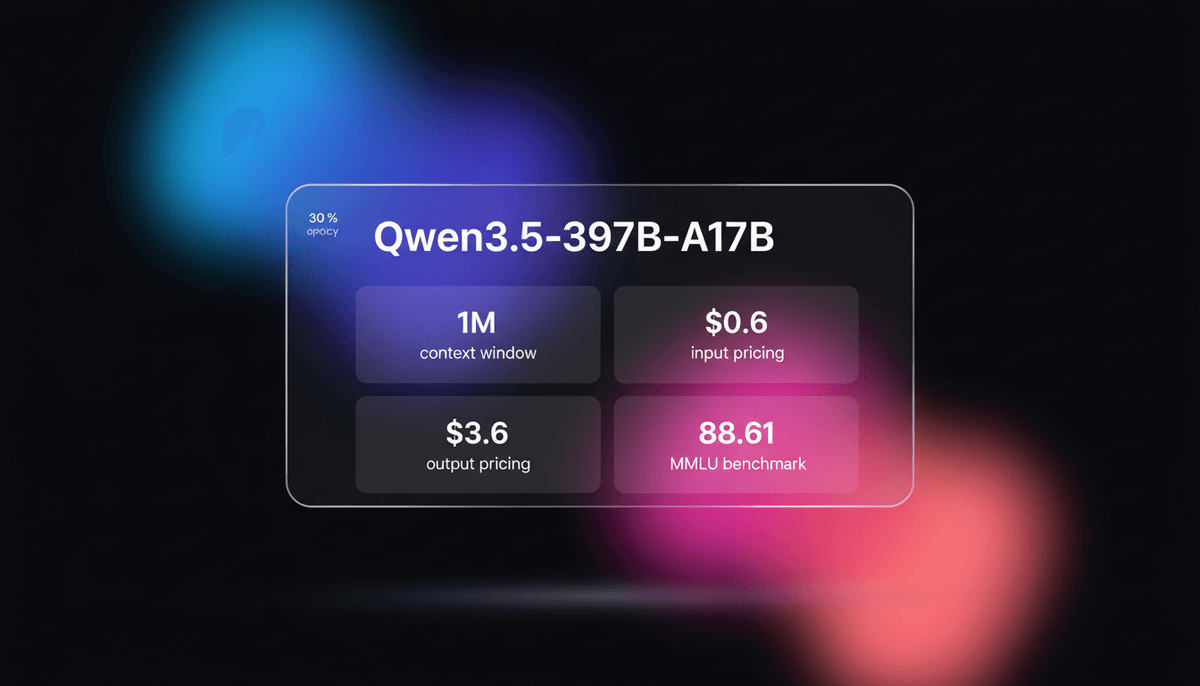

Qwen3.5-397B-A17B to flagowy model MoE z open-weights od Alibaba. Cechuje się natywnym multimodalnym reasoningiem, oknem kontekstowym 1M i 19-krotną...

O Qwen3.5-397B-A17B

Dowiedz sie o mozliwosciach Qwen3.5-397B-A17B, funkcjach i jak moze pomoc Ci osiagnac lepsze wyniki.

Wysokowydajna architektura Mixture of Experts

Qwen3.5-397B-A17B to flagowy model natywnie multimodalny, który wykorzystuje innowacyjną architekturę hybrydową, łączącą liniową atencję za pośrednictwem Gated Delta Networks z rzadką architekturą Mixture-of-Experts (MoE). Choć zawiera 397 miliardów parametrów, jego rzadka konstrukcja aktywuje tylko 17 miliardów parametrów podczas przejścia w przód, osiągając wyjątkową wydajność inference bez uszczerbku dla szerokich zdolności reasoning. Jest zoptymalizowany zarówno do zadań językowych, jak i wizualnych, obsługując słownik 250 tys. tokenów i ponad 201 języków i dialektów.

Natywne multimodalne przepływy pracy agentów

Model doskonale sprawdza się jako natywny agent multimodalny, zdolny do przetwarzania do miliona tokenów kontekstu, co odpowiada około dwóm godzinom wideo. Wprowadza specjalistyczny Tryb Myślenia dla złożonego wnioskowania logicznego i jest natywnie wyposażony do obsługi agentowych przepływów pracy, w tym tworzenia stron internetowych, nawigacji GUI i inteligencji przestrzennej w świecie rzeczywistym. Architektura wspiera szkolenie FP8 end-to-end, co czyni go jednym z najbardziej skalowalnych i wydajnych modeli dla korporacyjnych aplikacji AI.

Open Weights dla globalnej dostępności

Udostępniony na licencji Apache 2.0, model ten dostarcza społeczności open-source możliwości na poziomie frontier model, które wcześniej były ograniczone do systemów własnościowych. Niweluje przepaść między ogromną liczbą parametrów a praktycznym wdrożeniem, pozwalając organizacjom uruchamiać najnowocześniejsze zadania reasoning na prywatnej infrastrukturze przy znacznie mniejszym narzucie obliczeniowym niż w przypadku gęstych modeli 400B.

Przypadki uzycia dla Qwen3.5-397B-A17B

Odkryj rozne sposoby wykorzystania Qwen3.5-397B-A17B do osiagniecia swietnych wynikow.

Analiza długich materiałów wideo

Analizuj do dwóch godzin treści wideo, aby wyodrębnić logikę, przeprowadzić inżynierię wsteczną kodu z nagrania lub wygenerować ustrukturyzowane podsumowania.

Badania naukowe STEM na poziomie doktoranckim

Rozwiązuj zadania naukowe i matematyczne na poziomie olimpijskim, korzystając z adaptacyjnego trybu głębokiego myślenia.

Autonomiczne agenty GUI

Automatyzuj interakcje ze smartfonami i komputerami w celu obsługi przepływów pracy w biurze i nawigacji między aplikacjami mobilnymi.

Inżynieria oprogramowania wizualnego

Realizuj 'vibe coding', przekształcając instrukcje w języku naturalnym i szkice interfejsu w funkcjonalny kod frontendowy.

Inteligencja dokumentowa

Przetwarzaj złożone dokumenty, wykresy i odręczne notatki, aby wyodrębnić ustrukturyzowane dane i zrekonstruować układy stron.

Aplikacje Spatial AI

Rozumiej relacje na poziomie pikseli w zadaniach embodied AI, takich jak analiza scen w autonomicznym prowadzeniu pojazdów i nawigacja robotyczna.

Mocne strony

Ograniczenia

Szybki start API

alibaba/qwen3.5-plus

import OpenAI from 'openai';

const client = new OpenAI({

apiKey: process.env.DASHSCOPE_API_KEY,

baseURL: 'https://dashscope-intl.aliyuncs.com/compatible-mode/v1',

});

async function main() {

const completion = await client.chat.completions.create({

model: 'qwen3.5-plus',

messages: [{ role: 'user', content: 'Przeanalizuj logikę tej architektury MoE.' }],

extra_body: { enable_thinking: true },

});

console.log(completion.choices[0].message.content);

}

main();Zainstaluj SDK i zacznij wykonywac wywolania API w kilka minut.

Co mowia ludzie o Qwen3.5-397B-A17B

Zobacz, co spolecznosc mysli o Qwen3.5-397B-A17B

“Qwen3.5-397B to w zasadzie model klasy GPT-5, ale z open-weights. Architektura DeltaNet doskonale rozwiązuje problemy z latency MoE.”

“Natywny multimodalny reasoning w Qwen3.5 wygląda niesamowicie. 1M kontekstu + analiza wideo zmienią przepływy pracy agentów.”

“Decyzja o zastosowaniu szkolenia FP8 end-to-end przy zachowaniu BF16 w wrażliwych warstwach to mistrzostwo w optymalizacji stabilności.”

“To pierwszy raz, kiedy widzę otwarty model, który faktycznie pokonuje Gemini 1.5 Pro w złożonych multimodalnych zadaniach agentowych.”

“19-krotna poprawa przepustowości dekodowania w stosunku do Qwen3-Max czyni go realną alternatywą dla agentów na poziomie produkcyjnym.”

“Byłem zaskoczony, jak dobrze radzi sobie z kwantyzacją 4-bit. Zachowuje prawie wszystkie zdolności reasoning na konfiguracji z dwoma A100.”

Filmy o Qwen3.5-397B-A17B

Ogladaj samouczki, recenzje i dyskusje o Qwen3.5-397B-A17B

“Model o 397 miliardach parametrów, ale z 17 miliardami aktywnych parametrów.”

“Podczas dekodowania przy 256K, ten model jest 19 razy szybszy niż Qwen 3 Max.”

“Natywny multimodalny reasoning wyróżnia go w agentowych przepływach pracy.”

“Wygrywa z większością modeli zamkniętych w standardowych benchmarkach matematycznych.”

“Lokalne uruchomienie jest trudne, ale wersje skwantyzowane działają na high-endowych komputerach Mac.”

“Model o 397 miliardach parametrów z 17 miliardami aktywnych. Jest natywnie multimodalny.”

“To prawdopodobnie obecnie najlepszy multimodalny model open-source.”

“Możliwość przetwarzania dwóch godzin wideo natywnie to ogromna przewaga.”

“Spójrz na te wyniki logiki, konsekwentnie osiąga poziomy GPT-4o.”

“Licencja Apache czyni go bardzo atrakcyjnym dla prywatności danych w korporacjach.”

“Ekstrakcja ustrukturyzowana OCR. Masz nieuporządkowany plik PDF... i musisz zamienić go na czysty JSON. Ten model radzi sobie z tym wyśmienicie.”

“Dostajesz inteligencję giganta o 400 miliardach parametrów... ale płacisz koszt obliczeniowy modelu 17-miliardowego.”

“Lepiej radzi sobie z odzyskiwaniem długiego kontekstu niż poprzednia wersja.”

“Integracja z użyciem narzędzi jest wbudowana w bazowe szkolenie, a nie dodana na końcu.”

“Tryb myślenia (Thinking Mode) pozwala mu korygować własną logikę przed wygenerowaniem odpowiedzi.”

Przyspiesz swoj workflow z automatyzacja AI

Automatio laczy moc agentow AI, automatyzacji web i inteligentnych integracji, aby pomoc Ci osiagnac wiecej w krotszym czasie.

Porady Pro dla Qwen3.5-397B-A17B

Wskazówki ekspertów, aby w pełni wykorzystać Qwen3.5-397B-A17B.

Włącz tryb myślenia (Thinking Mode)

Przekaż parametr 'enable_thinking: true' w swoim wywołaniu API, aby aktywować głęboki reasoning dla zadań matematycznych, kodowania i złożonych łamigłówek logicznych.

Wykorzystaj tryb Fast Mode

Używaj trybu 'Fast' dla prostych zapytań, aby otrzymywać natychmiastowe odpowiedzi bez zużywania tokenów na zbędne wewnętrzne fazy myślenia.

Optymalizuj promptowanie wideo

Podczas analizy wideo poproś model, aby skupił się na końcowym dynamicznym wyniku, zamiast na analizie klatka po klatce, aby uzyskać lepszą spójność czasową.

Wykorzystaj kwantyzację

Użyj kwantyzacji 4-bit lub 8-bit (GGUF/EXL2), aby uruchomić model na sprzęcie klasy konsumenckiej, jeśli dysponujesz wystarczającą ilością VRAM (200GB+).

Opinie

Co mowia nasi uzytkownicy

Dolacz do tysiecy zadowolonych uzytkownikow, ktorzy przeksztalcili swoj workflow

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Powiazane AI Models

GPT-5.1

OpenAI

GPT-5.1 is OpenAI’s advanced reasoning flagship featuring adaptive thinking, native multimodality, and state-of-the-art performance in math and technical...

Kimi K2.5

Moonshot

Discover Moonshot AI's Kimi K2.5, a 1T-parameter open-source agentic model featuring native multimodal capabilities, a 262K context window, and SOTA reasoning.

Grok-4

xAI

Grok-4 by xAI is a frontier model featuring a 2M token context window, real-time X platform integration, and world-record reasoning capabilities.

Claude Opus 4.5

Anthropic

Claude Opus 4.5 is Anthropic's most powerful frontier model, delivering record-breaking 80.9% SWE-bench performance and advanced autonomous agency for coding.

Gemini 3.1 Flash-Lite

Gemini 3.1 Flash-Lite is Google's fastest, most cost-efficient model. Features 1M context, native multimodality, and 363 tokens/sec speed for scale.

Claude Sonnet 4.6

Anthropic

Claude Sonnet 4.6 offers frontier performance for coding and computer use with a massive 1M token context window for only $3/1M tokens.

DeepSeek v4

DeepSeek

DeepSeek v4 is a 1.6T parameter MoE model featuring a 1M token context window and native multimodal support for text, vision, and video at disruptive prices.

Gemini 3 Flash

Gemini 3 Flash is Google's high-speed multimodal model featuring a 1M token context window, elite 90.4% GPQA reasoning, and autonomous browser automation tools.

Często Zadawane Pytania o Qwen3.5-397B-A17B

Znajdź odpowiedzi na częste pytania o Qwen3.5-397B-A17B