Qwen3.6-Max-Preview

Qwen3.6-Max-Preview to flagowy model MoE od Alibaba, oferujący 1M context window, natywny tryb myślenia oraz najlepsze wyniki (SOTA) w agentic kodowaniu i...

O Qwen3.6-Max-Preview

Dowiedz sie o mozliwosciach Qwen3.6-Max-Preview, funkcjach i jak moze pomoc Ci osiagnac lepsze wyniki.

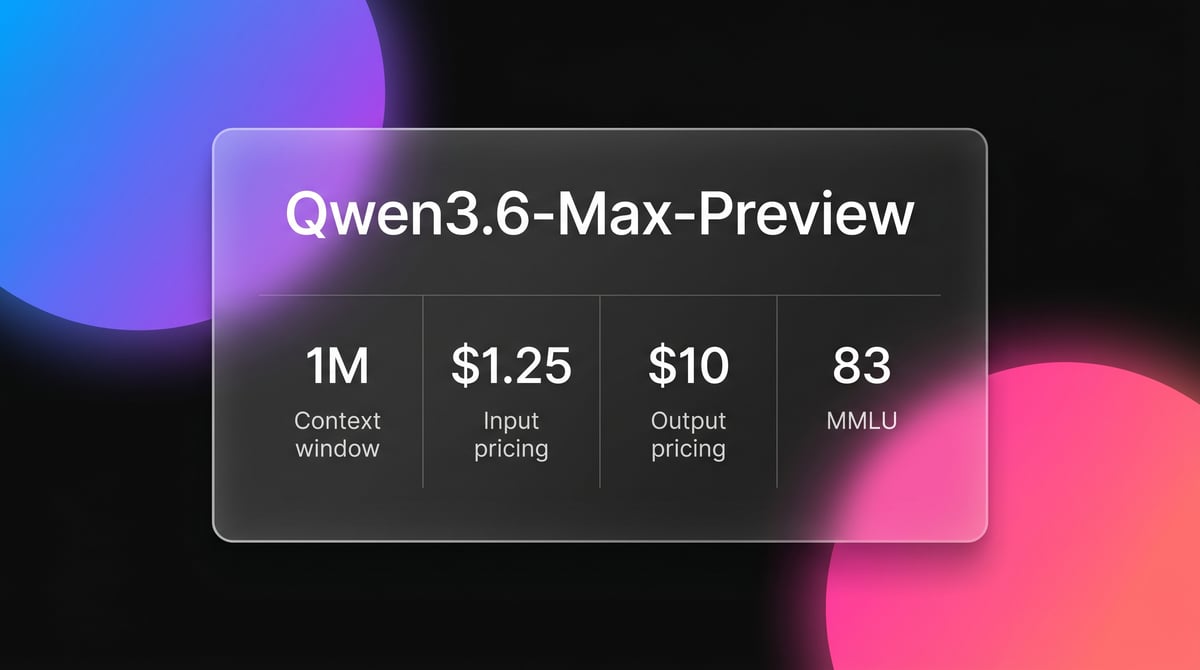

Qwen3.6-Max-Preview to flagowy, własnościowy model językowy (LLM) od Alibaba, stanowiący kolejny krok w ich serii wydajnych systemów AI. Wykorzystując rzadką architekturę Mixture-of-Experts (MoE), model osiąga głębię rozumowania systemu z bilionami parametrów, zachowując przy tym znaczną efektywność operacyjną. Jest on specjalnie zoptymalizowany pod kątem programowania agentowego, wiedzy o świecie i podążania za złożonymi instrukcjami.

Wyróżniającą cechą modelu jest natywny Thinking Mode, który pozwala systemowi wygenerować widoczny wewnętrzny łańcuch myśli (chain-of-thought) przed udzieleniem ostatecznej odpowiedzi. Ta przejrzystość jest szczególnie cenna dla deweloperów budujących autonomiczne agenty, ponieważ zapewnia jasny wgląd w kroki logicznego planowania i korekcji błędów. W połączeniu z ogromnym 1-milionowym context window, model może przetworzyć całe repozytoria projektowe lub obszerne biblioteki dokumentacji w jednym przebiegu.

Hostowany w Alibaba Cloud Model Studio, Qwen3.6-Max-Preview obsługuje standardowe protokoły branżowe i jest kompatybilny ze specyfikacjami API w stylu OpenAI. Został zaprojektowany jako główny wybór dla przedsiębiorstw wymagających możliwości AI klasy frontier do multimodalnej analizy danych i solidnych agentowych przepływów pracy, oferując wysokowydajną alternatywę dla zachodnich modeli typu closed-source.

Przypadki uzycia dla Qwen3.6-Max-Preview

Odkryj rozne sposoby wykorzystania Qwen3.6-Max-Preview do osiagniecia swietnych wynikow.

Autonomiczna inżynieria oprogramowania

Wdróż model jako agenta programistycznego zdolnego do poruszania się po całych bazach kodu, planowania zmian architektonicznych i naprawiania błędów w wielu plikach jednocześnie.

Analiza techniczna na dużą skalę

Wykorzystaj 1M token context window, aby przetwarzać kompletne zbiory dokumentacji lub ramy prawne do dogłębnej analizy bez ograniczeń RAG.

Złożone rozumowanie i planowanie

Wykorzystaj natywny Thinking Mode do rozwiązywania problemów matematycznych wysokiego szczebla, gdzie do uzyskania dokładności wymagany jest wieloetapowy plan wewnętrzny.

Multimodalne rozumienie treści

Analizuj zarówno statyczne obrazy, jak i złożone sekwencje wideo, aby wyodrębniać dane i podsumowywać dynamiczne zdarzenia wizualne.

Interaktywne operacje terminalowe

Buduj narzędzia, które pozwalają AI na bezpośrednią interakcję z powłokami i środowiskami CLI, korzystając z jego zoptymalizowanej wydajności w Terminal-Bench.

Enterprise Agentic Workflows

Zintegruj model ze złożonymi potokami biznesowymi, gdzie do automatyzacji wymagana jest wysoka niezawodność instrukcji i zaawansowane tool-calling.

Mocne strony

Ograniczenia

Szybki start API

alibaba/qwen3.6-max-preview

import OpenAI from 'openai';

const client = new OpenAI({

apiKey: process.env.DASHSCOPE_API_KEY,

base_url: 'https://dashscope-intl.aliyuncs.com/compatible-mode/v1',

});

async function main() {

const completion = await client.chat.completions.create({

model: 'qwen3.6-max-preview',

messages: [{ role: 'user', content: 'Zaprojektuj architekturę systemu dla agenta AI działającego w czasie rzeczywistym.' }],

extra_body: { enable_thinking: true },

stream: true

});

for await (const chunk of completion) {

process.stdout.write(chunk.choices[0]?.delta?.content || '');

}

}

main();Zainstaluj SDK i zacznij wykonywac wywolania API w kilka minut.

Co mowia ludzie o Qwen3.6-Max-Preview

Zobacz, co spolecznosc mysli o Qwen3.6-Max-Preview

“Wydajność, której można oczekiwać od modelu działającego w ogromnym centrum danych, jest teraz dostępna na twoim pulpicie.”

“Qwen3.6-Max-Preview właśnie pokonał Claude Opus 4.5 w SWE-Bench Pro. Chiny szybko nadrabiają zaległości.”

“Przy cenie 1,25 USD za milion tokens, Qwen jest znacznie tańszy niż Claude w przypadku masowego przetwarzania danych.”

“Fakt, że Thinking Mode jest wbudowany jako stan domyślny, to znaczący wybór projektowy dla niezawodności agentowej.”

“Qwen uruchomił Qwen 3.6 Max Preview jako nowy flagowy model własnościowy z najwyższej półki.”

“Wykazuje ulepszone kodowanie agentowe i lepszą niezawodność w rzeczywistych zadaniach w porównaniu do modelu Plus.”

Filmy o Qwen3.6-Max-Preview

Ogladaj samouczki, recenzje i dyskusje o Qwen3.6-Max-Preview

“Qwen uruchomił Qwen 3.6 Max Preview jako nowy, flagowy model własnościowy z najwyższej półki.”

“Model wykazuje silny skok w benchmarkach dla agentów programistycznych, takich jak SkillsBench i Terminal-Bench 2.0.”

“Qwen wyraźnie próbuje poważnie konkurować na wysokim poziomie z modelami typu Claude 4.5 Opus.”

“Ten model stanowi znaczącą poprawę w zakresie wiedzy o świecie i podążania za instrukcjami.”

“Skok wydajności w SWE-bench jest tym, co naprawdę odróżnia go od wariantu Plus.”

“Historia benchmarków polega na pozycjonowaniu hostowanego Max Preview jako rozwiązania odrębnego od rodziny open-weight.”

“Używamy stron Qwen Code oraz analizy repozytoriów, aby ocenić głębię ekosystemu wykraczającą poza same wagi modelu.”

“Tryb myślenia (thinking mode) jest zaskakująco szybki w porównaniu do modeli w stylu o1 z zeszłego roku.”

“Jest to wyraźnie zaprojektowane dla programistów korporacyjnych, którzy potrzebują niezawodnego API do zadań agentowych.”

“Multimodalna wydajność wizyjna dogania Gemini 2 w niektórych testach analizy dokumentów.”

“Ten film przedstawia Qwen3.6-Max-Preview, wczesne spojrzenie na kolejny flagowy model od Qwen.”

“Wykazuje ulepszone kodowanie agentowe i lepszą niezawodność w rzeczywistych zadaniach w porównaniu do modelu Plus.”

“1M context window jest znacznie bardziej stabilny niż to, co widzieliśmy we wczesnych wersjach Qwen 2.”

“Jeśli dużo programujesz, Qwen 3.6 Max jest obecnie liderem benchmarków.”

“Ceny pozostają bardzo konkurencyjne nawet jak na ich flagowy model closed-source.”

Przyspiesz swoj workflow z automatyzacja AI

Automatio laczy moc agentow AI, automatyzacji web i inteligentnych integracji, aby pomoc Ci osiagnac wiecej w krotszym czasie.

Porady Pro dla Qwen3.6-Max-Preview

Wskazówki ekspertów, aby w pełni wykorzystać Qwen3.6-Max-Preview.

Włącz wewnętrzne rozumowanie (Internal Reasoning)

Ustaw parametr 'enable_thinking' na true w swoim żądaniu API, aby zobaczyć wewnętrzną logikę modelu podczas debugowania złożonych procesów reasoning.

Zachowaj logikę długoterminową (Long-Horizon Logic)

Użyj funkcji 'preserve_thinking' w rozmowach wieloetapowych, aby zapewnić, że model utrzyma spójność logiczną w całej sesji.

Przesyłaj całe biblioteki

Wykorzystaj 1M context window, dostarczając pełne materiały źródłowe zamiast podzielonych na części danych, co pozwoli na lepsze zrozumienie powiązań między plikami.

Używaj kompatybilnych endpointów

W przypadku aplikacji globalnych korzystaj z endpointów w Singapurze lub amerykańskim stanie Wirginia w Alibaba Cloud, aby zminimalizować regionalną latency dla użytkowników międzynarodowych.

Opinie

Co mowia nasi uzytkownicy

Dolacz do tysiecy zadowolonych uzytkownikow, ktorzy przeksztalcili swoj workflow

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Powiazane AI Models

GLM-5

Zhipu (GLM)

GLM-5 is Zhipu AI's 744B parameter open-weight powerhouse, excelling in long-horizon agentic tasks, coding, and factual accuracy with a 200k context window.

GLM-5.1

Zhipu (GLM)

GLM-5.1 is Zhipu AI's flagship reasoning model, featuring a 202K context window and an autonomous 8-hour execution loop for complex agentic engineering.

GPT-5.2

OpenAI

GPT-5.2 is OpenAI's flagship model for professional tasks, featuring a 400K context window, elite coding, and deep multi-step reasoning capabilities.

Gemini 3.1 Flash-Lite

Gemini 3.1 Flash-Lite is Google's fastest, most cost-efficient model. Features 1M context, native multimodality, and 363 tokens/sec speed for scale.

Claude Opus 4.5

Anthropic

Claude Opus 4.5 is Anthropic's most powerful frontier model, delivering record-breaking 80.9% SWE-bench performance and advanced autonomous agency for coding.

Grok-4

xAI

Grok-4 by xAI is a frontier model featuring a 2M token context window, real-time X platform integration, and world-record reasoning capabilities.

Kimi K2 Thinking

Moonshot

Kimi K2 Thinking is Moonshot AI's trillion-parameter reasoning model. It outperforms GPT-5 on HLE and supports 300 sequential tool calls autonomously for...

Kimi K2.5

Moonshot

Discover Moonshot AI's Kimi K2.5, a 1T-parameter open-source agentic model featuring native multimodal capabilities, a 262K context window, and SOTA reasoning.

Często Zadawane Pytania o Qwen3.6-Max-Preview

Znajdź odpowiedzi na częste pytania o Qwen3.6-Max-Preview