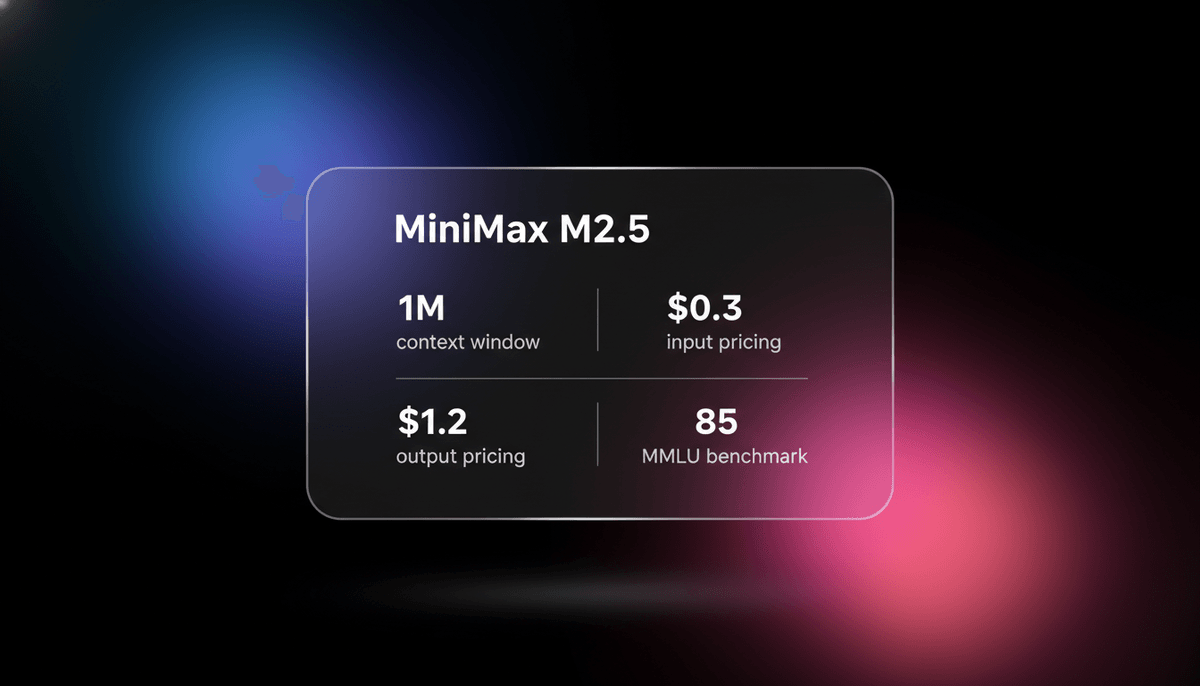

MiniMax M2.5

O MiniMax M2.5 é um model SOTA MoE com context window de 1M e capacidades de codificação agentic de elite a preços disruptivos para agentes autônomos.

Sobre MiniMax M2.5

Aprenda sobre as capacidades do MiniMax M2.5, recursos e como ele pode ajuda-lo a obter melhores resultados.

Arquitetura de fronteira eficiente

O MiniMax M2.5 é um frontier model de alta eficiência construído sobre uma arquitetura de 230B Mixture-of-Experts (MoE). Ao ativar apenas 10 bilhões de parâmetros por passagem, ele atinge velocidades de inference e estruturas de preços que são quase 20 vezes mais eficientes do que os gigantes proprietários. Ele foi projetado especificamente para agentic intelligence, priorizando lógica estruturada e planejamento em várias etapas em vez de simples chat completions. Este design sparse permite que o model mantenha alta inteligência sem o enorme overhead computacional dos modelos densos tradicionais.

Inteligência de codificação avançada

A característica marcante do model é sua Mentalidade de Arquiteto, que lhe permite visualizar estruturas lógicas e hierarquias de projeto antes de gerar o código. Isso o torna particularmente eficaz para engenharia de software autônoma, onde ele se iguala ao estado da arte com uma pontuação de 80,2% no SWE-Bench Verified. Com um context window de 1 milhão de tokens, ele pode ingerir bases de código inteiras, permitindo auditorias profundas de repositórios e refatorações complexas de sistemas que antes eram proibitivamente caras.

Implantação corporativa e local

O MiniMax M2.5 suporta mais de 10 linguagens de programação e um throughput nativo de até 100 tokens por segundo em sua variante lightning. Como está disponível como um model de open-weights, os desenvolvedores podem implantá-lo localmente para total privacidade de dados, mantendo o acesso ao mesmo reasoning complexo encontrado na API hospedada. Essa versatilidade o torna uma escolha prática tanto para pipelines de agentes baseados em nuvem quanto para ferramentas de desenvolvimento locais.

Casos de Uso para MiniMax M2.5

Descubra as diferentes maneiras de usar MiniMax M2.5 para obter otimos resultados.

Engenharia de Software Autônoma

Resolução de problemas reais do GitHub e depuração de múltiplos arquivos usando estruturas de agentes.

Pipelines de Agentes Corporativos

Execução de agentes de segundo plano sempre ativos para pesquisa e síntese de dados com baixo custo de API.

Modernização de Código Legado

Refatoração de repositórios massivos e obsoletos para frameworks modernos, mantendo os padrões de lógica.

Revisões de Código Arquiteturais

Análise de hierarquias de projetos para fornecer feedback lógico e sugestões de otimização estrutural.

Edição de Documentos de Alto Volume

Processamento de grandes arquivos de escritório com alta fidelidade para modelagem financeira e jurídica.

Ferramentas de Desenvolvedor de Baixa Latência

Impulsionando extensões de IDE e ferramentas de CLI que exigem tempos de resposta abaixo de um segundo para assistência.

Pontos Fortes

Limitacoes

Inicio Rapido da API

minimax/minimax-m2.5

import OpenAI from 'openai';

const client = new OpenAI({

apiKey: process.env.MINIMAX_API_KEY,

baseURL: 'https://api.minimax.io/v1',

});

async function main() {

const response = await client.chat.completions.create({

model: 'minimax-m2.5',

messages: [{ role: 'user', content: 'Design a microservices architecture for a fintech app.' }],

temperature: 0.1,

});

console.log(response.choices[0].message.content);

}

main();Instale o SDK e comece a fazer chamadas de API em minutos.

O Que as Pessoas Estao Dizendo Sobre MiniMax M2.5

Veja o que a comunidade pensa sobre MiniMax M2.5

“O preço do MiniMax M2.5 é a verdadeira história; barato o suficiente para mudar a arquitetura, não apenas os orçamentos.”

“O M2.5 está atingindo números SOTA e é um model de 10B de parâmetros ativos, o que significa que é rápido e barato.”

“O model reduz o trabalho pesado que os usuários tinham que fazer apenas para manter as coisas funcionando.”

“O M2.5 está igualando o throughput do Claude Opus 4.6 por uma fração do custo.”

“Executar o M2.5 localmente em um Mac Studio é muito rápido. Os 10B de parâmetros ativos realmente fazem a diferença.”

“O passo de planejamento arquitetural detecta erros de lógica antes mesmo de escrever uma única linha de código.”

Videos Sobre MiniMax M2.5

Assista tutoriais, analises e discussoes sobre MiniMax M2.5

“É quase 20 vezes mais barato que as principais opções proprietárias.”

“Este é um model de codificação e agentic de alto nível que é muito mais rápido e drasticamente mais barato.”

“O desempenho no SWE-bench verified realmente o coloca na categoria de elite.”

“Você está obtendo frontier intelligence com requisitos de hardware open-source.”

“A arquitetura MoE aqui é perfeitamente ajustada para tarefas de codificação de baixa latência.”

“A MiniMax está servindo o model a 3% do custo do Opus 4.6 em tokens de saída.”

“O custo da inteligência está, na verdade, se aproximando do custo da eletricidade neste momento.”

“Ele lida com context windows de repositórios grandes sem o típico esquecimento no meio do documento.”

“Para ferramentas de desenvolvedor, a velocidade da variante lightning é uma vitória massiva de UX.”

“É a primeira vez que vejo um model tão barato realmente resolver bugs de lógica complexos.”

“Custa apenas US$ 1 executar o model continuamente por uma hora a 100 tokens por segundo.”

“O raciocínio interno realmente brilha aqui porque ele pode corrigir o curso imediatamente.”

“Testando contra o GPT-4o, ele fornece consistentemente melhores refatorações de múltiplos arquivos.”

“As capacidades agentic são integradas, não apenas uma reflexão tardia no prompt.”

“É essencialmente gratuito para pequenos desenvolvedores, dado os níveis de preços de entrada.”

Potencialize seu fluxo de trabalho com Automacao de IA

Automatio combina o poder de agentes de IA, automacao web e integracoes inteligentes para ajuda-lo a realizar mais em menos tempo.

Dicas Profissionais para MiniMax M2.5

Dicas de especialistas para ajuda-lo a aproveitar ao maximo MiniMax M2.5 e obter melhores resultados.

Adote a mentalidade de arquiteto

Peça ao model para gerar uma estrutura de projeto antes de solicitar o código de implementação real.

Utilize o context window de 1M

Forneça documentação completa ou módulos inteiros para garantir uma consciência global da sua base de código.

Use o plano HighSpeed

Selecione o endpoint M2.5-HighSpeed para atingir constantes 100 tokens por segundo para agentes interativos.

Refinamento iterativo

Peça ao model para revisar sua saída inicial em busca de falhas lógicas ou vulnerabilidades de segurança.

Depoimentos

O Que Nossos Usuarios Dizem

Junte-se a milhares de usuarios satisfeitos que transformaram seu fluxo de trabalho

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Relacionados AI Models

DeepSeek-V3.2-Speciale

DeepSeek

DeepSeek-V3.2-Speciale is a reasoning-first LLM featuring gold-medal math performance, DeepSeek Sparse Attention, and a 131K context window. Rivaling GPT-5...

MiMo V2.5 Pro

Other

MiMo V2.5 Pro is Xiaomi's open-source 1.02T parameter MoE model featuring a 1M context window, native multimodality, and elite agentic coding performance.

Claude 3.7 Sonnet

Anthropic

Claude 3.7 Sonnet is Anthropic's first hybrid reasoning model, delivering state-of-the-art coding capabilities, a 200k context window, and visible thinking.

Gemini 3.5 Flash

Gemini 3.5 Flash is Google's high-speed multimodal model with a 1M context window, optimized for sub-second agentic loops and complex coding tasks.

Qwen 3.7 Max

alibaba

Qwen 3.7 Max is Alibaba’s flagship AI model for deep reasoning and autonomous agent tasks, featuring a 256k context window and top-tier coding performance.

Qwen3.5-Omni

alibaba

Qwen3.5-Omni is a natively omnimodal AI by Alibaba Cloud, offering seamless audio-visual reasoning, real-time voice chat, and 256k context for low-latency apps.

DeepSeek v4

DeepSeek

DeepSeek v4 is a 1.6T parameter MoE model featuring a 1M token context window and native multimodal support for text, vision, and video at disruptive prices.

GPT-5.5

OpenAI

GPT-5.5 is OpenAI's flagship frontier model with a 1M context window and five reasoning effort levels, optimized for autonomous agentic workflows and coding.

Perguntas Frequentes Sobre MiniMax M2.5

Encontre respostas para perguntas comuns sobre MiniMax M2.5