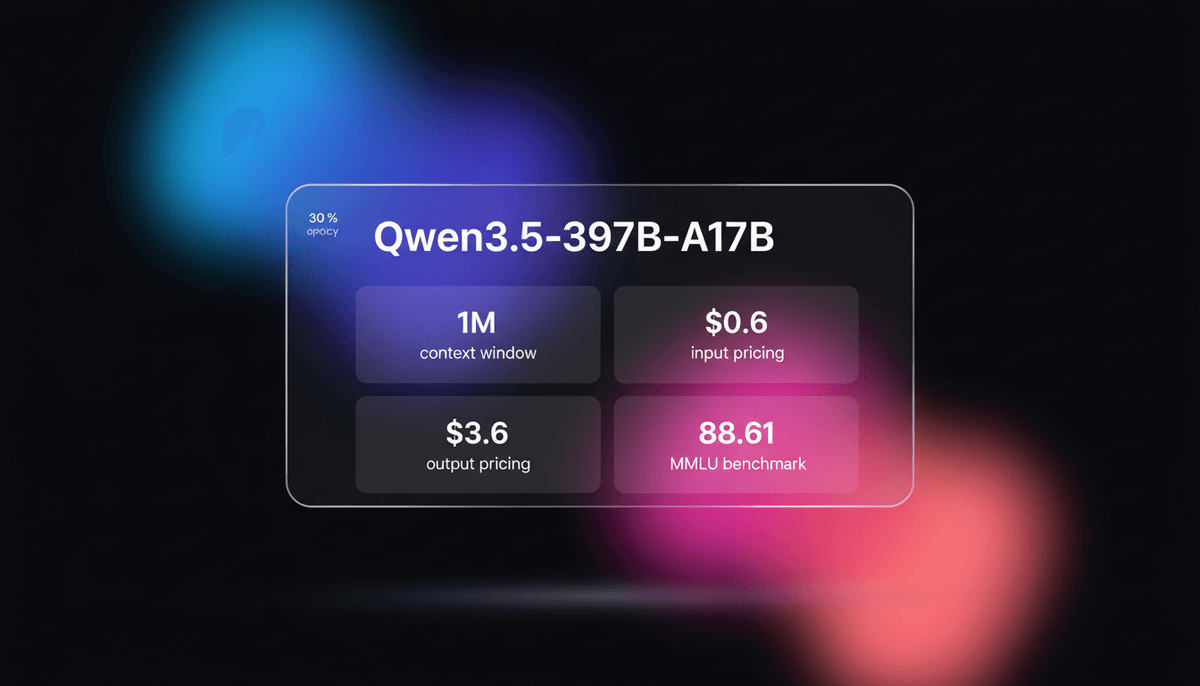

Qwen3.5-397B-A17B

Qwen3.5-397B-A17B är Alibabas flagship open-weight MoE-modell. Den har nativ multimodal reasoning, 1M context window och 19x decoding throughput...

Om Qwen3.5-397B-A17B

Lar dig om Qwen3.5-397B-A17Bs kapacitet, funktioner och hur det kan hjalpa dig uppna battre resultat.

Högeffektiv Mixture of Experts

Qwen3.5-397B-A17B är en ledande nativ multimodal modell som använder en innovativ hybridarkitektur genom att sammanfoga linjär attention via Gated Delta Networks med en sparsam Mixture-of-Experts (MoE). Även om den innehåller totalt 397 miljarder parametrar aktiverar dess sparsamma design endast 17 miljarder parametrar per forward pass, vilket uppnår exceptionell effektivitet och hastighet utan att kompromissa med dess omfattande reasoning-kapacitet. Den är optimerad för både språk- och visuella uppgifter, stöder ett massivt ordförråd på 250k tokens och ger stöd för över 201 språk och dialekter.

Nativa multimodala agent-arbetsflöden

Modellen utmärker sig som en nativ multimodal agent, kapabel att bearbeta upp till en miljon tokens context, vilket motsvarar ungefär två timmars video. Den introducerar ett specialiserat Thinking Mode för komplex logisk reasoning och är nativt utrustad för agent-arbetsflöden, inklusive webbutveckling, GUI-navigering och spatial intelligens i den verkliga världen. Dess arkitektur stöder FP8 end-to-end träning och ett disaggregerat ramverk för träning och inference, vilket gör den till en av de mest skalbara och effektiva modellerna för AI-applikationer i företagsklass.

Open Weights för global tillgänglighet

Modellen släpps under Apache 2.0-licensen och ger open-source-communityt kapacitet på frontier-nivå som tidigare var begränsad till proprietära system. Den överbryggar klyftan mellan massivt parameterantal och praktisk användning, vilket gör att organisationer kan köra avancerade reasoning-uppgifter på privat infrastruktur med betydligt lägre beräkningskostnader än täta 400B-alternativ.

Anvandningsfall for Qwen3.5-397B-A17B

Upptack de olika satten du kan anvanda Qwen3.5-397B-A17B for att uppna fantastiska resultat.

Långsiktig videoanalys

Analysera upp till två timmars videoinnehåll för att extrahera logik, reverse-engineera kod från filmmaterial eller generera strukturerade sammanfattningar.

STEM-forskning på PhD-nivå

Lös vetenskapliga problem på forskarnivå och matematiska problem på olympiadnivå med hjälp av dess adaptiva deep-thinking-läge.

Autonoma GUI-agenter

Automatisera interaktioner med smartphones och datorer för att hantera arbetsflöden och navigering mellan olika appar.

Visuell mjukvaruutveckling

Utför 'vibe coding' genom att omvandla instruktioner i naturligt språk och UI-skisser till funktionell frontend-kod.

Dokumentintelligens

Bearbeta komplexa dokument, diagram och handskrivna skisser för att extrahera strukturerad data och reverse-engineera layouter.

Spatiala AI-applikationer

Förstå pixel-nivå-relationer för embodied AI-uppgifter som analys av körscenarier för autonoma fordon och robotnavigering.

Styrkor

Begransningar

API snabbstart

alibaba/qwen3.5-plus

import OpenAI from 'openai';

const client = new OpenAI({

apiKey: process.env.DASHSCOPE_API_KEY,

baseURL: 'https://dashscope-intl.aliyuncs.com/compatible-mode/v1',

});

async function main() {

const completion = await client.chat.completions.create({

model: 'qwen3.5-plus',

messages: [{ role: 'user', content: 'Analysera logiken i denna MoE-arkitektur.' }],

extra_body: { enable_thinking: true },

});

console.log(completion.choices[0].message.content);

}

main();Installera SDK och borja gora API-anrop pa nagra minuter.

Vad folk sager om Qwen3.5-397B-A17B

Se vad communityt tycker om Qwen3.5-397B-A17B

“Qwen3.5-397B är i princip en modell i GPT-5-klassen men med open-weights. DeltaNet-arkitekturen löser MoE-latensproblemen perfekt.”

“Nativ multimodal reasoning i Qwen3.5 ser otroligt ut. 1M context + videoanalys kommer att förändra agent-arbetsflöden.”

“Beslutet att använda FP8 end-to-end träning samtidigt som man bibehåller BF16 i känsliga lager är en mästarklass i stabilitetsoptimeringar.”

“Detta är första gången jag har sett en öppen modell faktiskt slå Gemini 1.5 Pro på komplexa multimodala agent-uppgifter.”

“Den 19x förbättringen av decoding throughput jämfört med Qwen3-Max gör detta till ett hållbart alternativ för agenter på produktionsnivå.”

“Jag blev överraskad av hur väl den hanterar 4-bit kvantisering. Den behåller nästan all reasoning-kapacitet på en konfiguration med dubbla A100.”

Videor om Qwen3.5-397B-A17B

Se handledningar, recensioner och diskussioner om Qwen3.5-397B-A17B

“En modell med 397 miljarder parametrar, men med 17 miljarder aktiva.”

“Vid decoding på 256K är denna modell 19 gånger snabbare än Qwen 3 Max.”

“Det nativa stödet för vision-language reasoning är vad som skiljer den åt för agentic arbetsflöden.”

“Den slår de flesta closed-source modeller på standardiserade matematiska benchmarks.”

“Att köra denna lokalt är svårt, men de kvantiserade versionerna fungerar på high-end Mac-datorer.”

“397 miljarder parametrar med 17 miljarder aktiva. Den är nativt multimodal.”

“Det är förmodligen den bästa open-source multimodala modellen just nu.”

“Förmågan att nativt bearbeta två timmars video är en massiv fördel.”

“Titta på dessa logik-poäng, den når GPT-4o-nivåer konsekvent.”

“Apache-licensen gör den mycket attraktiv för datasekretess inom företag.”

“OCR strukturerad extraktion. Du har en rörig PDF... och du behöver göra om den till ren JSON. Den här modellen excellerar där.”

“Du får intelligensen från en jätte på 400 miljarder parametrar... men betalar beräkningskostnaden för en modell på 17 miljarder.”

“Den hanterar long-context retrieval bättre än den tidigare versionen.”

“Integreringen för verktygsanvändning är inbyggd i grundträningen, inte något som lagts till i efterhand.”

“Thinking-läget tillåter den att korrigera sin egen logik innan den genererar output.”

Superladda ditt arbetsflode med AI-automatisering

Automatio kombinerar kraften av AI-agenter, webbautomatisering och smarta integrationer for att hjalpa dig astadkomma mer pa kortare tid.

Proffs-tips for Qwen3.5-397B-A17B

Experttips for att hjalpa dig fa ut det mesta av Qwen3.5-397B-A17B och uppna battre resultat.

Aktivera Thinking Mode

Skicka med parametern 'enable_thinking: true' i ditt API-anrop för att aktivera djupgående reasoning för matematik, programmering och komplexa logiska problem.

Använd Fast Mode

Använd 'Fast'-läget för enkla frågor för att få omedelbara svar utan att förbruka tokens på onödiga interna tänkande-faser.

Optimera videoprompts

Vid analys av video, uppmana modellen att fokusera på det slutgiltiga dynamiska resultatet snarare än bild-för-bild-analys för bättre temporal koherens.

Utnyttja kvantisering

Använd 4-bit eller 8-bit kvantisering (GGUF/EXL2) för att köra modellen på konsumenthårdvara om du har tillräckligt med VRAM (200GB+).

Omdomen

Vad vara anvandare sager

Ga med tusentals nojda anvandare som har transformerat sitt arbetsflode

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Relaterat AI Models

GPT-5.1

OpenAI

GPT-5.1 is OpenAI’s advanced reasoning flagship featuring adaptive thinking, native multimodality, and state-of-the-art performance in math and technical...

Kimi K2.5

Moonshot

Discover Moonshot AI's Kimi K2.5, a 1T-parameter open-source agentic model featuring native multimodal capabilities, a 262K context window, and SOTA reasoning.

Grok-4

xAI

Grok-4 by xAI is a frontier model featuring a 2M token context window, real-time X platform integration, and world-record reasoning capabilities.

Claude Opus 4.5

Anthropic

Claude Opus 4.5 is Anthropic's most powerful frontier model, delivering record-breaking 80.9% SWE-bench performance and advanced autonomous agency for coding.

Gemini 3.1 Flash-Lite

Gemini 3.1 Flash-Lite is Google's fastest, most cost-efficient model. Features 1M context, native multimodality, and 363 tokens/sec speed for scale.

Claude Sonnet 4.6

Anthropic

Claude Sonnet 4.6 offers frontier performance for coding and computer use with a massive 1M token context window for only $3/1M tokens.

DeepSeek v4

DeepSeek

DeepSeek v4 is a 1.6T parameter MoE model featuring a 1M token context window and native multimodal support for text, vision, and video at disruptive prices.

Gemini 3 Flash

Gemini 3 Flash is Google's high-speed multimodal model featuring a 1M token context window, elite 90.4% GPQA reasoning, and autonomous browser automation tools.

Vanliga fragor om Qwen3.5-397B-A17B

Hitta svar pa vanliga fragor om Qwen3.5-397B-A17B