วิธี Scrape ข้อมูล Open Collective: คู่มือดึงข้อมูลทางการเงินและผู้ร่วมสมทบ

เรียนรู้วิธีการ scrape ข้อมูล Open Collective เพื่อดึงธุรกรรมทางการเงิน รายชื่อผู้ร่วมสมทบ และข้อมูลการระดมทุนของโปรเจกต์...

ตรวจพบการป้องกันบอท

- Cloudflare

- WAF และการจัดการบอทระดับองค์กร ใช้ JavaScript challenges, CAPTCHAs และการวิเคราะห์พฤติกรรม ต้องมีระบบอัตโนมัติของเบราว์เซอร์พร้อมการตั้งค่าซ่อนตัว

- การจำกัดอัตรา

- จำกัดคำขอต่อ IP/เซสชันตามเวลา สามารถหลีกเลี่ยงได้ด้วยพร็อกซีหมุนเวียน การหน่วงเวลาคำขอ และการสแกรปแบบกระจาย

- WAF

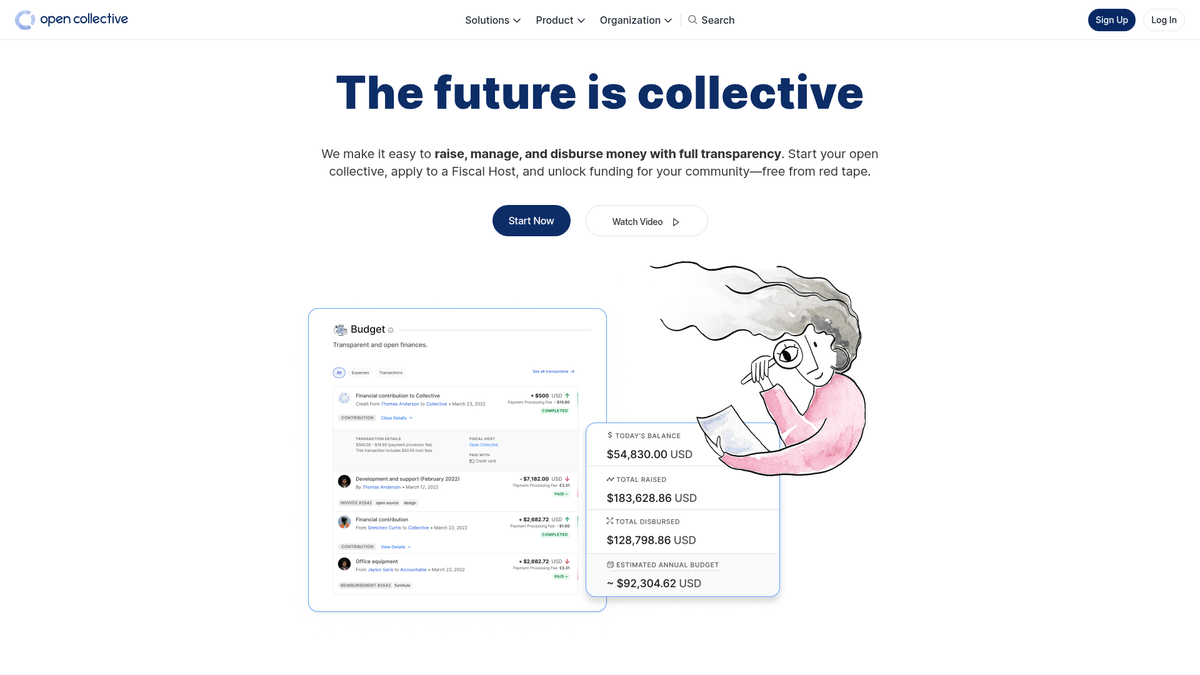

เกี่ยวกับ Open Collective

ค้นพบสิ่งที่ Open Collective นำเสนอและข้อมูลที่มีค่าที่สามารถดึงได้

เกี่ยวกับ Open Collective

Open Collective เป็นแพลตฟอร์มทางการเงินและกฎหมายที่มีเอกลักษณ์เฉพาะตัว ออกแบบมาเพื่อสร้างความโปร่งใสให้กับองค์กรที่ขับเคลื่อนโดยชุมชน โปรเจกต์ open-source และสมาคมต่างๆ ด้วยการทำหน้าที่เป็นเครื่องมือระดมทุนแบบกระจายศูนย์ ช่วยให้ 'กลุ่มคณะ' (collectives) สามารถระดมทุนและจัดการค่าใช้จ่ายได้โดยไม่ต้องมีนิติบุคคลที่เป็นทางการ โดยมักจะใช้ fiscal hosts สำหรับการสนับสนุนด้านการบริหาร โปรเจกต์เทคโนโลยีรายใหญ่ เช่น Babel และ Webpack ต่างพึ่งพาแพลตฟอร์มนี้ในการจัดการระบบนิเวศที่ได้รับเงินทุนจากชุมชน

แพลตฟอร์มนี้มีชื่อเสียงในด้านความโปร่งใสอย่างแท้จริง ทุกธุรกรรม ไม่ว่าจะเป็นการบริจาคจากบริษัทใหญ่หรือค่าใช้จ่ายเล็กๆ น้อยๆ สำหรับการพบปะในชุมชน จะถูกบันทึกและแสดงให้สาธารณะเห็น สิ่งนี้ให้ข้อมูลจำนวนมหาศาลเกี่ยวกับสุขภาพทางการเงินและพฤติกรรมการใช้จ่ายของ open-source ที่สำคัญที่สุดของโลก

การ scraping Open Collective มีมูลค่าสูงสำหรับองค์กรที่ต้องการทำวิจัยตลาดเกี่ยวกับเศรษฐกิจแบบ open-source ช่วยให้ผู้ใช้สามารถระบุลีดสปอนเซอร์ระดับองค์กร ติดตามแนวโน้มการระดมทุนของนักพัฒนา และตรวจสอบความยั่งยืนทางการเงินของโปรเจกต์ซอฟต์แวร์ที่สำคัญ ข้อมูลนี้ทำหน้าที่เป็นหน้าต่างโดยตรงสู่การไหลเวียนของเงินทุนภายในชุมชนนักพัฒนาระดับโลก

ทำไมต้อง Scrape Open Collective?

ค้นพบคุณค่าทางธุรกิจและกรณีการใช้งานสำหรับการดึงข้อมูลจาก Open Collective

วิเคราะห์ความยั่งยืนของโครงการ open-source ที่สำคัญ

ระบุลีดสปอนเซอร์ระดับองค์กรที่มีศักยภาพสำหรับบริการแบบ B2B

ตรวจสอบแนวโน้มการระดมทุนแบบกระจายศูนย์ใน tech stack ต่างๆ

ดำเนินการวิจัยทางวิชาการเกี่ยวกับระบบการเงินแบบ peer-to-peer

ตรวจสอบการใช้จ่ายของกลุ่มไม่แสวงหากำไรและกลุ่มชุมชนเพื่อความโปร่งใส

ติดตามการมีส่วนร่วมของคู่แข่งในการเป็นสปอนเซอร์โปรเจกต์ชุมชน

ความท้าทายในการ Scrape

ความท้าทายทางเทคนิคที่คุณอาจพบเมื่อ Scrape Open Collective

การจัดการคิวรี GraphQL ที่ซับซ้อนสำหรับการดึงข้อมูลแบบซ้อนกันลึก

การจัดการกับ dynamic Next.js hydration และการเลื่อนหน้าแบบ infinite scroll

การก้าวข้ามการป้องกันของ Cloudflare สำหรับการส่งคำขอด้วยความถี่สูง

การรับมือกับการจำกัดอัตราคำขอที่เข้มงวดทั้งในส่วน API และหน้าเว็บ

สกัดข้อมูลจาก Open Collective ด้วย AI

ไม่ต้องเขียนโค้ด สกัดข้อมูลภายในไม่กี่นาทีด้วยระบบอัตโนมัติที่ขับเคลื่อนด้วย AI

วิธีการทำงาน

อธิบายสิ่งที่คุณต้องการ

บอก AI ว่าคุณต้องการสกัดข้อมูลอะไรจาก Open Collective แค่พิมพ์เป็นภาษาธรรมชาติ — ไม่ต้องเขียนโค้ดหรือตัวเลือก

AI สกัดข้อมูล

ปัญญาประดิษฐ์ของเรานำทาง Open Collective จัดการเนื้อหาแบบไดนามิก และสกัดข้อมูลตรงตามที่คุณต้องการ

รับข้อมูลของคุณ

รับข้อมูลที่สะอาดและมีโครงสร้างพร้อมส่งออกเป็น CSV, JSON หรือส่งตรงไปยังแอปของคุณ

ทำไมต้องใช้ AI ในการสกัดข้อมูล

AI ทำให้การสกัดข้อมูลจาก Open Collective เป็นเรื่องง่ายโดยไม่ต้องเขียนโค้ด แพลตฟอร์มที่ขับเคลื่อนด้วยปัญญาประดิษฐ์ของเราเข้าใจว่าคุณต้องการข้อมูลอะไร — แค่อธิบายเป็นภาษาธรรมชาติ แล้ว AI จะสกัดให้โดยอัตโนมัติ

How to scrape with AI:

- อธิบายสิ่งที่คุณต้องการ: บอก AI ว่าคุณต้องการสกัดข้อมูลอะไรจาก Open Collective แค่พิมพ์เป็นภาษาธรรมชาติ — ไม่ต้องเขียนโค้ดหรือตัวเลือก

- AI สกัดข้อมูล: ปัญญาประดิษฐ์ของเรานำทาง Open Collective จัดการเนื้อหาแบบไดนามิก และสกัดข้อมูลตรงตามที่คุณต้องการ

- รับข้อมูลของคุณ: รับข้อมูลที่สะอาดและมีโครงสร้างพร้อมส่งออกเป็น CSV, JSON หรือส่งตรงไปยังแอปของคุณ

Why use AI for scraping:

- ดึงข้อมูลทางการเงินที่ซับซ้อนโดยไม่ต้องเขียนคิวรี GraphQL

- จัดการการเรนเดอร์ JavaScript และ infinite scroll โดยอัตโนมัติ

- ตั้งเวลาการทำงานซ้ำเพื่อติดตามการเปลี่ยนแปลงงบประมาณของโปรเจกต์

- ก้าวข้ามมาตรการป้องกันบอทผ่านการประมวลผลบนคลาวด์แบบกระจายศูนย์

No-code web scrapers สำหรับ Open Collective

ทางเลือกแบบ point-and-click สำหรับการ scraping ด้วย AI

เครื่องมือ no-code หลายตัวเช่น Browse.ai, Octoparse, Axiom และ ParseHub สามารถช่วยคุณ scrape Open Collective โดยไม่ต้องเขียนโค้ด เครื่องมือเหล่านี้มักใช้อินเทอร์เฟซแบบภาพเพื่อเลือกข้อมูล แม้ว่าอาจมีปัญหากับเนื้อหาไดนามิกที่ซับซ้อนหรือมาตรการ anti-bot

ขั้นตอนการทำงานทั่วไปกับเครื่องมือ no-code

ความท้าทายทั่วไป

เส้นโค้งการเรียนรู้

การทำความเข้าใจ selectors และตรรกะการดึงข้อมูลต้องใช้เวลา

Selectors เสีย

การเปลี่ยนแปลงเว็บไซต์อาจทำให้เวิร์กโฟลว์ทั้งหมดเสียหาย

ปัญหาเนื้อหาไดนามิก

เว็บไซต์ที่ใช้ JavaScript มากต้องการวิธีแก้ไขที่ซับซ้อน

ข้อจำกัด CAPTCHA

เครื่องมือส่วนใหญ่ต้องการการแทรกแซงด้วยตนเองสำหรับ CAPTCHA

การบล็อก IP

การ scrape อย่างรุนแรงอาจส่งผลให้ IP ถูกบล็อก

No-code web scrapers สำหรับ Open Collective

เครื่องมือ no-code หลายตัวเช่น Browse.ai, Octoparse, Axiom และ ParseHub สามารถช่วยคุณ scrape Open Collective โดยไม่ต้องเขียนโค้ด เครื่องมือเหล่านี้มักใช้อินเทอร์เฟซแบบภาพเพื่อเลือกข้อมูล แม้ว่าอาจมีปัญหากับเนื้อหาไดนามิกที่ซับซ้อนหรือมาตรการ anti-bot

ขั้นตอนการทำงานทั่วไปกับเครื่องมือ no-code

- ติดตั้งส่วนขยายเบราว์เซอร์หรือสมัครใช้งานแพลตฟอร์ม

- นำทางไปยังเว็บไซต์เป้าหมายและเปิดเครื่องมือ

- เลือกองค์ประกอบข้อมูลที่ต้องการดึงด้วยการชี้และคลิก

- กำหนดค่า CSS selectors สำหรับแต่ละฟิลด์ข้อมูล

- ตั้งค่ากฎการแบ่งหน้าเพื่อ scrape หลายหน้า

- จัดการ CAPTCHA (มักต้องแก้ไขด้วยตนเอง)

- กำหนดค่าการตั้งเวลาสำหรับการรันอัตโนมัติ

- ส่งออกข้อมูลเป็น CSV, JSON หรือเชื่อมต่อผ่าน API

ความท้าทายทั่วไป

- เส้นโค้งการเรียนรู้: การทำความเข้าใจ selectors และตรรกะการดึงข้อมูลต้องใช้เวลา

- Selectors เสีย: การเปลี่ยนแปลงเว็บไซต์อาจทำให้เวิร์กโฟลว์ทั้งหมดเสียหาย

- ปัญหาเนื้อหาไดนามิก: เว็บไซต์ที่ใช้ JavaScript มากต้องการวิธีแก้ไขที่ซับซ้อน

- ข้อจำกัด CAPTCHA: เครื่องมือส่วนใหญ่ต้องการการแทรกแซงด้วยตนเองสำหรับ CAPTCHA

- การบล็อก IP: การ scrape อย่างรุนแรงอาจส่งผลให้ IP ถูกบล็อก

ตัวอย่างโค้ด

import requests

# จุดเชื่อมต่อ Open Collective GraphQL

url = 'https://api.opencollective.com/graphql/v2'

# คิวรี GraphQL เพื่อรับข้อมูลพื้นฐานเกี่ยวกับกลุ่มคณะ

query = '''

query {

collective(slug: "webpack") {

name

stats {

totalAmountReceived { value }

balance { value }

}

}

}

'''

headers = {'Content-Type': 'application/json'}

try:

# ส่งคำขอ POST ไปยัง API

response = requests.post(url, json={'query': query}, headers=headers)

response.raise_for_status()

data = response.json()

# ดึงและพิมพ์ชื่อและยอดเงินคงเหลือ

collective = data['data']['collective']

print(f"Name: {collective['name']}")

print(f"Balance: {collective['stats']['balance']['value']}")

except Exception as e:

print(f"An error occurred: {e}")เมื่อไหร่ควรใช้

เหมาะที่สุดสำหรับหน้า HTML แบบ static ที่มี JavaScript น้อย เหมาะสำหรับบล็อก ไซต์ข่าว และหน้าสินค้า e-commerce ธรรมดา

ข้อดี

- ●ประมวลผลเร็วที่สุด (ไม่มี overhead ของเบราว์เซอร์)

- ●ใช้ทรัพยากรน้อยที่สุด

- ●ง่ายต่อการทำงานแบบขนานด้วย asyncio

- ●เหมาะมากสำหรับ API และหน้า static

ข้อจำกัด

- ●ไม่สามารถรัน JavaScript ได้

- ●ล้มเหลวใน SPA และเนื้อหาไดนามิก

- ●อาจมีปัญหากับระบบ anti-bot ที่ซับซ้อน

วิธีสเครปข้อมูล Open Collective ด้วยโค้ด

Python + Requests

import requests

# จุดเชื่อมต่อ Open Collective GraphQL

url = 'https://api.opencollective.com/graphql/v2'

# คิวรี GraphQL เพื่อรับข้อมูลพื้นฐานเกี่ยวกับกลุ่มคณะ

query = '''

query {

collective(slug: "webpack") {

name

stats {

totalAmountReceived { value }

balance { value }

}

}

}

'''

headers = {'Content-Type': 'application/json'}

try:

# ส่งคำขอ POST ไปยัง API

response = requests.post(url, json={'query': query}, headers=headers)

response.raise_for_status()

data = response.json()

# ดึงและพิมพ์ชื่อและยอดเงินคงเหลือ

collective = data['data']['collective']

print(f"Name: {collective['name']}")

print(f"Balance: {collective['stats']['balance']['value']}")

except Exception as e:

print(f"An error occurred: {e}")Python + Playwright

from playwright.sync_api import sync_playwright

def scrape_opencollective():

with sync_playwright() as p:

# เปิดเบราว์เซอร์พร้อมรองรับ JS

browser = p.chromium.launch(headless=True)

page = browser.new_page()

page.goto('https://opencollective.com/discover')

# รอให้การ์ดกลุ่มคณะโหลดเสร็จ

page.wait_for_selector('.CollectiveCard')

# ดึงข้อมูลจาก DOM

collectives = page.query_selector_all('.CollectiveCard')

for c in collectives:

name = c.query_selector('h2').inner_text()

print(f'Found project: {name}')

browser.close()

scrape_opencollective()Python + Scrapy

import scrapy

import json

class OpenCollectiveSpider(scrapy.Spider):

name = 'opencollective'

start_urls = ['https://opencollective.com/webpack']

def parse(self, response):

# Open Collective ใช้ Next.js; ข้อมูลมักอยู่ใน script tag

next_data = response.xpath('//script[@id="__NEXT_DATA__"]/text()').get()

if next_data:

parsed_data = json.loads(next_data)

collective = parsed_data['props']['pageProps']['collective']

yield {

'name': collective.get('name'),

'balance': collective.get('stats', {}).get('balance'),

'currency': collective.get('currency')

}Node.js + Puppeteer

const puppeteer = require('puppeteer');

(async () => {

const browser = await puppeteer.launch();

const page = await browser.newPage();

await page.goto('https://opencollective.com/discover');

// รอให้เนื้อหาแบบไดนามิกโหลดเสร็จ

await page.waitForSelector('.CollectiveCard');

// ดึงข้อมูลจากองค์ประกอบเพื่อดึงชื่อออกมา

const data = await page.evaluate(() => {

return Array.from(document.querySelectorAll('.CollectiveCard')).map(el => ({

name: el.querySelector('h2').innerText

}));

});

console.log(data);

await browser.close();

})();คุณสามารถทำอะไรกับข้อมูล Open Collective

สำรวจการใช้งานจริงและข้อมูลเชิงลึกจากข้อมูล Open Collective

การพยากรณ์การเติบโตของ Open Source

ระบุเทคโนโลยีที่กำลังมาแรงโดยติดตามอัตราการเติบโตทางการเงินของหมวดหมู่กลุ่มคณะเฉพาะ

วิธีการนำไปใช้:

- 1ดึงรายได้รายเดือนสำหรับโปรเจกต์ยอดนิยมในแท็กเฉพาะ

- 2คำนวณอัตราการเติบโตรายปีแบบทบต้น (CAGR)

- 3สร้างภาพข้อมูลสุขภาพการระดมทุนของโปรเจกต์เพื่อคาดการณ์การยอมรับเทคโนโลยี

ใช้ Automatio เพื่อดึงข้อมูลจาก Open Collective และสร้างแอปพลิเคชันเหล่านี้โดยไม่ต้องเขียนโค้ด

คุณสามารถทำอะไรกับข้อมูล Open Collective

- การพยากรณ์การเติบโตของ Open Source

ระบุเทคโนโลยีที่กำลังมาแรงโดยติดตามอัตราการเติบโตทางการเงินของหมวดหมู่กลุ่มคณะเฉพาะ

- ดึงรายได้รายเดือนสำหรับโปรเจกต์ยอดนิยมในแท็กเฉพาะ

- คำนวณอัตราการเติบโตรายปีแบบทบต้น (CAGR)

- สร้างภาพข้อมูลสุขภาพการระดมทุนของโปรเจกต์เพื่อคาดการณ์การยอมรับเทคโนโลยี

- การหา Lead สำหรับธุรกิจ SaaS

ระบุโปรเจกต์ที่มีเงินทุนสนับสนุนดีซึ่งอาจต้องการเครื่องมือนักพัฒนา, บริการโฮสติ้ง หรือบริการระดับมืออาชีพ

- กรองกลุ่มคณะตามงบประมาณและจำนวนเงินระดมทุนทั้งหมด

- ดึงคำอธิบายโปรเจกต์และ URL เว็บไซต์ภายนอก

- ตรวจสอบ tech stack ผ่าน GitHub repositories ที่เชื่อมโยงไว้

- การตรวจสอบกิจกรรมการกุศลขององค์กร

ติดตามว่าบริษัทรายใหญ่ใช้จ่ายงบประมาณเพื่อสนับสนุน open-source ที่ไหนบ้าง

- Scrape รายชื่อผู้ร่วมสมทบสำหรับโปรเจกต์ชั้นนำ

- กรองโปรไฟล์ที่เป็นระดับองค์กรเทียบกับโปรไฟล์ส่วนบุคคล

- รวบรวมยอดเงินบริจาคแยกตามหน่วยงานองค์กร

- การวิจัยผลกระทบต่อชุมชน

วิเคราะห์ว่ากลุ่มแบบกระจายศูนย์กระจายเงินทุนอย่างไรเพื่อทำความเข้าใจผลกระทบทางสังคม

- Scrape บัญชีธุรกรรมฉบับเต็มสำหรับกลุ่มคณะเฉพาะ

- จัดหมวดหมู่ค่าใช้จ่าย (ค่าเดินทาง, เงินเดือน, ฮาร์ดแวร์)

- สร้างรายงานเกี่ยวกับการจัดสรรทรัพยากรภายในกลุ่มชุมชน

- ระบบรวบรวมรายชื่อเพื่อการรับสมัครนักพัฒนา

ค้นหาผู้นำที่มีบทบาทในระบบนิเวศเฉพาะโดยพิจารณาจากประวัติการจัดการชุมชนและการร่วมสมทบของพวกเขา

- Scrape รายชื่อสมาชิกของกลุ่มเทคนิคที่สำคัญ

- ตรวจสอบข้อมูลอ้างอิงไขว้ระหว่างผู้ร่วมสมทบกับโปรไฟล์โซเชียลสาธารณะของพวกเขา

- ระบุผู้ดูแลหลัก (maintainers) ที่มีความเคลื่อนไหวเพื่อการติดต่อสื่อสารระดับสูง

เพิ่มพลังให้เวิร์กโฟลว์ของคุณด้วย ระบบอัตโนมัติ AI

Automatio รวมพลังของ AI agents การอัตโนมัติเว็บ และการผสานรวมอัจฉริยะเพื่อช่วยให้คุณทำงานได้มากขึ้นในเวลาน้อยลง

เคล็ดลับมืออาชีพสำหรับการ Scrape Open Collective

คำแนะนำจากผู้เชี่ยวชาญสำหรับการดึงข้อมูลจาก Open Collective อย่างประสบความสำเร็จ

ให้ความสำคัญกับการใช้งาน GraphQL API อย่างเป็นทางการแทนการทำ web scraping เพื่อให้ได้ผลลัพธ์ที่เสถียรและมีโครงสร้างที่ชัดเจนกว่า

เมื่อทำ scraping จากส่วนหน้า (front-end) ให้ใช้แอตทริบิวต์ 'data-cy' ในการเลือก selector เพื่อความเสถียรที่ดียิ่งขึ้นระหว่างการอัปเดตไซต์

ตั้งค่าการหน่วงเวลาแบบสุ่มระหว่าง 2-5 วินาที เพื่อเลียนแบบการท่องเว็บของมนุษย์และหลีกเลี่ยงการถูกจำกัดอัตราคำขอ (rate-limiting)

ใช้ rotating residential proxies หากคุณต้องการทำการค้นหาในปริมาณมากผ่านหน้า /discover

ตรวจสอบไฟล์ robots.txt เพื่อให้แน่ใจว่าความถี่ในการ scraping ของคุณเป็นไปตามพารามิเตอร์ crawl-delay ที่เว็บไซต์อนุญาต

คำรับรอง

ผู้ใช้ของเราพูดอย่างไร

เข้าร่วมกับผู้ใช้ที่พึงพอใจนับพันที่ได้เปลี่ยนแปลงเวิร์กโฟลว์ของพวกเขา

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

ที่เกี่ยวข้อง Web Scraping

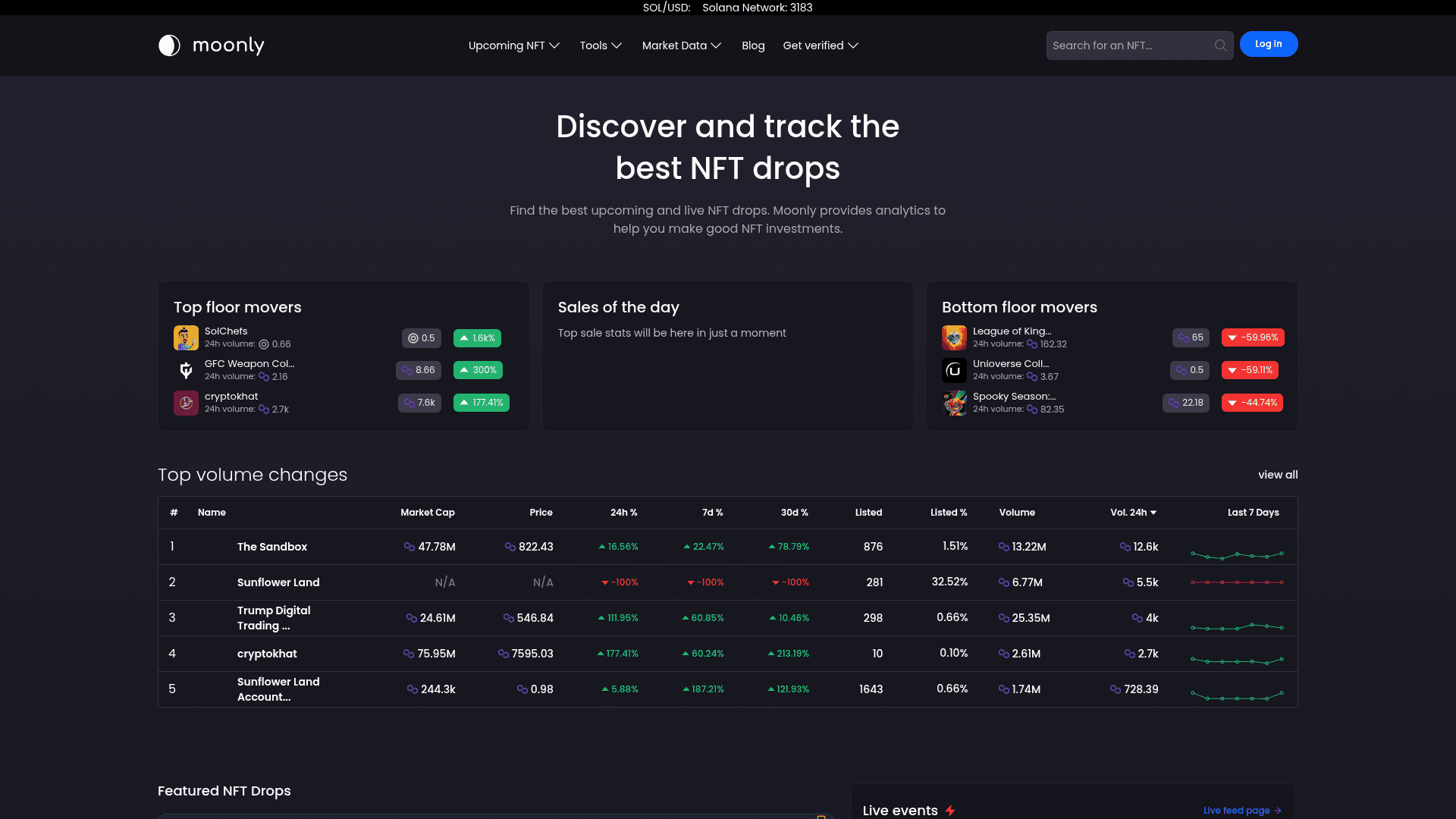

How to Scrape Moon.ly | Step-by-Step NFT Data Extraction Guide

How to Scrape Yahoo Finance: Extract Stock Market Data

How to Scrape Rocket Mortgage: A Comprehensive Guide

How to Scrape jup.ag: Jupiter DEX Web Scraper Guide

How to Scrape Indiegogo: The Ultimate Crowdfunding Data Extraction Guide

How to Scrape ICO Drops: Comprehensive Crypto Data Guide

How to Scrape Crypto.com: Comprehensive Market Data Guide

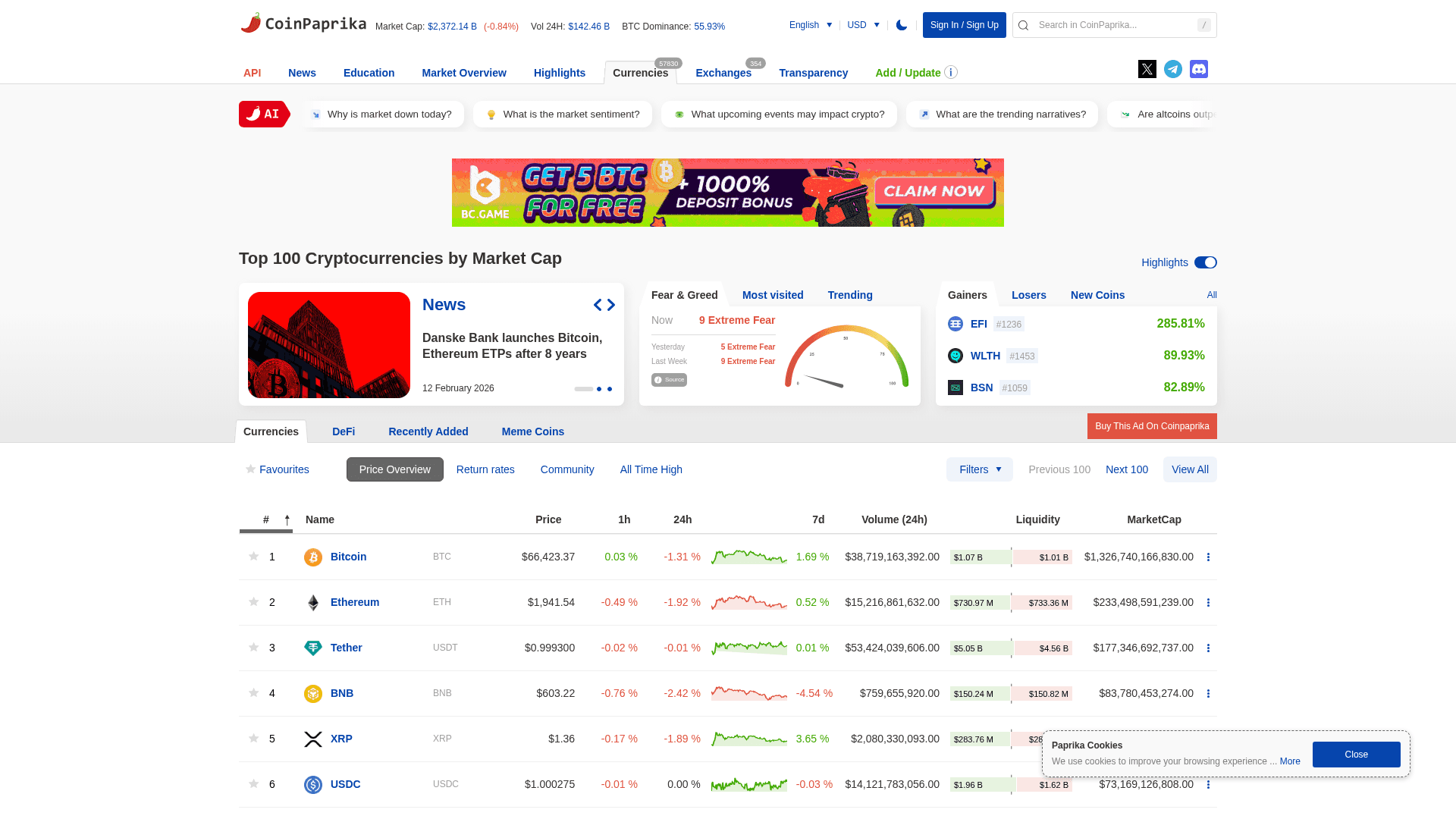

How to Scrape Coinpaprika: Crypto Market Data Extraction Guide

คำถามที่พบบ่อยเกี่ยวกับ Open Collective

ค้นหาคำตอบสำหรับคำถามทั่วไปเกี่ยวกับ Open Collective