Qwen3.6-Max-Preview

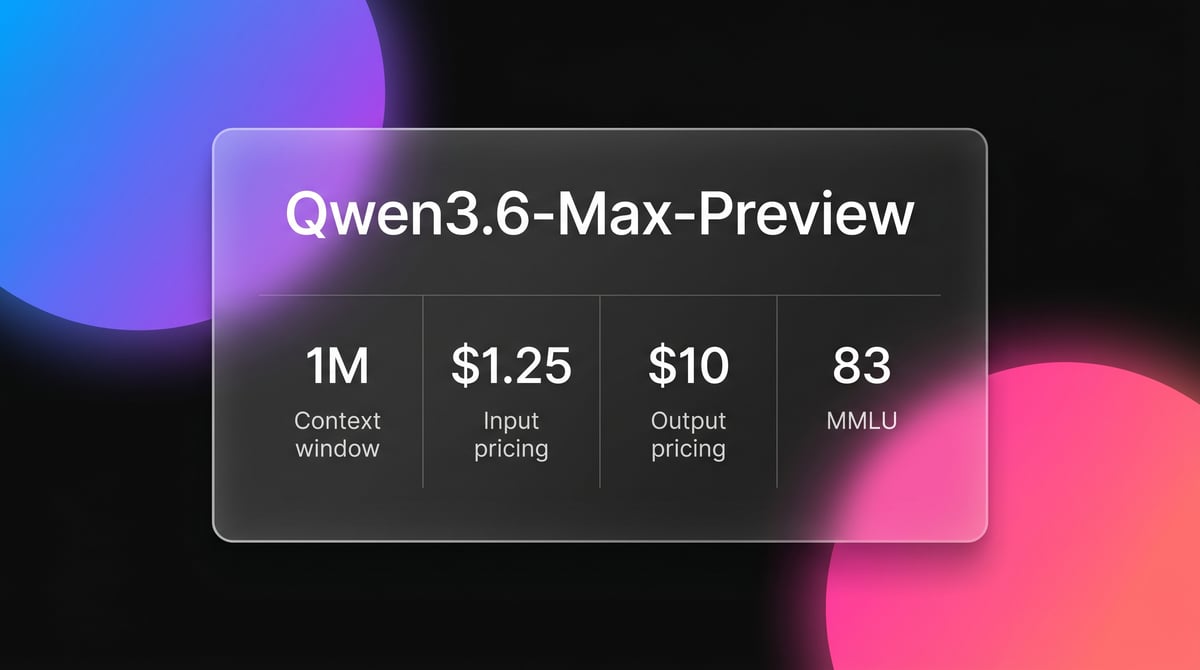

Qwen3.6-Max-Preview คือโมเดล MoE flagship ของ Alibaba ที่มาพร้อมกับ context 1 ล้าน tokens, ระบบ thinking mode ในตัว และคะแนน SOTA ในด้านการเขียนโค้ดและตรรกะแบบ...

เกี่ยวกับ Qwen3.6-Max-Preview

เรียนรู้เกี่ยวกับความสามารถของ Qwen3.6-Max-Preview คุณสมบัติ และวิธีที่จะช่วยให้คุณได้ผลลัพธ์ที่ดีขึ้น

Qwen3.6-Max-Preview เป็นโมเดลภาษาขนาดใหญ่ที่เป็น proprietary flagship จาก Alibaba ซึ่งแสดงถึงก้าวต่อไปในซีรีส์ AI ประสิทธิภาพสูงของพวกเขา โดยใช้สถาปัตยกรรม Mixture-of-Experts (MoE) ที่มีความเบาบาง (sparse) โมเดลนี้บรรลุความลึกในการใช้เหตุผลระดับระบบที่มีพารามิเตอร์นับล้านล้านตัว ในขณะที่ยังคงประสิทธิภาพการทำงานที่ยอดเยี่ยม โดยได้รับการปรับแต่งเป็นพิเศษสำหรับงาน agentic coding, ความรู้รอบตัว และการทำตามคำสั่งที่ซับซ้อน

จุดเด่นของโมเดลคือ Thinking Mode แบบเนทีฟ ซึ่งช่วยให้ระบบสามารถสร้าง chain-of-thought ภายในที่ผู้ใช้สามารถมองเห็นได้ก่อนที่จะส่งมอบคำตอบสุดท้าย ความโปร่งใสนี้มีค่าอย่างยิ่งสำหรับนักพัฒนาที่สร้าง autonomous agents เนื่องจากเป็นช่องทางที่ชัดเจนในการมองเห็นการวางแผนทางตรรกะและขั้นตอนการแก้ไขข้อผิดพลาด เมื่อรวมกับ 1-million-token context window ขนาดใหญ่ ทำให้โมเดลสามารถนำเข้าโครงการทั้งหมดหรือห้องสมุดเอกสารที่กว้างขวางได้ในการผ่านเพียงครั้งเดียว

Qwen3.6-Max-Preview ซึ่งโฮสต์อยู่บน Alibaba Cloud Model Studio รองรับโปรโตคอลมาตรฐานอุตสาหกรรมและเข้ากันได้กับข้อมูลจำเพาะของ API สไตล์ OpenAI โมเดลนี้ได้รับการออกแบบมาให้เป็นตัวเลือกหลักสำหรับองค์กรที่ต้องการขีดความสามารถด้าน AI ระดับ frontier สำหรับการวิเคราะห์ข้อมูลแบบ multimodal และเวิร์กโฟลว์ agentic ที่แข็งแกร่ง ซึ่งนำเสนอทางเลือกประสิทธิภาพสูงที่แตกต่างจากโมเดล closed-source ของตะวันตก

กรณีการใช้งานสำหรับ Qwen3.6-Max-Preview

ค้นพบวิธีต่างๆ ที่คุณสามารถใช้ Qwen3.6-Max-Preview เพื่อได้ผลลัพธ์ที่ยอดเยี่ยม

วิศวกรรมซอฟต์แวร์อัตโนมัติ (Autonomous Software Engineering)

ใช้งานโมเดลในฐานะ coding agent ที่สามารถนำทางผ่าน codebase ทั้งหมด วางแผนการเปลี่ยนแปลงทางสถาปัตยกรรม และแก้ไขบั๊กข้ามหลายไฟล์ได้

การวิเคราะห์ทางเทคนิคขนาดใหญ่

ใช้ประโยชน์จาก 1M context window เพื่ออ่านชุดเอกสารหรือกรอบกฎหมายทั้งหมดสำหรับการวิเคราะห์เชิงลึกโดยไม่มีข้อจำกัดแบบ RAG

การใช้เหตุผลและการวางแผนที่ซับซ้อน

ใช้ Thinking Mode เพื่อแก้โจทย์คณิตศาสตร์ระดับสูงที่ต้องการแผนการภายในหลายขั้นตอนเพื่อให้เกิดความแม่นยำ

การทำความเข้าใจเนื้อหาแบบ Multimodal

วิเคราะห์ทั้งภาพนิ่งและลำดับวิดีโอที่ซับซ้อนเพื่อดึงข้อมูลและสรุปเหตุการณ์ทางภาพที่มีความเคลื่อนไหว

การใช้งานผ่าน Terminal แบบโต้ตอบ

สร้างเครื่องมือที่ช่วยให้ AI สามารถโต้ตอบกับเชลล์และสภาพแวดล้อม CLI ได้โดยตรง โดยได้รับประโยชน์จากประสิทธิภาพที่ปรับแต่งมาเพื่อ Terminal-Bench

เวิร์กโฟลว์ Agentic สำหรับองค์กร

บูรณาการโมเดลเข้ากับไปป์ไลน์ธุรกิจที่ซับซ้อน ซึ่งต้องการความเชื่อมั่นในคำสั่งที่สูงและการเรียกใช้เครื่องมือที่ซับซ้อนสำหรับระบบอัตโนมัติ

จุดแข็ง

ข้อจำกัด

เริ่มต้นด่วน API

alibaba/qwen3.6-max-preview

import OpenAI from 'openai';

const client = new OpenAI({

apiKey: process.env.DASHSCOPE_API_KEY,

base_url: 'https://dashscope-intl.aliyuncs.com/compatible-mode/v1',

});

async function main() {

const completion = await client.chat.completions.create({

model: 'qwen3.6-max-preview',

messages: [{ role: 'user', content: 'Design a system architecture for a real-time AI agent.' }],

extra_body: { enable_thinking: true },

stream: true

});

for await (const chunk of completion) {

process.stdout.write(chunk.choices[0]?.delta?.content || '');

}

}

main();ติดตั้ง SDK และเริ่มเรียก API ภายในไม่กี่นาที

ผู้คนพูดอะไรเกี่ยวกับ Qwen3.6-Max-Preview

ดูว่าชุมชนคิดอย่างไรเกี่ยวกับ Qwen3.6-Max-Preview

“ประสิทธิภาพที่คุณคาดหวังจากโมเดลที่รันบนเซิร์ฟเวอร์ขนาดใหญ่ ตอนนี้มาอยู่บนเดสก์ท็อปของคุณแล้ว”

“Qwen3.6-Max-Preview เพิ่งเอาชนะ Claude Opus 4.5 บน SWE-Bench Pro ได้ จีนกำลังไล่ตามมาอย่างรวดเร็ว”

“ที่ราคา 1.25 ดอลลาร์ต่อล้าน tokens Qwen นั้นถูกกว่า Claude อย่างมากสำหรับการนำข้อมูลขนาดใหญ่เข้าสู่ระบบ”

“ความจริงที่ว่า Thinking Mode ถูกฝังมาเป็นสถานะเริ่มต้น เป็นทางเลือกการออกแบบที่มีความหมายสำหรับความน่าเชื่อถือของ agent”

“Qwen ได้เปิดตัว Qwen 3.6 Max Preview ในฐานะโมเดล flagship proprietary ระดับท็อปใหม่”

“มันแสดงให้เห็นถึงการเขียนโค้ดแบบ agentic ที่ดีขึ้นและความน่าเชื่อถือของ agent ในโลกจริงที่เหนือกว่ารุ่น Plus”

วิดีโอเกี่ยวกับ Qwen3.6-Max-Preview

ดูบทเรียน รีวิว และการสนทนาเกี่ยวกับ Qwen3.6-Max-Preview

“Qwen ได้เปิดตัว Qwen 3.6 Max Preview ในฐานะโมเดล flagship proprietary ระดับท็อปใหม่”

“โมเดลแสดงการก้าวกระโดดที่แข็งแกร่งในด้านการทำ coding-agent benchmarks เช่น SkillsBench และ Terminal-Bench 2.0”

“Qwen กำลังพยายามแข่งขันในระดับสูงอย่างจริงจังกับโมเดลอย่าง Claude 4.5 Opus”

“โมเดลนี้แสดงถึงการปรับปรุงที่มีความหมายในด้านความรู้รอบตัวและการทำตามคำสั่ง”

“การก้าวกระโดดของประสิทธิภาพบน SWE-bench คือสิ่งที่ทำให้รุ่นนี้แตกต่างจากรุ่น Plus อย่างแท้จริง”

“เรื่องราวของ benchmark คือการวางตำแหน่ง Max Preview ที่ให้บริการแบบโฮสต์ให้แตกต่างจากตระกูล open-weight”

“เราใช้ Qwen Code pages และ repo surfaces เพื่อตัดสินความลึกของระบบนิเวศนอกเหนือจากตัวน้ำหนักโมเดล”

“Thinking mode นั้นรวดเร็วอย่างน่าประหลาดใจเมื่อเทียบกับโมเดลสไตล์ o1 จากปีที่แล้ว”

“สิ่งนี้ถูกออกแบบมาอย่างชัดเจนสำหรับนักพัฒนาองค์กรที่ต้องการ API ที่เชื่อถือได้สำหรับงาน agentic”

“ประสิทธิภาพด้าน Multimodal vision กำลังตาม Gemini 2 ทันในการทดสอบการวิเคราะห์เอกสารบางประเภท”

“วิดีโอนี้แนะนำ Qwen3.6-Max-Preview ซึ่งเป็นภาพรวมแรกของโมเดล flagship ตัวต่อไปจาก Qwen”

“มันแสดงให้เห็นถึงการเขียนโค้ดแบบ agentic ที่ดีขึ้นและความน่าเชื่อถือของ agent ในโลกจริงที่เหนือกว่ารุ่น Plus”

“Context window ขนาด 1M นั้นมีความเสถียรมากกว่าสิ่งที่เราเห็นใน Qwen 2 รุ่นแรกๆ”

“หากคุณต้องเขียนโค้ดจำนวนมาก Qwen 3.6 Max คือผู้นำ benchmark ในปัจจุบัน”

“ราคายังคงมีความสามารถในการแข่งขันสูงแม้จะเป็นโมเดล flagship แบบ closed-source ก็ตาม”

เพิ่มพลังให้เวิร์กโฟลว์ของคุณด้วย ระบบอัตโนมัติ AI

Automatio รวมพลังของ AI agents การอัตโนมัติเว็บ และการผสานรวมอัจฉริยะเพื่อช่วยให้คุณทำงานได้มากขึ้นในเวลาน้อยลง

เคล็ดลับมือโปรสำหรับ Qwen3.6-Max-Preview

เคล็ดลับจากผู้เชี่ยวชาญเพื่อช่วยให้คุณใช้ประโยชน์สูงสุดจาก Qwen3.6-Max-Preview และได้ผลลัพธ์ที่ดีขึ้น

เปิดใช้งาน Internal Reasoning

ตั้งค่าพารามิเตอร์ 'enable_thinking' เป็น true ใน API request ของคุณ เพื่อดูตรรกะภายในของโมเดลสำหรับการดีบั๊กงานที่ต้องใช้การใช้เหตุผลที่ซับซ้อน

รักษาความต่อเนื่องของตรรกะระยะยาว

ใช้ฟีเจอร์ 'preserve_thinking' สำหรับการสนทนาแบบหลายเทิร์น เพื่อให้แน่ใจว่าโมเดลยังคงความสอดคล้องทางตรรกะตลอดทั้งเซสชัน

ป้อนข้อมูลห้องสมุดโค้ดทั้งหมด

ใช้ประโยชน์จาก 1M context window โดยการจัดเตรียมแหล่งข้อมูลต้นฉบับแบบเต็มแทนการแบ่งย่อยข้อมูล เพื่อความเข้าใจข้ามไฟล์ที่ดียิ่งขึ้น

ใช้ Endpoints ที่รองรับ

สำหรับแอปพลิเคชันทั่วโลก ให้ใช้ endpoints ในสิงคโปร์หรือสหรัฐอเมริกา (เวอร์จิเนีย) บน Alibaba Cloud เพื่อลด latency สำหรับผู้ใช้ระหว่างประเทศ

คำรับรอง

ผู้ใช้ของเราพูดอย่างไร

เข้าร่วมกับผู้ใช้ที่พึงพอใจนับพันที่ได้เปลี่ยนแปลงเวิร์กโฟลว์ของพวกเขา

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

ที่เกี่ยวข้อง AI Models

GLM-5

Zhipu (GLM)

GLM-5 is Zhipu AI's 744B parameter open-weight powerhouse, excelling in long-horizon agentic tasks, coding, and factual accuracy with a 200k context window.

GLM-5.1

Zhipu (GLM)

GLM-5.1 is Zhipu AI's flagship reasoning model, featuring a 202K context window and an autonomous 8-hour execution loop for complex agentic engineering.

GPT-5.2

OpenAI

GPT-5.2 is OpenAI's flagship model for professional tasks, featuring a 400K context window, elite coding, and deep multi-step reasoning capabilities.

Gemini 3.1 Flash-Lite

Gemini 3.1 Flash-Lite is Google's fastest, most cost-efficient model. Features 1M context, native multimodality, and 363 tokens/sec speed for scale.

Claude Opus 4.5

Anthropic

Claude Opus 4.5 is Anthropic's most powerful frontier model, delivering record-breaking 80.9% SWE-bench performance and advanced autonomous agency for coding.

Grok-4

xAI

Grok-4 by xAI is a frontier model featuring a 2M token context window, real-time X platform integration, and world-record reasoning capabilities.

Kimi K2 Thinking

Moonshot

Kimi K2 Thinking is Moonshot AI's trillion-parameter reasoning model. It outperforms GPT-5 on HLE and supports 300 sequential tool calls autonomously for...

Kimi K2.5

Moonshot

Discover Moonshot AI's Kimi K2.5, a 1T-parameter open-source agentic model featuring native multimodal capabilities, a 262K context window, and SOTA reasoning.

คำถามที่พบบ่อยเกี่ยวกับ Qwen3.6-Max-Preview

ค้นหาคำตอบสำหรับคำถามทั่วไปเกี่ยวกับ Qwen3.6-Max-Preview