Qwen3.6-Max-Preview

Qwen3.6-Max-Preview là mô hình MoE flagship của Alibaba với 1M context, chế độ thinking native và điểm số SOTA trong lĩnh vực lập trình và suy luận agentic.

Ve Qwen3.6-Max-Preview

Tim hieu ve kha nang cua Qwen3.6-Max-Preview, tinh nang va cach no co the giup ban dat ket qua tot hon.

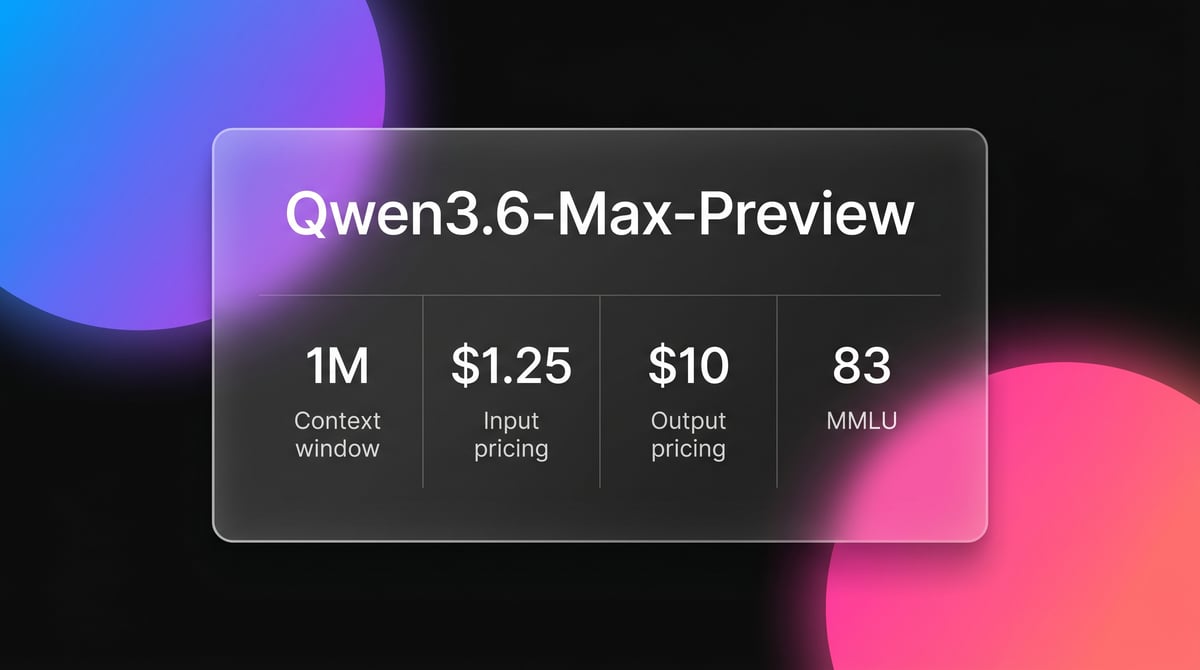

Qwen3.6-Max-Preview là mô hình ngôn ngữ lớn (LLM) proprietary flagship từ Alibaba, đại diện cho bước tiếp theo trong dòng AI hiệu năng cao của họ. Sử dụng kiến trúc Mixture-of-Experts (MoE) thưa thớt, mô hình đạt được chiều sâu suy luận của một hệ thống hàng nghìn tỷ tham số trong khi vẫn duy trì hiệu suất vận hành đáng kể. Nó được tối ưu hóa đặc biệt cho lập trình agentic, kiến thức thế giới và khả năng tuân thủ các hướng dẫn phức tạp.

Tính năng nổi bật của mô hình là Thinking Mode native, cho phép hệ thống tạo ra một chuỗi suy luận nội bộ có thể nhìn thấy trước khi đưa ra câu trả lời cuối cùng. Sự minh bạch này đặc biệt có giá trị đối với các nhà phát triển xây dựng các tác nhân tự hành (autonomous agents), vì nó cung cấp cái nhìn rõ ràng về quá trình lập kế hoạch logic và các bước sửa lỗi. Kết hợp với context window 1 triệu token khổng lồ, mô hình có thể nạp toàn bộ kho dự án hoặc các thư viện tài liệu chuyên sâu chỉ trong một lần xử lý.

Được lưu trữ trên Alibaba Cloud Model Studio, Qwen3.6-Max-Preview hỗ trợ các giao thức chuẩn công nghiệp và tương thích với các thông số kỹ thuật API kiểu OpenAI. Nó được thiết kế để trở thành lựa chọn hàng đầu cho các doanh nghiệp yêu cầu khả năng AI frontier-level cho phân tích dữ liệu multimodal và các quy trình công việc agentic mạnh mẽ, mang đến một giải pháp thay thế hiệu năng cao so với các mô hình closed-source phương Tây.

Truong hop su dung cho Qwen3.6-Max-Preview

Kham pha cac cach khac nhau ban co the su dung Qwen3.6-Max-Preview de dat ket qua tuyet voi.

Kỹ thuật phần mềm tự hành (Autonomous Software Engineering)

Triển khai mô hình như một coding agent có khả năng điều hướng toàn bộ codebase, lên kế hoạch thay đổi kiến trúc và sửa lỗi trên nhiều tệp tin.

Phân tích kỹ thuật quy mô lớn

Tận dụng context window 1M token để nạp toàn bộ bộ tài liệu hoặc khung pháp lý nhằm phân tích chuyên sâu mà không bị giới hạn bởi RAG.

Suy luận và Lập kế hoạch phức tạp

Tận dụng Thinking Mode native để giải các bài toán toán học cấp cao, nơi yêu cầu kế hoạch nội bộ gồm nhiều bước để đảm bảo độ chính xác.

Hiểu nội dung multimodal

Phân tích cả hình ảnh tĩnh và các chuỗi video phức tạp để trích xuất dữ liệu và tóm tắt các sự kiện trực quan động.

Thao tác terminal tương tác

Xây dựng các công cụ cho phép AI tương tác trực tiếp với các shell và môi trường CLI, tận dụng hiệu năng Terminal-Bench đã được tối ưu hóa.

Quy trình làm việc Agentic doanh nghiệp

Tích hợp mô hình vào các đường ống (pipelines) kinh doanh phức tạp, nơi yêu cầu độ tin cậy cao trong việc thực hiện hướng dẫn và khả năng gọi công cụ tinh vi cho tự động hóa.

Diem manh

Han che

Bat dau nhanh API

alibaba/qwen3.6-max-preview

import OpenAI from 'openai';

const client = new OpenAI({

apiKey: process.env.DASHSCOPE_API_KEY,

base_url: 'https://dashscope-intl.aliyuncs.com/compatible-mode/v1',

});

async function main() {

const completion = await client.chat.completions.create({

model: 'qwen3.6-max-preview',

messages: [{ role: 'user', content: 'Design a system architecture for a real-time AI agent.' }],

extra_body: { enable_thinking: true },

stream: true

});

for await (const chunk of completion) {

process.stdout.write(chunk.choices[0]?.delta?.content || '');

}

}

main();Cai dat SDK va bat dau thuc hien cac cuoc goi API trong vai phut.

Moi nguoi dang noi gi ve Qwen3.6-Max-Preview

Xem cong dong nghi gi ve Qwen3.6-Max-Preview

“Hiệu năng mà bạn mong đợi từ một mô hình chạy trên một trang trại máy chủ khổng lồ giờ đây đã nằm ngay trên máy tính để bàn của bạn.”

“Qwen3.6-Max-Preview vừa đánh bại Claude Opus 4.5 trên SWE-Bench Pro. Trung Quốc đang bắt kịp rất nhanh.”

“Với 1,25 USD mỗi triệu token, Qwen rẻ hơn đáng kể so với Claude cho việc nạp dữ liệu quy mô lớn.”

“Việc Thinking Mode được tích hợp sẵn làm trạng thái mặc định là một lựa chọn thiết kế có ý nghĩa cho độ tin cậy của agentic.”

“Qwen đã ra mắt Qwen 3.6 Max Preview như một mô hình flagship proprietary cao cấp mới.”

“Nó cho thấy khả năng lập trình agentic cải tiến và độ tin cậy của agent thực tế tốt hơn so với mô hình Plus.”

Video ve Qwen3.6-Max-Preview

Xem huong dan, danh gia va thao luan ve Qwen3.6-Max-Preview

“Qwen đã ra mắt Qwen 3.6 Max Preview như một mô hình flagship proprietary cao cấp mới.”

“Mô hình cho thấy bước nhảy vọt mạnh mẽ trong các benchmark coding-agent như SkillsBench và Terminal-Bench 2.0.”

“Qwen rõ ràng đang cố gắng cạnh tranh nghiêm túc ở phân khúc cao cấp với các mô hình như Claude 4.5 Opus.”

“Mô hình này đại diện cho sự cải thiện đáng kể về kiến thức thế giới và khả năng tuân thủ hướng dẫn.”

“Bước nhảy vọt về hiệu năng trên SWE-bench là điều thực sự tạo nên sự khác biệt so với phiên bản Plus.”

“Câu chuyện benchmark thực sự là về việc định vị bản Max Preview được lưu trữ tách biệt khỏi dòng open-weight.”

“Chúng tôi sử dụng các trang Qwen Code và bề mặt repo để đánh giá chiều sâu hệ sinh thái ngoài trọng số mô hình.”

“Thinking mode nhanh một cách đáng ngạc nhiên so với các mô hình kiểu o1 từ năm ngoái.”

“Mô hình này rõ ràng được thiết kế cho các nhà phát triển doanh nghiệp cần một API đáng tin cậy cho các tác vụ agentic.”

“Hiệu năng vision multimodal đang bắt kịp Gemini 2 trong một số bài kiểm tra phân tích tài liệu.”

“Video này giới thiệu Qwen3.6-Max-Preview, cái nhìn sớm về mô hình flagship tiếp theo từ Qwen.”

“Nó cho thấy khả năng lập trình agentic cải tiến và độ tin cậy của agent thực tế tốt hơn so với mô hình Plus.”

“Context window 1M ổn định hơn nhiều so với những gì chúng ta thấy trong các phiên bản Qwen 2 đầu tiên.”

“Nếu bạn đang lập trình nhiều, Qwen 3.6 Max hiện đang là đơn vị dẫn đầu benchmark.”

“Giá cả vẫn rất cạnh tranh ngay cả đối với mô hình closed-source flagship của họ.”

Tang cuong quy trinh lam viec cua ban voi Tu dong hoa AI

Automatio ket hop suc manh cua cac AI agent, tu dong hoa web va tich hop thong minh de giup ban lam duoc nhieu hon trong thoi gian ngan hon.

Meo chuyen nghiep cho Qwen3.6-Max-Preview

Meo chuyen gia giup ban tan dung toi da Qwen3.6-Max-Preview va dat ket qua tot hon.

Kích hoạt Internal Reasoning

Đặt tham số 'enable_thinking' thành true trong request API của bạn để xem logic nội bộ của mô hình nhằm debug các suy luận phức tạp.

Duy trì Long-Horizon Logic

Sử dụng tính năng 'preserve_thinking' cho các hội thoại nhiều lượt để đảm bảo mô hình duy trì sự nhất quán về logic trong suốt phiên làm việc.

Nạp toàn bộ thư viện

Tận dụng context window 1M bằng cách cung cấp toàn bộ tài liệu nguồn thay vì dữ liệu được chia nhỏ (chunked) để đạt được sự hiểu biết tốt hơn giữa các tệp tin.

Sử dụng các Endpoints tương thích

Đối với các ứng dụng toàn cầu, hãy sử dụng các endpoint tại Singapore hoặc US Virginia trên Alibaba Cloud để giảm thiểu latency theo vùng cho người dùng quốc tế.

Danh gia

Nguoi dung cua chung toi noi gi

Tham gia cung hang nghin nguoi dung hai long da thay doi quy trinh lam viec cua ho

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Lien quan AI Models

GLM-5

Zhipu (GLM)

GLM-5 is Zhipu AI's 744B parameter open-weight powerhouse, excelling in long-horizon agentic tasks, coding, and factual accuracy with a 200k context window.

GLM-5.1

Zhipu (GLM)

GLM-5.1 is Zhipu AI's flagship reasoning model, featuring a 202K context window and an autonomous 8-hour execution loop for complex agentic engineering.

GPT-5.2

OpenAI

GPT-5.2 is OpenAI's flagship model for professional tasks, featuring a 400K context window, elite coding, and deep multi-step reasoning capabilities.

Gemini 3.1 Flash-Lite

Gemini 3.1 Flash-Lite is Google's fastest, most cost-efficient model. Features 1M context, native multimodality, and 363 tokens/sec speed for scale.

Claude Opus 4.5

Anthropic

Claude Opus 4.5 is Anthropic's most powerful frontier model, delivering record-breaking 80.9% SWE-bench performance and advanced autonomous agency for coding.

Grok-4

xAI

Grok-4 by xAI is a frontier model featuring a 2M token context window, real-time X platform integration, and world-record reasoning capabilities.

Kimi K2 Thinking

Moonshot

Kimi K2 Thinking is Moonshot AI's trillion-parameter reasoning model. It outperforms GPT-5 on HLE and supports 300 sequential tool calls autonomously for...

Kimi K2.5

Moonshot

Discover Moonshot AI's Kimi K2.5, a 1T-parameter open-source agentic model featuring native multimodal capabilities, a 262K context window, and SOTA reasoning.

Cau hoi thuong gap ve Qwen3.6-Max-Preview

Tim cau tra loi cho cac cau hoi thuong gap ve Qwen3.6-Max-Preview