GLM-5.1

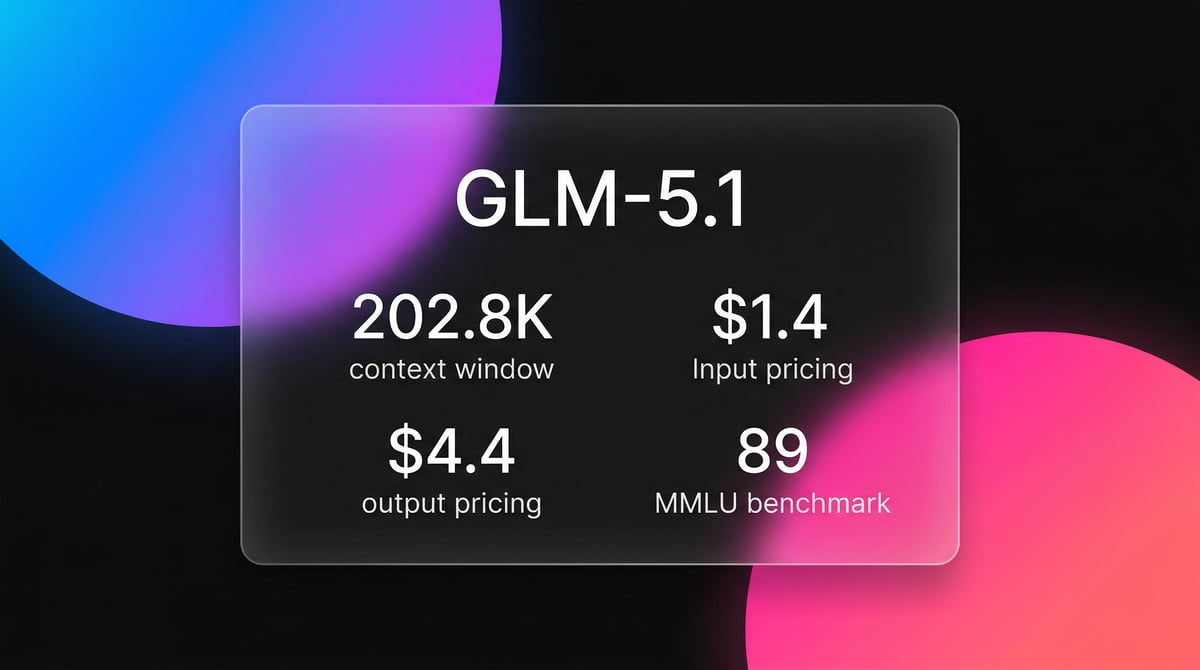

GLM-5.1 er Zhipu AI's flagship reasoning-model med et 202K context window og et autonomt 8-timers eksekveringsloop til kompleks agentic engineering.

Om GLM-5.1

Lær om GLM-5.1s muligheder, funktioner og hvordan den kan hjælpe dig med at opnå bedre resultater.

GLM-5.1 er Zhipu AI's flagship foundation-model designet til kompleks systemudvikling og langvarige agentic opgaver. Bygget på en Mixture-of-Experts (MoE)-arkitektur med 744 milliarder parametre og 40 milliarder aktive pr. gennemløb, repræsenterer den et betydeligt spring i udholdenhed og autonom problemløsning. Modellen er specifikt designet til at overvinde de reasoning-plateauer, man ser i tidligere store sprogmodeller, og opretholder produktivitet og kodekvalitet over tusindvis af tool-calls og hundredvis af iterationer. Den identificerer blokeringer, kører eksperimenter og justerer sin egen strategi uden menneskelig indgriben.

Teknisk set udmærker GLM-5.1 sig som en primær reasoning-motor i multi-agent systemer. Den håndterer arkitektoniske beslutninger på højt niveau, mens den uddelegerer implementering til mindre modeller. Den har et 202K context window understøttet af en dynamisk sparse attention-mekanisme, der sikrer sammenhæng på tværs af massive kodebaser. Modellen udgives som open weights under MIT-licensen og tilbyder et levedygtigt lokalt alternativ til proprietære frontier-modeller til opgaver som databaseoptimering, GPU-kerneludvikling og full-stack webudvikling.

KernelBench Level 3-resultater viser, at GLM-5.1 opretholder en væsentlig acceleration i agentic ML-workloads over lange forløb sammenlignet med Claude Opus 4.6. Denne udholdenhed giver udviklere mulighed for at starte en udviklingsopgave om morgenen og modtage en fuldt testet, implementeret service ved dagens afslutning. Den håndterer hele livscyklussen for en fejlrettelse, fra genskabelse af problemet i et sandbox-miljø til indsendelse af det endelige pull request.

Anvendelser for GLM-5.1

Opdag de forskellige måder, du kan bruge GLM-5.1 til at opnå gode resultater.

Autonom softwareudvikling

Den kører autonomt i over 8 timer for at designe, implementere og debugge microservices uden menneskelig vejledning.

Database-optimering med høj performance

Modellen optimerer iterativt Rust-baserede vector search-implementeringer over hundredvis af runder.

GPU-kerneloptimering

Den analyserer referenceimplementeringer for at producere hurtigere GPU-kernels, der udkonkurrerer standard autotune-kompilatorer.

Multi-agent orkestrering

Den fungerer som en reasoning-kerne, der koordinerer delopgaver og tool-calls på tværs af en sværm af specialiserede mindre modeller.

Komplekse terminalopgaver

Den udfører virkelige terminalhandlinger og systemadministration i flere trin via agentic CLI-værktøjer.

Full-stack webdesign

Modellen genererer visuelt konsistente UI-layouts og backend-logik til browserbaserede desktop-miljøer.

Styrker

Begrænsninger

API hurtig start

zhipu/glm-5.1

import OpenAI from 'openai';

const client = new OpenAI({

apiKey: process.env.ZHIPU_API_KEY,

baseURL: 'https://api.z.ai/api/paas/v4'

});

const chat = await client.chat.completions.create({

model: 'glm-5.1',

messages: [{ role: 'user', content: 'Optimér dette databaseskema.' }],

stream: true

});

for await (const chunk of chat) {

process.stdout.write(chunk.choices[0]?.delta?.content || '');

}Installér SDK'et og begynd at foretage API-kald på få minutter.

Hvad folk siger om GLM-5.1

Se hvad fællesskabet mener om GLM-5.1

“GLM-5.1 loopede på én prompt i 8 timer i træk. Den stoppede ikke som de fleste modeller; den fortsatte med at tilføje funktioner og selvevaluere.”

“Jeg har gennemtestet den op til 140k kontekst mindst 5 gange, og den forblev sammenhængende. SOTA har måske fået en udfordrer.”

“GLM-5.1 ligger stort set side om side med Opus på dette benchmark. Det er nu den bedste open model i Arenaen.”

“Hver gang jeg ser en NPC blive oprigtigt overbevist gennem uplanlagt dialog med GLM-5.1, er det ren magi.”

“Kodningspræstationen er legitim. Den rettede en race condition i vores Go-backend, som GPT-4o vedblev med at hallucinere om.”

“At køre denne lokalt med Unsloth er en game changer for databeskyttelse i vores juridiske tech-stack.”

Videoer om GLM-5.1

Se vejledninger, anmeldelser og diskussioner om GLM-5.1

“GLM-5.1 fik 45,3 % i dette benchmark, hvilket er et markant hop for familien.”

“Det er en utrolig langsom model... de har sandsynligvis flere af deres GPU'er dedikeret til GLM-5.”

“Måden den håndterer tool-calls på er langt mere robust end den standard GLM 5.”

“Det er i øjeblikket den stærkeste reasoning-model, du kan downloade og køre på din egen hardware.”

“Du kan faktisk se den identificere sine egne fejl i tænkeloggen.”

“Den kan køre autonomt i 8 timer og forfine strategier gennem tusindvis af iterationer.”

“Den overgår Gemini 3.1 Pro og Qwen 3.6 Plus på populære repo-genererings-benchmarks.”

“Agentic mode er der, hvor denne model virkelig skinner; den giver ikke op over for svære fejl.”

“Z.ai har i bund og grund fjernet paywallen på en 744B parameter frontier-model.”

“Den håndterer effektivt 'plateau'-problemet, hvor andre LLM'er mister fokus over tid.”

“80 % størrelsesreduktion fra de originale 1,65 TB ned til 236 GB, mens kvaliteten bevares.”

“Open source-kraften: selv i en kvantiseret version skrev den fungerende kode til fyrværkeri.”

“Du skal bruge mindst 256 GB system-RAM bare for at overveje at indlæse denne MoE-gigant.”

“Den benytter en dynamisk sparse attention-mekanisme for at holde de 202k kontekst sammenhængende.”

“Brug af Unsloth gør trænings- og inference-processen væsentligt mere effektiv.”

Supercharg din arbejdsgang med AI-automatisering

Automatio kombinerer kraften fra AI-agenter, webautomatisering og smarte integrationer for at hjælpe dig med at udrette mere på kortere tid.

Pro-tips til GLM-5.1

Eksperttips til at hjælpe dig med at få mest muligt ud af GLM-5.1 og opnå bedre resultater.

Slå Thinking Mode til

Sørg for, at 'Thinking'-knappen er aktiveret i din konfiguration for at låse op for de 8-timers autonome itereringsmuligheder.

Brug Off-Peak kvoter

Kør store engineering-batches uden for spidsbelastningstiden mellem 14:00-18:00 Beijing-tid for at få bedre priser.

Lokale hukommelseskrav

Brug Unsloth Dynamic GGUF-kvantisering for at få plads til 1,6 TB-modellen i 256 GB systemhukommelse til lokale kørsler.

Strategisk opgavevalg

Reserver GLM-5.1 til arkitektonisk reasoning og brug GLM-4.7 til rutineprægede implementeringer for at styre omkostningerne.

Anmeldelser

Hvad vores brugere siger

Slut dig til tusindvis af tilfredse brugere, der har transformeret deres arbejdsgang

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Relateret AI Models

Qwen3.6-Max-Preview

alibaba

Qwen3.6-Max-Preview is Alibaba's flagship MoE model featuring 1M context, a native thinking mode, and SOTA scores in agentic coding and reasoning.

GLM-5

Zhipu (GLM)

GLM-5 is Zhipu AI's 744B parameter open-weight powerhouse, excelling in long-horizon agentic tasks, coding, and factual accuracy with a 200k context window.

GPT-5.2

OpenAI

GPT-5.2 is OpenAI's flagship model for professional tasks, featuring a 400K context window, elite coding, and deep multi-step reasoning capabilities.

Gemini 3.1 Flash-Lite

Gemini 3.1 Flash-Lite is Google's fastest, most cost-efficient model. Features 1M context, native multimodality, and 363 tokens/sec speed for scale.

Claude Opus 4.5

Anthropic

Claude Opus 4.5 is Anthropic's most powerful frontier model, delivering record-breaking 80.9% SWE-bench performance and advanced autonomous agency for coding.

Grok-4

xAI

Grok-4 by xAI is a frontier model featuring a 2M token context window, real-time X platform integration, and world-record reasoning capabilities.

Kimi K2.5

Moonshot

Discover Moonshot AI's Kimi K2.5, a 1T-parameter open-source agentic model featuring native multimodal capabilities, a 262K context window, and SOTA reasoning.

Kimi K2 Thinking

Moonshot

Kimi K2 Thinking is Moonshot AI's trillion-parameter reasoning model. It outperforms GPT-5 on HLE and supports 300 sequential tool calls autonomously for...

Ofte stillede spørgsmål om GLM-5.1

Find svar på almindelige spørgsmål om GLM-5.1