Claude Opus 4.5

Claude Opus 4.5 ist das leistungsstärkste frontier model von Anthropic mit einer rekordverdächtigen 80,9 % SWE-bench-Performance und fortschrittlicher...

Über Claude Opus 4.5

Erfahren Sie mehr über die Fähigkeiten, Funktionen und Einsatzmöglichkeiten von Claude Opus 4.5.

Claude Opus 4.5 ist das flagship Modell von Anthropic, das Ende 2025 veröffentlicht wurde. Es wurde speziell für komplexes Software Engineering und reasoning mit hohem Anspruch entwickelt. Das Modell erreichte rekordverdächtige 80,9 % beim SWE-bench Verified Benchmark und ist damit eine erstklassige Wahl für autonomes Debugging und System-Refactoring. Es führt eine kultivierte Persona ein, die diplomatische Ehrlichkeit und nuancierte Hilfsbereitschaft betont.

Multimodal und Agentic Optimierung

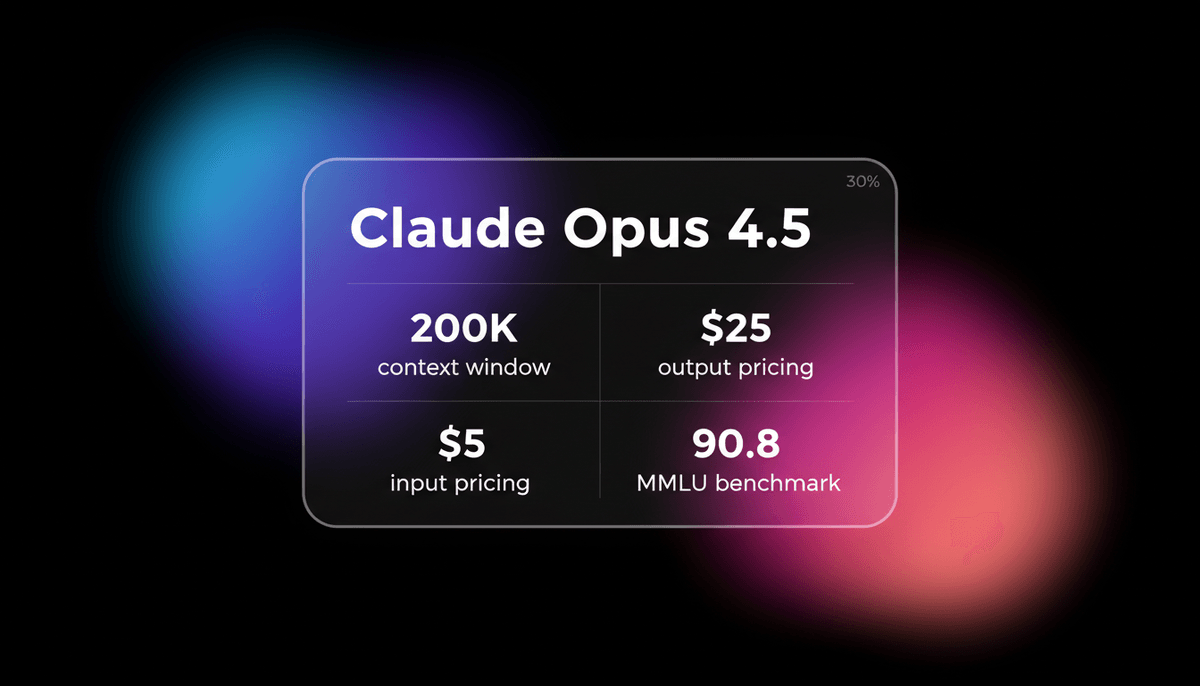

Die Architektur unterstützt ein 200.000 tokens context window und ein 64.000 tokens output-Limit. Entwickler können einen speziellen effort-parameter verwenden, um die reasoning-Tiefe im Verhältnis zu den Rechenkosten zu skalieren. Diese Flexibilität ermöglicht hochintensive Logikaufgaben oder schnellere, ökonomischere kreative Entwürfe. Das Modell ist multimodal und zeichnet sich durch die Interpretation architektonischer Diagramme und dichter UI-Layouts aus.

Engineering und Tool-Nutzung

Optimiert für agentic Workflows, navigiert es über Claude Code durch Terminalumgebungen, um systemweite Audits durchzuführen. Es senkt die Input- und Output-Preise im Vergleich zu früheren flagship Iterationen erheblich. Seine Fähigkeit, Kohärenz über langfristige Aufgaben hinweg zu wahren, macht es zu einem zuverlässigen Partner für professionelle Ingenieurteams und komplexe Datenanalysen.

Anwendungsfälle für Claude Opus 4.5

Entdecken Sie die verschiedenen Möglichkeiten, Claude Opus 4.5 für großartige Ergebnisse zu nutzen.

Autonomes Software Engineering

Automatisierung von End-to-End-Debugging und systemweitem Refactoring mit einem rekordverdächtigen SWE-bench-Ergebnis von 80,9 %.

Agentic Research Workflows

Synthetisierung riesiger Mengen technischer Daten in umsetzbare Geschäftsstrategien unter Nutzung des 200k context window.

High-Fidelity UI/UX Vision

Umwandlung komplexer Figma-Designs und architektonischer Diagramme in produktionsfertigen Frontend-Code mit pixelgenauer Präzision.

Multi-Agent Orchestrierung

Dient als zentrales Gehirn für Teams von Sub-Agents, um langfristige Projekte über verschiedene Codebases hinweg zu verwalten.

Erweiterte Datenanalyse

Automatisierung komplexer Finanzmodellierungen und Excel-Workflows mit hoher Präzision und reasoning-Tiefe.

Literarisches und kreatives Entwerfen

Erstellung nuancierter Texte, die spezifischen Schreibstilen und komplexen, menschzentrierten Designprinzipien entsprechen.

Stärken

Einschränkungen

API-Schnellstart

anthropic/claude-opus-4.5

import Anthropic from '@anthropic-ai/sdk';

const anthropic = new Anthropic({

apiKey: process.env.ANTHROPIC_API_KEY,

});

const msg = await anthropic.messages.create({

model: 'claude-opus-4-5-20251101',

max_tokens: 4096,

effort: 'high',

messages: [{ role: 'user', content: 'Analysieren Sie diese Systemarchitektur auf Race Conditions.' }],

});

console.log(msg.content[0].text);Installieren Sie das SDK und beginnen Sie in wenigen Minuten mit API-Aufrufen.

Was die Leute über Claude Opus 4.5 sagen

Sehen Sie, was die Community über Claude Opus 4.5 denkt

“Claude Opus 4.5 fühlt sich weniger wie ein zustandsloser Assistent und mehr wie ein beständiger Teamkollege an. Es kann Annahmen über mehrere Dateien hinweg nachverfolgen, was sich eindeutig stärker anfühlt.”

“Man sieht, wie Ihr AI agent eine Social-Media-Persona entwickelt, die bei echten Menschen auf eine Weise Anklang findet, die man nicht erklären kann. Infrastruktur ist wichtiger als prompts.”

“Opus ist das leistungsfähigste Modell in diesem Aspekt. Seine Diskussion ist am natürlichsten und es folgt einem wirklich in der Diskussion.”

“Opus 4.5 erfasst die kleinsten Nuancen. Es ist das einzige Modell, das erfolgreich einen Inline-Trailer-Mechanismus beim ersten Durchgang einfügt.”

“Der SWE-bench-Score von 80,9 % ist wahrscheinlich echt, aber auch etwas irreführend. Es erfordert eine klare Umgebungseinrichtung, um diese Zahlen konsistent zu erreichen.”

“SWE-bench Verified: 80,9 % (Opus 4.5) vs. 71,3 % (Claude 3-Opus). Dies ist ein massiver Sprung für die Zuverlässigkeit in der realen Welt.”

Videos über Claude Opus 4.5

Schauen Sie Tutorials, Rezensionen und Diskussionen über Claude Opus 4.5

“Opus 4.5 erfasst die kleinsten Nuancen”

“Es war das einzige Modell, das beim ersten Versuch erfolgreich einen Inline-Trailer-Mechanismus einfügte”

“Eine agent-gesteuerte Code-Bewertung bestätigt dieses subjektive Gefühl und bewertet Opus mit 7/10 für Feature-Vollständigkeit”

“Das reasoning ist bei der Handhabung von Edge Cases wesentlich logischer als bei früheren Versionen”

“Es behält die Konsistenz der Codebase über 30-minütige Sitzungen hinweg bei”

“Der Preis ist jetzt dreimal günstiger. Er liegt bei nur 5 $ für eine Million input tokens”

“Der Input kostet 5 $ und der Output 25 $ pro Million tokens”

“Opus 4.5 erzielte ein höheres Ergebnis als jeder menschliche Kandidat jemals bei der Take-Home-Prüfung von Anthropic”

“Dies ist das erste Modell, das die 80-Prozent-Hürde bei SWE-bench knackt”

“Es bewältigt autonome 30-minütige Coding-Sitzungen ohne menschliches Eingreifen”

“Stellen Sie sich Claude Opus 4.5 als eine Überzeugungsebene und ein absolutes agentic Monster vor”

“Es ist ein absolutes agentic und Coding-Monster”

“Ingenieure bevorzugen am Ende die Arbeit mit Claude Opus 4.5, weil sie diese engen Feedbackschleifen erhalten”

“Der reasoning effort-parameter ist das herausragende Feature für Entwickler”

“In Langzeitdiskussionen fühlt es sich mehr wie ein Mitarbeiter als wie ein Werkzeug an”

Optimieren Sie Ihren Workflow mit KI-Automatisierung

Automatio kombiniert die Kraft von KI-Agenten, Web-Automatisierung und intelligenten Integrationen, um Ihnen zu helfen, mehr in weniger Zeit zu erreichen.

Pro-Tipps für Claude Opus 4.5

Expertentipps, um das Beste aus Claude Opus 4.5 herauszuholen.

Reasoning-Aufwand umschalten

Verwenden Sie den effort-parameter: auf 'high' für komplexe Logik- oder Coding-Aufgaben und auf 'medium' für standardmäßiges kreatives Schreiben.

Vision-natives Design

Laden Sie hochauflösende Screenshots von UI-Bugs hoch, da das Modell darauf trainiert ist, visuelle Diskrepanzen zu erkennen, die in Textbeschreibungen übersehen werden.

Strukturierte System Prompts

Definieren Sie klare agentic Rollen und Aufwandsebenen in Ihren System Prompts, um zu verhindern, dass das Modell bei einfacheren prozeduralen Aufgaben zu stark ins Detail geht.

Kontext-Kompaktierung

Fassen Sie den Verlauf in lang laufenden Sitzungen zusammen, damit das 200k context window auf die relevantesten Informationen fokussiert bleibt.

Erfahrungsberichte

Was Unsere Nutzer Sagen

Schliessen Sie sich Tausenden zufriedener Nutzer an, die ihren Workflow transformiert haben

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Verwandte AI Models

Gemini 3.1 Flash-Lite

Gemini 3.1 Flash-Lite is Google's fastest, most cost-efficient model. Features 1M context, native multimodality, and 363 tokens/sec speed for scale.

Grok-4

xAI

Grok-4 by xAI is a frontier model featuring a 2M token context window, real-time X platform integration, and world-record reasoning capabilities.

Kimi K2.5

Moonshot

Discover Moonshot AI's Kimi K2.5, a 1T-parameter open-source agentic model featuring native multimodal capabilities, a 262K context window, and SOTA reasoning.

GLM-5.1

Zhipu (GLM)

GLM-5.1 is Zhipu AI's flagship reasoning model, featuring a 202K context window and an autonomous 8-hour execution loop for complex agentic engineering.

Qwen3.6-Max-Preview

alibaba

Qwen3.6-Max-Preview is Alibaba's flagship MoE model featuring 1M context, a native thinking mode, and SOTA scores in agentic coding and reasoning.

GLM-5

Zhipu (GLM)

GLM-5 is Zhipu AI's 744B parameter open-weight powerhouse, excelling in long-horizon agentic tasks, coding, and factual accuracy with a 200k context window.

GPT-5.1

OpenAI

GPT-5.1 is OpenAI’s advanced reasoning flagship featuring adaptive thinking, native multimodality, and state-of-the-art performance in math and technical...

GPT-5.2

OpenAI

GPT-5.2 is OpenAI's flagship model for professional tasks, featuring a 400K context window, elite coding, and deep multi-step reasoning capabilities.

Häufig gestellte Fragen zu Claude Opus 4.5

Finden Sie Antworten auf häufige Fragen zu Claude Opus 4.5