DeepSeek v4

DeepSeek v4 ist ein 1.6T parameter MoE model mit 1M token context window und nativer multimodaler Unterstützung für Text, Vision und Video zu disruptiven...

Über DeepSeek v4

Erfahren Sie mehr über die Fähigkeiten, Funktionen und Einsatzmöglichkeiten von DeepSeek v4.

Hocheffiziente Architektur im Billionen-Maßstab

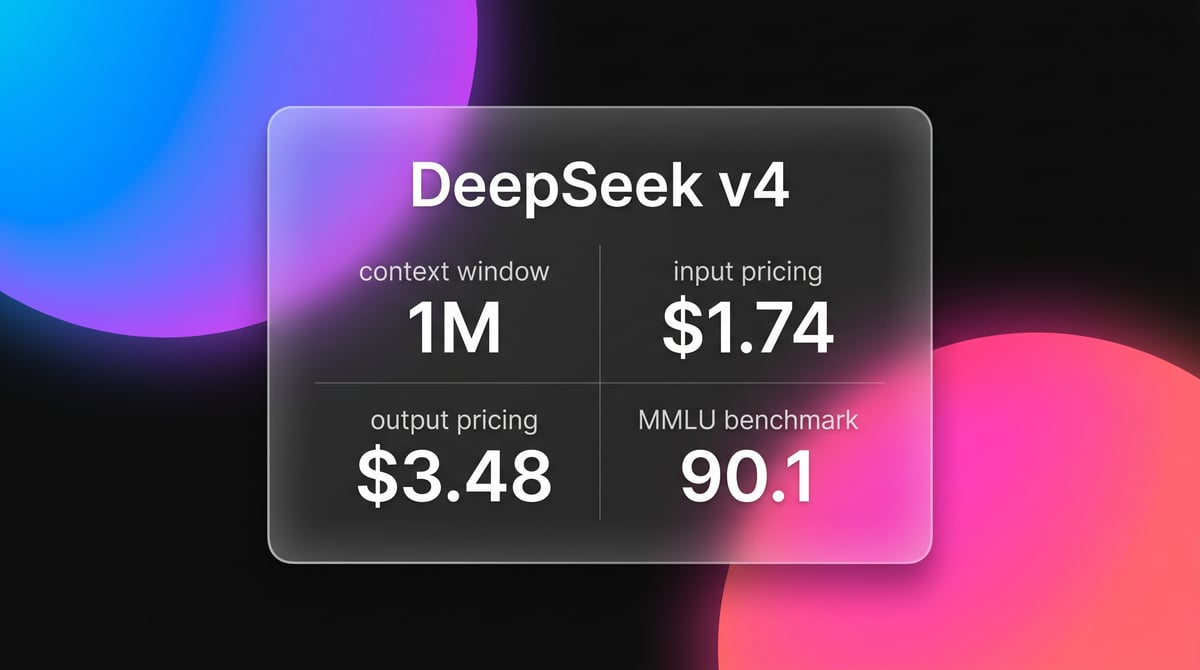

DeepSeek v4 stellt eine Evolution im Mixture-of-Experts (MoE)-Design dar und skaliert auf 1,6 Billionen Gesamtparameter bei 49 Milliarden aktiven Parametern. Das model integriert Compressed Sparse Attention (CSA) und Heavily Compressed Attention (HCA), um sein 1-Million-token context window zu verwalten. Diese Technologien reduzieren den KV cache-Speicherbedarf um 90 % im Vergleich zu Standardarchitekturen, was eine schnellere inference und geringere Hardwareanforderungen für long-context Aufgaben ermöglicht.

Native multimodale Integration

Im Gegensatz zu models, die separate Vision- oder Audio-Encoder verwenden, ist DeepSeek v4 von der ersten Trainingsphase an nativ multimodal. Es verarbeitet Text, Bilder, Audio und Video innerhalb eines einzigen vereinheitlichten Frameworks. Dieser Ansatz verbessert das cross-modale reasoning und ermöglicht es dem model, komplexe Analysen von Rohvideodateien und umfangreichen Dokumentenarchiven durchzuführen, ohne granulare Details zu verlieren.

Strategische Kostendisruption

Das model ist als performante open-source Alternative zu hochkarätigen proprietären models positioniert. Mit einer Preisgestaltung von $1,74 pro Million Input-tokens behält es die Leistungsfähigkeit von frontier models im Bereich Coding und Mathematik bei, während es die Betriebskosten für Entwickler erheblich senkt. Die Einbeziehung eines optionalen Thinking Mode ermöglicht deep reasoning für logische Beweise und wettbewerbsorientiertes Programmieren.

Anwendungsfälle für DeepSeek v4

Entdecken Sie die verschiedenen Möglichkeiten, DeepSeek v4 für großartige Ergebnisse zu nutzen.

Großflächiges Refactoring von Code-Repositories

Nutzung des 1M context window zum Einlesen ganzer Repositorys für die globale Fehlersuche und architektonische Verbesserungen.

Native Videoanalyse

Direkte Verarbeitung von Rohvideodateien zur Szenenerkennung, Transkripterstellung und komplexen visuellen reasoning-Aufgaben.

Autonome Software-Agents

Einsatz des models in agentic Workflows zur Lösung realer GitHub-Issues mit einer Erfolgsquote von 80,6 % auf dem SWE-bench.

Multimodale Content-Erstellung

Generierung von strukturierten Daten und kreativen Inhalten in Text-, Bild- und Audioformaten über ein einheitliches model.

Mathematische Beweise auf hohem Niveau

Lösung mathematischer Probleme auf Olympiade-Niveau und formale Beweise unter Verwendung des spezialisierten Thinking Mode für deep reasoning.

Unternehmensweite Wissensabfrage

Analyse massiver Dokumentenarchive in einem einzigen prompt, um Fakten ohne komplexe RAG-Pipelines zu extrahieren.

Stärken

Einschränkungen

API-Schnellstart

deepseek/deepseek-v4-pro

import OpenAI from 'openai'; const deepseek = new OpenAI({ baseURL: 'https://api.deepseek.com', apiKey: process.env.DEEPSEEK_API_KEY, }); const msg = await deepseek.chat.completions.create({ model: 'deepseek-v4-pro', messages: [{ role: 'user', content: 'Optimieren Sie diesen Rust-Kernel auf Speichereffizienz.' }], }); console.log(msg.choices[0].message.content);Installieren Sie das SDK und beginnen Sie in wenigen Minuten mit API-Aufrufen.

Was die Leute über DeepSeek v4 sagen

Sehen Sie, was die Community über DeepSeek v4 denkt

“Der reasoning-Modus von DeepSeek v4 hat einen Concurrency-Bug in meinem Rust-Code gefunden, den selbst Claude Opus übersehen hat. Wahnsinn.”

“Die Ära des kosteneffizienten 1M context ist endlich da. Wir können jetzt Full-Project-Refactors für Cent-Beträge durchführen.”

“Dass das model ein 1M token Code-Repository durcharbeiten kann, ohne den Faden zu verlieren, ist der echte Wendepunkt für 2026.”

“Anthropic und OpenAI haben jetzt ein ernsthaftes Preisproblem. DeepSeek hat frontier AI gerade zur Handelsware gemacht.”

“Es schlägt GPT-5.4 bei coding-benchmarks und ist dabei open-source. Das ist die größte Veröffentlichung des Jahres.”

“Die Speicherkomprimierung ist der echte Zaubertrick. 1T parameter auf Consumer-Hardware wird endlich Realität.”

Videos über DeepSeek v4

Schauen Sie Tutorials, Rezensionen und Diskussionen über DeepSeek v4

“Die Speichereffizienz ist hier die eigentliche Geschichte; die Reduzierung des KV cache um 90 % ändert alles”

“Ein 1T model mit dieser Geschwindigkeit zu betreiben, ist ein massiver architektonischer Gewinn”

“Die Kosten pro Million tokens machen es für kleine Startups unmöglich, dieses model zu ignorieren”

“Ich habe noch nie ein open-source model gesehen, das 1 Million tokens so sauber verarbeitet”

“Es fühlt sich an, als ob die Lücke zwischen open und closed models offiziell geschlossen ist”

“DeepSeek konkurriert nicht mehr nur über den Preis; sie sind führend beim long-context reasoning”

“Die native Videounterstützung ist im Vergleich zu Gemini 2.0 überraschend robust”

“Die lokale Installation ist überraschend einfach, wenn man SGLang verwendet”

“Benchmarks bei HumanEval zeigen, dass es im Wesentlichen mit GPT-5 gleichzieht”

“Das context window macht RAG-Pipelines für mittelgroße Projekte nahezu überflüssig”

“Die Leistung bei coding-benchmarks ist derzeit von keinem anderen open-weight model erreicht”

“Es erreicht oder übertrifft erstklassige closed models bei der Umgestaltung massiver Code-Repositories”

“Die engram memory-Implementierung ist ein technisches Meisterwerk in diesem Bereich”

“Wir sehen 90 % Logik-Genauigkeit im Thinking Mode für Mathematik auf Olympiade-Niveau”

“Diese Veröffentlichung demokratisiert effektiv Intelligenz im Bereich von Billionen-parametern”

Optimieren Sie Ihren Workflow mit KI-Automatisierung

Automatio kombiniert die Kraft von KI-Agenten, Web-Automatisierung und intelligenten Integrationen, um Ihnen zu helfen, mehr in weniger Zeit zu erreichen.

Pro-Tipps für DeepSeek v4

Expertentipps, um das Beste aus DeepSeek v4 herauszuholen.

Thinking Modes umschalten

Verwenden Sie den Standardmodus für schnellen Chat und reservieren Sie den Thinking Mode speziell für coding und logische Beweise.

Context Caching nutzen

Nutzen Sie integrierte context caching-Funktionen, um Kosten bei der Verwendung repetitiver long-context prompts um bis zu 90 % zu senken.

Direkter multimodaler Input

Speisen Sie Audio- und Videodateien direkt in die API ein, um von der nativen Architektur zu profitieren, anstatt sie vorab zu transkribieren.

System Prompt-Optimierung

Geben Sie klare JSON-Schemas oder Anweisungen zur tool-use im system prompt an, um ein hochzuverlässiges agentic Verhalten zu erreichen.

Erfahrungsberichte

Was Unsere Nutzer Sagen

Schliessen Sie sich Tausenden zufriedener Nutzer an, die ihren Workflow transformiert haben

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Verwandte AI Models

Claude Sonnet 4.6

Anthropic

Claude Sonnet 4.6 offers frontier performance for coding and computer use with a massive 1M token context window for only $3/1M tokens.

Gemini 3 Flash

Gemini 3 Flash is Google's high-speed multimodal model featuring a 1M token context window, elite 90.4% GPQA reasoning, and autonomous browser automation tools.

Kimi k2.6

Moonshot

Kimi k2.6 is Moonshot AI's 1T-parameter MoE model featuring a 256K context window, native video input, and elite performance in autonomous agentic coding.

Claude Opus 4.6

Anthropic

Claude Opus 4.6 is Anthropic's flagship model featuring a 1M token context window, Adaptive Thinking, and world-class coding and reasoning performance.

Qwen3.5-397B-A17B

alibaba

Qwen3.5-397B-A17B is Alibaba's flagship open-weight MoE model. It features native multimodal reasoning, a 1M context window, and a 19x decoding throughput...

Gemini 3 Pro

Google's Gemini 3 Pro is a multimodal powerhouse featuring a 1M token context window, native video processing, and industry-leading reasoning performance.

GPT-5.1

OpenAI

GPT-5.1 is OpenAI’s advanced reasoning flagship featuring adaptive thinking, native multimodality, and state-of-the-art performance in math and technical...

Qwen 3.7 Max

alibaba

Qwen 3.7 Max is Alibaba’s flagship AI model for deep reasoning and autonomous agent tasks, featuring a 256k context window and top-tier coding performance.

Häufig gestellte Fragen zu DeepSeek v4

Finden Sie Antworten auf häufige Fragen zu DeepSeek v4