GPT-5.2 Pro

GPT-5.2 Pro ist das 2025er Flaggschiff-Reasoning-Modell von OpenAI mit Extended Thinking für SOTA-Leistung in Mathematik, Programmierung und Expertenwissen.

Über GPT-5.2 Pro

Erfahren Sie mehr über die Fähigkeiten, Funktionen und Einsatzmöglichkeiten von GPT-5.2 Pro.

Ein neuer Standard für logische Intelligenz

GPT-5.2 Pro repräsentiert die rechenintensive Stufe der auf Reasoning ausgerichteten Modelle von OpenAI. Es wurde speziell für Enterprise-Workflows entwickelt, die wissenschaftliche Forschung auf PhD-Niveau und komplexe logische Inferenz erfordern. Im Gegensatz zu Standard-Sprachmodellen nutzt es eine hochentwickelte inference-time Compute-Architektur, die es Benutzern ermöglicht, den Denkaufwand des Modells zu skalieren. Dies ermöglicht es dem System, Probleme intern zu dekomponieren, die eigene Logik zu verifizieren und statistische Priors zu überschreiben, die bei kleineren Modellen oft zu Fehlern führen.

Spezialisiert auf technische Präzision

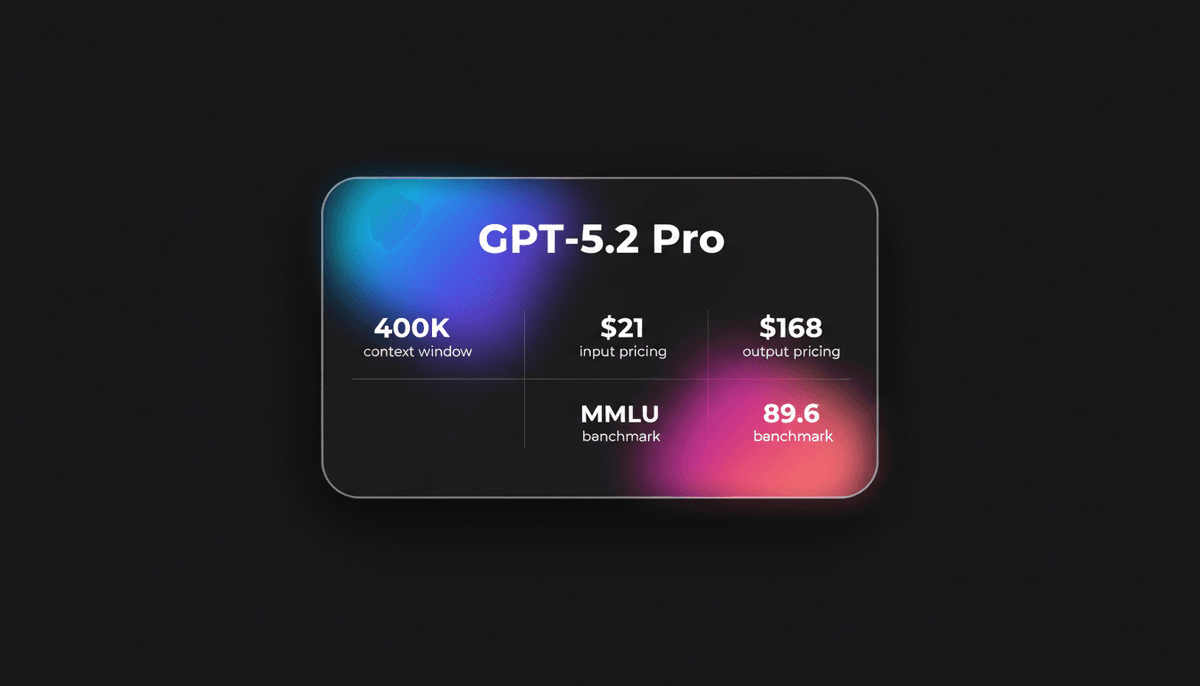

Während es die grundlegende Trainingsbasis mit der breiteren GPT-5-Familie teilt, zeichnet sich die Pro-Variante durch ihr massives context window von 400.000 tokens und deutlich niedrigere Halluzinationsraten aus. Es hat sich als zuverlässiger Partner in der theoretischen Physik und bei mathematischen Beweisen auf hohem Niveau bewährt. Seine Leistung bei kontaminationsresistenten benchmarks wie ARC-AGI-2 und GPQA Diamond etabliert es als primäre Prozess-Engine für autonome Agenten, die mehrstufige, technische Anweisungen ohne menschliches Eingreifen bewältigen müssen.

Enterprise-Leistung und Output

Das Modell zeichnet sich durch die strikte Einhaltung komplexer Anweisungen und einen professionellen Gesprächston aus. Es ist das erste Modell, das menschliche Industrieexperten mit über 14 Jahren Erfahrung bei spezialisierten Arbeits-benchmarks konsistent übertrifft. Mit einer Generierungskapazität von bis zu 128.000 tokens markiert es eine signifikante Abkehr von der „Faulheit“, die bei früheren Generationen beobachtet wurde, und ermöglicht die Erstellung ganzer Code-Module oder umfassender Forschungsberichte in einem einzigen Durchgang.

Anwendungsfälle für GPT-5.2 Pro

Entdecken Sie die verschiedenen Möglichkeiten, GPT-5.2 Pro für großartige Ergebnisse zu nutzen.

Autonome Softwareentwicklung

Lösung komplexer, dateiübergreifender GitHub-Issues und Durchführung von Modul-Refactorings mit einer Erfolgsquote von 84,5 % auf SWE-Bench Verified.

Mathematik-Olympiaden

Lösung von 100 % der AIME 2025-Wettbewerbsaufgaben und Beitrag origineller Beweise zu offenen Fragen der statistischen Lerntheorie.

Enterprise Agent Orchestration

Funktioniert als rechenintensive Prozess-Engine, die Dutzende von Tools für mehrstufige Finanzmodelle und Logistikprozesse steuern kann.

Wissenschaftliche Forschung auf PhD-Niveau

Analyse von Problemen aus Physik, Chemie und Biologie mit einem GPQA-Wert von 93,2 %, was viele menschliche Fachexperten übertrifft.

Long-Context Dokumentensynthese

Verarbeitung von bis zu 400.000 tokens an Archivdaten zur Erstellung umfassender Rechtsgutachten oder technischer Handbücher.

Interaktive 3D-Simulation

Generierung von tausenden Zeilen 3D-Simulationen in Three.js oder C++, einschließlich komplexer Partikelphysik und mechanischer Logik.

Stärken

Einschränkungen

API-Schnellstart

openai/gpt-5.2-pro

import OpenAI from 'openai';

const openai = new OpenAI();

async function main() {

const completion = await openai.chat.completions.create({

model: 'gpt-5.2-pro',

messages: [{ role: 'user', content: 'Design a leveraged buyout model for a take-private project.' }],

reasoning_effort: 'xhigh',

stream: true,

});

for await (const chunk of completion) {

process.stdout.write(chunk.choices[0]?.delta?.content || '');

}

}

main();Installieren Sie das SDK und beginnen Sie in wenigen Minuten mit API-Aufrufen.

Was die Leute über GPT-5.2 Pro sagen

Sehen Sie, was die Community über GPT-5.2 Pro denkt

“Das Reasoning war vorhanden; die Schlussfolgerung ergab sich einfach nicht daraus. Wenn dich das nicht zum Nachdenken bringt, sollte es das.”

“GPT-5.2 Pro hat ein neues Ergebnis in der theoretischen Physik abgeleitet, das der Expertenprüfung standhielt – etwas, das 5.1 nicht konnte.”

“GPT-5.2 Pro beginnt wie ein Junior-Entwickler auszusehen, der einen substanziellen Teil des Issue-Trackers übernehmen kann.”

“OpenAI gibt zu, dass dem Pro-Modell das Memory fehlt. Für mich als Akademiker ist das verheerend.”

“Die Logik ist makellos, aber die Latenz lässt es sich anfühlen, als würde ich mit einem sehr langsamen Genie zusammenarbeiten.”

“Endlich ein Modell, das sich nicht durch eine einfache Tensor-Kontraktion halluziniert.”

Videos über GPT-5.2 Pro

Schauen Sie Tutorials, Rezensionen und Diskussionen über GPT-5.2 Pro

“Gerüchte über Mensa Norwegen IQ-Werte zwischen 145 und 147”

“Erzeugte über 24.000 Zeilen Code”

“Integration einer wählbaren Denkzeit-Option”

“Die Pro-Tarif-Preise sind strikt für Enterprise-Budgets”

“Dieses Modell hat mein gesamtes Entwickler-Backlog an einem Nachmittag gelöst”

“30 % Reduzierung der Halluzinationen”

“Das Layout ist insgesamt erstaunlich gut im Vergleich zu dem, wo wir mit 5.1 standen”

“Genau 300 Wörter. Das ist das erste Mal, dass ich eine Wortbegrenzung vorgegeben habe und sie exakt getroffen wurde”

“Die Vision-Fähigkeiten bei Architekturplänen sind unübertroffen”

“Es fühlt sich deutlich kälter und roboterhafter an als 5.1”

“GPT5 Pro hat für 25 Minuten und 36 Sekunden nachgedacht”

“Zuweisung der doppelten inference-Rechenleistung”

“Ein kompliziertes Problem in eine andere Art von Mechanik aus einem Bereich namens komplexe Analysis übersetzt”

“Es ist effektiv ein PhD in der Box für 200 $ im Monat”

“Der Denkprozess zeigt, dass es seine eigenen Schritte tatsächlich verifiziert”

Optimieren Sie Ihren Workflow mit KI-Automatisierung

Automatio kombiniert die Kraft von KI-Agenten, Web-Automatisierung und intelligenten Integrationen, um Ihnen zu helfen, mehr in weniger Zeit zu erreichen.

Pro-Tipps für GPT-5.2 Pro

Expertentipps, um das Beste aus GPT-5.2 Pro herauszuholen.

Reasoning-Aufwand skalieren

Verwenden Sie den reasoning_effort API-parameter und setzen Sie ihn auf xhigh für Aufgaben, bei denen logische Konsistenz wichtiger ist als die Generierungsgeschwindigkeit.

Statistische Priors adressieren

Wenn das Modell in bekannte Fallen des gesunden Menschenverstands tappt, geben Sie einen Kontext-Hinweis, um die aktive Reasoning-Ebene zu aktivieren und die grundlegende Trainingsbasis zu überschreiben.

Massive Output-Kapazität nutzen

Fordern Sie ganze Projektverzeichnisse oder vollständige Dokumentationsdateien in einem einzigen prompt an, um das 128K Output-Budget voll auszunutzen.

Tool-Integration einsetzen

Aktivieren Sie immer Function Calling für Vision-Aufgaben; die Leistung des multimodal Modells steigt, wenn es Tools zur Verifizierung visueller Daten verwenden kann.

Erfahrungsberichte

Was Unsere Nutzer Sagen

Schliessen Sie sich Tausenden zufriedener Nutzer an, die ihren Workflow transformiert haben

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Verwandte AI Models

GPT-5.5

OpenAI

GPT-5.5 is OpenAI's flagship frontier model with a 1M context window and five reasoning effort levels, optimized for autonomous agentic workflows and coding.

Grok-3

xAI

Grok-3 is xAI's flagship reasoning model, featuring deep logic deduction, a 128k context window, and real-time integration with X for live research and coding.

Gemini 3.1 Flash Live Preview

Gemini 3.1 Flash Live Preview is Google's ultra-low-latency, audio-to-audio model featuring a 131K context window, high-fidelity multimodal reasoning, and...

Claude Opus 4.7

Anthropic

Claude Opus 4.7 is Anthropic's flagship model with a 1-million-token context, adaptive reasoning, and 3.3x vision resolution for enterprise-scale agents.

Gemini 3.1 Pro

Gemini 3.1 Pro is Google's elite multimodal model featuring the DeepThink reasoning engine, a 1M+ context window, and industry-leading ARC-AGI logic scores.

Gemini 3 Pro

Google's Gemini 3 Pro is a multimodal powerhouse featuring a 1M token context window, native video processing, and industry-leading reasoning performance.

Claude Opus 4.6

Anthropic

Claude Opus 4.6 is Anthropic's flagship model featuring a 1M token context window, Adaptive Thinking, and world-class coding and reasoning performance.

Kimi k2.6

Moonshot

Kimi k2.6 is Moonshot AI's 1T-parameter MoE model featuring a 256K context window, native video input, and elite performance in autonomous agentic coding.

Häufig gestellte Fragen zu GPT-5.2 Pro

Finden Sie Antworten auf häufige Fragen zu GPT-5.2 Pro