GLM-5.1

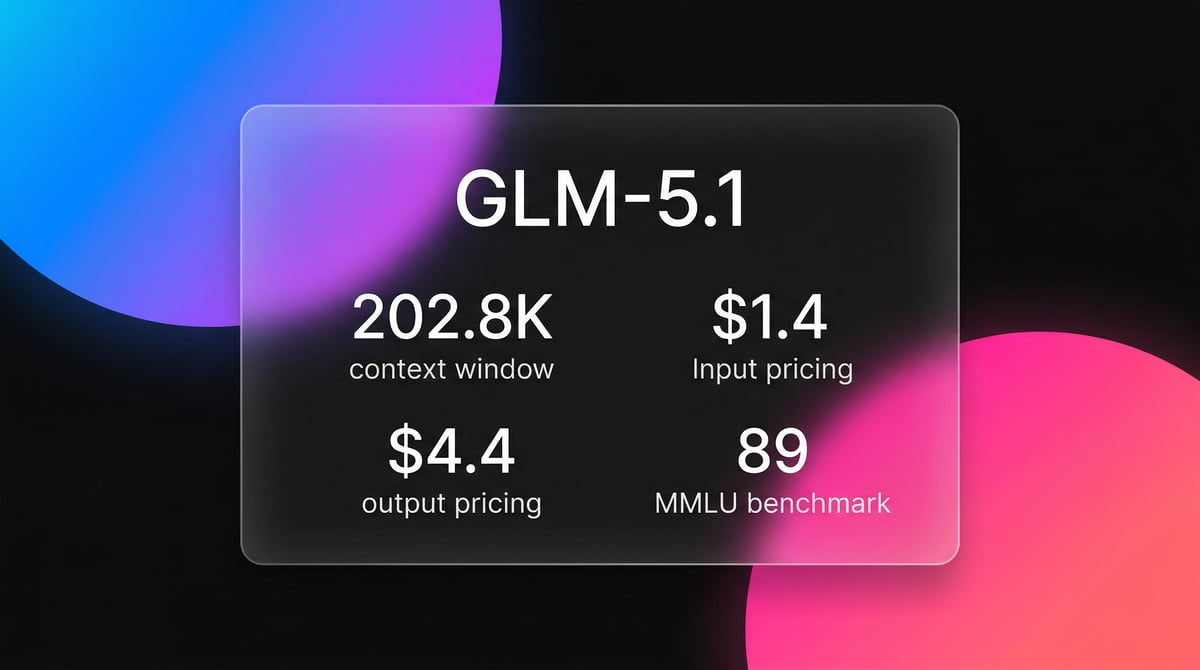

Το GLM-5.1 είναι το κορυφαίο μοντέλο reasoning της Zhipu AI, με context window 202K και αυτόνομο 8ωρο execution loop για σύνθετο agentic engineering.

Σχετικά με το GLM-5.1

Μάθετε για τις δυνατότητες, τα χαρακτηριστικά του GLM-5.1 και πώς μπορεί να σας βοηθήσει να επιτύχετε καλύτερα αποτελέσματα.

Το GLM-5.1 είναι το flagship foundation model της Zhipu AI, σχεδιασμένο για σύνθετο system engineering και long-horizon agentic tasks. Βασισμένο σε αρχιτεκτονική Mixture-of-Experts (MoE) με 744 δισεκατομμύρια παραμέτρους και 40 δισεκατομμύρια ενεργές ανά pass, αντιπροσωπεύει ένα σημαντικό άλμα στην αντοχή και την αυτόνομη επίλυση προβλημάτων. Το model είναι ειδικά σχεδιασμένο για να ξεπερνά τα reasoning plateaus που εμφανίζονται σε προηγούμενα μεγάλα γλωσσικά μοντέλα, διατηρώντας την παραγωγικότητα και την ποιότητα κώδικα σε χιλιάδες tool calls και εκατοντάδες επαναλήψεις. Εντοπίζει εμπόδια, εκτελεί πειράματα και προσαρμόζει τη δική του στρατηγική χωρίς ανθρώπινη παρέμβαση.

Τεχνικά, το GLM-5.1 διαπρέπει ως κύρια μηχανή reasoning σε multi-agent συστήματα. Χειρίζεται αρχιτεκτονικές αποφάσεις υψηλού επιπέδου ενώ αναθέτει την υλοποίηση σε μικρότερα μοντέλα. Διαθέτει context window 202K που υποστηρίζεται από έναν μηχανισμό dynamic sparse attention, διασφαλίζοντας τη συνοχή σε τεράστια codebases. Το μοντέλο κυκλοφορεί ως open weights υπό την άδεια MIT, παρέχοντας μια βιώσιμη τοπική εναλλακτική λύση στα proprietary frontier models για εργασίες όπως η βελτιστοποίηση βάσεων δεδομένων, το GPU kernel engineering και η ανάπτυξη full-stack web εφαρμογών.

Τα αποτελέσματα του KernelBench Level 3 δείχνουν ότι το GLM-5.1 διατηρεί σημαντική επιτάχυνση σε agentic ML workloads σε μεγάλες διαδρομές σε σύγκριση με το Claude Opus 4.6. Αυτή η αντοχή επιτρέπει στους προγραμματιστές να ξεκινούν μια engineering εργασία το πρωί και να λαμβάνουν μια πλήρως ελεγμένη και deploy-αρισμένη υπηρεσία μέχρι το τέλος της ημέρας. Διαχειρίζεται ολόκληρο τον κύκλο ζωής ενός bug fix, από την αναπαραγωγή του ζητήματος σε sandbox έως την υποβολή του τελικού pull request.

Περιπτώσεις χρήσης για GLM-5.1

Ανακαλύψτε τους διαφορετικούς τρόπους που μπορείτε να χρησιμοποιήσετε το GLM-5.1 για εξαιρετικά αποτελέσματα.

Αυτόνομο Software Engineering

Εκτελείται αυτόνομα για 8+ ώρες για τον σχεδιασμό, την υλοποίηση και τον εντοπισμό σφαλμάτων σε microservices χωρίς ανθρώπινη καθοδήγηση.

Βελτιστοποίηση βάσεων δεδομένων υψηλής απόδοσης

Το model βελτιστοποιεί επαναληπτικά υλοποιήσεις vector search βασισμένες σε Rust σε εκατοντάδες γύρους.

Βελτιστοποίηση GPU Kernel

Αναλύει υλοποιήσεις αναφοράς για την παραγωγή ταχύτερων GPU kernels που υπερέχουν των προεπιλεγμένων autotune compilers.

Multi-Agent Orchestration

Λειτουργεί ως ο πυρήνας reasoning που συντονίζει sub-tasks και tool-calls σε ένα σμήνος εξειδικευμένων μικρότερων models.

Σύνθετες εργασίες τερματικού (CLI)

Εκτελεί πραγματικές λειτουργίες τερματικού και διοικητικές εργασίες συστήματος πολλαπλών βημάτων μέσω agentic CLI tools.

Full-Stack Web Design

Το model δημιουργεί οπτικά συνεπή UI layouts και backend logic για περιβάλλοντα επιφάνειας εργασίας που βασίζονται σε browser.

Δυνατά σημεία

Περιορισμοί

Γρήγορη εκκίνηση API

zhipu/glm-5.1

import OpenAI from 'openai';

const client = new OpenAI({

apiKey: process.env.ZHIPU_API_KEY,

baseURL: 'https://api.z.ai/api/paas/v4'

});

const chat = await client.chat.completions.create({

model: 'glm-5.1',

messages: [{ role: 'user', content: 'Optimize this database schema.' }],

stream: true

});

for await (const chunk of chat) {

process.stdout.write(chunk.choices[0]?.delta?.content || '');

}Εγκαταστήστε το SDK και αρχίστε να κάνετε κλήσεις API σε λίγα λεπτά.

Τι λένε οι άνθρωποι για το GLM-5.1

Δείτε τι πιστεύει η κοινότητα για το GLM-5.1

“Το GLM-5.1 έκανε loop σε ένα prompt για 8 συνεχόμενες ώρες. Δεν σταμάτησε όπως τα περισσότερα models. Συνέχισε να προσθέτει λειτουργίες και να αυτο-αξιολογείται.”

“Το έχω δοκιμάσει σε 140k context τουλάχιστον 5 φορές και παρέμεινε συνεκτικό. Το SOTA ίσως έχει έναν αμφισβητία.”

“Το GLM-5.1 είναι σχεδόν ισάξιο με το Opus σε αυτό το benchmark. Είναι πλέον το #1 open model στο Arena.”

“Κάθε φορά που βλέπω ένα NPC να πείθεται ειλικρινά μέσα από διάλογο χωρίς σενάριο με το GLM-5.1, είναι καθαρή μαγεία.”

“Η απόδοση στο coding είναι νόμιμη. Διόρθωσε ένα race condition στο Go backend μας για το οποίο το GPT-4o έκανε συνεχώς hallucinations.”

“Η τοπική εκτέλεση με το Unsloth αλλάζει τα δεδομένα για το privacy των δεδομένων στο legal tech stack μας.”

Βίντεο για το GLM-5.1

Δείτε οδηγούς, κριτικές και συζητήσεις για το GLM-5.1

“Το GLM-5.1 πήρε 45,3% σε αυτό το benchmark, ένα σημαντικό άλμα για την οικογένεια.”

“Είναι ένα απίστευτα αργό model... πιθανώς έχουν περισσότερα GPU τους να εξυπηρετούν ακόμα το GLM-5.”

“Ο τρόπος που διαχειρίζεται τα tool calls είναι πολύ πιο ισχυρός από το τυπικό GLM 5.”

“Είναι επί του παρόντος το ισχυρότερο reasoning model που μπορείτε να κατεβάσετε και να τρέξετε στο δικό σας hardware.”

“Μπορείτε να δείτε ότι όντως εντοπίζει τα δικά του λάθη στο log σκέψης.”

“Μπορεί να τρέχει αυτόνομα για 8 ώρες, βελτιώνοντας στρατηγικές μέσα από χιλιάδες επαναλήψεις.”

“Ξεπερνά το Gemini 3.1 Pro και το Qwen 3.6 Plus στα δημοφιλή benchmarks παραγωγής repo.”

“Το agentic mode είναι εκεί όπου αυτό το model πραγματικά λάμπει, δεν τα παρατάει σε δύσκολα bugs.”

“Η Z.ai ουσιαστικά κατήργησε το paywall σε ένα frontier-level model 744B παραμέτρων.”

“Διαχειρίζεται αποτελεσματικά το πρόβλημα του 'plateau' όπου άλλα LLMs χάνουν τη συγκέντρωσή τους με τον χρόνο.”

“80% μείωση μεγέθους από το αρχικό 1,65 TB στα 236GB διατηρώντας την ποιότητα.”

“Η δύναμη του open-source: ακόμα και σε quantized έκδοση, έγραψε κώδικα για πυροτεχνήματα.”

“Θα χρειαστείτε τουλάχιστον 256GB RAM συστήματος για να σκεφτείτε καν τη φόρτωση αυτού του γίγαντα MoE.”

“Χρησιμοποιεί έναν μηχανισμό dynamic sparse attention για να διατηρεί το 202k context συνοχή.”

“Η χρήση του Unsloth καθιστά τη διαδικασία training και inference σημαντικά πιο αποδοτική.”

Ενισχύστε τη ροή εργασίας σας με Αυτοματισμό AI

Το Automatio συνδυάζει τη δύναμη των AI agents, του web automation και των έξυπνων ενσωματώσεων για να σας βοηθήσει να επιτύχετε περισσότερα σε λιγότερο χρόνο.

Επαγγελματικές συμβουλές για GLM-5.1

Εξειδικευμένες συμβουλές για να αξιοποιήσετε στο έπακρο το GLM-5.1 και να επιτύχετε καλύτερα αποτελέσματα.

Ενεργοποίηση του Thinking Mode

Βεβαιωθείτε ότι ο διακόπτης 'Thinking' είναι ενεργοποιημένος στις ρυθμίσεις σας για να ξεκλειδώσετε τις δυνατότητες αυτόνομης επανάληψης 8 ωρών.

Χρήση εκτός αιχμής

Εκτελέστε μεγάλα engineering batches κατά τις ώρες εκτός αιχμής, εκτός του διαστήματος 14:00-18:00 (ώρα Πεκίνου) για καλύτερη τιμολόγηση.

Απαιτήσεις τοπικής μνήμης

Χρησιμοποιήστε το Unsloth Dynamic GGUF quantization για να χωρέσετε το model 1,6TB σε 256GB μνήμης συστήματος για τοπική εκτέλεση.

Στρατηγική επιλογή εργασιών

Κρατήστε το GLM-5.1 για αρχιτεκτονικό reasoning και χρησιμοποιήστε το GLM-4.7 για εργασίες ρουτίνας ώστε να διαχειριστείτε το κόστος.

Μαρτυρίες

Τι λένε οι χρήστες μας

Ενταχθείτε στις χιλιάδες ικανοποιημένων χρηστών που έχουν μεταμορφώσει τη ροή εργασίας τους

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Σχετικά AI Models

Qwen3.6-Max-Preview

alibaba

Qwen3.6-Max-Preview is Alibaba's flagship MoE model featuring 1M context, a native thinking mode, and SOTA scores in agentic coding and reasoning.

GLM-5

Zhipu (GLM)

GLM-5 is Zhipu AI's 744B parameter open-weight powerhouse, excelling in long-horizon agentic tasks, coding, and factual accuracy with a 200k context window.

GPT-5.2

OpenAI

GPT-5.2 is OpenAI's flagship model for professional tasks, featuring a 400K context window, elite coding, and deep multi-step reasoning capabilities.

Gemini 3.1 Flash-Lite

Gemini 3.1 Flash-Lite is Google's fastest, most cost-efficient model. Features 1M context, native multimodality, and 363 tokens/sec speed for scale.

Claude Opus 4.5

Anthropic

Claude Opus 4.5 is Anthropic's most powerful frontier model, delivering record-breaking 80.9% SWE-bench performance and advanced autonomous agency for coding.

Grok-4

xAI

Grok-4 by xAI is a frontier model featuring a 2M token context window, real-time X platform integration, and world-record reasoning capabilities.

Kimi K2.5

Moonshot

Discover Moonshot AI's Kimi K2.5, a 1T-parameter open-source agentic model featuring native multimodal capabilities, a 262K context window, and SOTA reasoning.

Kimi K2 Thinking

Moonshot

Kimi K2 Thinking is Moonshot AI's trillion-parameter reasoning model. It outperforms GPT-5 on HLE and supports 300 sequential tool calls autonomously for...

Συχνές ερωτήσεις για GLM-5.1

Βρείτε απαντήσεις σε συνηθισμένες ερωτήσεις σχετικά με το GLM-5.1