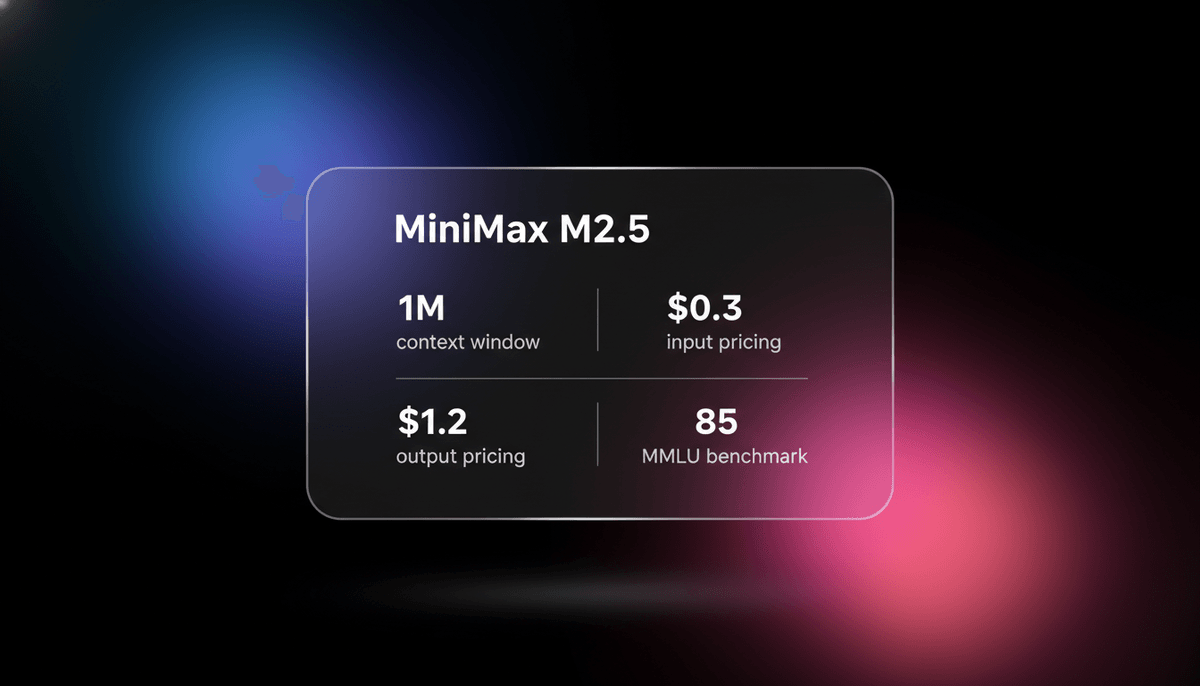

MiniMax M2.5

MiniMax M2.5 es un model MoE state-of-the-art con un context window de 1M y capacidades avanzadas de programación agentic a precios disruptivos para agentes...

Acerca de MiniMax M2.5

Conoce las capacidades, características y formas de uso de MiniMax M2.5.

Arquitectura de frontera eficiente

MiniMax M2.5 es un frontier model de alta eficiencia construido sobre una arquitectura Mixture-of-Experts (MoE) de 230B. Al activar solo 10 mil millones de parameters por pasada, alcanza velocidades de inference y estructuras de precios casi 20 veces más eficientes que los gigantes propietarios. Está diseñado específicamente para la inteligencia agentic, priorizando la lógica estructurada y la planificación de múltiples pasos sobre las simples conversaciones. Este diseño sparse permite al model mantener una alta inteligencia sin la enorme sobrecarga de cómputo de los modelos densos tradicionales.

Inteligencia avanzada en programación

La característica destacada del model es su Architect Mindset, que le permite visualizar estructuras lógicas y jerarquías de proyectos antes de generar código. Esto lo hace particularmente efectivo para la ingeniería de software autónoma, donde iguala el state-of-the-art con una puntuación del 80.2% en SWE-Bench Verified. Con un context window de 1 millón de tokens, puede ingerir repositorios completos, permitiendo auditorías profundas y refactorizaciones complejas que antes eran prohibitivas por su costo.

Despliegue empresarial y local

MiniMax M2.5 admite más de 10 lenguajes de programación y un throughput nativo de hasta 100 tokens por segundo en su variante lightning. Debido a que está disponible como un model de open-weights, los desarrolladores pueden desplegarlo localmente para una privacidad total de los datos, manteniendo el acceso al mismo reasoning lógico que se encuentra en la API alojada. Esta versatilidad lo convierte en una opción práctica tanto para pipelines de agentes en la nube como para herramientas de desarrollo on-premise.

Casos de uso de MiniMax M2.5

Descubre las diferentes formas de usar MiniMax M2.5 para lograr excelentes resultados.

Ingeniería de software autónoma

Resolución de problemas de GitHub reales y depuración multiarchivo utilizando agentes.

Pipelines de agentes empresariales

Potenciación de agentes en segundo plano 24/7 para investigación y síntesis de datos a bajo costo de API.

Modernización de código legacy

Refactorización de repositorios masivos obsoletos hacia frameworks modernos manteniendo estándares lógicos.

Revisiones de arquitectura de código

Análisis de jerarquías de proyectos para proporcionar retroalimentación lógica y sugerencias de optimización estructural.

Edición de documentos de alto volumen

Procesamiento de archivos de oficina extensos con alta fidelidad para modelos financieros y legales.

Herramientas de desarrollo de baja latencia

Impulso de extensiones de IDE y herramientas de CLI que requieren tiempos de respuesta inferiores a un segundo.

Fortalezas

Limitaciones

Inicio rápido de API

minimax/minimax-m2.5

import OpenAI from 'openai';

const client = new OpenAI({

apiKey: process.env.MINIMAX_API_KEY,

baseURL: 'https://api.minimax.io/v1',

});

async function main() {

const response = await client.chat.completions.create({

model: 'minimax-m2.5',

messages: [{ role: 'user', content: 'Design a microservices architecture for a fintech app.' }],

temperature: 0.1,

});

console.log(response.choices[0].message.content);

}

main();Instala el SDK y comienza a hacer llamadas API en minutos.

Lo que la gente dice sobre MiniMax M2.5

Mira lo que la comunidad piensa sobre MiniMax M2.5

“El precio de MiniMax M2.5 es la verdadera noticia, lo suficientemente barato como para cambiar la arquitectura, no solo los presupuestos.”

“M2.5 está alcanzando números de state-of-the-art y es un model de 10B de parameters activos, lo que significa que es rápido y barato.”

“El model reduce el trabajo pesado que los usuarios tenían que hacer solo para mantener las cosas en movimiento.”

“M2.5 está igualando el throughput de Claude Opus 4.6 a una fracción del costo.”

“Ejecutar M2.5 localmente en un Mac Studio es rápido. Los 10B de parameters activos realmente marcan la diferencia.”

“El paso de planificación arquitectónica detecta errores de lógica antes incluso de escribir una sola línea de código.”

Videos sobre MiniMax M2.5

Mira tutoriales, reseñas y discusiones sobre MiniMax M2.5

“Es casi 20 veces más barato que las principales opciones propietarias.”

“Este es un model de programación y agentic de primer nivel que es mucho más rápido y drásticamente más barato.”

“El rendimiento en SWE-bench verified realmente lo sitúa en la categoría de élite.”

“Obtienes inteligencia de nivel frontier con requisitos de hardware de open-source.”

“La arquitectura MoE aquí está ajustada perfectamente para tareas de programación de baja latencia.”

“MiniMax está ofreciendo el model al 3% del costo de Opus 4.6 en tokens de salida.”

“El costo de la inteligencia se acerca al costo de la electricidad en este punto.”

“Maneja context windows de repositorios grandes sin el típico olvido a mitad del documento.”

“Para herramientas de desarrollo, la velocidad de la variante lightning es una gran victoria de UX.”

“Es la primera vez que veo un model tan barato capaz de resolver errores lógicos complejos.”

“Cuesta solo $1 ejecutar el model continuamente durante una hora a 100 tokens por segundo.”

“El proceso de reasoning interno realmente brilla aquí porque puede corregir su curso inmediatamente.”

“Probándolo contra GPT-4o, consistentemente proporciona mejores refactorizaciones multiarchivo.”

“Las capacidades agentic están integradas, no son solo una ocurrencia tardía en el prompt.”

“Es esencialmente gratis para pequeños desarrolladores dados los niveles de precios de entrada.”

Potencia tu flujo de trabajo con Automatizacion IA

Automatio combina el poder de agentes de IA, automatizacion web e integraciones inteligentes para ayudarte a lograr mas en menos tiempo.

Consejos Pro para MiniMax M2.5

Consejos de expertos para ayudarte a sacar el máximo provecho de MiniMax M2.5.

Adopta la mentalidad de arquitecto

Pide al model que genere una estructura de proyecto antes de solicitar el código de implementación real.

Utiliza el context window de 1M

Proporciona documentación completa o módulos enteros para asegurar una conciencia global de tu codebase.

Usa el plan HighSpeed

Selecciona el endpoint M2.5-HighSpeed para alcanzar 100 tokens por segundo constantes para agentes interactivos.

Refinamiento iterativo

Pide al model que revise su output inicial en busca de lagunas lógicas o vulnerabilidades de seguridad.

Testimonios

Lo Que Dicen Nuestros Usuarios

Unete a miles de usuarios satisfechos que han transformado su flujo de trabajo

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Relacionados AI Models

DeepSeek-V3.2-Speciale

DeepSeek

DeepSeek-V3.2-Speciale is a reasoning-first LLM featuring gold-medal math performance, DeepSeek Sparse Attention, and a 131K context window. Rivaling GPT-5...

MiMo V2.5 Pro

Other

MiMo V2.5 Pro is Xiaomi's open-source 1.02T parameter MoE model featuring a 1M context window, native multimodality, and elite agentic coding performance.

Claude 3.7 Sonnet

Anthropic

Claude 3.7 Sonnet is Anthropic's first hybrid reasoning model, delivering state-of-the-art coding capabilities, a 200k context window, and visible thinking.

Gemini 3.5 Flash

Gemini 3.5 Flash is Google's high-speed multimodal model with a 1M context window, optimized for sub-second agentic loops and complex coding tasks.

Qwen 3.7 Max

alibaba

Qwen 3.7 Max is Alibaba’s flagship AI model for deep reasoning and autonomous agent tasks, featuring a 256k context window and top-tier coding performance.

Qwen3.5-Omni

alibaba

Qwen3.5-Omni is a natively omnimodal AI by Alibaba Cloud, offering seamless audio-visual reasoning, real-time voice chat, and 256k context for low-latency apps.

DeepSeek v4

DeepSeek

DeepSeek v4 is a 1.6T parameter MoE model featuring a 1M token context window and native multimodal support for text, vision, and video at disruptive prices.

GPT-5.5

OpenAI

GPT-5.5 is OpenAI's flagship frontier model with a 1M context window and five reasoning effort levels, optimized for autonomous agentic workflows and coding.

Preguntas Frecuentes Sobre MiniMax M2.5

Encuentra respuestas a preguntas comunes sobre MiniMax M2.5