Qwen3.5-397B-A17B

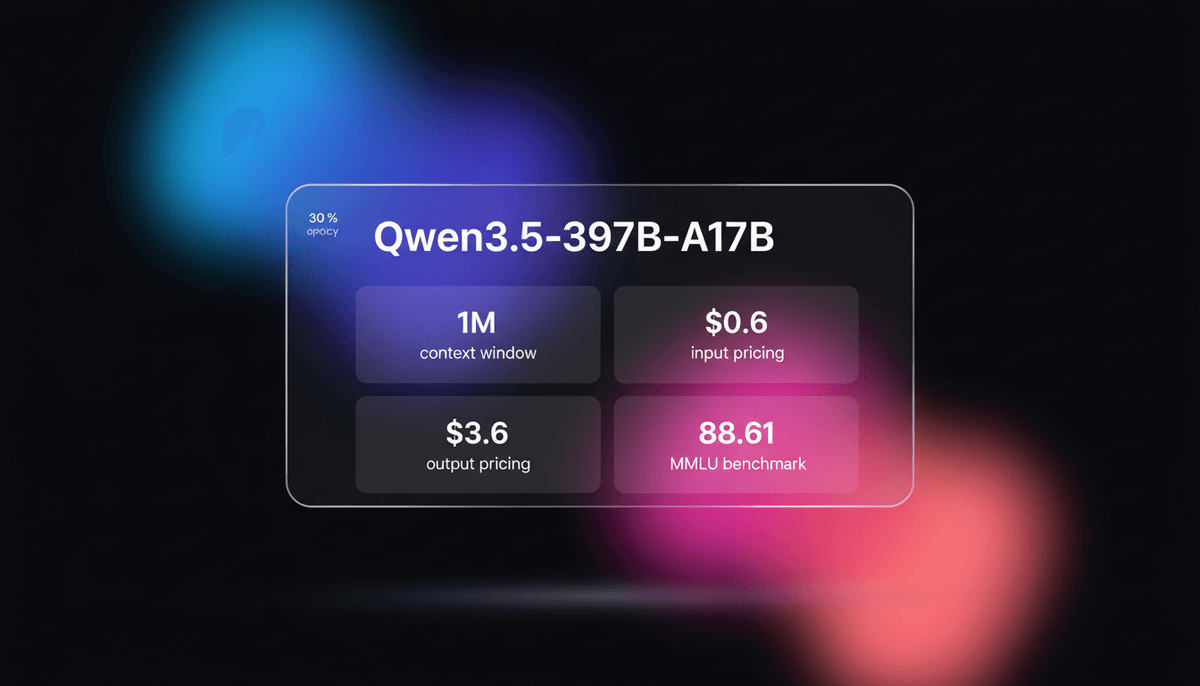

Qwen3.5-397B-A17B es el modelo MoE flagship de open-weights de Alibaba. Cuenta con razonamiento multimodal nativo, una context window de 1M y un throughput de...

Acerca de Qwen3.5-397B-A17B

Conoce las capacidades, características y formas de uso de Qwen3.5-397B-A17B.

Mixture of Experts de alta eficiencia

Qwen3.5-397B-A17B es un modelo multimodal nativo flagship que utiliza una arquitectura híbrida innovadora, fusionando la atención lineal a través de Gated Delta Networks con un Mixture-of-Experts (MoE) disperso. Aunque contiene un total de 397 mil millones de parámetros, su diseño disperso activa solo 17 mil millones de parámetros por pasada, logrando una eficiencia y velocidad de inferencia excepcionales sin comprometer sus vastas capacidades de razonamiento. Está optimizado tanto para tareas de lenguaje como visuales, admitiendo un vocabulario masivo de 250k tokens y proporcionando soporte para más de 201 idiomas y dialectos.

Flujos de trabajo de agentes multimodales nativos

El modelo destaca como un agente multimodal nativo, capaz de procesar hasta un millón de tokens de contexto, lo que equivale a aproximadamente dos horas de video. Introduce un Thinking Mode especializado para el razonamiento lógico complejo y está equipado de forma nativa para flujos de trabajo de agentes, incluyendo desarrollo web, navegación por GUI e inteligencia espacial del mundo real. Su arquitectura admite entrenamiento FP8 end-to-end y un framework de entrenamiento-inferencia desagregado, convirtiéndolo en uno de los modelos más escalables y eficientes para aplicaciones de IA de grado empresarial.

Open Weights para accesibilidad global

Publicado bajo la licencia Apache 2.0, este modelo proporciona a la comunidad open-source capacidades de nivel frontier anteriormente restringidas a sistemas propietarios. Cierra la brecha entre el conteo masivo de parámetros y la implementación práctica, permitiendo a las organizaciones ejecutar tareas de razonamiento de vanguardia en infraestructura privada con una sobrecarga de cómputo significativamente menor que las alternativas densas de 400B.

Casos de uso de Qwen3.5-397B-A17B

Descubre las diferentes formas de usar Qwen3.5-397B-A17B para lograr excelentes resultados.

Análisis de video de larga duración

Analiza hasta dos horas de contenido de video para extraer lógica, realizar ingeniería inversa de código a partir de grabaciones o generar resúmenes estructurados.

Investigación STEM de nivel doctorado

Resuelve problemas científicos de posgrado y problemas matemáticos de nivel de olimpiada utilizando su modo de pensamiento profundo adaptativo.

Agentes de GUI autónomos

Automatiza interacciones con teléfonos inteligentes y computadoras para gestionar flujos de trabajo de oficina y navegación móvil entre aplicaciones.

Ingeniería de software visual

Ejecuta 'vibe coding' transformando instrucciones en lenguaje natural y bocetos de UI en código frontend funcional.

Inteligencia documental

Procesa documentos complejos, gráficos y bocetos escritos a mano para extraer datos estructurados y realizar ingeniería inversa de diseños.

Aplicaciones de IA espacial

Comprende relaciones a nivel de píxel para tareas de IA encarnada, como el análisis de escenas de conducción autónoma y la navegación robótica.

Fortalezas

Limitaciones

Inicio rápido de API

alibaba/qwen3.5-plus

import OpenAI from 'openai';

const client = new OpenAI({

apiKey: process.env.DASHSCOPE_API_KEY,

baseURL: 'https://dashscope-intl.aliyuncs.com/compatible-mode/v1',

});

async function main() {

const completion = await client.chat.completions.create({

model: 'qwen3.5-plus',

messages: [{ role: 'user', content: 'Analiza la lógica de esta arquitectura MoE.' }],

extra_body: { enable_thinking: true },

});

console.log(completion.choices[0].message.content);

}

main();Instala el SDK y comienza a hacer llamadas API en minutos.

Lo que la gente dice sobre Qwen3.5-397B-A17B

Mira lo que la comunidad piensa sobre Qwen3.5-397B-A17B

“Qwen3.5-397B es esencialmente un modelo de clase GPT-5 pero con open-weights. La arquitectura DeltaNet está resolviendo perfectamente los problemas de latency de MoE.”

“El razonamiento multimodal nativo en Qwen3.5 parece increíble. 1M de context window + análisis de video va a cambiar los flujos de trabajo de los agentes.”

“La decisión de usar entrenamiento FP8 end-to-end manteniendo BF16 en capas sensibles es una clase magistral en optimizaciones de estabilidad.”

“Esta es la primera vez que veo un modelo abierto que realmente supera a Gemini 1.5 Pro en tareas de agentes multimodales complejos.”

“La mejora de 19x en throughput de decodificación sobre Qwen3-Max lo convierte en una alternativa viable para agentes a nivel de producción.”

“Me sorprendió lo bien que maneja la cuantización de 4-bit. Mantiene casi toda la capacidad de razonamiento en una configuración de doble A100.”

Videos sobre Qwen3.5-397B-A17B

Mira tutoriales, reseñas y discusiones sobre Qwen3.5-397B-A17B

“Un modelo de 397 mil millones de parámetros, pero con 17 mil millones activos.”

“Al decodificar a 256K, este modelo es 19 veces más rápido que Qwen 3 Max.”

“El reasoning nativo de visión-lenguaje es lo que lo diferencia para flujos de trabajo de agenteic.”

“Supera a la mayoría de los modelos cerrados en los benchmarks matemáticos estándar.”

“Ejecutarlo localmente es difícil, pero las versiones cuantizadas funcionan en Mac de gama alta.”

“Modelo de 397 mil millones de parámetros con 17 mil millones activos. Es nativamente multimodal.”

“Probablemente sea actualmente el mejor modelo multimodal de código abierto.”

“La capacidad de procesar dos horas de video de forma nativa es una ventaja masiva.”

“Mira estas puntuaciones de lógica, está alcanzando niveles consistentes con GPT-4o.”

“La licencia Apache lo hace muy atractivo para la privacidad de datos corporativos.”

“Extracción estructurada por OCR. Tienes un PDF desordenado... y necesitas convertirlo en un JSON limpio. Este modelo sobresale ahí.”

“Obtienes la inteligencia de un gigante de 400 mil millones de parámetros... pero pagas el costo de cómputo de un modelo de 17 mil millones.”

“Maneja la recuperación de contexto largo mejor que la versión anterior.”

“La integración de uso de herramientas está integrada en el entrenamiento base, no es un añadido.”

“El modo Thinking le permite corregir su propia lógica antes de dar la respuesta.”

Potencia tu flujo de trabajo con Automatizacion IA

Automatio combina el poder de agentes de IA, automatizacion web e integraciones inteligentes para ayudarte a lograr mas en menos tiempo.

Consejos Pro para Qwen3.5-397B-A17B

Consejos de expertos para ayudarte a sacar el máximo provecho de Qwen3.5-397B-A17B.

Activar el modo Thinking

Incluye el parámetro 'enable_thinking: true' en tu llamada a la API para activar el razonamiento profundo en matemáticas, programación y acertijos lógicos complejos.

Utilizar el modo Fast

Usa el modo 'Fast' para consultas sencillas y obtener respuestas instantáneas sin consumir tokens en fases de pensamiento interno innecesarias.

Optimizar prompts de video

Al analizar video, pide al modelo que se enfoque en el resultado dinámico final en lugar de hacer un análisis cuadro por cuadro para lograr una mejor coherencia temporal.

Aprovechar la cuantización

Utiliza cuantización de 4-bit o 8-bit (GGUF/EXL2) para ejecutar el modelo en hardware de grado consumidor si dispones de suficiente VRAM (200GB+).

Testimonios

Lo Que Dicen Nuestros Usuarios

Unete a miles de usuarios satisfechos que han transformado su flujo de trabajo

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Relacionados AI Models

GPT-5.1

OpenAI

GPT-5.1 is OpenAI’s advanced reasoning flagship featuring adaptive thinking, native multimodality, and state-of-the-art performance in math and technical...

Kimi K2.5

Moonshot

Discover Moonshot AI's Kimi K2.5, a 1T-parameter open-source agentic model featuring native multimodal capabilities, a 262K context window, and SOTA reasoning.

Grok-4

xAI

Grok-4 by xAI is a frontier model featuring a 2M token context window, real-time X platform integration, and world-record reasoning capabilities.

Claude Opus 4.5

Anthropic

Claude Opus 4.5 is Anthropic's most powerful frontier model, delivering record-breaking 80.9% SWE-bench performance and advanced autonomous agency for coding.

Gemini 3.1 Flash-Lite

Gemini 3.1 Flash-Lite is Google's fastest, most cost-efficient model. Features 1M context, native multimodality, and 363 tokens/sec speed for scale.

Claude Sonnet 4.6

Anthropic

Claude Sonnet 4.6 offers frontier performance for coding and computer use with a massive 1M token context window for only $3/1M tokens.

DeepSeek v4

DeepSeek

DeepSeek v4 is a 1.6T parameter MoE model featuring a 1M token context window and native multimodal support for text, vision, and video at disruptive prices.

Gemini 3 Flash

Gemini 3 Flash is Google's high-speed multimodal model featuring a 1M token context window, elite 90.4% GPQA reasoning, and autonomous browser automation tools.

Preguntas Frecuentes Sobre Qwen3.5-397B-A17B

Encuentra respuestas a preguntas comunes sobre Qwen3.5-397B-A17B