GLM-5.1

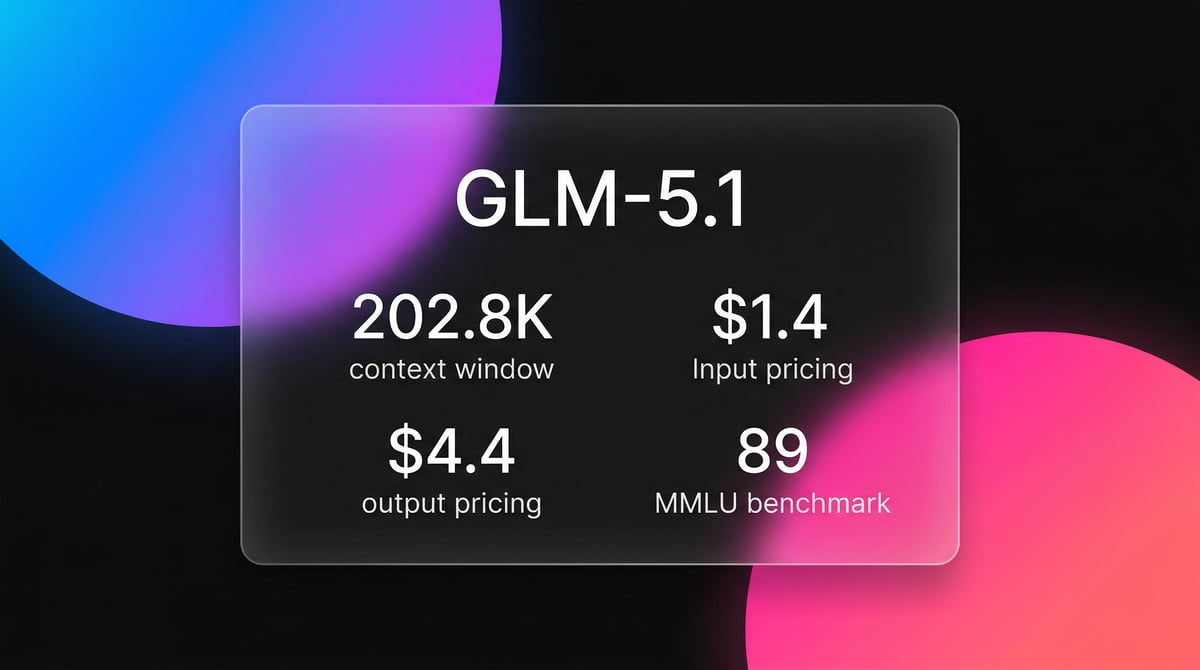

مدل GLM-5.1، مدل استدلال پرچمدار Zhipu AI با 202K context window و حلقه اجرای خودمختار 8 ساعته برای مهندسی agentic پیچیده است.

درباره GLM-5.1

درباره قابلیتهای GLM-5.1، ویژگیها و نحوه کمک به شما در دستیابی به نتایج بهتر بیاموزید.

GLM-5.1 مدل بنیادین پرچمدار Zhipu AI است که برای مهندسی سیستمهای پیچیده و وظایف agentic با افق طولانی طراحی شده است. این مدل با معماری Mixture-of-Experts (MoE) با 744 میلیارد parameters و 40 میلیارد فعال در هر پاس، نمایانگر جهشی قابل توجه در استقامت و حل مسئله خودمختار است. این مدل به طور ویژه برای غلبه بر افتهای استدلالی (reasoning plateaus) دیدهشده در مدلهای زبانی بزرگ قبلی مهندسی شده و بهرهوری و کیفیت کد را در هزاران tool-call و صدها تکرار حفظ میکند. این مدل بلاکرها را شناسایی کرده، آزمایشها را اجرا میکند و استراتژی خود را بدون دخالت انسان تنظیم میکند.

از نظر فنی، GLM-5.1 به عنوان یک هسته استدلالی اولیه در سیستمهای multi-agent میدرخشد. این مدل تصمیمات معماری سطح بالا را مدیریت کرده و پیادهسازی را به مدلهای کوچکتر محول میکند. همچنین دارای یک context window با ظرفیت 202K است که توسط مکانیزم dynamic sparse attention پشتیبانی میشود و انسجام را در میان کدهای عظیم تضمین میکند. این مدل به عنوان open weights تحت مجوز MIT منتشر شده و جایگزین محلی مناسبی برای مدلهای اختصاصی frontier برای وظایفی مانند بهینهسازی دیتابیس، مهندسی GPU kernel و توسعه اپلیکیشنهای وب full-stack است.

نتایج سطح 3 KernelBench نشان میدهد که GLM-5.1 سرعت قابل توجهی در پردازشهای agentic ML در دورهای طولانی نسبت به Claude Opus 4.6 حفظ میکند. این استقامت به توسعهدهندگان اجازه میدهد تا یک وظیفه مهندسی را صبح آغاز کرده و تا پایان روز یک سرویس کاملاً تست شده و مستقر دریافت کنند. این مدل کل چرخه عمر یک رفع باگ، از بازتولید مشکل در sandbox تا ثبت pull request نهایی را مدیریت میکند.

موارد استفاده برای GLM-5.1

روشهای مختلف استفاده از GLM-5.1 برای دستیابی به نتایج عالی را کشف کنید.

مهندسی نرمافزار خودمختار

این مدل بیش از 8 ساعت به طور مستقل اجرا میشود تا میکروسرویسها را بدون هدایت انسانی طراحی، پیادهسازی و دیباگ کند.

بهینهسازی دیتابیس با کارایی بالا

مدل به طور تکراری پیادهسازیهای vector search مبتنی بر Rust را در صدها مرحله بهینه میکند.

بهینهسازی GPU Kernel

مدل پیادهسازیهای مرجع را تحلیل میکند تا GPU kernelهای سریعتری تولید کند که از کامپایلرهای autotune پیشفرض پیشی میگیرند.

ارکستراسیون Multi-Agent

به عنوان یک هسته استدلال عمل میکند که وظایف فرعی و tool-callها را در میان مجموعهای از مدلهای کوچکتر تخصصی هماهنگ میکند.

وظایف پیچیده در ترمینال

عملیات واقعی ترمینال و مدیریت سیستم چندمرحلهای را از طریق ابزارهای agentic CLI اجرا میکند.

طراحی وب Full-Stack

مدل طرحبندیهای UI با انسجام بصری و منطق بکاند را برای محیطهای دسکتاپ تحت مرورگر تولید میکند.

نقاط قوت

محدودیتها

شروع سریع API

zhipu/glm-5.1

import OpenAI from 'openai';

const client = new OpenAI({

apiKey: process.env.ZHIPU_API_KEY,

baseURL: 'https://api.z.ai/api/paas/v4'

});

const chat = await client.chat.completions.create({

model: 'glm-5.1',

messages: [{ role: 'user', content: 'Optimize this database schema.' }],

stream: true

});

for await (const chunk of chat) {

process.stdout.write(chunk.choices[0]?.delta?.content || '');

}SDK را نصب کنید و در عرض چند دقیقه شروع به فراخوانی API کنید.

مردم درباره GLM-5.1 چه میگویند

ببینید جامعه درباره GLM-5.1 چه فکر میکند

“مدل GLM-5.1 روی یک prompt به مدت 8 ساعت مداوم حلقه زد. مثل اکثر مدلها متوقف نشد؛ بلکه به اضافه کردن ویژگیها و بررسی خود ادامه داد.”

“من آن را حداقل 5 بار تا 140k context تست کردم و همچنان منسجم باقی ماند. SOTA ممکن است یک رقیب پیدا کرده باشد.”

“مدل GLM-5.1 در این benchmark عملاً شانهبهشانه Opus حرکت میکند. اکنون رتبه #1 مدلهای open در Arena را دارد.”

“هر بار میبینم که یک NPC از طریق گفتگوی غیرمتن (unscripted) با GLM-5.1 متقاعد میشود، واقعاً جادویی است.”

“عملکرد کدنویسی واقعی است. یک race condition در بکاند Go ما را اصلاح کرد که GPT-4o مدام در مورد آن دچار توهم (hallucination) میشد.”

“اجرای این مدل به صورت محلی با Unsloth یک تغییر بزرگ برای حریم خصوصی دادهها در مجموعه حقوقی (legal tech) ماست.”

ویدیوهای درباره GLM-5.1

آموزشها، بررسیها و بحثهای درباره GLM-5.1 را تماشا کنید

“مدل GLM-5.1 در این benchmark امتیاز 45.3% را کسب کرد که جهش قابل توجهی برای این خانواده است.”

“این یک مدل فوقالعاده کند است... احتمالا آنها بخش زیادی از GPUهای خود را هنوز در حال سرویسدهی به GLM-5 دارند.”

“نحوه مدیریت tool-callها در این مدل بسیار قویتر از GLM 5 استاندارد است.”

“در حال حاضر قدرتمندترین مدل استدلالی است که میتوانید دانلود کنید و روی سختافزار خود اجرا کنید.”

“میتوانید ببینید که مدل واقعا اشتباهات خود را در لاگ فکر کردن (thinking log) شناسایی میکند.”

“میتواند به مدت 8 ساعت به طور خودمختار اجرا شود و استراتژیها را از طریق هزاران تکرار اصلاح کند.”

“در benchmarkهای محبوب تولید repo از Gemini 3.1 Pro و Qwen 3.6 Plus پیشی میگیرد.”

“حالت agentic جایی است که این مدل واقعا میدرخشد، در برابر باگهای سخت تسلیم نمیشود.”

“شرکت Z.ai عملاً دیوار پولی (paywall) را بر روی یک مدل 744B parameters در سطح frontier برداشته است.”

“به طور موثر مشکل 'plateau' را مدیریت میکند که سایر LLMها در طول زمان تمرکز خود را از دست میدهند.”

“80% کاهش حجم از 1.65 ترابایت اصلی به 236 گیگابایت در عین حفظ کیفیت.”

“قدرت open-source: حتی در نسخه کوانتیزه شده، کدی کاربردی برای fireworks نوشت.”

“برای فکر کردن به بارگذاری این غول MoE، حداقل به 256 گیگابایت RAM سیستم نیاز دارید.”

“از یک مکانیزم dynamic sparse attention برای حفظ انسجام آن context 202k استفاده میکند.”

“استفاده از Unsloth فرآیند آموزش و inference را بسیار کارآمدتر میکند.”

گردش کار خود را با اتوماسیون AI

Automatio قدرت عاملهای AI، اتوماسیون وب و ادغامهای هوشمند را ترکیب میکند تا به شما کمک کند در زمان کمتر بیشتر انجام دهید.

نکات حرفهای برای GLM-5.1

نکات تخصصی برای کمک به شما در استفاده حداکثری از GLM-5.1 و دستیابی به نتایج بهتر.

فعالسازی حالت Thinking

مطمئن شوید که گزینه 'Thinking' در تنظیمات شما فعال است تا قابلیتهای تکرار خودمختار 8 ساعته آزاد شود.

استفاده از سهمیههای ساعات غیر اوج

برای بهرهمندی از قیمتهای بهتر، دستههای مهندسی بزرگ را در ساعات غیر اوج مصرف یعنی خارج از 14:00 تا 18:00 به وقت پکن اجرا کنید.

الزامات حافظه برای اجرای محلی

از کوانتیزاسیون Unsloth Dynamic GGUF استفاده کنید تا مدل 1.6 ترابایتی را در 256 گیگابایت حافظه سیستم برای اجراهای محلی جای دهید.

انتخاب استراتژیک وظایف

GLM-5.1 را برای استدلالهای معماری رزرو کنید و از GLM-4.7 برای پیادهسازیهای روتین جهت مدیریت هزینهها استفاده کنید.

نظرات

کاربران ما چه میگویند

به هزاران کاربر راضی که گردش کار خود را متحول کردهاند بپیوندید

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

مرتبط AI Models

Qwen3.6-Max-Preview

alibaba

Qwen3.6-Max-Preview is Alibaba's flagship MoE model featuring 1M context, a native thinking mode, and SOTA scores in agentic coding and reasoning.

GLM-5

Zhipu (GLM)

GLM-5 is Zhipu AI's 744B parameter open-weight powerhouse, excelling in long-horizon agentic tasks, coding, and factual accuracy with a 200k context window.

GPT-5.2

OpenAI

GPT-5.2 is OpenAI's flagship model for professional tasks, featuring a 400K context window, elite coding, and deep multi-step reasoning capabilities.

Gemini 3.1 Flash-Lite

Gemini 3.1 Flash-Lite is Google's fastest, most cost-efficient model. Features 1M context, native multimodality, and 363 tokens/sec speed for scale.

Claude Opus 4.5

Anthropic

Claude Opus 4.5 is Anthropic's most powerful frontier model, delivering record-breaking 80.9% SWE-bench performance and advanced autonomous agency for coding.

Grok-4

xAI

Grok-4 by xAI is a frontier model featuring a 2M token context window, real-time X platform integration, and world-record reasoning capabilities.

Kimi K2.5

Moonshot

Discover Moonshot AI's Kimi K2.5, a 1T-parameter open-source agentic model featuring native multimodal capabilities, a 262K context window, and SOTA reasoning.

Kimi K2 Thinking

Moonshot

Kimi K2 Thinking is Moonshot AI's trillion-parameter reasoning model. It outperforms GPT-5 on HLE and supports 300 sequential tool calls autonomously for...

سوالات متداول درباره GLM-5.1

پاسخ سوالات رایج درباره GLM-5.1 را بیابید