Claude 3.7 Sonnet

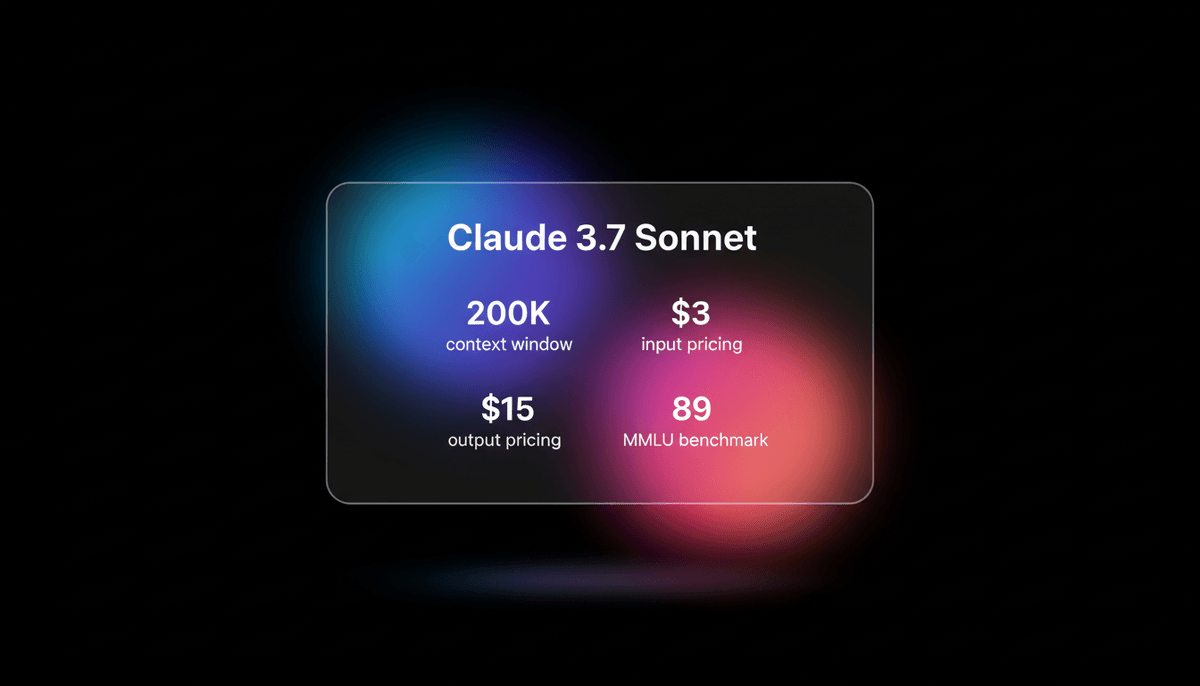

Claude 3.7 Sonnet est le premier modèle de raisonnement hybride d'Anthropic, offrant des capacités de programmation state-of-the-art, une context window de...

À propos de Claude 3.7 Sonnet

Découvrez les capacités, fonctionnalités et façons d'utiliser Claude 3.7 Sonnet.

Conception à raisonnement hybride

Claude 3.7 Sonnet utilise une nouvelle architecture permettant aux utilisateurs de choisir entre vitesse et profondeur. C'est le premier modèle à offrir un bouton de bascule pour la réflexion étendue, permettant au système de travailler sur une logique complexe avant de fournir une réponse. Cette transparence permet aux développeurs de voir exactement comment le modèle parvient à une conclusion, réduisant le risque d'erreurs cachées dans le travail technique.

Résolution de problèmes techniques

Ce modèle est conçu pour l'ingénierie logicielle de haut niveau. Il obtient un score de 62,1 % sur le benchmark SWE-bench Verified, démontrant une forte capacité à corriger de vraies issues GitHub. Lorsqu'il est utilisé avec des outils comme Claude Code, il gère l'édition de fichiers et l'exécution de commandes sur de grands référentiels. Il traite les tâches mathématiques et de programmation avec une précision qui égale ou dépasse les meilleurs modèles de raisonnement actuels.

Capacité de contexte massive

Avec une context window de 200 000 tokens, le modèle traite de grands ensembles de documentation ou de bases de code en une seule fois. Il prend en charge jusqu'à 128 000 tokens de sortie lorsque le mode de réflexion est actif, ce qui le rend utile pour générer de longs scripts ou des rapports détaillés. Le modèle est également multimodal, ce qui signifie qu'il peut interpréter des graphiques et des diagrammes en plus du texte.

Cas d'utilisation de Claude 3.7 Sonnet

Découvrez les différentes façons d'utiliser Claude 3.7 Sonnet pour obtenir d'excellents résultats.

Génie logiciel agentic

Utilisation de l'outil terminal pour corriger des bugs et refactoriser du code à travers des structures de fichiers volumineuses.

Vérification de preuves mathématiques

Résolution de problèmes mathématiques complexes en permettant au modèle de réfléchir aux étapes logiques.

Analyse de référentiel

Extraction de données et identification de modèles à partir de bases de code techniques entières via un seul prompt.

Analyse de données visuelles

Conversion de graphiques, d'organigrammes et de diagrammes techniques complexes en données JSON structurées.

Planification d'architecture système

Conception de systèmes logiciels avec des vérifications logiques détaillées utilisant le mode de réflexion étendu.

Workflows Git automatisés

Gestion des messages de commit, des revues de code et de l'exécution de tests via l'utilisation d'outils agentic.

Points forts

Limitations

Démarrage rapide API

anthropic/claude-3-7-sonnet

import Anthropic from '@anthropic-ai/sdk';

const anthropic = new Anthropic();

const message = await anthropic.messages.create({

model: "claude-3-7-sonnet-20250219",

max_tokens: 4096,

thinking: {

type: "enabled",

budget_tokens: 2048

},

messages: [{ role: "user", content: "Analyze this architectural flaw..." }],

});

console.log(message.content);Installez le SDK et commencez à faire des appels API en quelques minutes.

Ce que les gens disent de Claude 3.7 Sonnet

Voyez ce que la communauté pense de Claude 3.7 Sonnet

“Claude Code combiné à 3.7 Sonnet, c'est essentiellement un développeur junior sous stéroïdes dans mon terminal. C'est la première fois que l'IA agentic semble réelle.”

“Le raisonnement hybride est une mise à jour majeure. Je n'ai pas toujours besoin qu'il réfléchisse pendant 30 secondes, mais pour le débogage, c'est incroyable.”

“Anthropic a réussi à créer un modèle qui rivalise avec o1 en mathématiques tout en restant utile pour le chat quotidien.”

“Claude fournit des rapports complets, magnifiquement formatés et avec des citations en moins de cinq minutes.”

“La limite de sortie de 128k est une fonctionnalité sous-estimée. Enfin un modèle qui ne s'arrête pas en plein milieu d'un long script.”

“Claude 3.7 + MCP est ce qui se rapproche le plus de Jarvis en ce moment. Il utilise réellement mes outils locaux correctement.”

Vidéos sur Claude 3.7 Sonnet

Regardez des tutoriels, critiques et discussions sur Claude 3.7 Sonnet

“Claude 3.7 est impressionnant. Le nouveau modèle de base s'est surpassé pour devenir encore meilleur en programmation.”

“Le nouveau modèle 3.7 a littéralement écrasé tous les autres modèles, y compris o3 mini d'OpenAI.”

“Il est capable de résoudre 70 % des issues GitHub.”

“La réflexion étendue permet au modèle de peser un problème avant de produire du code.”

“C'est une victoire majeure pour l'expérience développeur.”

“Les chatbots vous donnent des conseils, mais Claude Code agit. Il peut créer des fichiers, construire des sites web et installer des paquets.”

“La réflexion étendue, c'est Claude qui raisonne avant d'agir.”

“L'outil est optimisé pour l'environnement terminal.”

“La connectivité MCP est ce qui le différencie vraiment de ChatGPT.”

“Le modèle comprend l'intention derrière des commandes terminal vagues.”

“L'intégration avec le terminal via Claude Code offre un niveau d'agence que nous n'avions pas encore vu.”

“La capacité de Claude 3.7 Sonnet à montrer son processus de réflexion est bien plus transparente que celle de ses concurrents.”

“Sur SWE-bench Verified, il atteint un score remarquable de 62 %.”

“Le raisonnement hybride signifie que vous ne subissez pas la pénalité de latence lorsque vous n'en avez pas besoin.”

“Il conserve la qualité d'écriture élevée des précédents modèles Claude.”

Optimisez votre flux de travail avec l'Automatisation IA

Automatio combine la puissance des agents IA, de l'automatisation web et des integrations intelligentes pour vous aider a accomplir plus en moins de temps.

Conseils Pro pour Claude 3.7 Sonnet

Conseils d'experts pour tirer le meilleur parti de Claude 3.7 Sonnet.

Définir des budgets de raisonnement

Utilisez le paramètre de réflexion (thinking) de l'API pour limiter le nombre de tokens de raisonnement et ainsi contrôler les coûts.

Passer en revue les blocs de réflexion

Examinez la chaîne de pensée (chain-of-thought) interne dans les réponses pour vérifier la logique des réponses complexes.

Utiliser les connecteurs MCP

Connectez le modèle à des bases de données locales et au stockage cloud pour bénéficier d'un contexte projet en temps réel.

Rafraîchissement du contexte

Utilisez des commandes de synthèse lors de longues boucles agentic pour garder la context window concentrée sur les données pertinentes.

Témoignages

Ce Que Disent Nos Utilisateurs

Rejoignez des milliers d'utilisateurs satisfaits qui ont transforme leur flux de travail

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Associés AI Models

Kimi K2 Thinking

Moonshot

Kimi K2 Thinking is Moonshot AI's trillion-parameter reasoning model. It outperforms GPT-5 on HLE and supports 300 sequential tool calls autonomously for...

GPT-5.4

OpenAI

GPT-5.4 is OpenAI's frontier model featuring a 1.05M context window and Extreme Reasoning. It excels at autonomous UI interaction and long-form data analysis.

Qwen3.5-Omni

alibaba

Qwen3.5-Omni is a natively omnimodal AI by Alibaba Cloud, offering seamless audio-visual reasoning, real-time voice chat, and 256k context for low-latency apps.

GPT-5.2

OpenAI

GPT-5.2 is OpenAI's flagship model for professional tasks, featuring a 400K context window, elite coding, and deep multi-step reasoning capabilities.

Qwen3.6-Max-Preview

alibaba

Qwen3.6-Max-Preview is Alibaba's flagship MoE model featuring 1M context, a native thinking mode, and SOTA scores in agentic coding and reasoning.

GLM-5

Zhipu (GLM)

GLM-5 is Zhipu AI's 744B parameter open-weight powerhouse, excelling in long-horizon agentic tasks, coding, and factual accuracy with a 200k context window.

GLM-5.1

Zhipu (GLM)

GLM-5.1 is Zhipu AI's flagship reasoning model, featuring a 202K context window and an autonomous 8-hour execution loop for complex agentic engineering.

Gemini 3.1 Flash-Lite

Gemini 3.1 Flash-Lite is Google's fastest, most cost-efficient model. Features 1M context, native multimodality, and 363 tokens/sec speed for scale.

Questions Fréquentes sur Claude 3.7 Sonnet

Trouvez des réponses aux questions courantes sur Claude 3.7 Sonnet