GLM-5.1

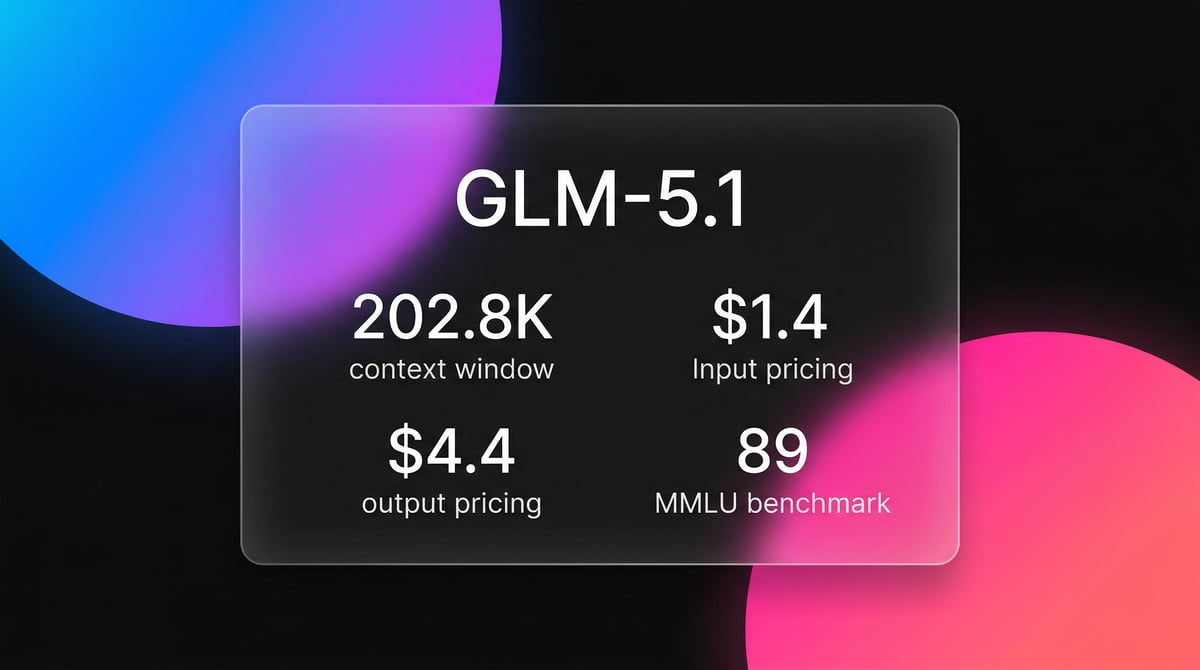

GLM-5.1 est le modèle de raisonnement flagship de Zhipu AI, doté d'une context window de 202K et d'une boucle d'exécution autonome de 8 heures pour...

À propos de GLM-5.1

Découvrez les capacités, fonctionnalités et façons d'utiliser GLM-5.1.

GLM-5.1 est le modèle fondation flagship de Zhipu AI conçu pour l'ingénierie système complexe et les tâches agentic de longue durée. Construit sur une architecture Mixture-of-Experts (MoE) avec 744 milliards de parameters et 40 milliards actifs par passage, il représente un bond significatif en termes d'endurance et de résolution autonome de problèmes. Le modèle est spécifiquement conçu pour surmonter les plateaux de raisonnement observés dans les LLM précédents, en maintenant la productivité et la qualité du code sur des milliers d'appels d'outils et des centaines d'itérations. Il identifie les blocages, exécute des expériences et ajuste sa propre stratégie sans intervention humaine.

Techniquement, GLM-5.1 excelle en tant que moteur de raisonnement primaire dans les systèmes multi-agents. Il gère les décisions architecturales de haut niveau tout en déléguant l'implémentation à des modèles plus petits. Il dispose d'une context window de 202K prise en charge par un mécanisme d'attention creuse dynamique, garantissant la cohérence sur des bases de code massives. Le modèle est publié en open weights sous licence MIT, offrant une alternative locale viable aux modèles frontier propriétaires pour des tâches telles que l'optimisation de bases de données, l'ingénierie de noyaux GPU et le développement d'applications web full-stack.

Les résultats de KernelBench niveau 3 montrent que GLM-5.1 maintient une accélération significative des charges de travail ML agentic sur de longues sessions par rapport à Claude Opus 4.6. Cette endurance permet aux développeurs de lancer une tâche d'ingénierie le matin et de recevoir un service entièrement testé et déployé à la fin de la journée. Il gère l'intégralité du cycle de vie d'un correctif de bug, de la reproduction du problème dans un environnement sandbox à la soumission de la pull request finale.

Cas d'utilisation de GLM-5.1

Découvrez les différentes façons d'utiliser GLM-5.1 pour obtenir d'excellents résultats.

Ingénierie logicielle autonome

Il fonctionne de manière autonome pendant plus de 8 heures pour concevoir, implémenter et déboguer des microservices sans intervention humaine.

Optimisation de bases de données haute performance

Le modèle optimise de manière itérative les implémentations de recherche vectorielle en Rust sur des centaines de cycles.

Optimisation de noyaux GPU

Il analyse les implémentations de référence pour produire des noyaux GPU plus rapides qui surpassent les compilateurs autotune par défaut.

Orchestration multi-agents

Il agit comme un moteur de raisonnement central qui coordonne les sous-tâches et les appels d'outils parmi une armée de modèles spécialisés plus petits.

Tâches complexes sur terminal

Il exécute des opérations de terminal réelles et une administration système multi-étapes via des outils CLI agentic.

Conception web Full-Stack

Le modèle génère des mises en page UI visuellement cohérentes et la logique backend pour des environnements de bureau basés sur navigateur.

Points forts

Limitations

Démarrage rapide API

zhipu/glm-5.1

import OpenAI from 'openai';

const client = new OpenAI({

apiKey: process.env.ZHIPU_API_KEY,

baseURL: 'https://api.z.ai/api/paas/v4'

});

const chat = await client.chat.completions.create({

model: 'glm-5.1',

messages: [{ role: 'user', content: 'Optimize this database schema.' }],

stream: true

});

for await (const chunk of chat) {

process.stdout.write(chunk.choices[0]?.delta?.content || '');

}Installez le SDK et commencez à faire des appels API en quelques minutes.

Ce que les gens disent de GLM-5.1

Voyez ce que la communauté pense de GLM-5.1

“GLM-5.1 a tourné en boucle sur un seul prompt pendant 8 heures d'affilée. Il n'a pas abandonné comme la plupart des modèles ; il a continué à ajouter des fonctionnalités et à se corriger lui-même.”

“Je l'ai testé à 140k de contexte au moins 5 fois et il est resté cohérent. Le SOTA a peut-être un concurrent.”

“GLM-5.1 est pratiquement au coude-à-coude avec Opus sur ce benchmark. C'est maintenant le modèle open-source n°1 dans l'Arena.”

“Chaque fois que je vois un PNJ être réellement convaincu par un dialogue non scripté avec GLM-5.1, c'est purement magique.”

“La performance de codage est réelle. Il a corrigé une condition de concurrence dans notre backend Go sur laquelle GPT-4o ne faisait que halluciner.”

“Exécuter cela localement avec Unsloth change la donne pour la confidentialité des données dans notre stack technologique juridique.”

Vidéos sur GLM-5.1

Regardez des tutoriels, critiques et discussions sur GLM-5.1

“GLM-5.1 a obtenu 45,3 % sur ce benchmark, un saut substantiel pour la famille.”

“C'est un modèle incroyablement lent... ils ont probablement plus de GPU qui servent encore GLM-5.”

“La façon dont il gère les appels d'outils est beaucoup plus robuste que celle du GLM 5 standard.”

“C'est actuellement le modèle de raisonnement le plus puissant que vous pouvez télécharger et exécuter sur votre propre matériel.”

“Vous pouvez le voir identifier ses propres erreurs dans le journal de réflexion.”

“Il peut fonctionner de manière autonome pendant 8 heures, affinant ses stratégies au fil de milliers d'itérations.”

“Il surpasse Gemini 3.1 Pro et Qwen 3.6 Plus sur les benchmarks populaires de génération de code.”

“Le mode agentic est là où ce modèle brille vraiment, il n'abandonne pas face aux bugs difficiles.”

“Z.ai a pratiquement supprimé la barrière de paiement sur un modèle frontier de 744B de parameters.”

“Il gère efficacement le problème du « plateau » où d'autres LLM perdent le fil au fil du temps.”

“Réduction de taille de 80 %, passant de 1,65 To à 236 Go tout en conservant la qualité.”

“Le pouvoir de l'open-source : même dans une version quantifiée, il a écrit du code fonctionnel pour des feux d'artifice.”

“Vous aurez besoin d'au moins 256 Go de RAM système pour envisager de charger ce géant MoE.”

“Il utilise un mécanisme d'attention creuse dynamique pour maintenir la cohérence de ces 202k de context window.”

“L'utilisation d'Unsloth rend le processus d'entraînement et d'inference beaucoup plus efficace.”

Optimisez votre flux de travail avec l'Automatisation IA

Automatio combine la puissance des agents IA, de l'automatisation web et des integrations intelligentes pour vous aider a accomplir plus en moins de temps.

Conseils Pro pour GLM-5.1

Conseils d'experts pour tirer le meilleur parti de GLM-5.1.

Activer le mode Thinking

Assurez-vous que le bouton « Thinking » est activé dans votre configuration pour débloquer les capacités d'itération autonome de 8 heures.

Utiliser les quotas hors pointe

Exécutez les gros traitements d'ingénierie en dehors des heures de pointe (14h00-18h00, heure de Pékin) pour bénéficier de meilleurs tarifs.

Exigences de mémoire locale

Utilisez la quantification Unsloth Dynamic GGUF pour faire tenir le modèle de 1,6 To dans 256 Go de RAM système pour les exécutions locales.

Sélection stratégique des tâches

Réservez GLM-5.1 pour le raisonnement architectural et utilisez GLM-4.7 pour les implémentations de routine afin de maîtriser les coûts.

Témoignages

Ce Que Disent Nos Utilisateurs

Rejoignez des milliers d'utilisateurs satisfaits qui ont transforme leur flux de travail

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Associés AI Models

Qwen3.6-Max-Preview

alibaba

Qwen3.6-Max-Preview is Alibaba's flagship MoE model featuring 1M context, a native thinking mode, and SOTA scores in agentic coding and reasoning.

GLM-5

Zhipu (GLM)

GLM-5 is Zhipu AI's 744B parameter open-weight powerhouse, excelling in long-horizon agentic tasks, coding, and factual accuracy with a 200k context window.

GPT-5.2

OpenAI

GPT-5.2 is OpenAI's flagship model for professional tasks, featuring a 400K context window, elite coding, and deep multi-step reasoning capabilities.

Gemini 3.1 Flash-Lite

Gemini 3.1 Flash-Lite is Google's fastest, most cost-efficient model. Features 1M context, native multimodality, and 363 tokens/sec speed for scale.

Claude Opus 4.5

Anthropic

Claude Opus 4.5 is Anthropic's most powerful frontier model, delivering record-breaking 80.9% SWE-bench performance and advanced autonomous agency for coding.

Grok-4

xAI

Grok-4 by xAI is a frontier model featuring a 2M token context window, real-time X platform integration, and world-record reasoning capabilities.

Kimi K2.5

Moonshot

Discover Moonshot AI's Kimi K2.5, a 1T-parameter open-source agentic model featuring native multimodal capabilities, a 262K context window, and SOTA reasoning.

Kimi K2 Thinking

Moonshot

Kimi K2 Thinking is Moonshot AI's trillion-parameter reasoning model. It outperforms GPT-5 on HLE and supports 300 sequential tool calls autonomously for...

Questions Fréquentes sur GLM-5.1

Trouvez des réponses aux questions courantes sur GLM-5.1