Qwen3.5-Omni

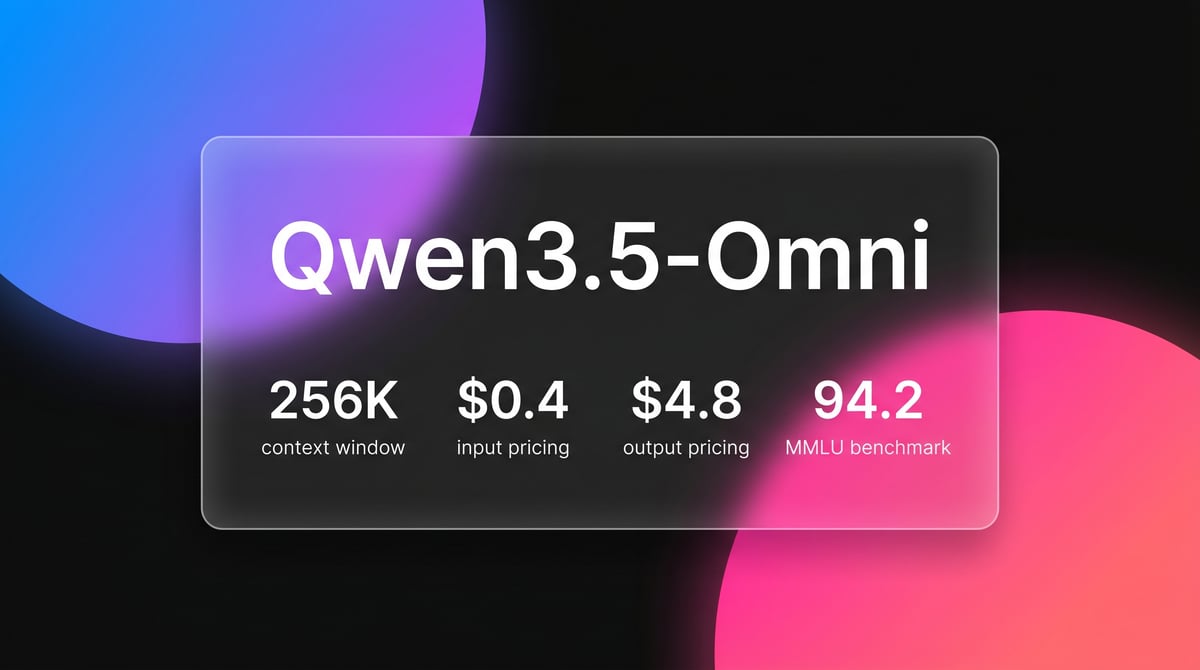

Qwen3.5-Omni est une IA nativement omnimodale d'Alibaba Cloud, offrant un raisonnement audiovisuel fluide, un chat vocal en temps réel et 256k de contexte pour...

À propos de Qwen3.5-Omni

Découvrez les capacités, fonctionnalités et façons d'utiliser Qwen3.5-Omni.

Architecture omnimodale unifiée

Qwen3.5-Omni est un modèle nativement omnimodal développé par Alibaba Cloud, construit sur une architecture unifiée conçue pour traiter simultanément les entrées texte, image, audio et vidéo. Contrairement aux modèles précédents qui s'appuyaient sur des encodeurs séparés, Qwen3.5-Omni utilise une architecture Thinker-Talker. Le composant Thinker effectue un raisonnement multimodal complexe sur des signaux entrelacés, tandis que le composant Talker génère une parole en streaming de haute qualité et à faible latence. Cela permet au modèle de gérer un contexte massif, incluant jusqu'à 10 heures d'audio ou près de sept minutes de vidéo 720p en un seul prompt.

Synchronisation et performances avancées

Une caractéristique technique clé de ce modèle est le système ARIA (Adaptive Rate Interleave Alignment), qui synchronise les tokens de texte et de parole pour garantir des réponses vocales naturelles. Le modèle prend en charge l'interruption sémantique en temps réel, permettant aux utilisateurs de couper l'IA pendant la conversation. Il est optimisé à la fois pour l'analyse multimodale en entreprise et pour les assistants vocaux en temps réel destinés aux consommateurs, offrant des performances en tâches visuelles et audio égales, voire supérieures, aux modèles propriétaires flagships.

Spécialisé pour l'interaction à faible latence

L'architecture du modèle est spécifiquement calibrée pour les applications en temps réel où la latence est critique. En utilisant une approche MoE (Mixture-of-Experts) avec une architecture de réseaux delta à porte (gated delta networks), le modèle maintient une haute efficacité computationnelle. Cette efficacité lui permet de fournir une interaction audio en temps réel tout en gérant une context window de 256k tokens, ce qui le rend idéal pour l'analyse de contenus longs tels que les transcriptions de réunions ou l'indexation de vidéos cinématographiques.

Cas d'utilisation de Qwen3.5-Omni

Découvrez les différentes façons d'utiliser Qwen3.5-Omni pour obtenir d'excellents résultats.

Assistants vocaux en temps réel

Le modèle permet de créer des avatars IA interactifs capables d'engager des conversations vocales naturelles avec prise en charge de l'interruption sémantique.

Sous-titrage vidéo cinématographique

Il génère des descriptions de niveau scénaristique et des annotations horodatées pour des contenus vidéo haute définition longue durée.

Live coding audiovisuel

Les développeurs corrigent leur code en partageant leur écran et en expliquant oralement la logique au modèle en temps réel.

Archivage audio d'entreprise

Le système traite jusqu'à 10 heures d'enregistrements de réunions ou de podcasts pour en extraire des insights en un seul passage.

Services de traduction multilingue

Il offre une traduction speech-to-speech complète dans 113 langues et divers dialectes régionaux chinois.

Modération de contenu

Le modèle audite les flux vidéo et audio pour assurer la sécurité en identifiant simultanément les contenus visuels et verbaux prohibés.

Points forts

Limitations

Démarrage rapide API

alibaba/qwen3.5-omni-plus

import OpenAI from 'openai';

const client = new OpenAI({

apiKey: process.env.DASHSCOPE_API_KEY,

baseURL: 'https://dashscope-intl.aliyuncs.com/compatible-mode/v1',

});

const completion = await client.chat.completions.create({

model: 'qwen3.5-omni-plus',

messages: [{ role: 'user', content: 'Analyze this video content.' }],

modalities: ['text'],

stream: true,

});

for await (const chunk of completion) {

process.stdout.write(chunk.choices[0]?.delta?.content || '');

}Installez le SDK et commencez à faire des appels API en quelques minutes.

Ce que les gens disent de Qwen3.5-Omni

Voyez ce que la communauté pense de Qwen3.5-Omni

“Le codage audiovisuel « vibe coding » change la donne ; il comprend enfin ce que je montre à l'écran pendant que j'explique le bug.”

“La capacité de Qwen3.5-Omni à gérer 10 heures d'audio dans un seul contexte est insensée pour les chercheurs et les podcasteurs.”

“Le clonage vocal semble étonnamment naturel par rapport à la génération précédente, presque indiscernable en anglais.”

“Enfin un modèle qui ne me coupe pas la parole en milieu de phrase ; l'interruption sémantique fonctionne comme promis.”

“Des chiffres impressionnants sur le nouveau Qwen3.6 27B, mais la version Omni est celle que tout le monde utilisera pour des produits réels.”

“J'ai essayé de l'interrompre cinq fois, et il a capté mon intention à chaque fois.”

Vidéos sur Qwen3.5-Omni

Regardez des tutoriels, critiques et discussions sur Qwen3.5-Omni

“L'architecture Thinker-Talker est un pas de géant pour la latence en temps réel [04:15].”

“Il gère 400 secondes de vidéo, soit le double de ce que nous voyons habituellement [07:22].”

“Ce modèle est nativement multilingue et multimodal de bout en bout [10:05].”

“Le système ARIA empêche les erreurs de prononciation présentes dans la TTS standard [15:30].”

“Vous pouvez littéralement montrer votre écran et avoir une conversation fluide sur le code [22:10].”

“J'ai essayé de l'interrompre cinq fois, et il a capté mon intention à chaque fois [08:30].”

“La façon dont il écrit du code en se basant sur ce qu'il voit dans la vidéo est impressionnante [10:45].”

“C'est le premier vrai concurrent du mode vocal de GPT-4o que nous ayons vu [14:20].”

“Il prend en charge 113 langues pour la reconnaissance vocale, ce qui est un avantage majeur [18:55].”

“L'extraction visuelle est beaucoup plus robuste pour les PDF complexes et la vidéo [25:15].”

“Le contexte audio de 10 heures est la vraie star ici pour un usage en entreprise [12:10].”

“C'est sur les langues non anglaises que Qwen prend vraiment de l'avance [15:40].”

“Il peut faire la distinction entre le bruit de fond et une réelle interruption de l'utilisateur [19:22].”

“La tarification est très compétitive, surtout au vu du nombre de paramètres actifs [24:10].”

“C'est actuellement le modèle le plus performant pour l'automatisation Python impliquant une interface utilisateur visuelle [28:45].”

Optimisez votre flux de travail avec l'Automatisation IA

Automatio combine la puissance des agents IA, de l'automatisation web et des integrations intelligentes pour vous aider a accomplir plus en moins de temps.

Conseils Pro pour Qwen3.5-Omni

Conseils d'experts pour tirer le meilleur parti de Qwen3.5-Omni.

Optimiser l'ingestion audio

Segmentez les fichiers audio de plus de 10 heures pour maintenir une précision de récupération factuelle au sein de la context window de 256k.

Exploiter l'interruption sémantique

Activez les fonctionnalités natives de prise de parole dans les applications vocales pour distinguer l'intention de l'utilisateur du bruit de fond.

Utiliser ARIA pour les termes techniques

Utilisez le mode de synthèse vocale en streaming pour bénéficier de l'alignement ARIA, qui garantit une prononciation précise des chiffres et termes techniques.

Contrôle de la fréquence d'images vidéo

Téléchargez les vidéos standard à 1 FPS, mais augmentez la fréquence pour les scènes d'action intense afin d'assurer une précision visuelle.

Témoignages

Ce Que Disent Nos Utilisateurs

Rejoignez des milliers d'utilisateurs satisfaits qui ont transforme leur flux de travail

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Associés AI Models

GPT-5.4

OpenAI

GPT-5.4 is OpenAI's frontier model featuring a 1.05M context window and Extreme Reasoning. It excels at autonomous UI interaction and long-form data analysis.

Kimi K2 Thinking

Moonshot

Kimi K2 Thinking is Moonshot AI's trillion-parameter reasoning model. It outperforms GPT-5 on HLE and supports 300 sequential tool calls autonomously for...

GPT-5.2

OpenAI

GPT-5.2 is OpenAI's flagship model for professional tasks, featuring a 400K context window, elite coding, and deep multi-step reasoning capabilities.

Qwen3.6-Max-Preview

alibaba

Qwen3.6-Max-Preview is Alibaba's flagship MoE model featuring 1M context, a native thinking mode, and SOTA scores in agentic coding and reasoning.

GLM-5

Zhipu (GLM)

GLM-5 is Zhipu AI's 744B parameter open-weight powerhouse, excelling in long-horizon agentic tasks, coding, and factual accuracy with a 200k context window.

GLM-5.1

Zhipu (GLM)

GLM-5.1 is Zhipu AI's flagship reasoning model, featuring a 202K context window and an autonomous 8-hour execution loop for complex agentic engineering.

GPT-5.3 Codex

OpenAI

GPT-5.3 Codex is OpenAI's 2026 frontier coding agent, featuring a 400K context window, 77.3% Terminal-Bench score, and superior logic for complex software...

Gemini 3.1 Flash-Lite

Gemini 3.1 Flash-Lite is Google's fastest, most cost-efficient model. Features 1M context, native multimodality, and 363 tokens/sec speed for scale.

Questions Fréquentes sur Qwen3.5-Omni

Trouvez des réponses aux questions courantes sur Qwen3.5-Omni