Qwen3-Coder-Next

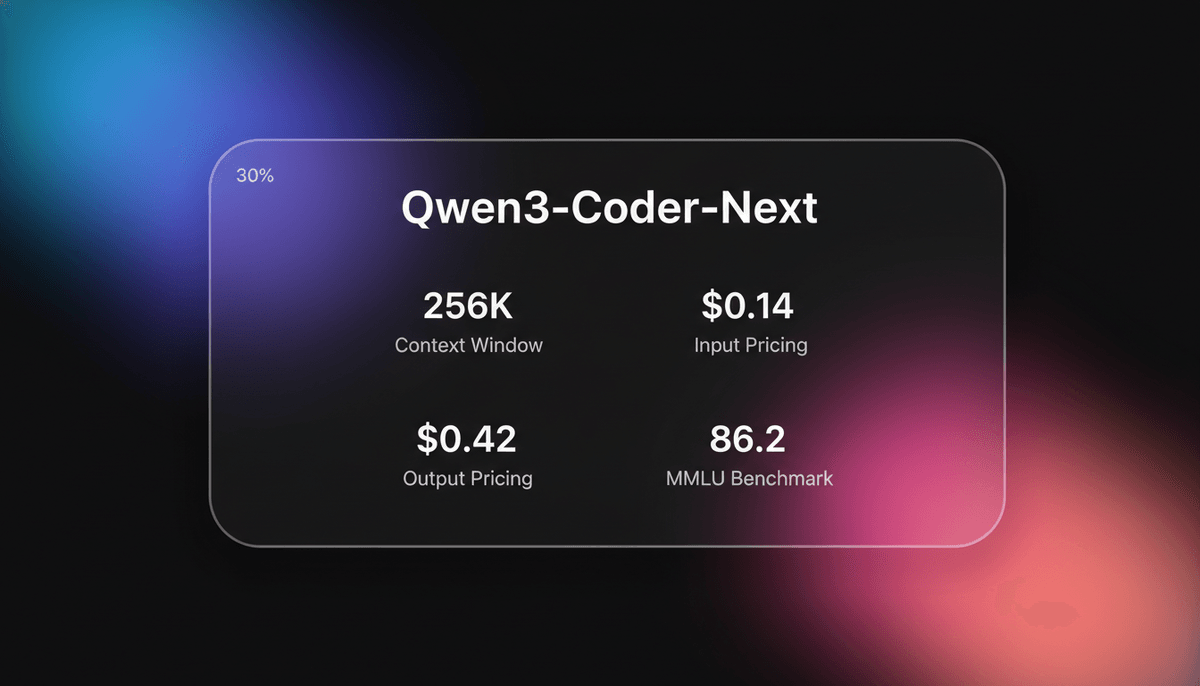

Qwen3-Coder-Next est le model de codage d'élite Apache 2.0 d'Alibaba Cloud, doté d'une architecture MoE 80B et d'une context window de 256k pour le...

À propos de Qwen3-Coder-Next

Découvrez les capacités, fonctionnalités et façons d'utiliser Qwen3-Coder-Next.

Architecture du model

Qwen3-Coder-Next est un model open-weight spécialisé conçu par Alibaba Cloud pour les agents d'ingénierie logicielle. Il utilise une architecture Mixture-of-Experts (MoE) avec 80 milliards de paramètres au total, mais n'active que 3 milliards de paramètres par token. Cette conception combine l'intelligence d'un model massif avec la vitesse d'inference d'un petit model. L'architecture inclut un mécanisme d'attention hybride, intégrant Gated DeltaNet avec Gated Attention standard pour traiter des contextes allant jusqu'à 262 144 tokens.

Spécialisation agentic

Le model est entraîné sur plus de 800 000 tâches de codage vérifiables et environnements exécutables. Cet entraînement met l'accent sur le reasoning à long terme et la capacité à récupérer suite à des échecs d'exécution. Il obtient 70,8 % sur SWE-Bench Verified, démontrant sa capacité à gérer des tâches de développement multi-étapes, de la planification initiale à l'exécution finale du code. Il excelle dans les frameworks d'agents autonomes comme OpenClaw et Qwen Code.

Déploiement et confidentialité

Sous licence Apache 2.0, ce model offre une alternative sécurisée pour les développeurs ayant besoin d'environnements de développement locaux et privés. Il peut fonctionner sur du matériel grand public avec suffisamment de RAM via la quantification. La grande context window permet une analyse à l'échelle du dépôt sans la dégradation des performances généralement constatée dans les modèles à contexte plus restreint.

Cas d'utilisation de Qwen3-Coder-Next

Découvrez les différentes façons d'utiliser Qwen3-Coder-Next pour obtenir d'excellents résultats.

Agents de codage autonomes

Alimente des frameworks capables de gérer des tâches de développement complexes, de la planification à l'exécution finale.

Développement privé local

Exécute une assistance au codage d'élite sur des GPU grand public avec 16 Go de VRAM via des couches MoE quantifiées.

Analyse de dépôts à grande échelle

Traite des bases de code entières au sein de sa fenêtre de 256k pour identifier la dette technique.

Réparation et refactorisation de code

Met à jour le code legacy selon les standards modernes en fournissant un feedback d'environnement exécutable.

Scripting multilingue

Génère du code haute fidélité dans plus de 40 langages de programmation, dont Rust et Go.

Simulation 3D interactive

Construit des visualiseurs et simulations web complexes grâce à une génération rapide one-shot.

Points forts

Limitations

Démarrage rapide API

alibaba/qwen-3-coder-next

import OpenAI from "openai";

const client = new OpenAI({

apiKey: process.env.DASHSCOPE_API_KEY,

baseURL: "https://dashscope-intl.aliyuncs.com/compatible-mode/v1",

});

async function main() {

const completion = await client.chat.completions.create({

model: "qwen3-coder-next",

messages: [

{ role: "system", content: "You are a professional coding assistant." },

{ role: "user", content: "Write a React component for a sortable list." },

],

});

console.log(completion.choices[0].message.content);

}

main();Installez le SDK et commencez à faire des appels API en quelques minutes.

Ce que les gens disent de Qwen3-Coder-Next

Voyez ce que la communauté pense de Qwen3-Coder-Next

“Égale presque Claude en capacités globales de codage. Bat Claude 3.5 Sonnet sur HumanEval à 92,7 %.”

“L'efficacité de la version MoE est incroyable pour le matériel local. J'obtiens 26 TPS sur un système de milieu de gamme.”

“Le self-speculative decoding est mathématiquement impossible pour Qwen Coder Next à cause des états récurrents.”

“Qwen3-Coder-Next est basé sur MoE, et bien plus fort et intelligent qu'avant !”

“Démontre la capacité de changer de fournisseur en milieu de projet avec les nouvelles variantes de model 480B.”

“La recette d'entraînement agentic sur 800k tâches se voit dans sa manière de récupérer après des erreurs de build.”

Vidéos sur Qwen3-Coder-Next

Regardez des tutoriels, critiques et discussions sur Qwen3-Coder-Next

“Il est accessible pour ceux qui veulent expérimenter avec des agents de codage IA locaux”

“Ce model m'incite clairement à tester du code ouvert, ce que je vais faire”

“L'efficacité mémoire sur ce modèle est une victoire énorme”

“Il gère la logique complexe mieux que le précédent model dense de 72B”

“C'est le premier model ouvert qui suit correctement mes commandes de terminal”

“Qwen 3 coder Next n'a aussi que 3 milliards de paramètres actifs pour tourner sur une carte graphique grand public”

“Ça fonctionne à merveille. Je suis vraiment étonné de pouvoir obtenir ce résultat en une seule fois depuis une IA locale”

“80 milliards de paramètres nécessitent généralement un cluster, mais l'approche MoE change tout”

“Il gère 40+ langages de programmation sans perte de performance notable”

“L'utiliser avec OpenClaw donne l'impression d'avoir un développeur junior dans l'équipe”

“Un model de 3 milliards de paramètres qui rivalise avec des modèles 10 à 20 fois plus gros”

“Qwen 3 offre beaucoup d'avantages pour un coût moindre”

“Le context de 256k est bien réel, il n'a pas halluciné au milieu de mon projet”

“La latence est étonnamment faible compte tenu du poids total de 80B de paramètres”

“Il a corrigé un bug dans mon vieux dépôt Go que GPT-4o avait manqué trois fois”

Optimisez votre flux de travail avec l'Automatisation IA

Automatio combine la puissance des agents IA, de l'automatisation web et des integrations intelligentes pour vous aider a accomplir plus en moins de temps.

Conseils Pro pour Qwen3-Coder-Next

Conseils d'experts pour tirer le meilleur parti de Qwen3-Coder-Next.

Utilisez des System Prompts longs

Fournissez au model des exemples détaillés et de la documentation pour aligner son comportement agentic.

Feedback itératif sur les erreurs

Réinjectez les logs d'erreurs de la console du navigateur dans le model pour une auto-correction à haut taux de réussite.

Optimisez le déchargement des couches

Déchargez les couches d'experts MoE spécifiques vers la RAM système pour équilibrer la vitesse d'inference et le reasoning.

Alignez les paramètres d'échantillonnage

Utilisez une température de 1,0 avec un top_p de 0,95 et un top_k de 40 pour des résultats de codage plus précis.

Témoignages

Ce Que Disent Nos Utilisateurs

Rejoignez des milliers d'utilisateurs satisfaits qui ont transforme leur flux de travail

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Associés AI Models

MiMo V2.5 Pro

Other

MiMo V2.5 Pro is Xiaomi's open-source 1.02T parameter MoE model featuring a 1M context window, native multimodality, and elite agentic coding performance.

DeepSeek-V3.2-Speciale

DeepSeek

DeepSeek-V3.2-Speciale is a reasoning-first LLM featuring gold-medal math performance, DeepSeek Sparse Attention, and a 131K context window. Rivaling GPT-5...

MiniMax M2.5

minimax

MiniMax M2.5 is a SOTA MoE model featuring a 1M context window and elite agentic coding capabilities at disruptive pricing for autonomous agents.

GLM-4.7

Zhipu (GLM)

GLM-4.7 by Zhipu AI is a flagship 358B MoE model featuring a 200K context window, elite 73.8% SWE-bench performance, and native Deep Thinking for agentic...

GPT-4o mini

OpenAI

OpenAI's most cost-efficient small model, GPT-4o mini offers multimodal intelligence and high-speed performance at a significantly lower price point.

Qwen 3.7 Max

alibaba

Qwen 3.7 Max is Alibaba’s flagship AI model for deep reasoning and autonomous agent tasks, featuring a 256k context window and top-tier coding performance.

Qwen3.5-Omni

alibaba

Qwen3.5-Omni is a natively omnimodal AI by Alibaba Cloud, offering seamless audio-visual reasoning, real-time voice chat, and 256k context for low-latency apps.

DeepSeek v4

DeepSeek

DeepSeek v4 is a 1.6T parameter MoE model featuring a 1M token context window and native multimodal support for text, vision, and video at disruptive prices.

Questions Fréquentes sur Qwen3-Coder-Next

Trouvez des réponses aux questions courantes sur Qwen3-Coder-Next