Hogyan végezzünk jup.ag scrapinget: Jupiter DEX Web Scraper útmutató

Ismerje meg, hogyan végezhet jup.ag scrapinget valós idejű Solana token árak, swap útvonalak és piaci volumenek kinyeréséhez. Fedezze fel a Jupiter hivatalos...

Anti-bot védelem észlelve

- Cloudflare

- Vállalati szintű WAF és botkezelés. JavaScript kihívásokat, CAPTCHA-kat és viselkedéselemzést használ. Böngészőautomatizálás szükséges rejtett beállításokkal.

- Sebességkorlátozás

- IP/munkamenet alapú kéréseket korlátoz időben. Forgó proxykkal, kéréskésleltetéssel és elosztott scrapinggel megkerülhető.

- Böngésző ujjlenyomat

- Botokat azonosít a böngésző jellemzői alapján: canvas, WebGL, betűtípusok, bővítmények. Hamisítás vagy valódi böngészőprofilok szükségesek.

- Böngésző ujjlenyomat

- Botokat azonosít a böngésző jellemzői alapján: canvas, WebGL, betűtípusok, bővítmények. Hamisítás vagy valódi böngészőprofilok szükségesek.

A(z) Jupiter Névjegye

Fedezze fel, mit kínál a(z) Jupiter és milyen értékes adatok nyerhetők ki.

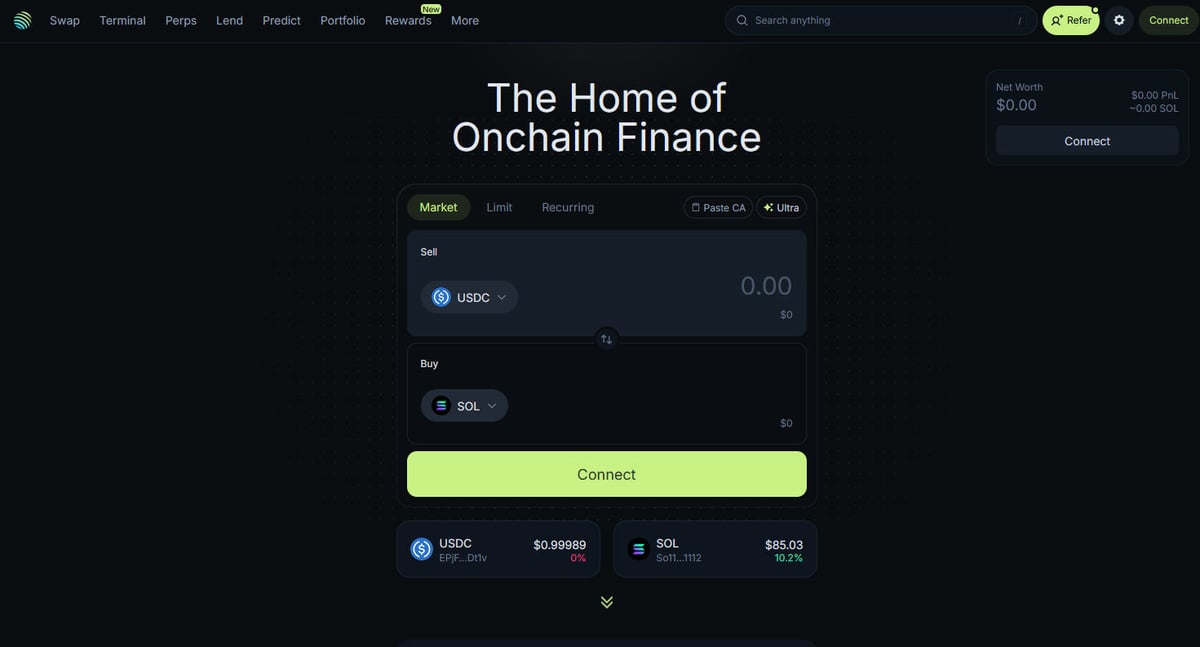

A Solana DeFi központja

A Jupiter a Solana blockchain elsődleges likviditási aggregátora, amely egyfajta „DeFi Superapp”-ként működik: optimalizálja a kereskedési útvonalakat több száz likviditási poolon keresztül, hogy a felhasználók számára a legjobb árakat és minimális slippage-et biztosítsa. Ez a Solana on-chain pénzügyeinek központi csomópontja, amely a egyszerű token swapoktól kezdve az olyan fejlett funkciókig kínál szolgáltatásokat, mint a perpetual trading akár 250x-es tőkeáttétellel (leverage), a limit orders és a dollar-cost averaging (DCA). A platform kritikus adatokat szolgáltat az ökoszisztéma számára, beleértve a valós idejű árazást, a likviditási mélységet és az átfogó piaci mérőszámokat több ezer eszközre vonatkozóan.

Technikai architektúra

A weboldal modern technológiai stackre épül, Next.js és React használatával, ami egy rendkívül dinamikus egyoldalas alkalmazássá (SPA) teszi. Mivel az árakat és az útvonalakat valós időben, az aktuális blockchain állapot alapján számítják ki, a frontend folyamatosan frissül WebSocketeken és magas frekvenciájú API hívásokon keresztül. Az adattudósok, fejlesztők és kereskedők számára a Jupiter adatai jelentik az aranyszabályt a Solana piaci hangulatának és a likviditási mozgásoknak a követésére a teljes ökoszisztémában.

Miért fontosak ezek az adatok?

Ezekhez az adatokhoz való hozzáférés elengedhetetlen kereskedési botok, piaci dashboardok építéséhez és előzményelemzések elvégzéséhez az egyik leggyorsabban növekvő blockchain hálózaton. A scraperek gyakran célozzák a Jupitert az új token listázások figyelésére, a „bálnák” mozgásának követésére a perpetual piacokon, vagy az arbitrázslehetőségek azonosítására. Bár a platform kínál hivatalos API-kat, a közvetlen web scrapinget gyakran alkalmazzák a pontos UI állapot és olyan specifikus routing adatok rögzítésére, amelyek esetleg nem érhetők el teljesen a nyilvános endpointokon keresztül.

Miért Kell Scrapelni a(z) Jupiter-t?

Fedezze fel a(z) Jupiter-ból történő adatkinyerés üzleti értékét és felhasználási eseteit.

Valós idejű ármonitorozás Solana tokenekhez

Arbitrázs kereskedési botok fejlesztése DEX-ek között

Piaci volumen és likviditási trendek követése

Új token listázások és piaci hangulat azonosítása

Hitelezési hozamok és perpetual funding ráták aggregálása

Történelmi árhatás elemzése nagy kereskedésekhez

Scraping Kihívások

Technikai kihívások, amelyekkel a(z) Jupiter scrapelésekor találkozhat.

Agresszív Cloudflare anti-bot védelem

Teljes JavaScript renderelés igénye (React/Next.js)

Agresszív IP-alapú rate limiting a nyilvános endpointokon

Dinamikus és obszfukált CSS szelektorok az UI-ban

Nagy sebességű adatfrissítések, amelyek alacsony késleltetésű kapcsolatot igényelnek

Scrapeld a Jupiter-t AI-val

Nincs szükség kódolásra. Nyerj ki adatokat percek alatt AI-vezérelt automatizálással.

Hogyan működik

Írd le, mire van szükséged

Mondd el az AI-nak, milyen adatokat szeretnél kinyerni a Jupiter-ról. Csak írd be természetes nyelven — nincs szükség kódra vagy szelektorokra.

Az AI kinyeri az adatokat

Mesterséges intelligenciánk navigál a Jupiter-on, kezeli a dinamikus tartalmat, és pontosan azt nyeri ki, amit kértél.

Kapd meg az adataidat

Kapj tiszta, strukturált adatokat, amelyek készen állnak CSV, JSON exportra vagy közvetlenül az alkalmazásaidba küldésre.

Miért érdemes AI-t használni a scrapeléshez

Az AI megkönnyíti a Jupiter scrapelését kódírás nélkül. Mesterséges intelligenciával működő platformunk megérti, milyen adatokra van szükséged — csak írd le természetes nyelven, és az AI automatikusan kinyeri őket.

How to scrape with AI:

- Írd le, mire van szükséged: Mondd el az AI-nak, milyen adatokat szeretnél kinyerni a Jupiter-ról. Csak írd be természetes nyelven — nincs szükség kódra vagy szelektorokra.

- Az AI kinyeri az adatokat: Mesterséges intelligenciánk navigál a Jupiter-on, kezeli a dinamikus tartalmat, és pontosan azt nyeri ki, amit kértél.

- Kapd meg az adataidat: Kapj tiszta, strukturált adatokat, amelyek készen állnak CSV, JSON exportra vagy közvetlenül az alkalmazásaidba küldésre.

Why use AI for scraping:

- No-code adatkinyerés dinamikus SPA-kból

- A Cloudflare és a böngésző ujjlenyomatok automatikus kezelése

- Ütemezett kinyerés a folyamatos piaci monitorozáshoz

- Közvetlen adatexport Webhookokra vagy Google Sheets-be

No-Code Web Scraperek a Jupiter számára

Kattints-és-válassz alternatívák az AI-alapú scrapeléshez

Számos no-code eszköz, mint a Browse.ai, Octoparse, Axiom és ParseHub segíthet a Jupiter scrapelésében kódírás nélkül. Ezek az eszközök általában vizuális felületeket használnak az adatok kiválasztásához, bár nehézségeik lehetnek összetett dinamikus tartalmakkal vagy anti-bot intézkedésekkel.

Tipikus Munkafolyamat No-Code Eszközökkel

Gyakori Kihívások

Tanulási görbe

A szelektorok és a kinyerési logika megértése időt igényel

Szelektorok elromlanak

A weboldal változásai tönkretehetik a teljes munkafolyamatot

Dinamikus tartalom problémák

JavaScript-gazdag oldalak komplex megoldásokat igényelnek

CAPTCHA korlátozások

A legtöbb eszköz manuális beavatkozást igényel CAPTCHA esetén

IP blokkolás

Az agresszív scraping az IP blokkolásához vezethet

No-Code Web Scraperek a Jupiter számára

Számos no-code eszköz, mint a Browse.ai, Octoparse, Axiom és ParseHub segíthet a Jupiter scrapelésében kódírás nélkül. Ezek az eszközök általában vizuális felületeket használnak az adatok kiválasztásához, bár nehézségeik lehetnek összetett dinamikus tartalmakkal vagy anti-bot intézkedésekkel.

Tipikus Munkafolyamat No-Code Eszközökkel

- Böngésző bővítmény telepítése vagy regisztráció a platformon

- Navigálás a célweboldalra és az eszköz megnyitása

- Adatelemek kiválasztása kattintással

- CSS szelektorok konfigurálása minden adatmezőhöz

- Lapozási szabályok beállítása több oldal scrapeléséhez

- CAPTCHA kezelése (gyakran manuális megoldás szükséges)

- Ütemezés konfigurálása automatikus futtatásokhoz

- Adatok exportálása CSV, JSON formátumba vagy API-n keresztüli csatlakozás

Gyakori Kihívások

- Tanulási görbe: A szelektorok és a kinyerési logika megértése időt igényel

- Szelektorok elromlanak: A weboldal változásai tönkretehetik a teljes munkafolyamatot

- Dinamikus tartalom problémák: JavaScript-gazdag oldalak komplex megoldásokat igényelnek

- CAPTCHA korlátozások: A legtöbb eszköz manuális beavatkozást igényel CAPTCHA esetén

- IP blokkolás: Az agresszív scraping az IP blokkolásához vezethet

Kod peldak

import requests

def get_jupiter_price(token_address):

# Using the official Jupiter Price API V2 is the most reliable method

url = f"https://api.jup.ag/price/v2?ids={token_address}"

headers = {

"User-Agent": "Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/120.0.0.0 Safari/537.36",

"Accept": "application/json"

}

try:

response = requests.get(url, headers=headers)

response.raise_for_status()

data = response.json()

price_info = data['data'].get(token_address)

if price_info:

print(f"Token: {token_address} | Price: ${price_info['price']}")

except Exception as e:

print(f"An error occurred: {e}")

# Example: Fetching SOL price

get_jupiter_price("So11111111111111111111111111111111111111112")Mikor Használjuk

A legjobb statikus HTML oldalakhoz, ahol a tartalom szerver oldalon töltődik. A leggyorsabb és legegyszerűbb megközelítés, amikor JavaScript renderelés nem szükséges.

Előnyök

- ●Leggyorsabb végrehajtás (nincs böngésző overhead)

- ●Legalacsonyabb erőforrás-fogyasztás

- ●Könnyen párhuzamosítható asyncio-val

- ●Kiváló API-khoz és statikus oldalakhoz

Korlátok

- ●Nem tudja végrehajtani a JavaScriptet

- ●Nem működik SPA-knál és dinamikus tartalmaknál

- ●Problémái lehetnek összetett anti-bot rendszerekkel

How to Scrape Jupiter with Code

Python + Requests

import requests

def get_jupiter_price(token_address):

# Using the official Jupiter Price API V2 is the most reliable method

url = f"https://api.jup.ag/price/v2?ids={token_address}"

headers = {

"User-Agent": "Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/120.0.0.0 Safari/537.36",

"Accept": "application/json"

}

try:

response = requests.get(url, headers=headers)

response.raise_for_status()

data = response.json()

price_info = data['data'].get(token_address)

if price_info:

print(f"Token: {token_address} | Price: ${price_info['price']}")

except Exception as e:

print(f"An error occurred: {e}")

# Example: Fetching SOL price

get_jupiter_price("So11111111111111111111111111111111111111112")Python + Playwright

from playwright.sync_api import sync_playwright

def scrape_jupiter_tokens():

with sync_playwright() as p:

# Launch a browser that can render the Next.js frontend

browser = p.chromium.launch(headless=True)

context = browser.new_context(

user_agent="Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/120.0.0.0 Safari/537.36"

)

page = context.new_page()

page.goto("https://jup.ag/tokens", wait_until="networkidle")

# Wait for the token list items to render in the DOM

# Note: Selectors must be updated based on the current UI build

page.wait_for_selector(".token-item")

tokens = page.query_selector_all(".token-item")

for token in tokens[:10]:

name = token.query_selector(".token-name").inner_text()

price = token.query_selector(".token-price").inner_text()

print(f"{name}: {price}")

browser.close()

scrape_jupiter_tokens()Python + Scrapy

import scrapy

import json

class JupiterTokenSpider(scrapy.Spider):

name = 'jupiter_tokens'

# Directly hitting the token list JSON endpoint used by the frontend

start_urls = ['https://token.jup.ag/all']

def parse(self, response):

# The response is a raw JSON list of all verified tokens

tokens = json.loads(response.text)

for token in tokens[:100]:

yield {

'symbol': token.get('symbol'),

'name': token.get('name'),

'address': token.get('address'),

'decimals': token.get('decimals'),

'logoURI': token.get('logoURI')

}Node.js + Puppeteer

const puppeteer = require('puppeteer');

(async () => {

const browser = await puppeteer.launch({ headless: true });

const page = await browser.newPage();

// Set a realistic User-Agent to help bypass basic filters

await page.setUserAgent('Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/120.0.0.0 Safari/537.36');

// Navigate to the main swap page

await page.goto('https://jup.ag/', { waitUntil: 'networkidle2' });

// Example of extracting a price element using a partial selector

const solPrice = await page.evaluate(() => {

const element = document.querySelector('div[class*="price"]');

return element ? element.innerText : 'Price not found';

});

console.log(`Live SOL Price observed in UI: ${solPrice}`);

await browser.close();

})();Mit Tehet a(z) Jupiter Adataival

Fedezze fel a(z) Jupiter adataiból származó gyakorlati alkalmazásokat és betekintéseket.

Árarbitrázs riasztási rendszer

Azonosítsa az áreltéréseket a Jupiter és más Solana DEX-ek között nyereséges kereskedések végrehajtásához.

Hogyan implementáljuk:

- 1Valós idejű swap árfolyamok kinyerése a Jupiter Price API-ból.

- 2Az árfolyamok összehasonlítása az Orca és Raydium likviditási poolokkal.

- 3Automatizált riasztások vagy végrehajtási hookok beállítása arbitrázslehetőségekhez.

Használja az Automatio-t adatok kinyeréséhez a Jupiter-ből és építse meg ezeket az alkalmazásokat kódírás nélkül.

Mit Tehet a(z) Jupiter Adataival

- Árarbitrázs riasztási rendszer

Azonosítsa az áreltéréseket a Jupiter és más Solana DEX-ek között nyereséges kereskedések végrehajtásához.

- Valós idejű swap árfolyamok kinyerése a Jupiter Price API-ból.

- Az árfolyamok összehasonlítása az Orca és Raydium likviditási poolokkal.

- Automatizált riasztások vagy végrehajtási hookok beállítása arbitrázslehetőségekhez.

- Solana piaci egészségügyi dashboard

Makroszintű kép alkotása a Solana DeFi aktivitásáról a befektetők számára.

- A vezető tokenek 24 órás volumenének és TVL adatainak aggregálása.

- Tokenek kategorizálása szektorok szerint (Meme, AI, RWA).

- A likviditási eltolódások vizualizációja a különböző eszközosztályok között az idő függvényében.

- Új token listázás sniper

A Jupiter hitelesített listáján megjelenő új tokenek azonnali észlelése és elemzése.

- A token lista endpoint rendszeres scrapingelése.

- Az új eredmények összevetése egy helyi adatbázissal az új hozzáadások kereséséhez.

- Kezdeti likviditás és volumen elemzése a token potenciáljának felméréséhez.

- Bálna és Perps Tracker

Nagy pozíciók és funding ráták figyelése a Jupiter Perpetuals piacon.

- Open interest és funding rate adatok kinyerése a Perps szekcióból.

- Nagy tranzakciós naplók követése a wallet viselkedés azonosításához.

- Hangulatmodellek építése a főbb eszközök long/short arányai alapján.

- Hozam-aggregációs szolgáltatás

A felhasználók számára a legjobb elérhető hitelezési kamatlábak biztosítása a Jupiter Lend vaultokon keresztül.

- APY adatok kinyerése különböző stablecoin és SOL párokhoz.

- Nettó hozam számítása a becsült platformdíjak levonása után.

- Újrabalanszírozási javaslatok automatizálása a portfólió optimalizálásához.

Turbozd fel a munkafolyamatodat AI automatizalasal

Az Automatio egyesiti az AI ugynokk, a web automatizalas es az okos integraciok erejet, hogy segitsen tobbet elerni kevesebb ido alatt.

Profi Tippek a(z) Jupiter Scrapeléséhez

Szakértői tanácsok a(z) Jupiter-ból történő sikeres adatkinyeréshez.

Mindig az api.jup.ag címen elérhető hivatalos API-t részesítse előnyben, mielőtt megpróbálná a HTML frontend scrapinget.

Használjon residential proxykat a Cloudflare blokkolások minimalizálása érdekében, mivel az adatközponti IP címek gyakran tiltólistán vannak.

Engedélyezze a HTTP2 használatát a scraperben, hogy illeszkedjen a standard böngésző ujjlenyomatokhoz és elkerülje a detektálást.

Vizsgálja meg a WebSocket kapcsolatokat (wss

//) a hálózati (network) fülön a leghatékonyabb valós idejű price streaming érdekében.

Implementáljon robusztus hibakezelést a 403 Forbidden válaszokra, amelyek a Cloudflare blokkolását jelzik.

Célozza meg a https

//token.jup.ag/all endpointot, ha csak a hitelesített token címek statikus listájára van szüksége.

Velemenyek

Mit mondanak a felhasznaloink

Csatlakozz tobb ezer elegedett felhasznalohoz, akik atalakitottak a munkafolyamatukat

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Kapcsolodo Web Scraping

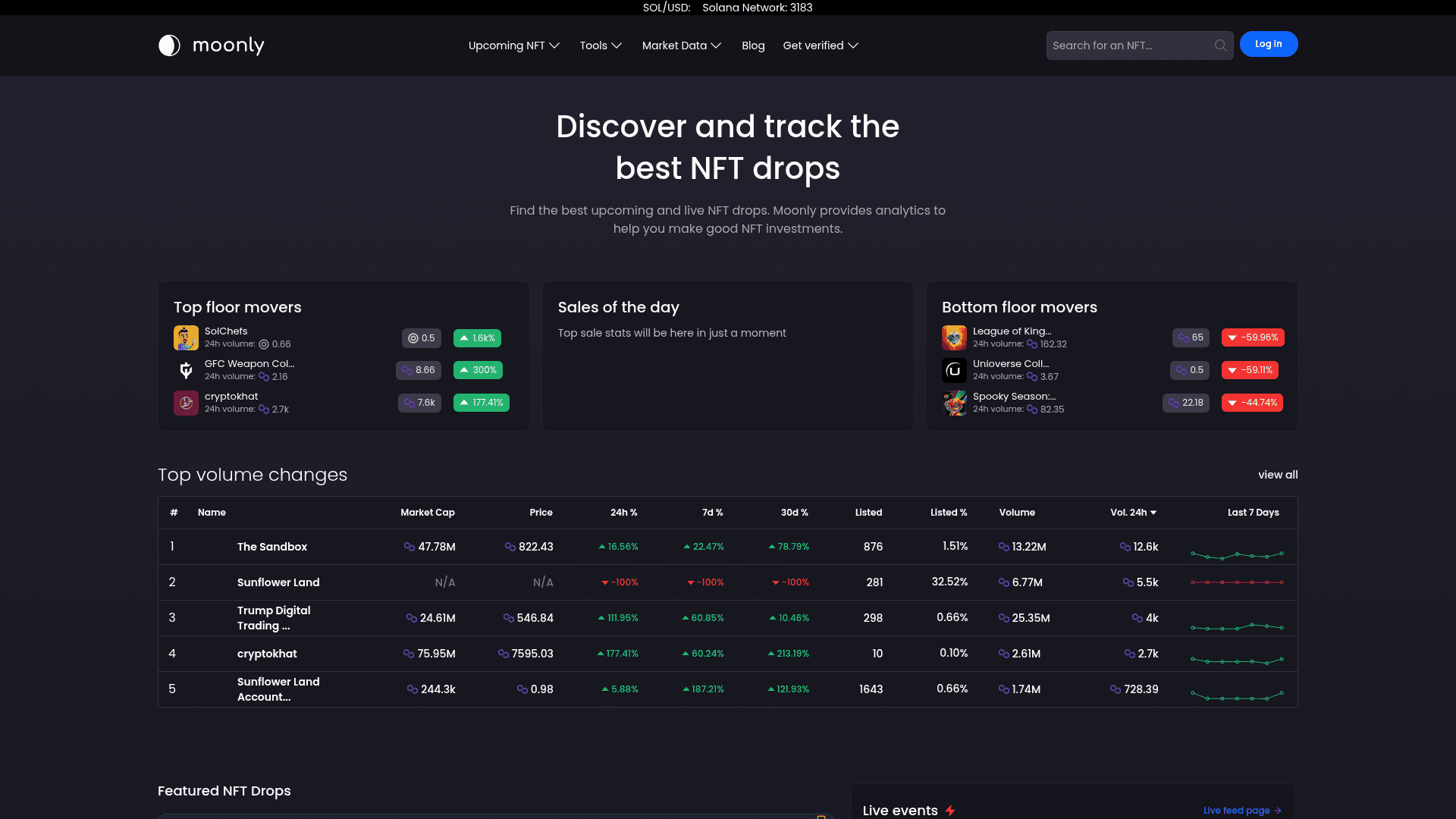

How to Scrape Moon.ly | Step-by-Step NFT Data Extraction Guide

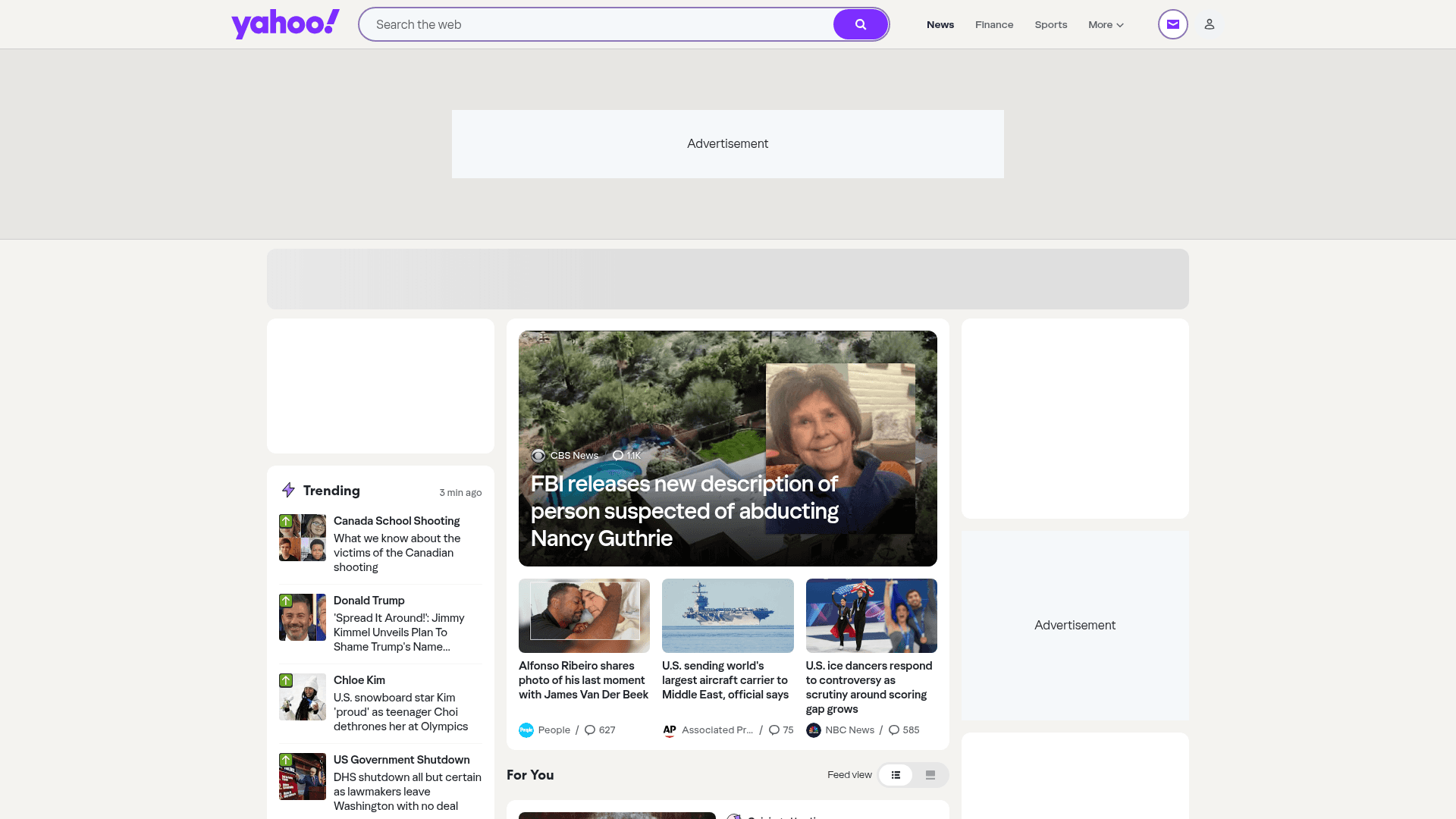

How to Scrape Yahoo Finance: Extract Stock Market Data

How to Scrape Rocket Mortgage: A Comprehensive Guide

How to Scrape Open Collective: Financial and Contributor Data Guide

How to Scrape Indiegogo: The Ultimate Crowdfunding Data Extraction Guide

How to Scrape ICO Drops: Comprehensive Crypto Data Guide

How to Scrape Crypto.com: Comprehensive Market Data Guide

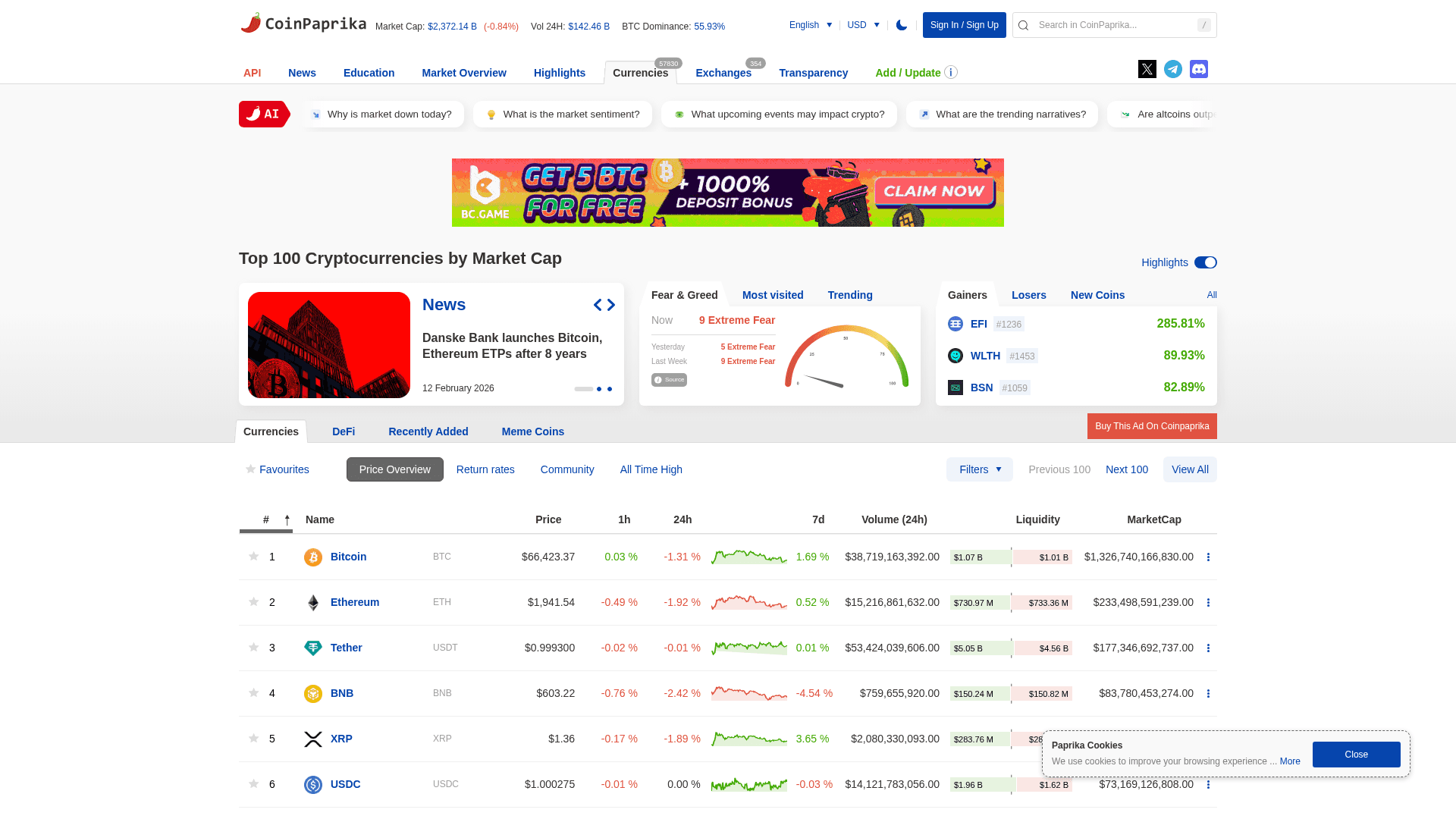

How to Scrape Coinpaprika: Crypto Market Data Extraction Guide

Gyakran ismetelt kerdesek a Jupiter-rol

Talalj valaszokat a Jupiter-val kapcsolatos gyakori kerdesekre