Hogyan gyűjtsünk adatokat a LivePiazza-ról: Philadelphiai ingatlan scraper

Ismerje meg, hogyan gyűjthet adatokat a LivePiazza.com oldalról luxuslakás-árak, elérhetőség és alaprajzok kinyeréséhez. Figyelje a philadelphiai...

Anti-bot védelem észlelve

- Cloudflare

- Vállalati szintű WAF és botkezelés. JavaScript kihívásokat, CAPTCHA-kat és viselkedéselemzést használ. Böngészőautomatizálás szükséges rejtett beállításokkal.

- Sebességkorlátozás

- IP/munkamenet alapú kéréseket korlátoz időben. Forgó proxykkal, kéréskésleltetéssel és elosztott scrapinggel megkerülhető.

- Böngésző ujjlenyomat

- Botokat azonosít a böngésző jellemzői alapján: canvas, WebGL, betűtípusok, bővítmények. Hamisítás vagy valódi böngészőprofilok szükségesek.

- JavaScript kihívás

- JavaScript végrehajtást igényel a tartalom eléréséhez. Egyszerű kérések sikertelenek; headless böngésző szükséges, mint a Playwright vagy Puppeteer.

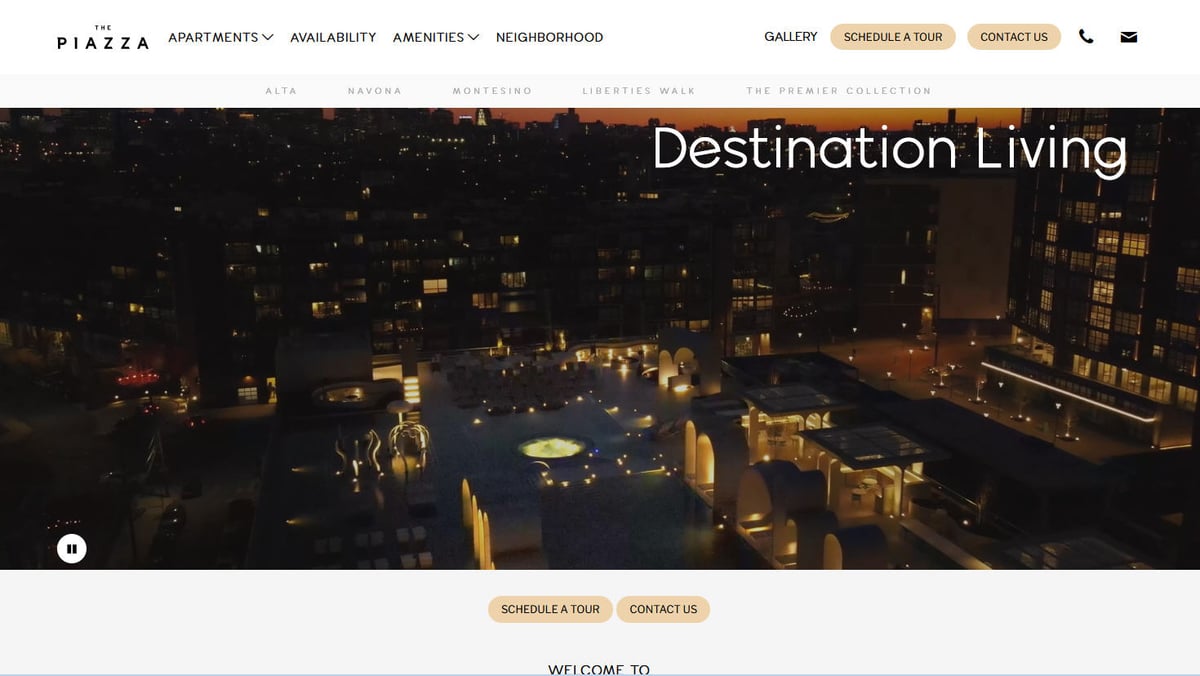

A(z) The Piazza Névjegye

Fedezze fel, mit kínál a(z) The Piazza és milyen értékes adatok nyerhetők ki.

A Post Brothers által kezelt The Piazza egy meghatározó lakó- és kiskereskedelmi fejlesztés Philadelphia Northern Liberties negyedében. Négy különálló luxusközösséget foglal magában – Alta, Navona, Montesino és Liberties Walk –, amelyek 'város a városban' élményt kínálnak csúcskategóriás kényelmi szolgáltatásokkal és modern dizájnnal.

Az weboldal valós idejű portálként szolgál a leendő lakók számára, megjelenítve az aktuális bérleti díjakat, a konkrét egységek elérhetőségi dátumait és a részletes belső kialakítási lehetőségeket. Az adattudósok és ingatlanpiaci elemzők számára a LivePiazza kritikus adatforrás az északkeleti régió egyik leggyorsabban növekvő városi folyosójának luxus többlakásos piacának megértéséhez.

Ezen adatok kinyerése lehetővé teszi az árazási trendek, a telítettségi szintek és a nagy ingatlanfejlesztők által kínált különféle bérleti ösztönzők hatékonyságának nagy gyakoriságú nyomon követését.

Miért Kell Scrapelni a(z) The Piazza-t?

Fedezze fel a(z) The Piazza-ból történő adatkinyerés üzleti értékét és felhasználási eseteit.

A philadelphiai luxuspiac valós idejű bérleti díj ingadozásainak nyomon követése.

A telítettségi arányok és a lakásfluktuáció figyelése a különböző lakóközösségekben.

A bérleti engedmények, például a '2 hónap ingyen', nettó effektív bérleti díjra gyakorolt hatásának elemzése.

Nagy felbontású alaprajz adatok gyűjtése építészeti és belsőépítészeti kutatásokhoz.

Lead generálás automatizálása helyi szolgáltatók, például költöztető cégek és bútorboltok számára.

Versenyképes benchmarking végzése a régió más luxusfejlesztéseivel szemben.

Scraping Kihívások

Technikai kihívások, amelyekkel a(z) The Piazza scrapelésekor találkozhat.

A Cloudflare 'Waiting Room' és 'Just a moment' ellenőrző képernyői blokkolják az egyszerű bot kéréseket.

Erős függőség a kliensoldali JavaScript rendereléstől az egységek elérhetőségi táblázatainál.

A belső API végpontok dinamikus token-eket használnak, amelyek gyorsan lejárnak.

Gyakori DOM-struktúra frissítések, amelyek megtörhetik a statikus CSS szelektorokat.

Scrapeld a The Piazza-t AI-val

Nincs szükség kódolásra. Nyerj ki adatokat percek alatt AI-vezérelt automatizálással.

Hogyan működik

Írd le, mire van szükséged

Mondd el az AI-nak, milyen adatokat szeretnél kinyerni a The Piazza-ról. Csak írd be természetes nyelven — nincs szükség kódra vagy szelektorokra.

Az AI kinyeri az adatokat

Mesterséges intelligenciánk navigál a The Piazza-on, kezeli a dinamikus tartalmat, és pontosan azt nyeri ki, amit kértél.

Kapd meg az adataidat

Kapj tiszta, strukturált adatokat, amelyek készen állnak CSV, JSON exportra vagy közvetlenül az alkalmazásaidba küldésre.

Miért érdemes AI-t használni a scrapeléshez

Az AI megkönnyíti a The Piazza scrapelését kódírás nélkül. Mesterséges intelligenciával működő platformunk megérti, milyen adatokra van szükséged — csak írd le természetes nyelven, és az AI automatikusan kinyeri őket.

How to scrape with AI:

- Írd le, mire van szükséged: Mondd el az AI-nak, milyen adatokat szeretnél kinyerni a The Piazza-ról. Csak írd be természetes nyelven — nincs szükség kódra vagy szelektorokra.

- Az AI kinyeri az adatokat: Mesterséges intelligenciánk navigál a The Piazza-on, kezeli a dinamikus tartalmat, és pontosan azt nyeri ki, amit kértél.

- Kapd meg az adataidat: Kapj tiszta, strukturált adatokat, amelyek készen állnak CSV, JSON exportra vagy közvetlenül az alkalmazásaidba küldésre.

Why use AI for scraping:

- Automatikusan megoldja a Cloudflare kihívásokat manuális proxy konfiguráció nélkül.

- Pontosan úgy rendereli a dinamikus JavaScript tartalmat, mint egy valódi böngésző.

- Lehetővé teszi az adatpontok vizuális kijelölését összetett alaprajzi térképeken.

- Támogatja az ütemezett futtatásokat a napi árváltozások és történelmi trendek rögzítéséhez.

- Az adatokat közvetlenül a Google Sheets-be vagy Webhook-on keresztül exportálja az azonnali elemzéshez.

No-Code Web Scraperek a The Piazza számára

Kattints-és-válassz alternatívák az AI-alapú scrapeléshez

Számos no-code eszköz, mint a Browse.ai, Octoparse, Axiom és ParseHub segíthet a The Piazza scrapelésében kódírás nélkül. Ezek az eszközök általában vizuális felületeket használnak az adatok kiválasztásához, bár nehézségeik lehetnek összetett dinamikus tartalmakkal vagy anti-bot intézkedésekkel.

Tipikus Munkafolyamat No-Code Eszközökkel

Gyakori Kihívások

Tanulási görbe

A szelektorok és a kinyerési logika megértése időt igényel

Szelektorok elromlanak

A weboldal változásai tönkretehetik a teljes munkafolyamatot

Dinamikus tartalom problémák

JavaScript-gazdag oldalak komplex megoldásokat igényelnek

CAPTCHA korlátozások

A legtöbb eszköz manuális beavatkozást igényel CAPTCHA esetén

IP blokkolás

Az agresszív scraping az IP blokkolásához vezethet

No-Code Web Scraperek a The Piazza számára

Számos no-code eszköz, mint a Browse.ai, Octoparse, Axiom és ParseHub segíthet a The Piazza scrapelésében kódírás nélkül. Ezek az eszközök általában vizuális felületeket használnak az adatok kiválasztásához, bár nehézségeik lehetnek összetett dinamikus tartalmakkal vagy anti-bot intézkedésekkel.

Tipikus Munkafolyamat No-Code Eszközökkel

- Böngésző bővítmény telepítése vagy regisztráció a platformon

- Navigálás a célweboldalra és az eszköz megnyitása

- Adatelemek kiválasztása kattintással

- CSS szelektorok konfigurálása minden adatmezőhöz

- Lapozási szabályok beállítása több oldal scrapeléséhez

- CAPTCHA kezelése (gyakran manuális megoldás szükséges)

- Ütemezés konfigurálása automatikus futtatásokhoz

- Adatok exportálása CSV, JSON formátumba vagy API-n keresztüli csatlakozás

Gyakori Kihívások

- Tanulási görbe: A szelektorok és a kinyerési logika megértése időt igényel

- Szelektorok elromlanak: A weboldal változásai tönkretehetik a teljes munkafolyamatot

- Dinamikus tartalom problémák: JavaScript-gazdag oldalak komplex megoldásokat igényelnek

- CAPTCHA korlátozások: A legtöbb eszköz manuális beavatkozást igényel CAPTCHA esetén

- IP blokkolás: Az agresszív scraping az IP blokkolásához vezethet

Kod peldak

import requests

from bs4 import BeautifulSoup

# Note: This direct request will likely fail due to Cloudflare

# A proxy or bypass solution like cloudscraper is recommended

url = 'https://www.livepiazza.com/residences'

headers = {

'User-Agent': 'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/121.0.0.0 Safari/537.36',

'Accept-Language': 'en-US,en;q=0.9'

}

def fetch_piazza():

try:

response = requests.get(url, headers=headers, timeout=10)

if response.status_code == 200:

soup = BeautifulSoup(response.text, 'html.parser')

# Example selector for residence cards

for card in soup.select('.residence-card'):

name = card.select_one('.residence-name').text.strip()

price = card.select_one('.price-value').text.strip()

print(f'Community: {name} | Price: {price}')

else:

print(f'Blocked by Anti-Bot: Status {response.status_code}')

except Exception as e:

print(f'Error: {e}')

fetch_piazza()Mikor Használjuk

A legjobb statikus HTML oldalakhoz, ahol a tartalom szerver oldalon töltődik. A leggyorsabb és legegyszerűbb megközelítés, amikor JavaScript renderelés nem szükséges.

Előnyök

- ●Leggyorsabb végrehajtás (nincs böngésző overhead)

- ●Legalacsonyabb erőforrás-fogyasztás

- ●Könnyen párhuzamosítható asyncio-val

- ●Kiváló API-khoz és statikus oldalakhoz

Korlátok

- ●Nem tudja végrehajtani a JavaScriptet

- ●Nem működik SPA-knál és dinamikus tartalmaknál

- ●Problémái lehetnek összetett anti-bot rendszerekkel

How to Scrape The Piazza with Code

Python + Requests

import requests

from bs4 import BeautifulSoup

# Note: This direct request will likely fail due to Cloudflare

# A proxy or bypass solution like cloudscraper is recommended

url = 'https://www.livepiazza.com/residences'

headers = {

'User-Agent': 'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/121.0.0.0 Safari/537.36',

'Accept-Language': 'en-US,en;q=0.9'

}

def fetch_piazza():

try:

response = requests.get(url, headers=headers, timeout=10)

if response.status_code == 200:

soup = BeautifulSoup(response.text, 'html.parser')

# Example selector for residence cards

for card in soup.select('.residence-card'):

name = card.select_one('.residence-name').text.strip()

price = card.select_one('.price-value').text.strip()

print(f'Community: {name} | Price: {price}')

else:

print(f'Blocked by Anti-Bot: Status {response.status_code}')

except Exception as e:

print(f'Error: {e}')

fetch_piazza()Python + Playwright

import asyncio

from playwright.async_api import async_playwright

async def scrape_live_piazza():

async with async_playwright() as p:

# Launching with a specific user agent to mimic a real browser

browser = await p.chromium.launch(headless=True)

context = await browser.new_context(user_agent='Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36')

page = await context.new_page()

await page.goto('https://www.livepiazza.com/alta/')

# Wait for the dynamic unit table to load

await page.wait_for_selector('.unit-row', timeout=15000)

units = await page.query_selector_all('.unit-row')

for unit in units:

unit_id = await (await unit.query_selector('.unit-id')).inner_text()

rent = await (await unit.query_selector('.unit-rent')).inner_text()

print(f'Unit: {unit_id.strip()} | Rent: {rent.strip()}')

await browser.close()

asyncio.run(scrape_live_piazza())Python + Scrapy

import scrapy

class PiazzaSpider(scrapy.Spider):

name = 'piazza_spider'

start_urls = ['https://www.livepiazza.com/communities']

def parse(self, response):

# Scrapy requires a JS-rendering middleware (like Scrapy-Playwright) for this site

for building in response.css('.building-section'):

yield {

'building_name': building.css('h3.name::text').get(),

'link': building.css('a.explore-btn::attr(href)').get(),

'starting_price': building.css('.starting-from::text').get()

}

# Example of pagination following

next_page = response.css('a.next-page::attr(href)').get()

if next_page:

yield response.follow(next_page, self.parse)Node.js + Puppeteer

const puppeteer = require('puppeteer-extra');

const StealthPlugin = require('puppeteer-extra-plugin-stealth');

puppeteer.use(StealthPlugin());

(async () => {

const browser = await puppeteer.launch({ headless: true });

const page = await browser.newPage();

await page.goto('https://www.livepiazza.com/montesino', { waitUntil: 'networkidle2' });

// Wait for the residences container to render

await page.waitForSelector('.residences-container');

const apartmentData = await page.evaluate(() => {

const rows = Array.from(document.querySelectorAll('.apartment-listing'));

return rows.map(row => ({

type: row.querySelector('.plan-type').innerText,

sqft: row.querySelector('.sqft').innerText,

available: row.querySelector('.availability').innerText

}));

});

console.log(apartmentData);

await browser.close();

})();Mit Tehet a(z) The Piazza Adataival

Fedezze fel a(z) The Piazza adataiból származó gyakorlati alkalmazásokat és betekintéseket.

Valós idejű bérleti díj index

Élő műszerfal készítése, amely nyomon követi a Northern Liberties luxuslakásainak átlagos négyzetméterárát.

Hogyan implementáljuk:

- 1Napi árak kinyerése az összes stúdió, 1 és 2 hálószobás lakáshoz.

- 2Az árak normalizálása négyzetméter alapján a PPSF mérőszám létrehozásához.

- 3A trendvonal vizualizálása 90 napos időszakra vonatkozóan.

Használja az Automatio-t adatok kinyeréséhez a The Piazza-ből és építse meg ezeket az alkalmazásokat kódírás nélkül.

Mit Tehet a(z) The Piazza Adataival

- Valós idejű bérleti díj index

Élő műszerfal készítése, amely nyomon követi a Northern Liberties luxuslakásainak átlagos négyzetméterárát.

- Napi árak kinyerése az összes stúdió, 1 és 2 hálószobás lakáshoz.

- Az árak normalizálása négyzetméter alapján a PPSF mérőszám létrehozásához.

- A trendvonal vizualizálása 90 napos időszakra vonatkozóan.

- Engedményezési stratégia elemzése

Annak elemzése, hogyan használják az ingatlankezelők az 'ingyen lakbér' ösztönzőket az üres lakások feltöltésére az egyes épületekben.

- A 'Promotions' (Promóciók) mező kinyerése minden listázott egységhez.

- A promóciók összevetése azzal, hogy egy egység hány napja van listázva.

- Annak a 'fordulópontnak' a meghatározása, ahol a fejlesztők növelik az ösztönzőket.

- Befektetési megvalósíthatósági tanulmányok

Az adatok felhasználása az új luxusfejlesztések indokoltságának alátámasztására vagy elutasítására a közvetlen környéken, a jelenlegi kínálat és kereslet alapján.

- Az elérhető egységek összesítése az Alta, Navona és Montesino épületekben.

- Az elérhetőség szegmentálása 'beköltözési dátum' szerint a kínálat felszívódásának előrejelzéséhez.

- A Piazza árainak összehasonlítása a városi luxus átlagokkal.

- Lead generálás költöztetőknek

Nagy volumenű beköltözési időszakok azonosítása a helyi költöztető és takarító szolgáltatások marketingjének célzásához.

- A kinyert hirdetések szűrése az 'Azonnal költözhető' vagy konkrét jövőbeli dátumokra.

- A legnagyobb várható elérhetőséggel rendelkező épületek célzása.

- A hirdetési költések összehangolása a legmagasabb becsült fluktuációs időszakokkal.

Turbozd fel a munkafolyamatodat AI automatizalasal

Az Automatio egyesiti az AI ugynokk, a web automatizalas es az okos integraciok erejet, hogy segitsen tobbet elerni kevesebb ido alatt.

Profi Tippek a(z) The Piazza Scrapeléséhez

Szakértői tanácsok a(z) The Piazza-ból történő sikeres adatkinyeréshez.

Használjon philadelphiai rezidenciális proxy-kat, hogy csökkentse a Cloudflare biztonsági szűrői által keltett gyanút.

Az adatgyűjtést (scraping) a kora reggeli órákra (ET) időzítse, amikor az ingatlankezelő frissíti az egységek elérhetőségét.

Ellenőrizze a böngésző 'Network' fülét az egységek táblázataihoz JSON adatokat visszaadó XHR/Fetch kérések azonosításához.

Gyakran rotálja a User-Agent-eket az ujjlenyomat-alapú (fingerprint) rate limiting elkerülése érdekében.

Számítsa ki a 'Nettó effektív bérleti díjat' a promóciós ajánlatok szövegének elemzésével (pl. '1 hónap ingyen 13 hónapos bérlet esetén').

Alkalmazzon 'wait for' logikát a scraper-ben, hogy az interaktív alaprajzok teljesen betöltődjenek a kinyerés előtt.

Velemenyek

Mit mondanak a felhasznaloink

Csatlakozz tobb ezer elegedett felhasznalohoz, akik atalakitottak a munkafolyamatukat

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Kapcsolodo Web Scraping

How to Scrape Century 21 Property Listings

How to Scrape Homes.com: Real Estate Data Extraction Guide

How to Scrape Century 21: A Technical Real Estate Guide

How to Scrape HotPads: A Complete Guide to Extracting Rental Data

How to Scrape Sacramento Delta Property Management

How to Scrape Locations Hawaii | Locations Hawaii Web Scraper

How to Scrape RE/MAX (remax.com) Real Estate Listings

How to Scrape Apartments Near Me | Real Estate Data Scraper

Gyakran ismetelt kerdesek a The Piazza-rol

Talalj valaszokat a The Piazza-val kapcsolatos gyakori kerdesekre