Come eseguire lo scraping di whatsmydns.net: Guida completa ai dati DNS

Scopri come estrarre i dati sulla propagazione DNS globale da whatsmydns.net. Estrai record A, MX, CNAME e TXT in tempo reale dai server di tutto il mondo in...

Protezione Anti-Bot Rilevata

- Cloudflare

- WAF e gestione bot di livello enterprise. Usa sfide JavaScript, CAPTCHA e analisi comportamentale. Richiede automazione del browser con impostazioni stealth.

- Rate Limiting

- Limita le richieste per IP/sessione nel tempo. Può essere aggirato con proxy rotanti, ritardi nelle richieste e scraping distribuito.

- Sfida JavaScript

- Richiede l'esecuzione di JavaScript per accedere al contenuto. Le richieste semplici falliscono; serve un browser headless come Playwright o Puppeteer.

- User-Agent Filtering

- Turnstile

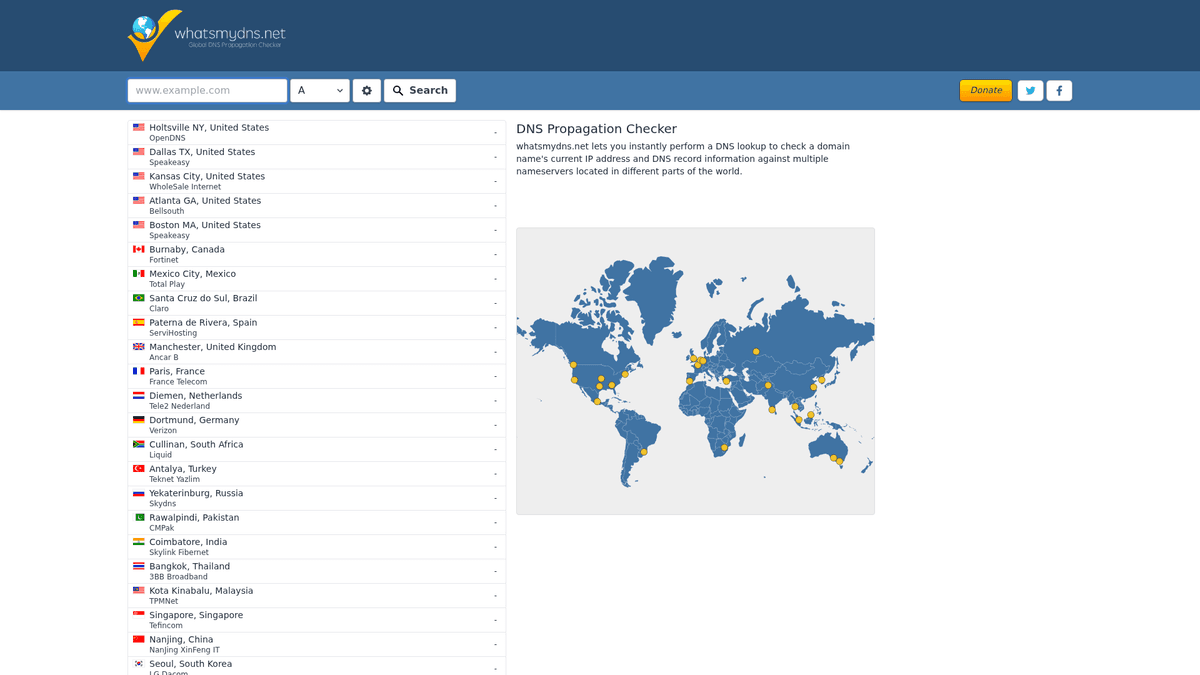

Informazioni Su whatsmydns.net

Scopri cosa offre whatsmydns.net e quali dati preziosi possono essere estratti.

Infrastruttura di propagazione DNS globale

whatsmydns.net è un'utilità online leader progettata per amministratori di sistema e sviluppatori per tracciare la propagazione DNS in tutto il mondo. Interrogando dozzine di server DNS situati in varie regioni geografiche, fornisce una visione completa di come un dominio viene risolto per gli utenti in diversi paesi. Questa visibilità è essenziale per garantire che le modifiche DNS, come le migrazioni IP o gli aggiornamenti del server di posta, siano state applicate correttamente a livello globale.

Monitoraggio completo dei record DNS

La piattaforma supporta una vasta gamma di tipi di record DNS, tra cui A, AAAA, CNAME, MX, NS, PTR, SOA e TXT. Per ogni query, il sito restituisce un elenco dettagliato delle posizioni dei server, i valori risolti e lo stato della propagazione. Questi dati sono fondamentali per la risoluzione di problemi tecnici che appaiono solo in regioni specifiche a causa del caching degli ISP o di resolver locali configurati in modo errato.

Valore strategico dei dati

Lo scraping di questi dati consente alle organizzazioni di automatizzare gli audit tecnici e monitorare lo stato dell'infrastruttura. Invece di controllare manualmente la propagazione, le aziende possono creare sistemi automatizzati che verificano l'accuratezza dei record ogni pochi minuti. Ciò è particolarmente prezioso durante eventi critici come migrazioni di siti web o aggiornamenti di sicurezza, dove qualsiasi ritardo negli aggiornamenti DNS può portare a tempi di inattività o interruzioni del servizio per una parte degli utenti globali.

Perché Fare Scraping di whatsmydns.net?

Scopri il valore commerciale e i casi d'uso per l'estrazione dati da whatsmydns.net.

Monitoraggio dell'infrastruttura globale

Monitora continuamente lo stato di salute del tuo dominio su server internazionali per garantire un'accessibilità costante e identificare istantaneamente le interruzioni DNS regionali. Questo approccio proattivo aiuta i team tecnici a risolvere i problemi di connettività locale prima che abbiano un impatto su una base di utenti più ampia.

Verifica automatizzata della migrazione

Traccia la propagazione di nuovi indirizzi IP o nameserver durante il trasferimento di un server, assicurandoti che tutti i nodi globali si aggiornino correttamente prima di dismettere le vecchie risorse. Fornisce una conferma basata sui dati che il passaggio è avvenuto con successo in tutto il mondo.

Audit della sicurezza del brand

Monitora record critici come SPF, DKIM e DMARC per prevenire lo spoofing delle email e rilevare modifiche non autorizzate che potrebbero compromettere la reputazione del tuo brand. Lo scraping regolare aiuta a identificare tentativi di DNS hijacking in specifiche zone geografiche.

Competitive Intelligence

Analizza le scelte di hosting, CDN e infrastruttura email dei concorrenti estraendo i loro record MX e CNAME in varie regioni geografiche. Ciò consente ai ricercatori di mercato di mappare gli stack tecnologici utilizzati dai leader del settore.

Ottimizzazione della strategia CDN

Verifica che la tua Content Delivery Network stia instradando il traffico verso le corrette edge location a livello globale, consentendo regolazioni basate sui dati alla tua strategia di caching. Questo assicura che gli utenti ricevano sempre i contenuti dal server più veloce possibile.

Risoluzione della latency regionale

Identifica resolver specifici o zone geografiche in cui la risoluzione DNS fallisce o restituisce record obsoleti, aiutando a diagnosticare complessi problemi di prestazioni di rete. È uno strumento essenziale per il debug di errori che appaiono solo in determinati paesi.

Sfide dello Scraping

Sfide tecniche che potresti incontrare durante lo scraping di whatsmydns.net.

Protezione Cloudflare avanzata

Il sito utilizza il livello di sicurezza di Cloudflare, inclusi Turnstile e il fingerprinting del browser, il che richiede un'automazione sofisticata per essere superato senza essere segnalati. Semplici richieste HTTP verranno quasi sempre bloccate dal muro di sfida.

Caricamento asincrono dei risultati

I punti dati non sono disponibili nell'HTML sorgente e vengono caricati in tempi diversi tramite chiamate AJAX in background, rendendo gli scraper statici completamente inefficaci. Lo scraper deve attendere che ogni nodo globale riporti il suo stato prima di estrarre i valori.

Rate Limiting aggressivo

Query rapide e automatizzate da un singolo indirizzo IP attivano rapidamente ban temporanei o CAPTCHA, rendendo necessaria la rotazione di proxy di alta qualità. Ciò richiede un'attenta gestione degli header delle richieste e del tempismo per imitare il comportamento umano.

Volatilità dei dati in tempo reale

La propagazione DNS è un processo fluido in cui i risultati possono cambiare in pochi secondi, richiedendo un'estrazione rapida e l'apposizione di timestamp per un'analisi accurata. Tenere traccia di questi cambiamenti nel tempo richiede una solida architettura del database.

Logica dei selettori complessa

La tabella dei risultati utilizza icone di stato specifiche, come spunte verdi o croci rosse, che devono essere analizzate correttamente insieme ai valori testuali per determinare il successo della risoluzione. Ciò richiede un targeting CSS o XPath preciso per interpretare correttamente lo stato visivo.

Scraping di whatsmydns.net con l'IA

Nessun codice richiesto. Estrai dati in minuti con l'automazione basata sull'IA.

Come Funziona

Descrivi ciò di cui hai bisogno

Di' all'IA quali dati vuoi estrarre da whatsmydns.net. Scrivi semplicemente in linguaggio naturale — nessun codice o selettore necessario.

L'IA estrae i dati

La nostra intelligenza artificiale naviga whatsmydns.net, gestisce contenuti dinamici ed estrae esattamente ciò che hai richiesto.

Ottieni i tuoi dati

Ricevi dati puliti e strutturati pronti per l'esportazione in CSV, JSON o da inviare direttamente alle tue applicazioni.

Perché Usare l'IA per lo Scraping

L'IA rende facile lo scraping di whatsmydns.net senza scrivere codice. La nostra piattaforma basata sull'intelligenza artificiale capisce quali dati vuoi — descrivili in linguaggio naturale e l'IA li estrae automaticamente.

How to scrape with AI:

- Descrivi ciò di cui hai bisogno: Di' all'IA quali dati vuoi estrarre da whatsmydns.net. Scrivi semplicemente in linguaggio naturale — nessun codice o selettore necessario.

- L'IA estrae i dati: La nostra intelligenza artificiale naviga whatsmydns.net, gestisce contenuti dinamici ed estrae esattamente ciò che hai richiesto.

- Ottieni i tuoi dati: Ricevi dati puliti e strutturati pronti per l'esportazione in CSV, JSON o da inviare direttamente alle tue applicazioni.

Why use AI for scraping:

- Stealth Engine integrato: Automatio gestisce nativamente le sfide di Cloudflare e il fingerprinting del browser, consentendoti di concentrarti sull'estrazione dei dati piuttosto che sugli aspetti tecnici del superamento dei bot. Questo riduce significativamente il sovraccarico tecnico necessario per iniziare lo scraping.

- Interazione AJAX visiva: L'editor visuale no-code ti consente di impostare facilmente azioni 'Wait for Element' per garantire che ogni risultato del server globale sia completamente caricato prima che inizi lo scraping. Questo garantisce un'accuratezza dei dati al 100% anche quando alcuni server rispondono più lentamente di altri.

- Integrazione globale dei proxy: Ruota facilmente tra proxy residenziali o datacenter per evitare rate limits e simulare ricerche da vari indirizzi IP internazionali. Questo aiuta a mantenere un alto tasso di successo per gli audit di domini su larga scala.

- Pianificazione basata sugli eventi: Imposta trigger automatizzati per controllare la propagazione DNS ogni ora durante una finestra di migrazione, inviando i dati direttamente al tuo database o foglio di calcolo preferito. Ciò consente un monitoraggio automatico durante gli aggiornamenti critici dell'infrastruttura.

- Armonizzazione dei dati: Pulisci e formatta automaticamente vari tipi di record, come le priorità MX o le stringhe TXT, in un formato strutturato JSON o CSV pronto per l'analisi tecnica immediata. Ciò fa risparmiare ore di pulizia e riorganizzazione manuale dei dati.

Scraper Web No-Code per whatsmydns.net

Alternative point-and-click allo scraping alimentato da IA

Diversi strumenti no-code come Browse.ai, Octoparse, Axiom e ParseHub possono aiutarti a fare scraping di whatsmydns.net senza scrivere codice. Questi strumenti usano interfacce visive per selezionare i dati, anche se possono avere difficoltà con contenuti dinamici complessi o misure anti-bot.

Workflow Tipico con Strumenti No-Code

Sfide Comuni

Curva di apprendimento

Comprendere selettori e logica di estrazione richiede tempo

I selettori si rompono

Le modifiche al sito web possono rompere l'intero flusso di lavoro

Problemi con contenuti dinamici

I siti con molto JavaScript richiedono soluzioni complesse

Limitazioni CAPTCHA

La maggior parte degli strumenti richiede intervento manuale per i CAPTCHA

Blocco IP

Lo scraping aggressivo può portare al blocco del tuo IP

Scraper Web No-Code per whatsmydns.net

Diversi strumenti no-code come Browse.ai, Octoparse, Axiom e ParseHub possono aiutarti a fare scraping di whatsmydns.net senza scrivere codice. Questi strumenti usano interfacce visive per selezionare i dati, anche se possono avere difficoltà con contenuti dinamici complessi o misure anti-bot.

Workflow Tipico con Strumenti No-Code

- Installare l'estensione del browser o registrarsi sulla piattaforma

- Navigare verso il sito web target e aprire lo strumento

- Selezionare con point-and-click gli elementi dati da estrarre

- Configurare i selettori CSS per ogni campo dati

- Impostare le regole di paginazione per lo scraping di più pagine

- Gestire i CAPTCHA (spesso richiede risoluzione manuale)

- Configurare la pianificazione per le esecuzioni automatiche

- Esportare i dati in CSV, JSON o collegare tramite API

Sfide Comuni

- Curva di apprendimento: Comprendere selettori e logica di estrazione richiede tempo

- I selettori si rompono: Le modifiche al sito web possono rompere l'intero flusso di lavoro

- Problemi con contenuti dinamici: I siti con molto JavaScript richiedono soluzioni complesse

- Limitazioni CAPTCHA: La maggior parte degli strumenti richiede intervento manuale per i CAPTCHA

- Blocco IP: Lo scraping aggressivo può portare al blocco del tuo IP

Esempi di Codice

import requests

from bs4 import BeautifulSoup

# Nota: le richieste dirette potrebbero essere bloccate da Cloudflare

url = 'https://www.whatsmydns.net/'

headers = {

'User-Agent': 'Mozilla/5.0 (Windows NT 10.0; Win64; x64) Chrome/119.0.0.0 Safari/537.36',

'Accept': 'text/html,application/xhtml+xml,xml;q=0.9,image/avif,image/webp,*/*;q=0.8'

}

def check_dns_static():

try:

# Accesso alla homepage per ottenere sessione/cookie

session = requests.Session()

response = session.get(url, headers=headers)

if response.status_code == 200:

soup = BeautifulSoup(response.text, 'html.parser')

# Lo scraping statico è limitato poiché i risultati si caricano via JS

print('Pagina caricata correttamente. Rendering JS richiesto per i risultati.')

else:

print(f'Bloccato: HTTP {response.status_code}')

except Exception as e:

print(f'Errore: {e}')

check_dns_static()Quando Usare

Ideale per pagine HTML statiche con JavaScript minimo. Perfetto per blog, siti di notizie e pagine prodotto e-commerce semplici.

Vantaggi

- ●Esecuzione più veloce (senza overhead del browser)

- ●Consumo risorse minimo

- ●Facile da parallelizzare con asyncio

- ●Ottimo per API e pagine statiche

Limitazioni

- ●Non può eseguire JavaScript

- ●Fallisce su SPA e contenuti dinamici

- ●Può avere difficoltà con sistemi anti-bot complessi

Come Fare Scraping di whatsmydns.net con Codice

Python + Requests

import requests

from bs4 import BeautifulSoup

# Nota: le richieste dirette potrebbero essere bloccate da Cloudflare

url = 'https://www.whatsmydns.net/'

headers = {

'User-Agent': 'Mozilla/5.0 (Windows NT 10.0; Win64; x64) Chrome/119.0.0.0 Safari/537.36',

'Accept': 'text/html,application/xhtml+xml,xml;q=0.9,image/avif,image/webp,*/*;q=0.8'

}

def check_dns_static():

try:

# Accesso alla homepage per ottenere sessione/cookie

session = requests.Session()

response = session.get(url, headers=headers)

if response.status_code == 200:

soup = BeautifulSoup(response.text, 'html.parser')

# Lo scraping statico è limitato poiché i risultati si caricano via JS

print('Pagina caricata correttamente. Rendering JS richiesto per i risultati.')

else:

print(f'Bloccato: HTTP {response.status_code}')

except Exception as e:

print(f'Errore: {e}')

check_dns_static()Python + Playwright

from playwright.sync_api import sync_playwright

def scrape_whatsmydns():

with sync_playwright() as p:

browser = p.chromium.launch(headless=True)

page = browser.new_page()

# Usa l'URL basato su hash per attivare un lookup DNS specifico

page.goto('https://www.whatsmydns.net/#A/google.com')

# Attendi che la tabella dei risultati si popoli con i dati

page.wait_for_selector('.results-table tr', timeout=15000)

# Estrai i risultati

rows = page.query_selector_all('.results-table tr')

for row in rows:

location = row.query_selector('.location').inner_text()

result_val = row.query_selector('.value').inner_text()

print(f'[{location}] Risolto in: {result_val}')

browser.close()

scrape_whatsmydns()Python + Scrapy

import scrapy

from scrapy_playwright.page import PageMethod

class DNSPropagationSpider(scrapy.Spider):

name = 'dns_spider'

def start_requests(self):

# Scrapy-Playwright gestisce il rendering JS

yield scrapy.Request(

'https://www.whatsmydns.net/#A/example.com',

meta={

'playwright': True,

'playwright_page_methods': [

PageMethod('wait_for_selector', '.results-table tr')

]

}

)

def parse(self, response):

# Itera attraverso le righe della tabella estratte tramite Playwright

for row in response.css('.results-table tr'):

yield {

'location': row.css('.location::text').get(),

'result': row.css('.value::text').get()

}Node.js + Puppeteer

const puppeteer = require('puppeteer');

(async () => {

const browser = await puppeteer.launch();

const page = await browser.newPage();

// Naviga direttamente all'URL del controllo DNS

await page.goto('https://www.whatsmydns.net/#MX/microsoft.com', { waitUntil: 'networkidle2' });

// Attendi il caricamento delle righe dinamiche del server

await page.waitForSelector('.results-table tr');

const data = await page.evaluate(() => {

const rows = Array.from(document.querySelectorAll('.results-table tr'));

return rows.map(row => ({

location: row.querySelector('.location')?.innerText.trim(),

value: row.querySelector('.value')?.innerText.trim()

}));

});

console.log(data);

await browser.close();

})();Cosa Puoi Fare Con I Dati di whatsmydns.net

Esplora applicazioni pratiche e insight dai dati di whatsmydns.net.

Monitoraggio dell'uptime globale

Gli IT manager possono garantire che i loro servizi siano accessibili in tutto il mondo senza controlli manuali.

Come implementare:

- 1Pianifica uno scraping dei domini critici ogni 30 minuti

- 2Confronta gli indirizzi IP estratti con una lista master di IP autorizzati

- 3Attiva un avviso automatico tramite Webhook se viene rilevata una mancata corrispondenza in qualsiasi regione

Usa Automatio per estrarre dati da whatsmydns.net e costruire queste applicazioni senza scrivere codice.

Cosa Puoi Fare Con I Dati di whatsmydns.net

- Monitoraggio dell'uptime globale

Gli IT manager possono garantire che i loro servizi siano accessibili in tutto il mondo senza controlli manuali.

- Pianifica uno scraping dei domini critici ogni 30 minuti

- Confronta gli indirizzi IP estratti con una lista master di IP autorizzati

- Attiva un avviso automatico tramite Webhook se viene rilevata una mancata corrispondenza in qualsiasi regione

- Mappatura dell'utilizzo delle CDN

I ricercatori di marketing possono identificare quali reti di distribuzione dei contenuti utilizzano i concorrenti in base ai record CNAME.

- Esegui lo scraping dei record CNAME per un elenco dei primi 500 domini del settore

- Incrocia i domini di destinazione con i fornitori di CDN noti (es. Cloudflare, Akamai)

- Genera un report sulle tendenze delle quote di mercato per i fornitori di infrastrutture

- Verifica della migrazione senza tempi di inattività

I team DevOps possono confermare la completa propagazione prima di dismettere la vecchia infrastruttura.

- Esegui una modifica DNS e abbassa i valori TTL

- Esegui lo scraping di whatsmydns.net ogni 5 minuti durante la finestra di migrazione

- Dismetti il vecchio server solo quando il 100% dei nodi globali riporta il nuovo IP

- Rilevamento delle minacce alla sicurezza

Gli analisti della sicurezza possono rilevare il DNS poisoning o modifiche non autorizzate ai record MX.

- Monitora i record TXT e MX per i domini aziendali di alto valore

- Esegui lo scraping dello stato di propagazione per trovare regioni che ricevono dati 'obsoleti' o dannosi

- Identifica regioni geografiche specifiche in cui potrebbe verificarsi il dirottamento del DNS

- Analisi storica dei record DNS

I ricercatori possono creare un dataset di come i record DNS cambiano nel tempo per audit accademici o legali.

- Esegui il crawling dei record quotidianamente e memorizza i risultati in un database SQL

- Traccia i cambiamenti negli intervalli IP dei provider nel corso di mesi o anni

- Visualizza la velocità di propagazione per diversi provider DNS utilizzando metriche storiche sul tempo di completamento

Potenzia il tuo workflow con l'automazione AI

Automatio combina la potenza degli agenti AI, dell'automazione web e delle integrazioni intelligenti per aiutarti a fare di piu in meno tempo.

Consigli Pro per lo Scraping di whatsmydns.net

Consigli esperti per estrarre con successo i dati da whatsmydns.net.

Sfrutta gli URL hash parameters

Naviga direttamente verso specifici tipi di record e domini manipolando l'hash dell'URL, come l'uso di #MX/domain.com, per saltare la compilazione manuale dei moduli. Questo approccio velocizza significativamente il processo di scraping per i controlli di domini in batch.

Implementa tempi di attesa dinamici

Alcuni resolver globali impiegano più tempo di altri per rispondere; imposta un timeout flessibile di 10-15 secondi per acquisire risultati da regioni più lente come il Sud America o l'Asia. Timeout brevi porteranno a set di dati incompleti.

Estrai la classe di stato

Non limitarti a estrarre l'indirizzo IP; estrai anche la classe CSS dell'icona di stato per distinguere programmaticamente tra una risoluzione riuscita e un timeout. Questo è fondamentale per riportare accuratamente la percentuale di propagazione.

Ruota le stringhe User-Agent

Ruota frequentemente tra User-Agent moderni per desktop e mobile per imitare il comportamento umano reale e ridurre ulteriormente il rischio di rilevamento basato sul fingerprinting. Questo rende la tua automazione indistinguibile da un utente standard.

Monitora le richieste API interne

Ispeziona la scheda Network del browser per identificare gli endpoint JSON utilizzati dalle chiamate AJAX del sito, che a volte possono essere interrogati direttamente per un recupero dati più rapido. L'uso di questi endpoint può evitare la necessità di rendering completi della pagina.

Usa proxy residenziali

Per evitare di essere identificato come un bot di un datacenter, utilizza proxy residenziali che offrono punteggi di affidabilità più elevati e hanno meno probabilità di attivare i blocchi aggressivi di Cloudflare. Forniscono la connessione più stabile per sessioni di scraping di lunga durata.

Testimonianze

Cosa dicono i nostri utenti

Unisciti a migliaia di utenti soddisfatti che hanno trasformato il loro workflow

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Correlati Web Scraping

How to Scrape Bilregistret.ai: Swedish Vehicle Data Extraction Guide

How to Scrape CSS Author: A Comprehensive Web Scraping Guide

How to Scrape Biluppgifter.se: Vehicle Data Extraction Guide

How to Scrape The AA (theaa.com): A Technical Guide for Car & Insurance Data

How to Scrape Car.info | Vehicle Data & Valuation Extraction Guide

How to Scrape GoAbroad Study Abroad Programs

How to Scrape ResearchGate: Publication and Researcher Data

How to Scrape Statista: The Ultimate Guide to Market Data Extraction

Domande frequenti su whatsmydns.net

Trova risposte alle domande comuni su whatsmydns.net